01

研究動(dòng)機(jī)

以ChatGPT為代表的大語言模型(Large Language Models, LLM)在機(jī)器翻譯(Machine Translation, MT)任務(wù)上展現(xiàn)出了驚人的潛力。通過情景學(xué)習(xí)(In-Context Learning,ICL),大語言模型可以根據(jù)任務(wù)示例和任務(wù)指令,在不更新模型參數(shù)的情況下,完成特定下游任務(wù)。然而,值得注意的是,這些大語言模型主要基于大規(guī)模的數(shù)據(jù)進(jìn)行語言模型任務(wù)的學(xué)習(xí),并沒有在大規(guī)模多語言翻譯數(shù)據(jù)上訓(xùn)練過,我們非常好奇于:(1)大語言模型的多語言機(jī)器翻譯能力如何?(2)哪些因素會(huì)影響大語言模型的翻譯表現(xiàn)?為了探究這些問題,本文評(píng)測了XGLM[1],OPT[2],BLOOMZ[3],ChatGPT[4]等眾多熱門大語言模型在百余種語言上的翻譯能力,并且分析了在情景學(xué)習(xí)中各種因素對(duì)翻譯效果的影響。

02

貢獻(xiàn)

1. 本文在102種語言以及202個(gè)以英文為核心的翻譯方向上全面地評(píng)測了包括ChatGPT在內(nèi)的熱門大語言模型的多語言機(jī)器翻譯能力。

2. 本文系統(tǒng)地報(bào)告了一系列大語言模型以及兩個(gè)有監(jiān)督基線的翻譯表現(xiàn),為后續(xù)大語言模型和多語言機(jī)器翻譯研究工作提供了有力參照。

3. 本文還發(fā)現(xiàn)了在機(jī)器翻譯任務(wù)上大語言模型展現(xiàn)出了一些新的工作模式。

03

實(shí)驗(yàn)設(shè)定

為了全面地衡量大語言模型的多語言機(jī)器翻譯能力,本文選用Flores-101數(shù)據(jù)集[5]進(jìn)行實(shí)驗(yàn)。在應(yīng)用大語言模型進(jìn)行情景學(xué)習(xí)的過程中,本文設(shè)置任務(wù)示例數(shù)目為8,任務(wù)指令模版為“

04

大語言模型多語言機(jī)器翻譯能力評(píng)測

在系統(tǒng)地評(píng)測大語言模型的多語言翻譯能力后,本文得出了以下主要結(jié)論:

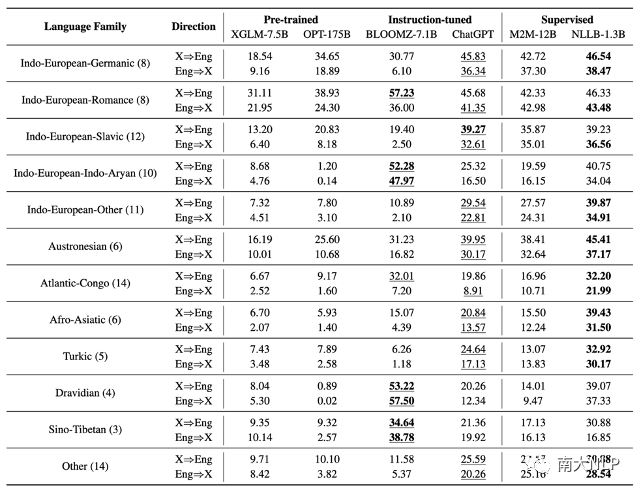

1. 在評(píng)測的四種大語言模型中,ChatGPT展現(xiàn)了最好的多語言機(jī)器翻譯效果:相比于只經(jīng)過預(yù)訓(xùn)練(pre-traing)的XGLM和OPT,經(jīng)過指令微調(diào)(instruction-tuning)的BLOOMZ和ChatGPT展現(xiàn)了更好的翻譯表現(xiàn)(表格1)。值得注意的是,BLOOMZ在七組翻譯方向上超過了有監(jiān)督基線模型,而ChatGPT在所有被評(píng)測的大語言模型中取得了最好的綜合翻譯表現(xiàn)。

2. 大語言模型翻譯其他語言到英語的表現(xiàn)往往比翻譯英語到其他語言的表現(xiàn)要好:此前的研究發(fā)現(xiàn)大語言模型在將其他語言翻譯到英語時(shí)往往有很好的表現(xiàn),而在將英語翻譯到其他語言時(shí)則表現(xiàn)較差。本文發(fā)現(xiàn)XGLM,OPT,BLOOMZ,ChatGPT也都存在這種偏好。但是,值得注意的是,ChatGPT已經(jīng)極大地改善了這種傾向。

表格 1 不同模型在各語系上的平均BLEU分?jǐn)?shù)

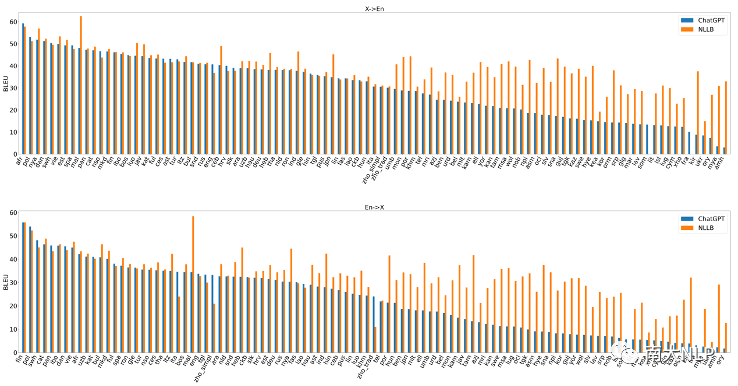

3. 在大部分語言上,尤其是低資源語言,大語言模型的翻譯效果仍然落后于強(qiáng)大的有監(jiān)督基線模型:圖1中畫出來了ChatGPT和NLLB模型在各個(gè)語言上的翻譯表現(xiàn),可以看出在圖片的左半部分,ChatGPT可以取得與NLLB相似的性能,而在圖片的右半部分,在低資源語言翻譯上,ChatGPT仍然遠(yuǎn)遠(yuǎn)落后于傳統(tǒng)的有監(jiān)督基線模型。

圖 1 ChatGPT和NLLB在各語言上的翻譯表現(xiàn)對(duì)比

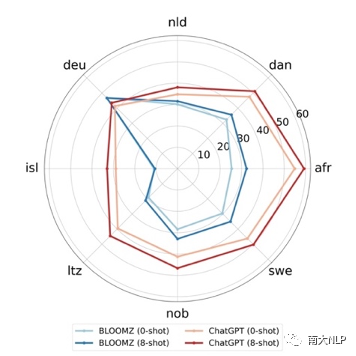

4. 指令微調(diào)過的大語言模型仍然可以從任務(wù)示例中受益:本文對(duì)比了BLOOMZ和ChatGPT這兩個(gè)經(jīng)過指令微調(diào)的模型在任務(wù)樣例數(shù)目分別為0和8時(shí)的翻譯表現(xiàn)(圖2),可以看出即使對(duì)于指令微調(diào)過的模型,提供任務(wù)示例依然可以進(jìn)一步提升其翻譯能力。這也是本文在評(píng)測大語言模型翻譯能力同時(shí)提供任務(wù)示例和任務(wù)指令的原因。

圖 2 BLOOMZ和ChatGPT在給定不同數(shù)目的任務(wù)示例時(shí)的翻譯表現(xiàn)對(duì)比

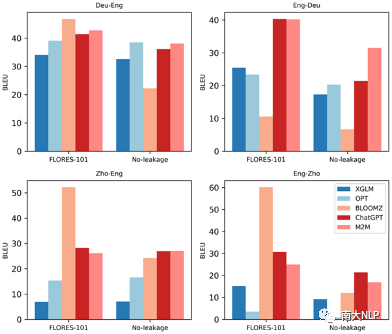

5. 在公開數(shù)據(jù)上評(píng)測大語言模型有數(shù)據(jù)泄漏的風(fēng)險(xiǎn):為了考察數(shù)據(jù)泄漏對(duì)評(píng)測結(jié)果的影響,本文基于近期的英語新聞,人工構(gòu)建了一個(gè)中-英-德三語無泄漏機(jī)器翻譯測試集。在該測試集上的測試結(jié)果顯示:XGLM和OPT在新標(biāo)注測試集上取得了與公開測試集上相似的性能,而ChatGPT在英語-德語翻譯上性能出現(xiàn)大幅下降,BLOOMZ更是在四個(gè)測試方向上都出現(xiàn)性能下降的問題(圖3)。這說明BLOOMZ在Flores-101上取得很好的表現(xiàn)很可能是數(shù)據(jù)泄漏導(dǎo)致的。

圖 3 不同模型在Flores-101測試集和無泄漏測試集上的翻譯表現(xiàn)

05

大語言模型機(jī)器翻譯能力影響因素分析

為了更好地理解大語言模型如何通過情景學(xué)習(xí)中完成翻譯任務(wù),本文以XGLM為例分析了情景學(xué)習(xí)中諸多因素對(duì)翻譯效果的影響。以下介紹本文在關(guān)于任務(wù)指令和任務(wù)示例兩方面的相關(guān)發(fā)現(xiàn):

1. 與任務(wù)指令相關(guān)的發(fā)現(xiàn):

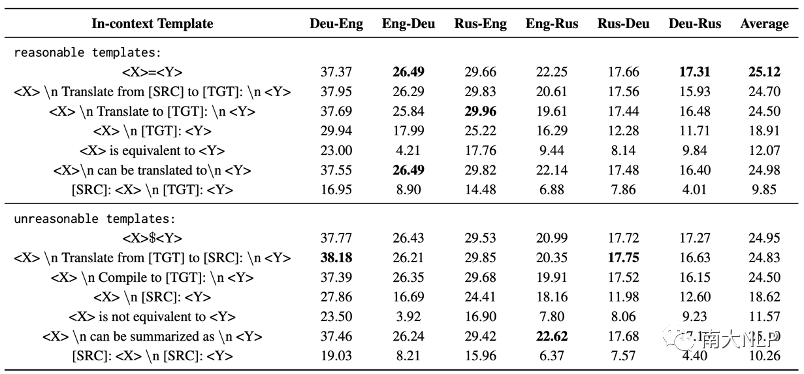

大語言模型在下游任務(wù)上的良好表現(xiàn)依賴于精心設(shè)計(jì)的指令:本文發(fā)現(xiàn)大語言模型在下游任務(wù)上的表現(xiàn)會(huì)隨著指令內(nèi)容的不同而劇烈變化。并且在不同翻譯方向上,最好的指令也不同(表格2)在這些指令中,“

即使是不合理的指令也可以引導(dǎo)大語言模型完成翻譯任務(wù):直覺上,人們認(rèn)為大語言模型理解了任務(wù)指令所以能夠完成指定的下游任務(wù)。但是本文發(fā)現(xiàn),在情景學(xué)習(xí)時(shí)使用任務(wù)無關(guān)的指令,大語言模型依然可以完成目標(biāo)任務(wù)。例如,面對(duì)指令“

表格 2 使用不同任務(wù)指令對(duì)翻譯效果的影響

2. 關(guān)于任務(wù)示例的發(fā)現(xiàn)

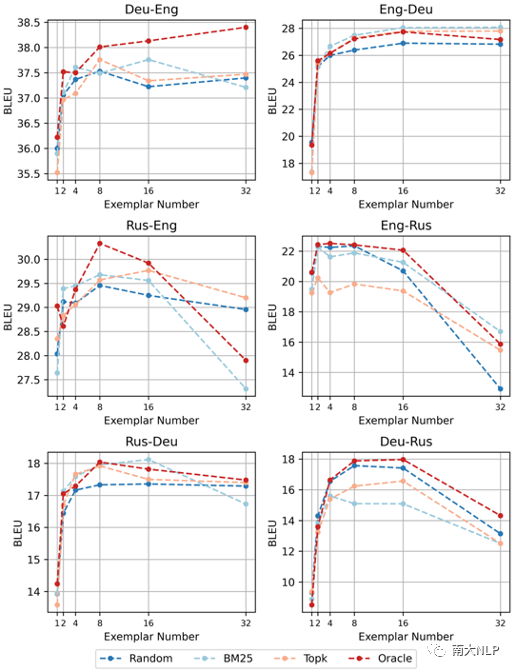

根據(jù)語義選擇示例與隨機(jī)選擇示例效果相當(dāng):為了研究任務(wù)示例對(duì)情景學(xué)習(xí)效果的影響,本文對(duì)比了包括隨機(jī)檢索、稀疏檢索、稠密檢索在內(nèi)的多種任務(wù)示例選擇策略(圖4)。實(shí)驗(yàn)結(jié)果表明當(dāng)任務(wù)樣例數(shù)目從1增加到8時(shí),BLEU分?jǐn)?shù)會(huì)顯著提升。但是進(jìn)一步增加樣例數(shù)目,BLEU分?jǐn)?shù)基本變化不大,甚至?xí)_始下降。相比于根據(jù)語義進(jìn)行選擇,隨機(jī)選擇也可以取得相似的效果。并且即使根據(jù)目標(biāo)句進(jìn)行檢索,也沒有展現(xiàn)出明顯的優(yōu)勢(shì)。這些實(shí)驗(yàn)結(jié)果表明,翻譯任務(wù)示例可以幫助大語言模型理解翻譯任務(wù),但是大語言模型可能很難從語義相關(guān)的翻譯示例中直接獲取有幫助的翻譯知識(shí)。

圖4使用不同任務(wù)示例選擇策略對(duì)翻譯效果的影響

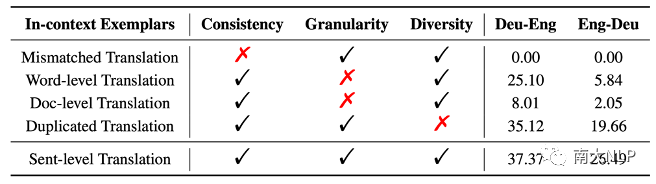

翻譯任務(wù)示例幫助大語言模型理解翻譯任務(wù)的核心特征:為了理解翻譯任務(wù)示例如何影響大語言模型理解翻譯任務(wù),本文觀察了大語言模型在不同任務(wù)示例下的翻譯表現(xiàn)(表格3)。當(dāng)使用不匹配的翻譯句對(duì)作為任務(wù)樣例時(shí),大語言模型完全無法進(jìn)行翻譯。這說明模型從翻譯任務(wù)示例中學(xué)習(xí)到需要保證源句和目標(biāo)句語義一致。當(dāng)使用詞級(jí)別或者段落級(jí)別翻譯對(duì)作為翻譯示例時(shí),模型的翻譯質(zhì)量顯著下降,這說明任務(wù)樣例的粒度也很重要。當(dāng)使用重復(fù)的翻譯句對(duì)作為翻譯樣例時(shí),模型的翻譯質(zhì)量也會(huì)下降,這說明保持任務(wù)示例的多樣性也是保證模型下游任務(wù)性能的必要條件。總體來說,這些對(duì)比實(shí)驗(yàn)的結(jié)果說明大語言在情景學(xué)習(xí)中,通過任務(wù)樣例理解了翻譯任務(wù)的核心需求。

表格 3 在給定不同任務(wù)示例時(shí)XGLM的翻譯表現(xiàn)

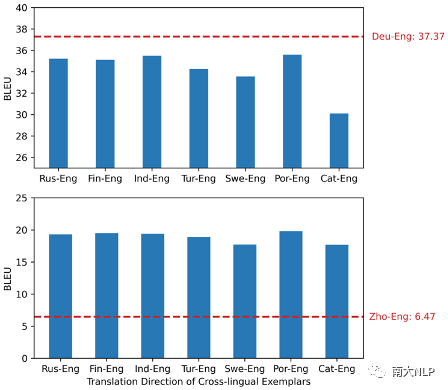

使用跨語言任務(wù)示例也可能帶來翻譯性能提升:本文發(fā)現(xiàn)在機(jī)器翻譯的情景學(xué)習(xí)中,使用不同語言對(duì)的翻譯句對(duì)作為任務(wù)示例并不一定會(huì)導(dǎo)致翻譯質(zhì)量下降。例如,在進(jìn)行德語-英語翻譯時(shí),如果使用跨語言任務(wù)示例會(huì)導(dǎo)致翻譯質(zhì)量下降;而在進(jìn)行漢語-英語翻譯時(shí),使用跨語言任務(wù)示例則可以大幅提升翻譯性能(圖5)。這顯示了跨語言任務(wù)示例在情景學(xué)習(xí)中的潛在用途。

圖 5 使用跨語言翻譯任務(wù)示例的效果

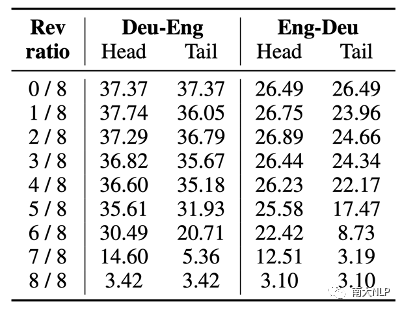

在上下文末尾位置的任務(wù)示例對(duì)于大語言模型的行為有著更大的影響:本文發(fā)現(xiàn)使用與目標(biāo)翻譯方向相反的翻譯句對(duì)作為任務(wù)示例時(shí),大語言模型完全無法進(jìn)行正確的翻譯。利用這種特性,本文考察了在上下文的不同位置的任務(wù)示例對(duì)大語言模型的翻譯行為的影響程度。表格4中的實(shí)驗(yàn)結(jié)果表明,在使用相同數(shù)量的反向任務(wù)示例時(shí),反向任務(wù)示例出現(xiàn)在上下文的末尾位置時(shí),大語言模型的翻譯表現(xiàn)會(huì)更差。這說明在末尾位置的任務(wù)示例對(duì)于大語言模型的行為有著更大的影響。

表格 4 反轉(zhuǎn)任務(wù)示例翻譯方向?qū)Ψg效果的影響

06

總結(jié)

本文系統(tǒng)地評(píng)測了包括ChatGPT在內(nèi)的一系列大語言模型在102種語言,202個(gè)以英文為核心的翻譯方向上的多語言機(jī)器翻譯能力,探究了使用大語言模型進(jìn)行多語言機(jī)器翻譯的優(yōu)勢(shì)與挑戰(zhàn)。我們發(fā)現(xiàn)即使是最強(qiáng)的大語言模型(ChatGPT),仍然在83.33%的翻譯方向上落后于強(qiáng)大的有監(jiān)督基線模型(NLLB)。經(jīng)過進(jìn)一步的分析實(shí)驗(yàn),我們發(fā)現(xiàn)在機(jī)器翻譯任務(wù)上,大語言模型展現(xiàn)出了一些新的工作模式:例如,在情景學(xué)習(xí)時(shí),任務(wù)指令的語義可以被大語言模型所忽視;使用跨語言任務(wù)示例可以提升低資源機(jī)器翻譯效果。更重要的是,我們發(fā)現(xiàn)BLOOMZ在公開數(shù)據(jù)集上的表現(xiàn)是被高估的,而如何公平地比較不同語言模型的能力將是大語言模型時(shí)代的一個(gè)重要話題。

審核編輯:劉清

-

Opt

+關(guān)注

關(guān)注

2文章

18瀏覽量

15124 -

語言模型

+關(guān)注

關(guān)注

0文章

527瀏覽量

10292 -

ChatGPT

+關(guān)注

關(guān)注

29文章

1564瀏覽量

7800

原文標(biāo)題:大語言模型的多語言機(jī)器翻譯能力分析

文章出處:【微信號(hào):zenRRan,微信公眾號(hào):深度學(xué)習(xí)自然語言處理】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

多語言開發(fā)的流程詳解

基于機(jī)器翻譯增加的跨語言機(jī)器閱讀理解算法

機(jī)器翻譯三大核心技術(shù)原理 | AI知識(shí)科普

神經(jīng)機(jī)器翻譯的方法有哪些?

SoC多語言協(xié)同驗(yàn)證平臺(tái)技術(shù)研究

谷歌再次發(fā)布BERT的多語言模型和中文模型

阿里宣布完成全球首個(gè)多語言實(shí)時(shí)翻譯的電商直播

人工智能翻譯mRASP:可翻譯32種語言

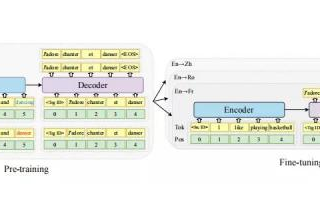

多語言翻譯新范式的工作:機(jī)器翻譯界的BERT

Multilingual多語言預(yù)訓(xùn)練語言模型的套路

多語言任務(wù)在內(nèi)的多種NLP任務(wù)實(shí)現(xiàn)

借助機(jī)器翻譯來生成偽視覺-目標(biāo)語言對(duì)進(jìn)行跨語言遷移

基于LLaMA的多語言數(shù)學(xué)推理大模型

大語言模型(LLMs)如何處理多語言輸入問題

大語言模型的多語言機(jī)器翻譯能力分析

大語言模型的多語言機(jī)器翻譯能力分析

評(píng)論