一般認(rèn)為,大腦對(duì)可視目標(biāo)的識(shí)別過程分為兩部分:視覺屬性和語義屬性,即目標(biāo)“像什么“和”是什么“。過去人們對(duì)這兩部分一般是分開研究的,現(xiàn)在,劍橋大學(xué)的研究人員利用計(jì)算機(jī)視覺的標(biāo)準(zhǔn)深度神經(jīng)網(wǎng)絡(luò)AlexNet,可以將二者結(jié)合起來研究,并探尋它們之間的信息交互和映射關(guān)系究竟是怎樣的。

劍橋大學(xué)的神經(jīng)科學(xué)研究人員將計(jì)算機(jī)視覺與語義相結(jié)合,開發(fā)出一種新模型,可以更清晰地理解大腦對(duì)視覺目標(biāo)的處理方式。

人類識(shí)別目標(biāo)的能力分為兩個(gè)主要過程,對(duì)目標(biāo)的快速視覺分析,以及對(duì)整個(gè)生命過程中獲得的語義知識(shí)的激活。大多數(shù)過去的研究一般是對(duì)這兩個(gè)過程進(jìn)行分別研究。因此,這兩個(gè)過程之間的相互作用目前仍然很不清楚。

新的DNN目標(biāo)識(shí)別模型: 同時(shí)關(guān)注“像什么”和“是什么”

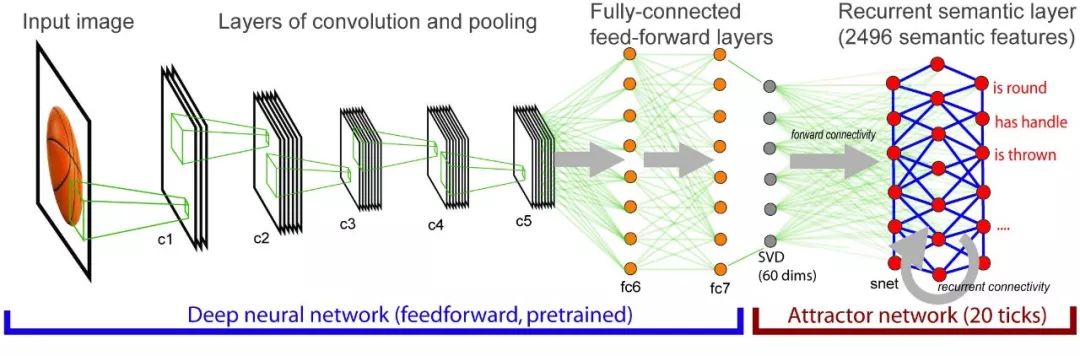

劍橋大學(xué)的研究人員團(tuán)隊(duì)使用一種新方法研究了大腦對(duì)目標(biāo)的識(shí)別過程,該方法結(jié)合了深度神經(jīng)網(wǎng)絡(luò)與吸引子網(wǎng)絡(luò)語義模型。與之前的大多數(shù)研究相比,這一識(shí)別技術(shù)既考慮了視覺信息,也考慮了關(guān)于被識(shí)別目標(biāo)的概念知識(shí)。

劍橋大學(xué)的研究人員表示:“我們之前曾對(duì)健康人和腦損傷患者進(jìn)行了大量研究,以更好地了解大腦中對(duì)識(shí)別目標(biāo)的處理方式。這項(xiàng)工作的主要貢獻(xiàn)之一是,它表明了大腦在理解‘目標(biāo)是什么’這個(gè)問題時(shí),涉及到視覺輸入隨著時(shí)間的推移,迅速轉(zhuǎn)變?yōu)橛幸饬x的表現(xiàn)形式,這種轉(zhuǎn)變過程是沿著腹側(cè)顳葉完成的。”

研究人員堅(jiān)信,對(duì)語義記憶的訪問是理解“目標(biāo)是什么”的關(guān)鍵,因此僅關(guān)注與視覺相關(guān)的屬性的理論并不能完全捕捉到這個(gè)復(fù)雜的過程。

該集成模型的體系結(jié)構(gòu),可以看到,會(huì)有越來越復(fù)雜的視覺信息映射到語義信息上。

來源:Lorraine Tyler等。

“就是這個(gè)問題催生出了我們目前的研究,我們希望能夠完全理解低級(jí)視覺輸入是如何映射到對(duì)象意義的語義表示上的。”研究人員解釋說。為此,他們使用了一個(gè)專門用于計(jì)算機(jī)視覺的標(biāo)準(zhǔn)深度神經(jīng)網(wǎng)絡(luò),稱為AlexNet。

他們解釋說:“這個(gè)模型以及其他類似模型可以非常精確地識(shí)別圖像中的對(duì)象,但模型中不包含任何關(guān)于對(duì)象語義屬性的明確知識(shí)。例如,香蕉和獼猴桃的外觀(不同的顏色,形狀,質(zhì)地等)有很大不同,但是,我們能夠正確地理解它們都是水果。計(jì)算機(jī)視覺的模型可以區(qū)分香蕉和獼猴桃,但這些模型并不是對(duì)更抽象的知識(shí)進(jìn)行編碼,即:它們都是水果。”

研究人員認(rèn)識(shí)到神經(jīng)網(wǎng)絡(luò)在計(jì)算機(jī)視覺應(yīng)用方面的局限性,將AlexNet視覺算法與神經(jīng)網(wǎng)絡(luò)相結(jié)合,將概念性的意義(包括語義知識(shí))納入到對(duì)方程的分析中。

“像什么”和“是什么”的關(guān)系如何,信息如何交互和映射?

研究人員表示:“在這個(gè)組合模型中,會(huì)將視覺處理映射至語義處理,并激活我們關(guān)于概念的語義知識(shí),”這個(gè)新技術(shù)已經(jīng)在16名志愿者的神經(jīng)影像數(shù)據(jù)上進(jìn)行了測(cè)試,志愿者被要求在接受功能性核磁共振(fMRI)掃描的同時(shí)說出測(cè)試圖片中目標(biāo)的名字。與傳統(tǒng)的深度神經(jīng)網(wǎng)絡(luò)(DNN)視覺模型相比,新方法能夠識(shí)別與視覺和語義處理相關(guān)的不同腦區(qū)。

圖為視覺深度神經(jīng)網(wǎng)絡(luò)(紫色)和語義吸引網(wǎng)絡(luò)(紅色-黃色)的不同層如何映射到大腦的不同區(qū)域。

來源:Lorraine Tyler等。

“這項(xiàng)研究最關(guān)鍵的發(fā)現(xiàn)是,通過考慮物體的視覺和語義屬性,可以更好地模擬物體識(shí)別過程中的大腦活動(dòng),這可以通過計(jì)算建模方法捕獲,”研究人員解釋說。

研究人員設(shè)計(jì)的方法對(duì)大腦中語義激活的階段進(jìn)行了預(yù)測(cè),預(yù)測(cè)結(jié)果與先前對(duì)目標(biāo)的處理結(jié)果是一致的,其中粒度更粗的語義處理被更精細(xì)的處理所取代。研究人員還發(fā)現(xiàn),該模型在不同階段預(yù)測(cè)了大腦不同區(qū)域的對(duì)象處理方式的激活。

“最終,關(guān)于如何有意義地處理視覺目標(biāo)的更優(yōu)秀的模型可能具有重要的臨床意義。例如,語義性癡呆癥的患者就失去了對(duì)象概念意義的知識(shí),這項(xiàng)研究的發(fā)現(xiàn)對(duì)于該病的治療是很有幫助的。”研究人員說。

劍橋大學(xué)的這項(xiàng)研究是對(duì)神經(jīng)科學(xué)領(lǐng)域的重要貢獻(xiàn),因?yàn)樗故玖舜竽X的不同區(qū)域是如何推進(jìn)對(duì)目標(biāo)的視覺處理和語義處理的。該研究最近發(fā)表在《Scientific Reports》上。

-

神經(jīng)網(wǎng)絡(luò)

+關(guān)注

關(guān)注

42文章

4779瀏覽量

101048 -

計(jì)算機(jī)視覺

+關(guān)注

關(guān)注

8文章

1700瀏覽量

46076

原文標(biāo)題:劍橋構(gòu)建視覺“語義大腦”:兼顧視覺信息和語義表示

文章出處:【微信號(hào):AI_era,微信公眾號(hào):新智元】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

開發(fā)者手機(jī) AI - 目標(biāo)識(shí)別 demo

RCS目標(biāo)識(shí)別

基于樣本正交子空間的SAR目標(biāo)識(shí)別方法

運(yùn)動(dòng)目標(biāo)識(shí)別與跟蹤系統(tǒng)的研究

基于顏色和區(qū)域的運(yùn)動(dòng)目標(biāo)識(shí)別

基于MVDR參數(shù)譜在艦船目標(biāo)識(shí)別中的應(yīng)用

紅外動(dòng)目標(biāo)識(shí)別跟蹤系統(tǒng)的實(shí)現(xiàn)方案

基于OpenCv運(yùn)動(dòng)目標(biāo)識(shí)別技術(shù)的研究孟介成

電磁場(chǎng)在目標(biāo)識(shí)別中的應(yīng)用

基于SIFT視覺詞匯的目標(biāo)識(shí)別算法

基于改進(jìn)KD樹與RANSC算法的目標(biāo)識(shí)別算法

基于擴(kuò)展字典稀疏表示分類的遙感目標(biāo)識(shí)別

新的DNN目標(biāo)識(shí)別模型: 同時(shí)關(guān)注“像什么”和“是什么”

新的DNN目標(biāo)識(shí)別模型: 同時(shí)關(guān)注“像什么”和“是什么”

評(píng)論