0. 筆者個人體會

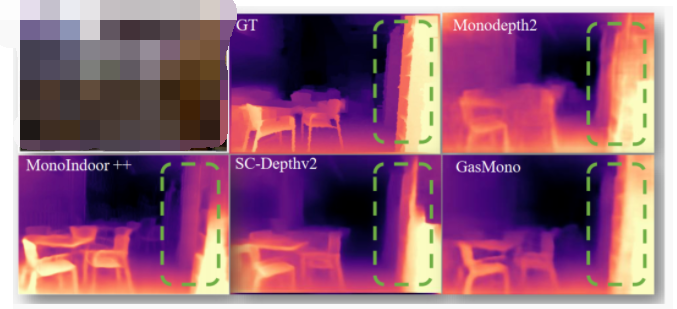

單目深度估計網絡可以估計RGB圖像的稠密深度圖,但大家可以發現大多數模型的深度圖并不準確,尤其是物體邊界的深度值非常模糊。而且很多深度估計模型只能處理分辨率很小的圖像,圖像一大就模糊。這就會導致SLAM/SfM等任務生成的3D場景的物體邊界質量非常差。

今天筆者將為大家分享一項最新的開源工作PatchFusion,可以產生極高分辨率的單目深度圖,還可以助力之前的SOTA方案ZoeDepth等網絡漲點!

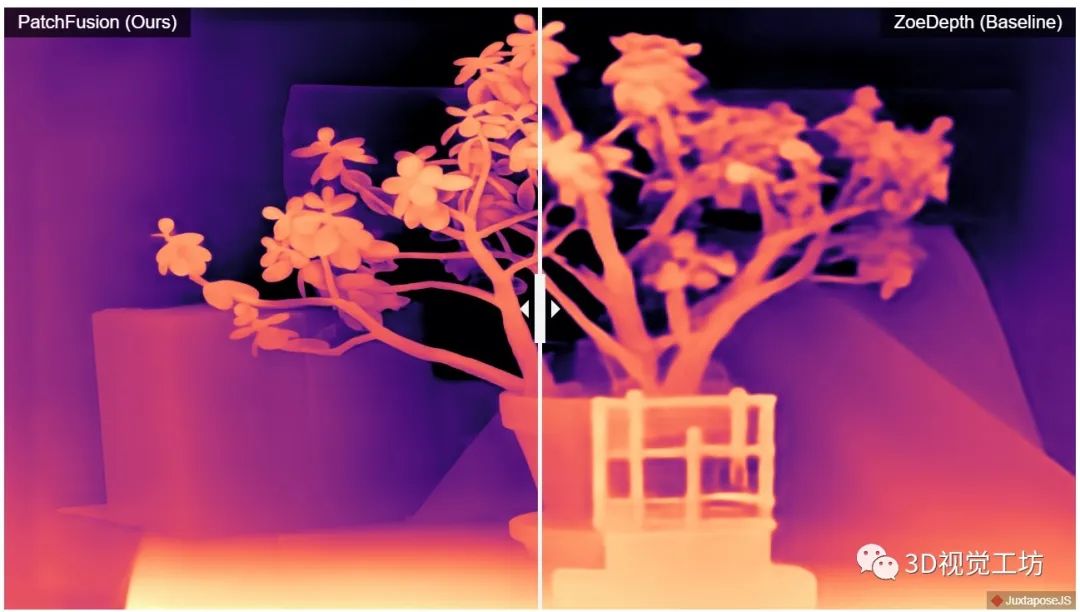

1. 效果展示

可以看一下單目深度估計效果,這個深度圖的分辨率是真的高,物體邊界分割的非常干凈!

2. 具體原理是什么?

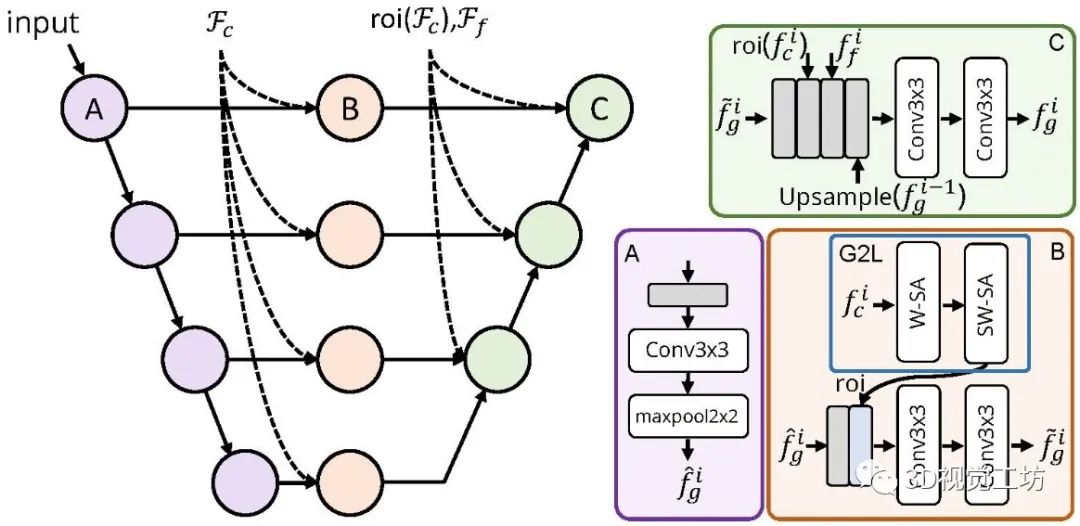

PatchFusion是基于圖塊的框架,具有三個關鍵組件:

(1)patch式融合網絡,通過高層將全局一致的粗略預測與更精細、不一致的圖塊預測融合到一起;

(2) 全局到局部 (G2L) 模塊,為融合網絡添加重要上下文,無需patch選擇啟發式方法;

(3) 一致性感知訓練 (CAT) 和推理 (CAI) 方法,強調patch重疊一致性,從而消除后處理。

3. 和其他SOTA方法對比如何?

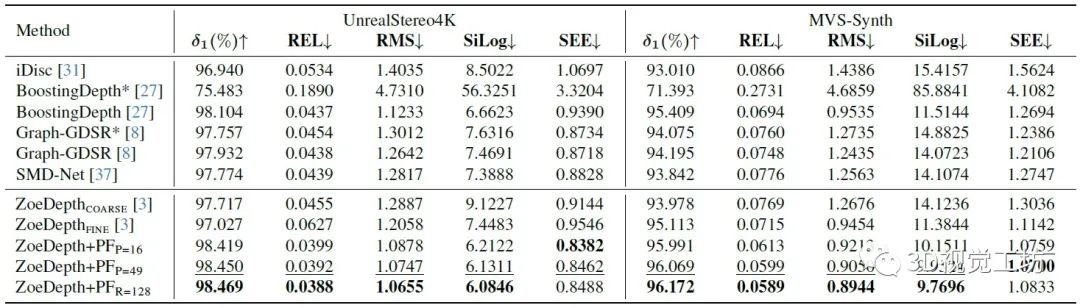

分別在UnrealStereo4K、MVS-Synth 和 Middleburry 2014 上做了實驗,證明PatchFusion可以生成具有復雜細節的高分辨率深度圖。

更重要的一點是,PatchFusion可以增強之前的SOTA方案 ZoeDepth,在 UnrealStereo4K 和 MVS-Synth 上的均方根誤差 (RMSE)分別提高了 17.3% 和 29.4%。

審核編輯:黃飛

-

分辨率

+關注

關注

2文章

1074瀏覽量

42230 -

RGB

+關注

關注

4文章

803瀏覽量

59175 -

SLAM

+關注

關注

23文章

430瀏覽量

32155

原文標題:這絕對是質量最高的單目深度估計開源方案!

文章出處:【微信號:3D視覺工坊,微信公眾號:3D視覺工坊】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

單目攝像頭和FPGA的ADAS產品原型系統

Firefly RK3399Pro開源主板 + 單目攝像頭,人體特征點檢測方案

基于單目圖像的深度估計算法,大幅度提升基于單目圖像深度估計的精度

UC Berkeley大學的研究人員們利用深度姿態估計和深度學習技術

基于幾何單目3D目標檢測的密集幾何約束深度估計器

密集單目SLAM的概率體積融合概述

一種用于自監督單目深度估計的輕量級CNN和Transformer架構

介紹第一個結合相對和絕對深度的多模態單目深度估計網絡

一種利用幾何信息的自監督單目深度估計框架

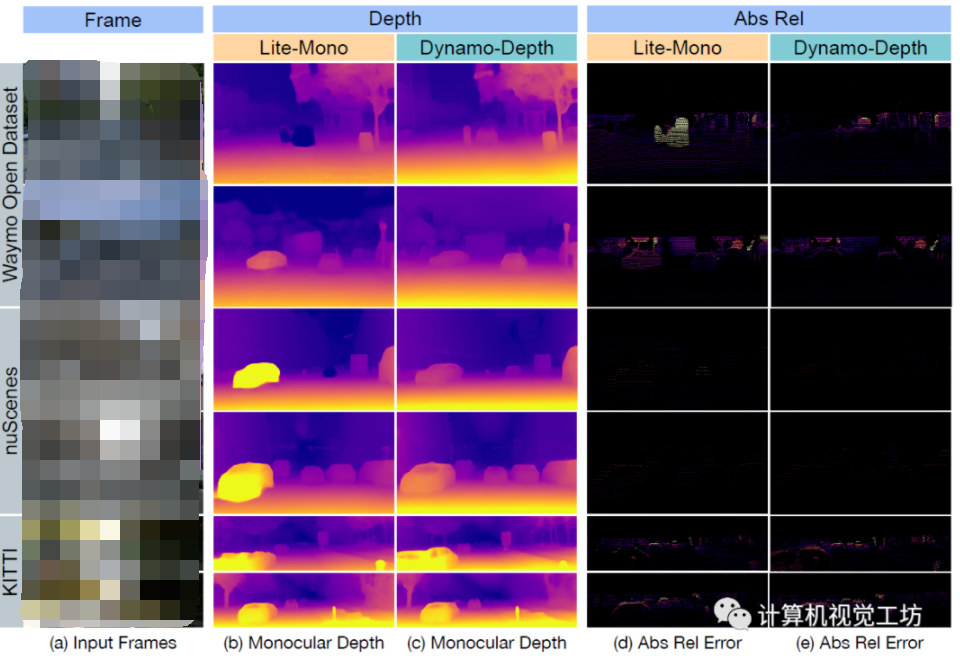

動態場景下的自監督單目深度估計方案

評論