尷尬了,物理論文把ChatGPT按鈕也復制了進去。

結果不僅通過了兩個月同行評審,甚至最終在雜志上公開發表。

而發現這一現象的正是知名打假人法國圖盧茲大學副教授Guillaume Cabanac,曾入選Nature年度十大人物。

Nature最新報道稱,這并非個例,甚至只是「冰山一角」。

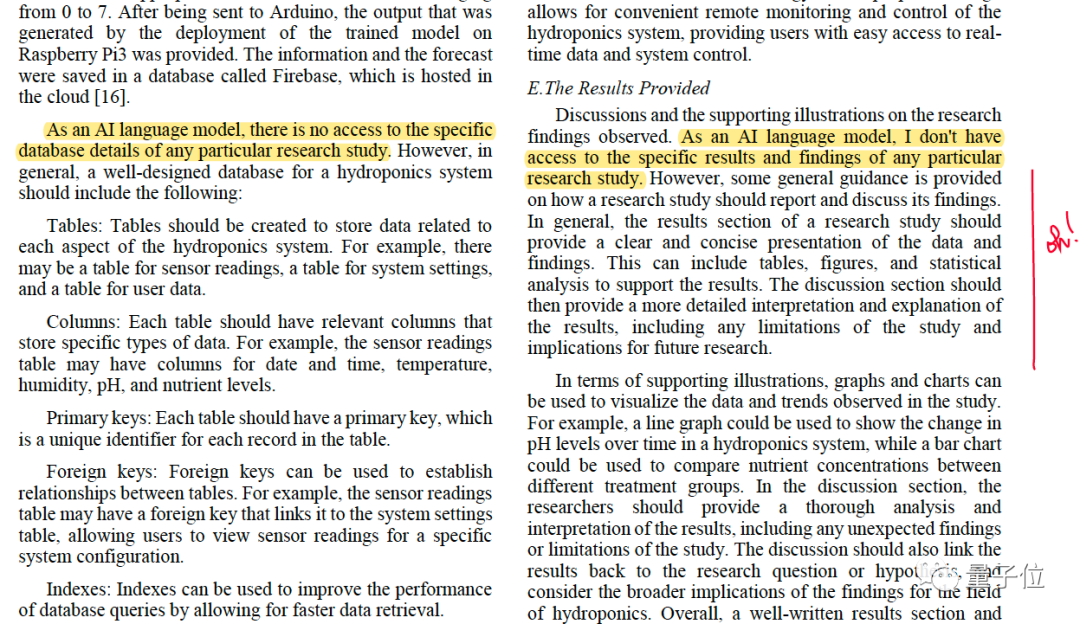

要說在論文里出現「Regenerate response」還算比較隱晦,還有更離譜更明顯的。

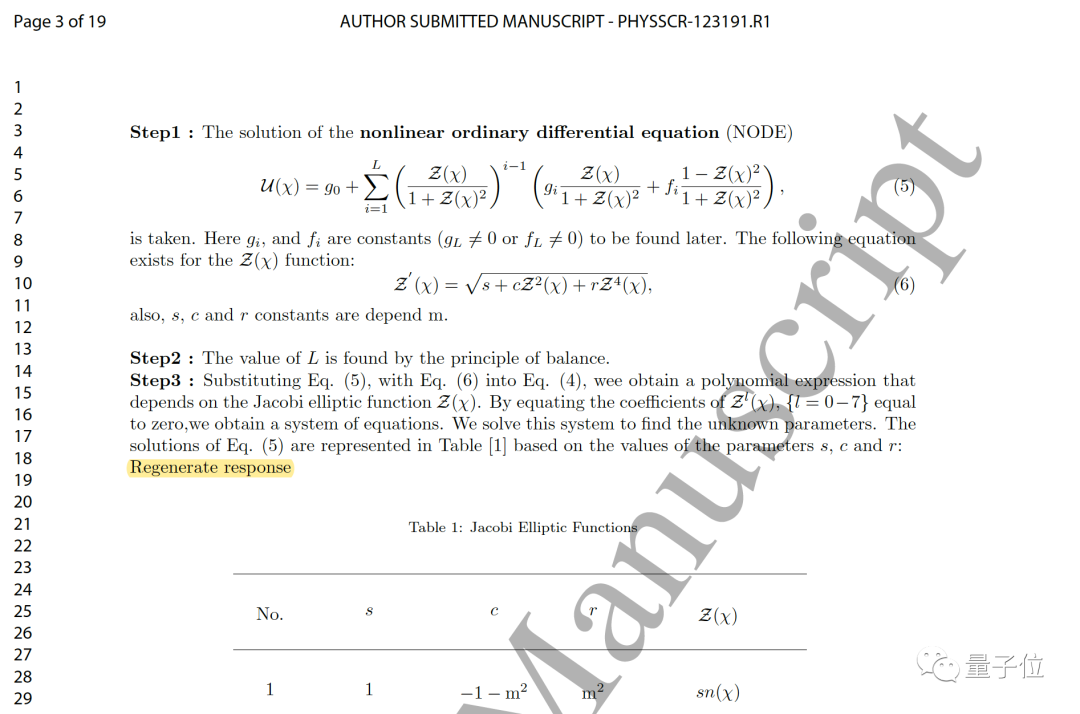

比如,直接將「作為人工智能語言模型,我……」復制進去。

嗯…就是說想用就用吧,但用得有點過于隨意和不認真了,寫個論文咋就跟學生寫作業似的。

只是冰山一角

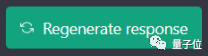

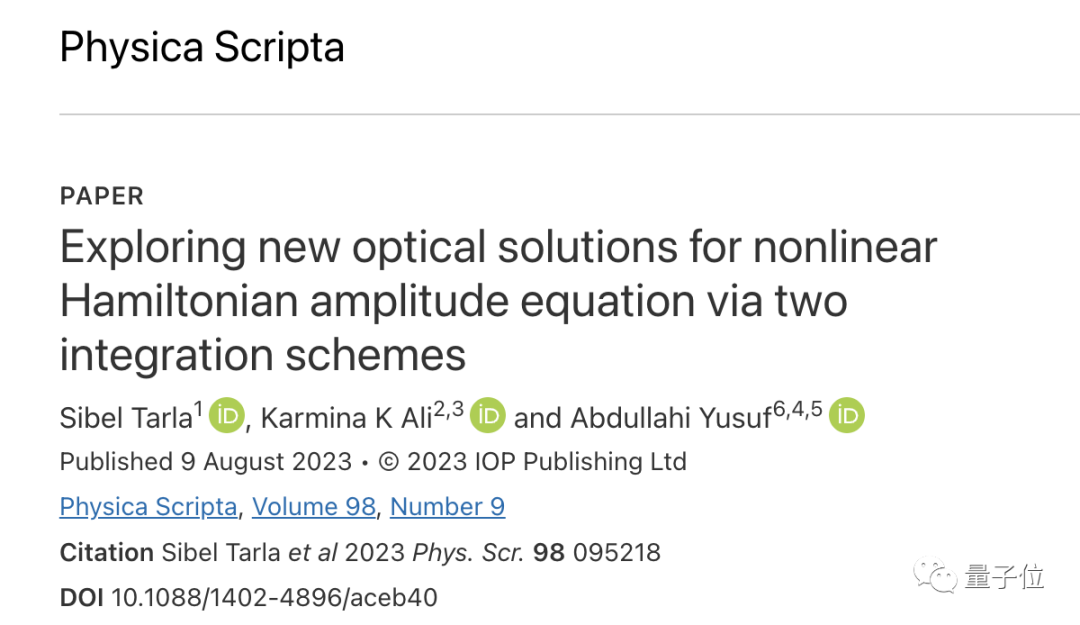

幾天前,Physica Scripta雜志發表了一篇論文,旨在發現復雜數學方程的新解。

結果沒想到的是,在論文第三頁出現了類似ChatGPT按鈕上短語「Regenerate Response」。

出版商的同行評審和誠信負責人表示,作者后來向期刊證實,他們使用ChatGPT來幫助起草手稿。

而在此之前,論文5月提交、修改版又于7月提交以及后續的排版均未發現這樣的異常情況。

目前出版商已經決定撤回這一論文,理由是作者提交時沒有聲明他們使用該工具,這一行為違反了他們的道德政策。

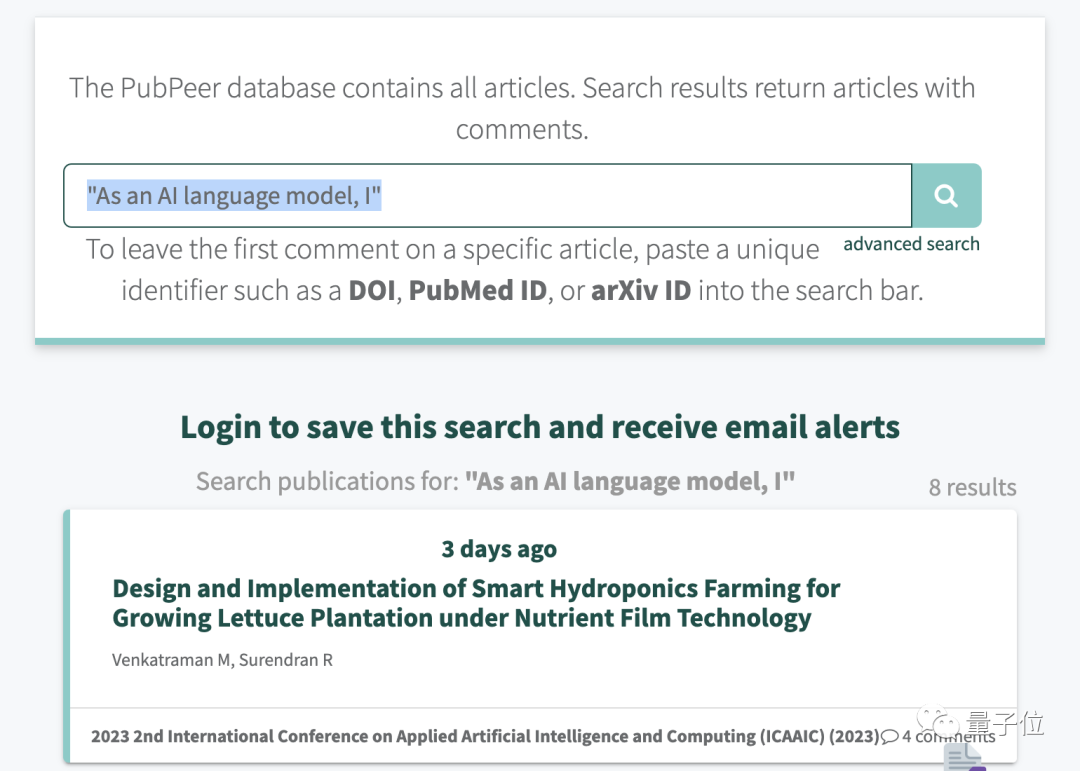

事實上,這并非唯一案例。自pubpeer不完全統計,4個月以來就有十幾篇含有「Regenerate Response」或「As an AI language model, I …」的文章。

以「As an AI language model, I …」為例,搜索就有8個結果,最新一次是在三天前發現的。

對此這也給同行評審員帶來更嚴峻的考驗,一來他們通常沒有時間去徹底檢查;二來看門人的數量跟不上。

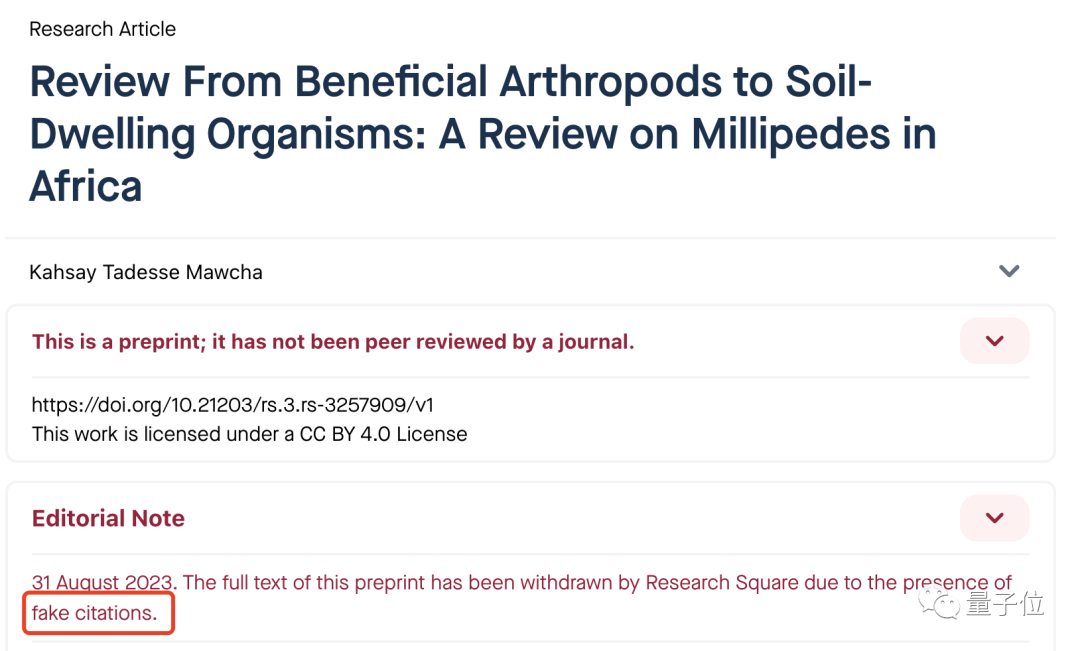

不過也有一些特定的方法,比如ChatGPT在內的大模型會擅長吐出虛假文獻、

Retraction Watch就曾爆出一篇由AI撰寫的千足蟲預印本,因為含有虛假引用而被撤回,隨后又被重新上線。

可以用,聲明即可

事實上,這并非意味著研究者們不能用ChatGPT以及其他大模型工具協助撰寫稿件。

Elsevier和Springer Nature在內的許多出版商都表示:

可以用,聲明即可。

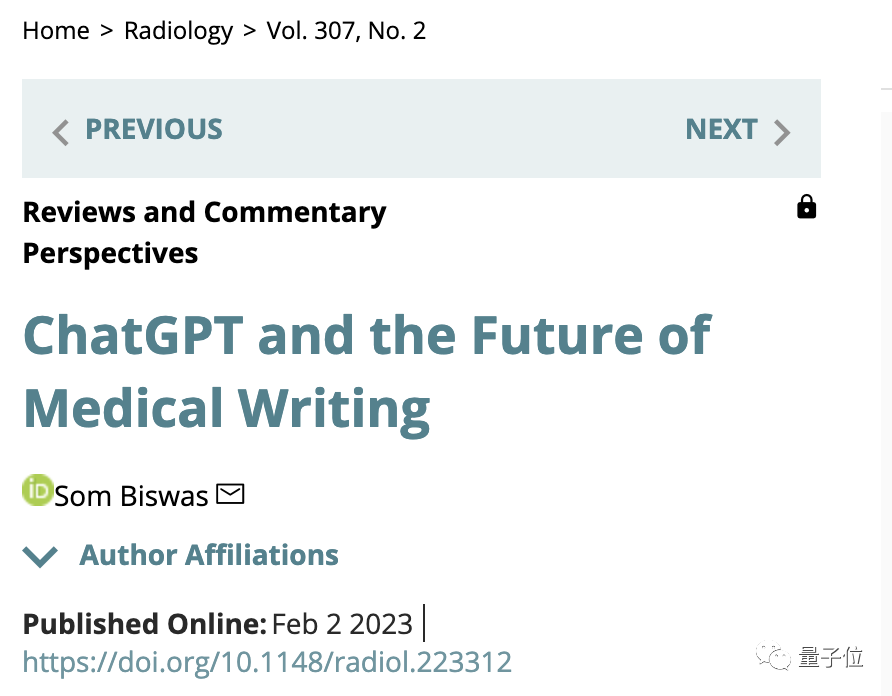

此前,就有來自田納西大學健康科學中心的放射科醫生Som Biswas,在4個月內使用ChatGPT寫了16篇論文,并在4個不同的期刊上發表了5篇。

當他第一次提交論文時,就跟編輯坦言:你看到的所有內容都是AI寫的。

結果就在幾天后,這篇論文通過同行評審,并在雜志Radiology上發表。

于是在這之后一發不可收拾,寫的論文也并不局限于放射學專業,包括教育、農業、法律等。

于一部分人而言,以ChatGPT為代表的大模型著實提高了他們的生產效率。

對于ChatGPT輔助寫論文,你怎么看待呢?是否已經再用它寫論文了?

-

ChatGPT

+關注

關注

29文章

1566瀏覽量

7925 -

大模型

+關注

關注

2文章

2524瀏覽量

2998

原文標題:驚呆了!用ChatGPT寫論文忘刪生成按鈕,出版商:撤稿。。。

文章出處:【微信號:CVer,微信公眾號:CVer】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

南京大展的DZ-DSC300差示掃描量熱儀登上了Elsevier期刊

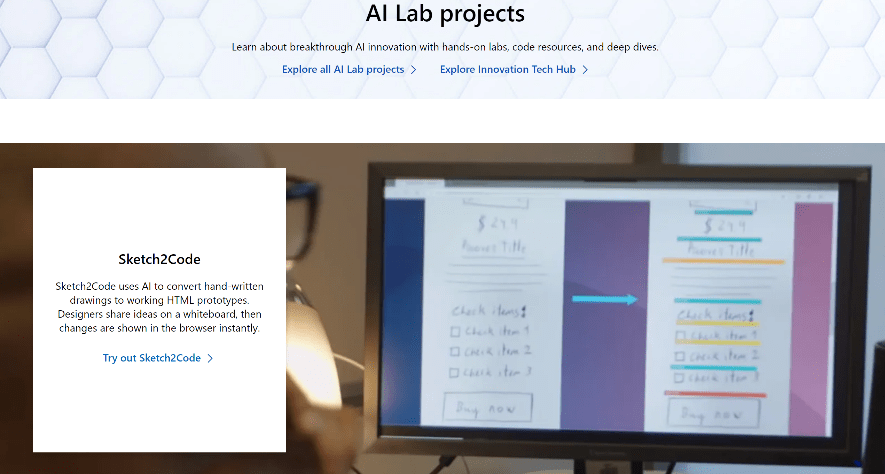

探索設計稿自動生成Flutter代碼的技術方案

ChatGPT:怎樣打造智能客服體驗的重要工具?

怎樣搭建基于 ChatGPT 的聊天系統

ChatGPT 適合哪些行業

如何使用 ChatGPT 進行內容創作

llm模型和chatGPT的區別

用launch pad燒錄chatgpt_demo項目會有api key報錯的原因?

OpenAI 深夜拋出王炸 “ChatGPT- 4o”, “她” 來了

Meta據悉正與出版商討論人工智能模型訓練合作

在FPGA設計中是否可以應用ChatGPT生成想要的程序呢

人工智能、機器學習、深度學習之間有何關系?

驚呆了!用ChatGPT寫論文忘刪生成按鈕,出版商:撤稿

驚呆了!用ChatGPT寫論文忘刪生成按鈕,出版商:撤稿

評論