視覺注意力機(jī)制的各種模塊是個好東西,即插即用,可以添加到主流的對象檢測、實例分割等模型的backbone與neck中,實現(xiàn)輕松漲點,本文使用OID數(shù)據(jù)集的2000多張數(shù)據(jù),基于YOLOv5s基礎(chǔ)上實現(xiàn)五種視覺注意力模塊的改進(jìn),然后訓(xùn)練相同的輪次,橫向比較模型的精度。

YOLOv5添加注意模塊魔改

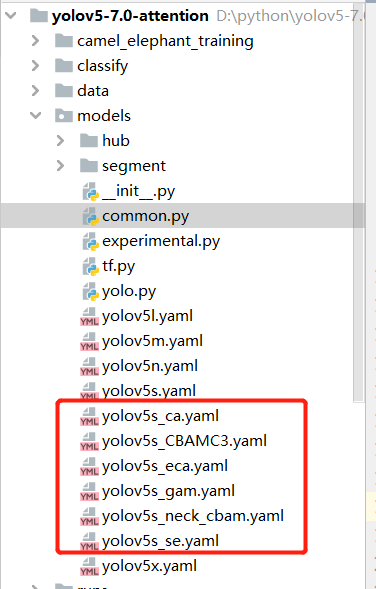

視覺注意力機(jī)制是一個好東西,即插即用,YOLOv5 7.0版本工程代碼簡潔明了,代碼加入視覺注意力模塊支持異常方便,以SE注意力為例,只要三步即可完成: 1. 修改模型結(jié)構(gòu)文件yaml、添加注意力機(jī)制SENet模塊 2. 修改模型結(jié)構(gòu)實現(xiàn)代碼文件common.py,實現(xiàn)SENet模塊代碼添加 3. 修改模型解析代碼文件yolo.py,注冊新添加的SENet模塊解析支持 這樣就完成了YOLOv5+SE注意力模塊的支持,別急,我還修改了ECA、CA、GAM、CBAM,顯示如下:

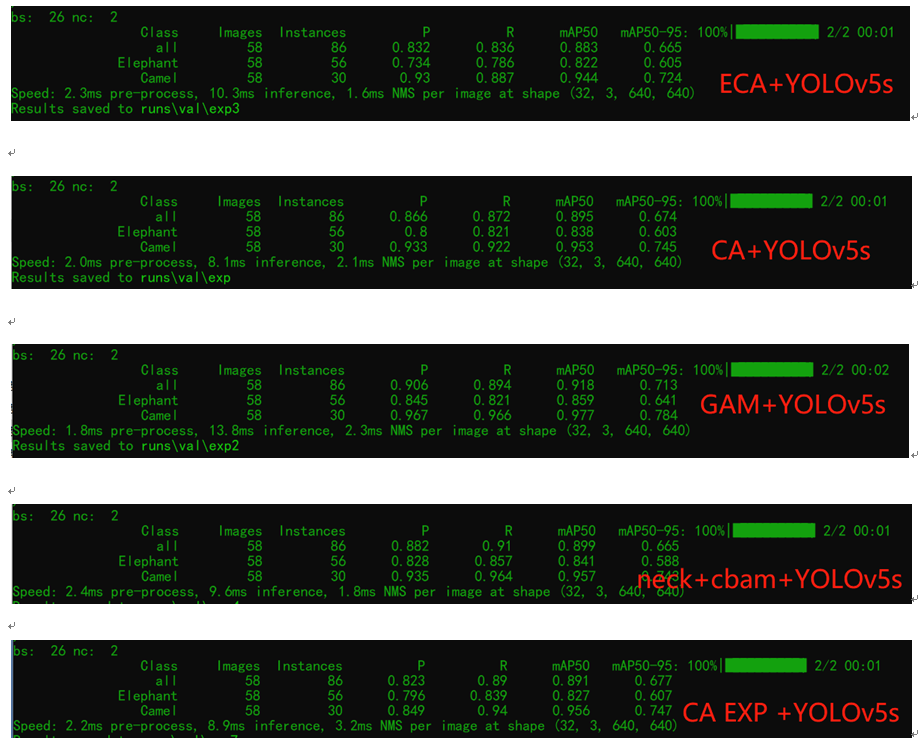

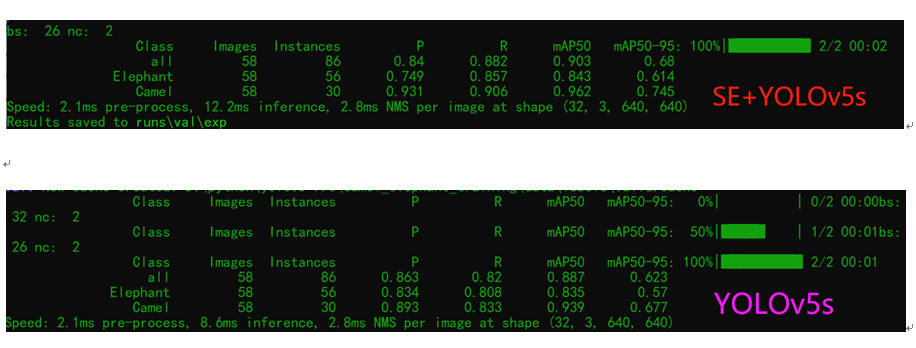

然后統(tǒng)統(tǒng)訓(xùn)練100輪次,跟原來的沒有添加注意力機(jī)制的對比一下,看看效果怎么樣?答案揭曉了,

我只是在SPPF之前的一層添加了注意力模塊,只有這個小小的改動!從效果看,基本都可以漲點了…

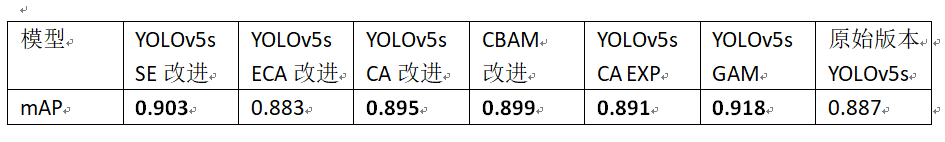

對比驗證結(jié)果

100 輪次OID數(shù)據(jù)集自定義數(shù)據(jù),YOLOv5s模型與SE、ECA、CA、CBAM、GAM五種注意力改進(jìn)模型,mAP指標(biāo)統(tǒng)計與對比

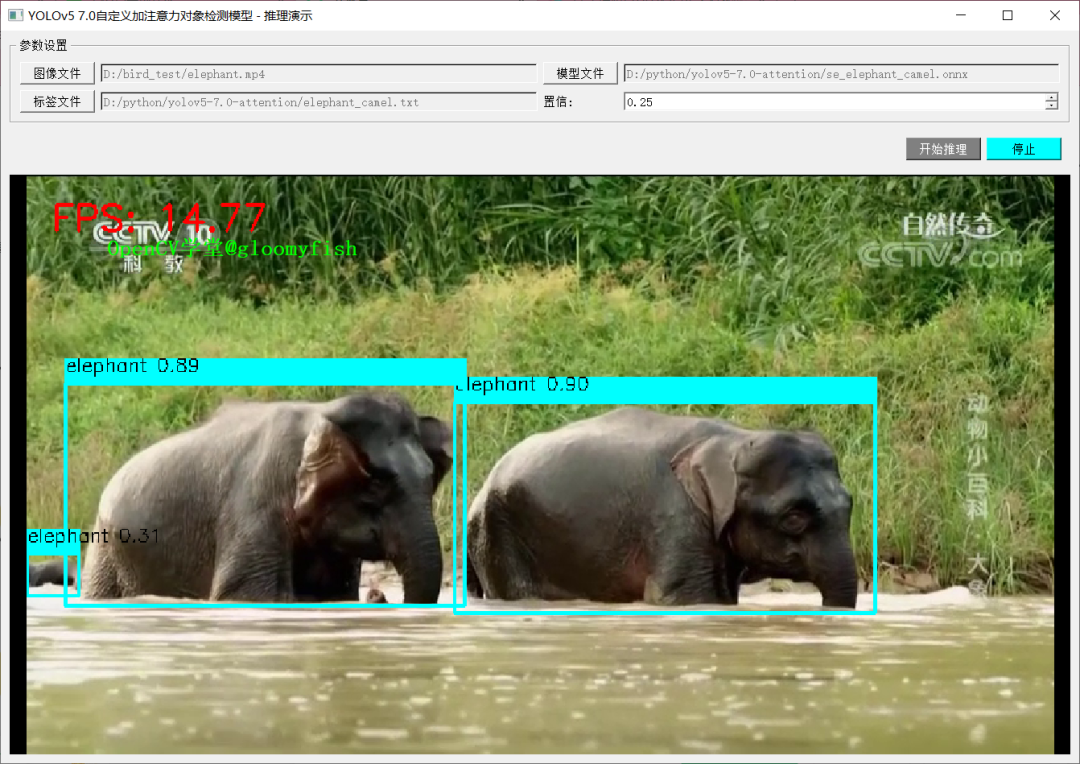

YOLOv5注意力機(jī)制模型部署

然后我還基于以前的測試程序上測試一下,導(dǎo)出ONNX格式,然后通過ONNXRUNTIME進(jìn)行推理,以SE注意力+YOLOv5s為例,感覺一切順利。PyQT5 + ONNXRUNTIME, 圖示如下:

責(zé)任編輯:彭菁

-

模塊

+關(guān)注

關(guān)注

7文章

2717瀏覽量

47555 -

數(shù)據(jù)

+關(guān)注

關(guān)注

8文章

7079瀏覽量

89166 -

代碼

+關(guān)注

關(guān)注

30文章

4799瀏覽量

68728

原文標(biāo)題:用注意力機(jī)制魔改YOLOv5漲點

文章出處:【微信號:CVSCHOOL,微信公眾號:OpenCV學(xué)堂】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

相關(guān)推薦

基于H743板子移植YOLOV5s做缺陷檢測可行嗎?

maixcam部署yolov5s 自定義模型

基于SLH89F5162的左額電壓信號的注意力比拼

基于labview的注意力分配實驗設(shè)計

YOLOv5s算法在RK3399ProD上的部署推理流程是怎樣的

怎樣使用PyTorch Hub去加載YOLOv5模型

如何YOLOv5測試代碼?

【愛芯派 Pro 開發(fā)板試用體驗】使用yolov5s模型(官方)

DeepMind為視覺問題回答提出了一種新的硬注意力機(jī)制

一種通過引入硬注意力機(jī)制來引導(dǎo)學(xué)習(xí)視覺回答任務(wù)的研究

基于通道注意力機(jī)制的SSD目標(biāo)檢測算法

Tengine 支持 NPU 模型部署-YOLOv5s

詳解五種即插即用的視覺注意力模塊

計算機(jī)視覺中的注意力機(jī)制

YOLOv8+OpenCV實現(xiàn)DM碼定位檢測與解析

基于YOLOv5s基礎(chǔ)上實現(xiàn)五種視覺注意力模塊的改進(jìn)

基于YOLOv5s基礎(chǔ)上實現(xiàn)五種視覺注意力模塊的改進(jìn)

評論