漫畫是很多人的童年回憶,除了經典的《銀魂》、《海賊王》、《火影》,久保帶人的作品《死神》也很有人氣。最近,六位來自北航的研究者推出了一款漫畫臉轉換模型「MangaGAN」,實現了真人照片到漫畫臉的完美轉換。

我們可以合理懷疑,幾位論文作者都是久保帶人的粉絲。

這篇論文中提出的「MangaGAN」,是一種基于生成對抗網絡(GAN)的非成對照片到漫畫轉換方法。用來訓練 MangaGAN 的數據集也來源于一部非常受歡迎的漫畫作品——久保帶人的《死神(Bleach)》,包含漫畫人臉的面部特征、特征點、身體等元素,所以生成結果也帶有強烈的久保帶人風格。

標準漫畫臉是如何生成的?

MangaGAN 生成漫畫臉的整體流程。

總體來說,MangaGAN 包含兩個分支:

一個分支通過幾何轉換網絡(Geometric Transformation Network,GTN)學習幾何映射;

另一個分支通過外觀轉換網絡(Appearance Transformation Network,ATN)學習外觀映射。

最后通過合成模塊將二者融合,從而生成漫畫臉。

假設 P 表示照片,M 表示生成的漫畫臉,二者之間不存在成對關系。給定一張照片 p∈P,MangaGAN 學習映射

將 p 遷移至樣本

(m∈M),同時為 m 加上漫畫風格和面部相似度。

圖中(f)步驟通過 GTN 勾勒出夸張的幾何線條,并確定五官的幾何分布位置;圖中(e)步驟則通過 ATN 生成所有的面部特征,包括眼睛、鼻子和嘴巴。繼而通過合成模塊將幾何輪廓和面部特征相融合,輸出漫畫臉 m∈M。

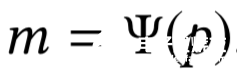

外觀轉換:ATN

ATN 是一個 multi-GAN 結構的網絡,包含四個局部 GAN,分別用來轉換眼、口、鼻和頭發這四個面部位置。針對每個部位的 GAN,會有專屬的訓練策略和編碼器以改善其性能。

眼睛和嘴巴是漫畫臉的靈魂所在,但也是最難轉換的部分,隨著表情的變化,這兩個部位的特征也會變化。

對于眼睛和嘴巴部位,為了實現更好的非成對數據匹配,研究者將 CycleGAN 與反向映射(reverse mapping)相結合,并進行了三項改進:

第一,設計了一個帶有 SP loss L_SP 的 Similarity Preserving (SP) 模塊,以增強相似度;

第二,訓練編碼器 E^eye 用于提取 p^eye 的主干,訓練編碼器 E^mouth 用于提取 p^mouth 的輪廓線條;

第三,提出結構平滑損失 L_SS,幫助網絡生成筆觸平滑的漫畫臉。

使用不同的改進方法得到的眼部和嘴部區域對比情況。

上圖第 5 列和第 11 列展示了使用 SP 模塊進行改進的效果;第 6 列和第 12 列分別展示了使用編碼器 E^eye 和 E^mouth 的改進效果;第 4 列和第 10 列展示了使用結構平滑損失進行改進的效果。

鼻子和頭發的生成則相對簡單,大部分動漫人物的鼻型相似,因此該研究使用基于 ProGAN 的架構生成鼻子。頭發部分則使用了 APDdrawingGAN,通過頭發分割方法劃分出大致的頭發區域,然后使用肖像分割方法移除多余的背景區域,即可生成類似漫畫風格的頭發樣式。

幾何轉換:GTN

在轉換面部特征點時會遇到一個問題:面部特征的搭配模式限制了結果的多樣性。比如,臉型相同的人可能有著不同的眼口鼻大小或位置,但 GAN 在接受全局人臉特征點訓練時可能遵循固定或類似的搭配模式。因此研究者也將「幾何特征」分解為三種屬性:臉型、位置、大小,并使用三個 sub-GAN 分別轉換。

GTN pipeline。幾何信息被分為三種獨立屬性:位置、大小和臉型,然后使用 N_loc、N_siz、N_sha 三個 sub-GAN 分別進行轉換。

最終,如圖 5(b) 所示,基于預定義的臉頰和額頭比例,生成了整張漫畫臉的幾何特征。

最后一步:融合

這一步的目的是融合人臉特征和幾何特征,從而生成漫畫臉。

如上圖所示,首先,根據幾何特征來調整和定位各面部特征組件;

其次,基于分段三次 Hermite 插值多項式 (PCHIP) 方法,獲得平滑的曲線并保留臉部形狀,然后通過擬合生成人臉特征點的曲線來繪制臉型;

然后,模型提供了 10 種漫畫式耳朵供選擇,而非按照片重新生成,因為耳朵的樣式對面部表情來說影響不大;

此外,研究者還收集了 8 種漫畫人物身體(manga body),用來與生成的漫畫臉搭配。

最后就可以輸出漫畫結果啦。該模型提供了快速微調尺寸和位置的工具,以及鼻子、耳朵和骨架等組件的切換工具,用戶可以按照個人喜好進行調整,生成自己喜歡的漫畫臉。

MangaGAN 效果如何?

該研究所用的實驗數據集包括三部分:漫畫數據集、照片數據集和人像數據集。漫畫數據集來源于一部流行的漫畫作品《死神》,包括 448 雙眼睛、109 個鼻子、179 個嘴巴和 106 張正面漫畫臉。

研究者將 MangaGAN 與 9 種漫畫臉生成 SOTA 方法進行了對比,效果生成如下圖所示:

可以看到,其他方法生成的漫畫臉都會有扭曲和突兀的線條,或是面部存在莫名的陰影,其原因在于生成過程中忽視了幾何特征的轉換。相比之下,MangaGAN 生成的臉部十分干凈利落,沒有多余的部分。

接下來是跨域轉換層面中 MangaGAN 與其他方法的對比。為公平起見,CycleGAN 和 UNIT 先轉換全臉再轉換每個人臉特征。最終效果如下圖所示:

很明顯,其他方法在匹配照片和漫畫時容易出現問題,它們更關心二者的黑暗區域是否匹配,但沒有轉換臉型和筆觸。MangaGAN 的生成結果則更接近理想中的漫畫臉,臉型棱角分明,眉形平滑,嘴巴也進行了簡化,幾乎完全符合手繪漫畫的人物長相特征。

責任編輯:pj

-

幾何

+關注

關注

0文章

37瀏覽量

12367 -

合成

+關注

關注

0文章

16瀏覽量

13799 -

ATN

+關注

關注

0文章

5瀏覽量

3630

發布評論請先 登錄

相關推薦

ADT7420出現溫度采集問題時,是否可以通過軟件方式進行復位?

光波導系統中光柵幾何結構的優化

光波導系統中光柵幾何結構的優化

TVP7002+THS8200 VGA輸出圖像出現垂直線條有鋸齒,是什么原因導致的?

dac38j82 IOUTx為什么沒有波形輸出?

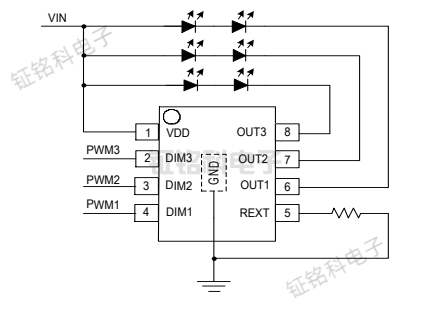

低壓線性恒流LED恒流驅動芯片:用于洗墻燈和線條燈

精準測量第一步:如何選擇合適的幾何尺寸測量儀器?

機床的幾何精度什么和什么時是有區別的

數控機床的幾何精度是表明所測量的什么

Thinborne揭示Galaxy Z Fold6 CAD渲染圖,線條硬朗,重量輕盈

WD4000無圖晶圓幾何量測系統

低壓線性恒流LED恒流驅動芯片SM15633EH:用于洗墻燈和線條燈

mpo光纖跳線2進24出的怎么接?

“芯”動未來,無圖晶圓幾何量測系統提升半導體競爭力

GTN可以勾勒出夸張的幾何線條?

GTN可以勾勒出夸張的幾何線條?

評論