CNN模型的輸出信息進行負荷預測,最終得到預測結果。選取西班牙公開的電力數據為實驗數據,運用Python語言搭建預測模型,分別與CNN和LSTM單一模型進行對比,驗證了所提組合預測模型的可靠性,其在電力短期負荷預測領域應用效果較好,可為供電部門電力規劃提供理論依據。

2023-11-09 14:13:59 988

988

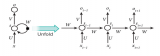

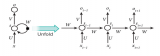

循環神經網絡 (RNN) 是一種深度學習結構,它使用過去的信息來提高網絡處理當前和將來輸入的性能。RNN 的獨特之處在于該網絡包含隱藏狀態和循環。

2024-02-29 14:56:10 316

316

? 電子發燒友網報道(文/李彎彎)近年來,隨著大語言模型的不斷出圈,Transformer這一概念也走進了大眾視野。Transformer是一種非常流行的深度學習模型,最早于2017年由谷歌(Google)研究團隊提出,主要用于處理自然語言。 2018年10月,Google發出一篇論文《BERT: Pre-training of Deep Bidirectional Transformers for Language Understanding》,BERT模型橫空出世,并橫掃NLP領域11項任務的最佳成績。而在BERT中發揮重要作用的結構就是Transformer,之后又相繼出現XLNET、roBERT等模型擊

2023-12-25 08:36:00 1282

1282

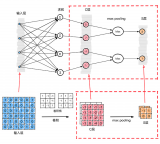

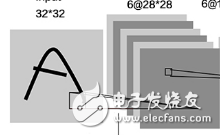

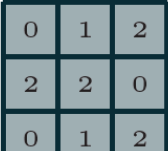

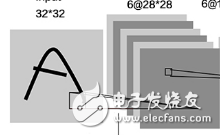

;quot;X"圖案。而且即便未知圖案可能有一些平移或稍稍變形,依然能辨別出它是一個X圖案。如此,CNN是把未知圖案和標準X圖案一個局部一個局部的對比,如下圖所示未知圖案的局部和標準X圖案

2018-10-17 10:15:50

RNN中支持的一些基本算子,如何對序列數據進行組織

2022-08-31 10:01:30

DL之RNN:RNN算法相關論文、相關思路、關鍵步驟、配圖集合+TF代碼定義

2018-12-28 14:20:33

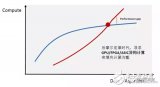

作者:琥珀導言:循環神經網絡(RNNs)具有保留記憶和學習數據序列的能力。由于RNN的循環性質,難以將其所有計算在傳統硬件上實現并行化。當前CPU不具有大規模并行性,而由于RNN模型的順序組件

2018-07-31 10:11:00

GMR7580-15P2CNN - Vertical Mount Micro-D Connectors - Glenair, Inc.

2022-11-04 17:22:44

GMR7580-15S2CNN - Vertical Mount Micro-D Connectors - Glenair, Inc.

2022-11-04 17:22:44

GMR7580-15S3CNN - Vertical Mount Micro-D Connectors - Glenair, Inc.

2022-11-04 17:22:44

GMR7580-21P1CNN - Vertical Mount Micro-D Connectors - Glenair, Inc.

2022-11-04 17:22:44

GMR7580-21P2CNN - Vertical Mount Micro-D Connectors - Glenair, Inc.

2022-11-04 17:22:44

GMR7580-21P3CNN - Vertical Mount Micro-D Connectors - Glenair, Inc.

2022-11-04 17:22:44

GMR7580-21S1CNN - Vertical Mount Micro-D Connectors - Glenair, Inc.

2022-11-04 17:22:44

GMR7590-15S1CNN - Right Angle Micro-D Connectors - Glenair, Inc.

2022-11-04 17:22:44

GMR7590-9P2CNN - Right Angle Micro-D Connectors - Glenair, Inc.

2022-11-04 17:22:44

GMR7590-9P3CNN - Right Angle Micro-D Connectors - Glenair, Inc.

2022-11-04 17:22:44

GMR7590-9S1CNN - Right Angle Micro-D Connectors - Glenair, Inc.

2022-11-04 17:22:44

GMR7590-9S2CNN - Right Angle Micro-D Connectors - Glenair, Inc.

2022-11-04 17:22:44

2.概述一個簡單的AI開發sampleGithub開源的數字手勢識別CNN模型,識別數字0-10十一種手勢類LeNet-5,兩個卷積層,兩個池化層,一個全連接層,一個Softmax輸出層3.RKNN

2022-04-02 15:22:11

TF之CNN:CNN實現mnist數據集預測 96%采用placeholder用法+2層C及其max_pool法+隱藏層dropout法+輸出層softmax法+目標函數cross_entropy法+

2018-12-19 17:02:40

TF之CNN:Tensorflow構建卷積神經網絡CNN的嘻嘻哈哈事之詳細攻略

2018-12-19 17:03:10

TF之CNN:利用sklearn(自帶手寫圖片識別數據集)使用dropout解決學習中overfitting的問題+Tensorboard顯示變化曲線

2018-12-24 11:36:58

在TensorFlow中實現CNN進行文本分類(譯)

2019-10-31 09:27:55

原文鏈接:http://tecdat.cn/?p=6585本文介紹了用于渦輪槳距角控制的永磁同步發電機(PMSG)和高性能在線訓練遞歸神經網絡(RNN)的混合模糊滑模損失最小化控制的設計。反向傳播學

2021-07-12 07:55:17

1 CNN簡介

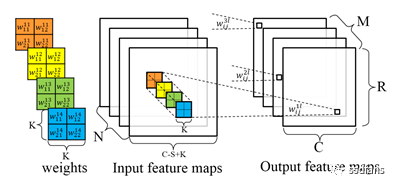

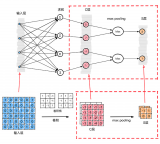

CNN即卷積神經網絡(Convolutional Neural Networks),是一類包含卷積計算的神經網絡,是深度學習(deep learning)的代表算法之一,在圖像識別

2023-08-18 06:56:34

利用RNN進行文章生成

2019-05-24 08:35:12

Keras實現卷積神經網絡(CNN)可視化

2019-07-12 11:01:52

【深度學習】卷積神經網絡CNN

2020-06-14 18:55:37

”機制來捕捉長時依賴關系。● 卷積循環神經網絡 (CRNN)卷積循環神經網絡是 CNN 和 RNN 的混合,可發現局部時間/空間關聯性。CRNN 模型從卷積層開始,然后是 RNN,對信號進行編碼

2021-07-26 09:46:37

CV之CNN:基于Keras利用cv2建立訓練存儲CNN模型(2+1)并調用攝像頭進行實時人臉識別

2018-12-26 11:09:16

1、基于SARIMA、XGBoost和CNN-LSTM的時間序列預測對比 時間序列預測是一個經常被研究的話題,我們這里使用使用兩個太陽能電站的數據,研究其規律進行建模。首先將它們歸納為兩個問題來

2022-12-20 16:34:57

采用數字CNN電路。所謂數字CNN電路即以數字架構來仿效實現CNN功能的芯片,該設計方式使用數字的方法來仿效實現CNN的微分方程式,計算結果是比較容易用電路實現的,且電路功能也是可測試的[14-15

2009-09-19 09:35:15

【技術綜述】為了壓榨CNN模型,這幾年大家都干了什么

2019-05-29 14:49:27

?方式有哪些?今天本文將以一個簡單的指南,將幫助您構建和了解構建簡單的CNN的概念。通過閱讀本文之后,將能夠基于PyTorch API構建一個簡單的CNN,并使用FashionMNIST日期集對服裝

2020-07-16 18:13:11

單片機(Cortex-M內核,無操作系統)可以跑深度學習嗎? ——Read Air 2019.8.20Xu_CNN框架待處理:1.需要設計一個可讀寫的消息棧 ()2.函數的類型參數使用結構體傳入 (已實現)3.動態...

2021-12-09 08:02:27

MIMRTX1064(SDK2.13.0)的KWS demo中放置了ds_cnn_s.tflite文件,提供demo中使用的模型示例。在 read.me 中,聲明我可以找到腳本,但是,該文檔中的腳本

2023-04-19 06:11:51

Inference的仿真,查看基于浮點參數和基于定點參數的仿真結果。甚至還能通過USB連接PC與FPGA進行硬件調試。第三步:調用Lattice CNN IP以及其他FPGA組件(例如MIPI視頻源接入、ISP、目標畫框、NMS算法、視頻輸出等),構建一個完整CNN Inference系統和產品。

2020-11-26 07:46:03

。更多細節,請大家參看知乎何之源的文章,文末會給出文章鏈接。4、CNN的seq2seq現在大多數場景下使用的Seq2Seq模型是基于RNN構成的,雖然取得了不錯的效果,但也有一些學者發現使用CNN來替換

2019-07-20 04:00:00

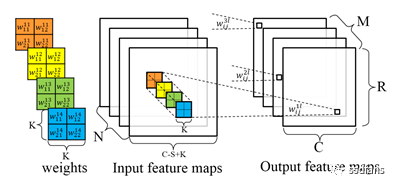

連接層等基本結構的組合使用,CNN 能夠有效地捕捉語音信號的局部特征。

3.循環神經網絡(RNN)

RNN 是專門為處理時間序列數據而設計的神經網絡。在語音識別領域,RNN 主要用于處理語音

2023-11-07 18:01:32

本文介紹了用于渦輪槳距角控制的永磁同步發電機(PMSG)和高性能在線訓練遞歸神經網絡(RNN)的混合模糊滑模損失最小化控制的設計。反向傳播學習算法用于調節RNN控制器。PMSG速度使用低于額定速度

2021-07-12 06:46:57

英文句子,用同樣的單詞,但只有考慮單詞的順序時,它們才意味著不同的含義。人類通過從左到右閱讀詞序列來理解文本,并構建了可以理解文本數據中所有不同內容的強大模型。RNN的工作方式有些許類似,每次只查看

2022-07-20 09:27:59

基于FPGA的通用CNN加速器整體框架如下,通過Caffe/Tensorflow/Mxnet等框架訓練出來的CNN模型,通過編譯器的一系列優化生成模型對應的指令;同時,圖片數據和模型權重數據按照優化規則進行預處理以及壓縮后通過PCIe下發到FPGA加速器中

2017-10-27 14:09:58 9882

9882

演化脈絡下圖所示CNN結構演化的歷史,起點是神經認知機模型,已經出現了卷積結構,但是第一個CNN模型誕生于1989年,1998年誕生了LeNet。隨著ReLU和dropout的提出,以及GPU和大數

2017-11-15 11:10:09 2413

2413

循環神經網絡(RNNs)具有保留記憶和學習數據序列的能力。由于RNN的循環性質,難以將其所有計算在傳統硬件上實現并行化。當前CPU不具有大規模并行性,而由于RNN模型的順序組件,GPU只能提供有

2017-11-15 13:30:06 1974

1974

CNN是目前自然語言處理中和RNN并駕齊驅的兩種最常見的深度學習模型。圖1展示了在NLP任務中使用CNN模型的典型網絡結構。一般而言,輸入的字或者詞用Word Embedding的方式表達,這樣

2017-11-15 17:59:19 14700

14700

之前在網上搜索了好多好多關于CNN的文章,由于網絡上的文章很多斷章取義或者描述不清晰,看了很多youtobe上面的教學視頻還是沒有弄懂,最后經過痛苦漫長的煎熬之后對于神經網絡和卷積有了粗淺的了解

2017-11-16 13:18:40 56168

56168

對于神經網絡和卷積有了粗淺的了解,關于CNN 卷積神經網絡,需要總結深入的知識有很多:人工神經網絡 ANN卷積神經網絡CNN 卷積神經網絡CNN-BP算法卷積神經網絡CNN-caffe應用卷積神經網絡CNN-LetNet分析 LetNet網絡.

2017-11-16 13:28:01 2562

2562

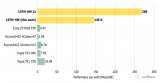

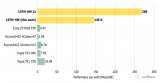

微軟數據科學家Ilia Karmanov最新測試的結果顯示,亞馬遜MXNet在CNN、RNN與NLP情感分析任務上性能強勁,而TensorFlow僅擅長于特征提取。

2017-12-06 16:04:40 8245

8245 將神經網絡模型訓練好之后,在輸入層給定一個x,通過網絡之后就能夠在輸出層得到特定的y,那么既然有了這么強大的模型,為什么還需要RNN(循環神經網絡)呢?

2018-05-05 10:51:00 5037

5037

2014 年 RNN/LSTM 起死回生。自此,RNN/LSTM 及其變種逐漸被廣大用戶接受和認可。起初,LSTM 和 RNN 只是一種解決序列學習和序列翻譯問題的方法(seq2seq),隨后被用于語音識別并有很好的效果。

2018-04-25 09:43:56 20290

20290 懂原理俠:抱歉我起了個這么蠢的名字。但是,進階到這一步,已經可以算是入門了,可以找一份能養活自己的工作了。CNN,RNN,LSTM信手拈來,原理講的溜的飛起,對于不同的參數對模型的影響也是說的有理有據,然而,如果你要問,你可以手動寫一個CNN嗎?不用調包,實現一個最基礎的網絡結構即可,又gg了。

2018-05-08 16:24:11 6806

6806

在循環神經網絡可以用于文本生成、機器翻譯還有看圖描述等,在這些場景中很多都出現了RNN的身影。

2018-05-11 14:58:41 13295

13295

由 mengqiqi 于 星期三, 2018-09-05 09:58 發表 一、前述 CNN和RNN幾乎占據著深度學習的半壁江山,所以本文將著重講解CNN+RNN的各種組合方式,以及CNN和RNN

2018-09-06 22:32:01 539

539 運用遷移學習,CNN特征,語句特征應用已有模型2. 最終的輸出模型是LSTM,訓練過程的參數設定:梯度上限(gradient clipping), 學習率調整(adaptivelearning)3. 訓練時間很長。

2018-09-13 15:22:42 52086

52086 之前在網上搜索了好多好多關于CNN的文章,由于網絡上的文章很多斷章取義或者描述不清晰,看了很多youtobe上面的教學視頻還是沒有弄懂,最后經過痛苦漫長的煎熬之后對于神經網絡和卷積有了粗淺的了解

2018-10-02 07:41:01 544

544 Kortiq提供易于使用,可擴展且小巧的CNN加速器。

該設備支持所有類型的CNN,并動態加速網絡中的不同層類型。

2018-11-23 06:28:00 2957

2957 卷積神經網絡( CNN)和循環神經網絡(RNN)在自然語言處理,上得到廣泛應用,但由于自然語言在結構上存在著前后依賴關系,僅依靠卷積神經網絡實現文本分類將忽略詞的上下文含義,且傳統的循環神經網絡存在梯度消失或梯度爆炸問題,限制了文本分類的準確率。

2018-11-22 16:01:45 9

9 最近,有一篇入門文章引發了不少關注。文章中詳細介紹了循環神經網絡(RNN),及其變體長短期記憶(LSTM)背后的原理。

2019-02-05 13:43:00 673

673 很多“長相相似”的專有名詞,比如我們今天要說的“三胞胎”DNN(深度神經網絡)、CNN(卷積神經網絡)、RNN(遞歸神經網絡),就讓許許多多的AI初學者們傻傻分不清楚。而今天,就讓我們一起擦亮眼睛,好好

2019-03-13 14:32:34 3081

3081 Mask R-CNN是承繼于Faster R-CNN,Mask R-CNN只是在Faster R-CNN上面增加了一個Mask Prediction Branch(Mask預測分支),并且在ROI

2019-04-04 16:32:07 12856

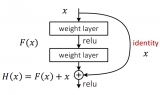

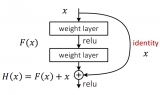

12856 梯度爆炸/消失不僅僅是RNN存在的問題。由于鏈式法則和非線性激活函數,所有神經網絡(包括前向和卷積神經網絡),尤其是深度神經網絡,都會出現梯度消失/爆炸問題。這導致低層網絡訓練非常緩慢。那么解決辦法就是在神經網絡之間添加直接連接,使梯度傳播更順暢。

2019-05-05 16:05:26 15907

15907

在CNN中,轉置卷積是一種上采樣(up-sampling)的方法。如果你對轉置卷積感到困惑,那么就來讀讀這篇文章吧。

2020-01-31 17:32:00 4246

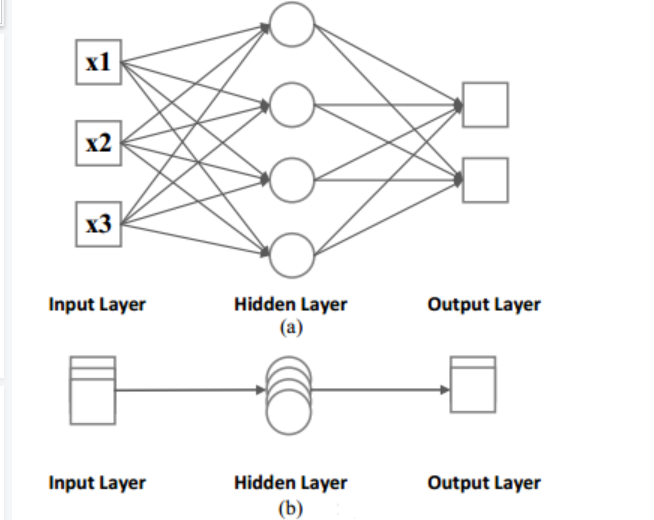

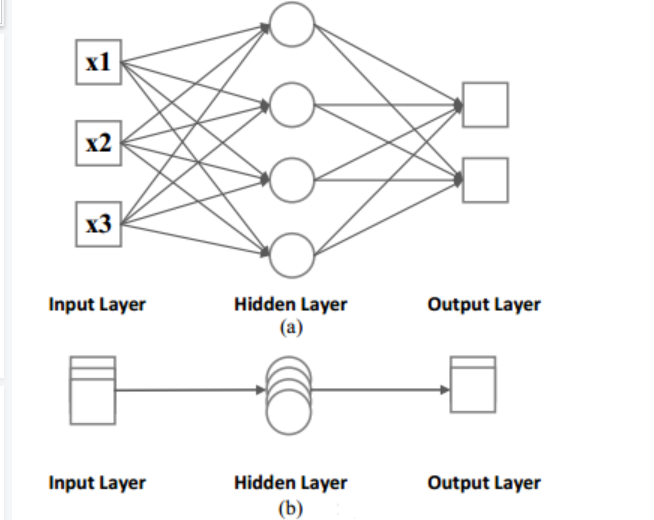

4246 包含有輸入層、輸出層和一個隱藏層。輸入的特征向量通過隱藏層變換到達輸出層,由輸出層得到分類結果。

2020-03-13 16:49:20 4711

4711 遞歸神經網絡(RNN)被提出用來處理80年代的輸入序列時間信息。1993年,神經歷史壓縮器系統解決了“非常深度學習”任務,該任務需要及時展開RNN中的1000多個后續層。

2020-03-22 10:23:00 6494

6494

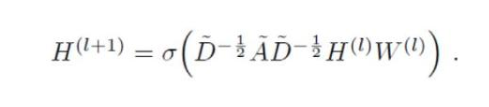

深度學習一直都是被幾大經典模型給統治著,如CNN、RNN等等,它們無論再CV還是NLP領域都取得了優異的效果,那這個GCN是怎么跑出來的?是因為我們發現了很多CNN、RNN無法解決或者效果不好的問題——圖結構的數據。

2020-04-17 10:14:13 2776

2776

盡管許多研究人員已經開發了用于FER的CNN方法,但到目前為止,他們中很少有人試圖確定哪種類型的網絡最適合這一特定任務。意識到文獻中的這種差距,永勝和他的同事邵杰為FER開發了三種不同的CNN,并進行了一系列的評估,以確定他們的優勢和劣勢。

2020-04-17 10:55:01 14141

14141 使用的是 CNN 而不是 RNN(常用來處理時序數據),是因為每次的重復運動練習(如舉啞鈴)是花費的時間是非常短的少于 4 秒,訓練時不需要長時間的記憶。

2020-12-25 03:39:00 15

15 逐層抽取的能力,構建基于循環神經網絡(RNN)的樣本分類模型,以對 Linux遠控木馬進行檢測。為避免陷入局部最優,采用隨機搜索參數的方法進行模型超參數選擇。對基于RNN的分類模型及其他基于傳統機器學習算法的模型分別進行實驗

2021-03-30 09:21:44 15

15 概述 深度學習中CNN網絡是核心,對CNN網絡來說卷積層與池化層的計算至關重要,不同的步長、填充方式、卷積核大小、

2021-04-06 15:13:25 2453

2453

神經網絡是深度學習的載體,而神經網絡模型中,最經典非RNN模型所屬,盡管它不完美,但它具有學習歷史信息的能力。后面不管是encode-decode 框架,還是注意力模型,以及自注意力模型,以及更加

2021-05-10 10:22:45 11005

11005

神經網絡是深度學習的載體,而神經網絡模型中,最經典非RNN模型所屬,盡管它不完美,但它具有學習歷史信息的能力。后面不管是encode-decode 框架,還是注意力模型,以及自注意力模型,以及更加

2021-05-13 10:47:46 22438

22438

全連接層,使得網絡結構簡單且可移植性強。在改進CNN網絡的基礎上,利用基于投票法的集成學習策略將所有個體學習器結果凸組合為最終結果,實現更準確的人臉識別。實驗結果表明,該算法在 Color Feret、AR和ORL人臉數據庫上的識別準確率分別達到

2021-05-27 14:36:12 6

6 基于CNN和LSTM的蛋白質亞細胞定位研究對比

2021-06-11 14:16:11 15

15 基于CNN與約束概率矩陣分解的推薦算法

2021-06-17 16:36:19 7

7 基于改進CNN等的左心室射血分數精準計算

2021-06-27 10:44:44 35

35 基于RNN的GIS故障預測算法及系統設計

2021-07-01 15:38:37 30

30 循環神經網絡(Recurrent Neural Network,RNN)是一種用于處理序列數據的神經網絡。相比一般的神經網絡來說,他能夠處理序列變化的數據。比如某個單詞的意思會因為上文提到的內容不同而有不同的含義,RNN就能夠很好地解決這類問題。

2022-03-15 10:44:42 1544

1544 是應用于每個 RoI 的小型 FCN,以像素到像素的方式預測分割掩碼。鑒于 Faster R-CNN 框架,Mask R-CNN 易于實現和訓練,這有助于廣泛的靈活架構設計。此外,掩碼分支僅增加了少量

2022-04-13 10:40:50 2133

2133 不論是CNN還是RNN,一個共同特點是整個網絡是由幾個相同的單元聯結形成的。CNN中基本的單元是神經元,一個神經元包含一個權重和激活函數,其中權重是對輸入信息進行卷積(圖1.1)

2022-07-01 09:56:59 819

819 然而,由于卷積核的離散性,傳統的 CNN 不能跨分辨率使用。當考慮具有相同 CNN 的不同維度數據時,這兩個問題會進一步加劇,例如序列(1D)、視覺(2D)和高維數據(3D、4D),因為不同的維度

2022-07-21 10:15:21 842

842 神經網絡一般可以分為以下常用的三大類:CNN(卷積神經網絡)、RNN(循環神經網絡)、Transformer(注意力機制)。

2022-12-12 14:48:43 4288

4288 卷積神經網絡(CNN)是解決圖像分類、分割、目標檢測等任務的流行模型。本文將CNN應用于解決簡單的二維路徑規劃問題。主要使用Python, PyTorch, NumPy和OpenCV。

2023-02-13 14:30:54 406

406 作者:Ahzam Ejaz 來源: DeepHub IMBA 卷積神經網絡(cnn)是一種神經網絡,通常用于圖像分類、目標檢測和其他計算機視覺任務。CNN的關鍵組件之一是特征圖,它是通過對圖像

2023-04-12 10:25:05 518

518 電子發燒友網站提供《PyTorch教程14.8之基于區域的CNN(R-CNN).pdf》資料免費下載

2023-06-05 11:09:06 0

0 14.8。基于區域的 CNN (R-CNN)? Colab [火炬]在 Colab 中打開筆記本 Colab [mxnet] Open the notebook in Colab

2023-06-05 15:44:37 339

339

因為CNN的特有計算模式,通用處理器對于CNN實現效率并不高,不能滿足性能要求。 因此,近來已經提出了基于FPGA,GPU甚至ASIC設計的各種加速器來提高CNN設計的性能。

2023-06-14 16:03:43 1453

1453

作者:AhzamEjaz來源:DeepHubIMBA卷積神經網絡(cnn)是一種神經網絡,通常用于圖像分類、目標檢測和其他計算機視覺任務。CNN的關鍵組件之一是特征圖,它是通過對圖像應用卷積濾波器

2023-04-19 10:33:09 430

430

它用TensorFlow.js加載了一個10層的預訓練模型,相當于在你的瀏覽器上跑一個CNN模型,只需要打開電腦,就能了解CNN究竟是怎么回事。

2023-06-28 14:47:09 2623

2623

python卷積神經網絡cnn的訓練算法? 卷積神經網絡(Convolutional Neural Network,CNN)一直是深度學習領域重要的應用之一,被廣泛應用于圖像、視頻、語音等領域

2023-08-21 16:41:37 859

859 和高效的處理方式,CNN已經成為圖像識別、語音識別和自然語言處理等領域中的優選技術。CNN對于處理基于網格結構的數據具有天然的優勢,因此在處理圖像和視頻等視覺數據時,具有獨特的優越性能。 CNN的特點 1. 卷積操作:CNN最重要的操作是卷積操作,這也是CNN得名的來源。CNN的卷積操

2023-08-21 16:41:48 1662

1662 cnn卷積神經網絡原理 cnn卷積神經網絡的特點是什么? 卷積神經網絡(Convolutional Neural Network,CNN)是一種特殊的神經網絡結構,主要應用于圖像處理和計算機視覺領域

2023-08-21 17:15:25 1027

1027 cnn卷積神經網絡算法 cnn卷積神經網絡模型 卷積神經網絡(CNN)是一種特殊的神經網絡,具有很強的圖像識別和數據分類能力。它通過學習權重和過濾器,自動提取圖像和其他類型數據的特征。在過去的幾年

2023-08-21 17:15:57 946

946 cnn卷積神經網絡matlab代碼? 卷積神經網絡(Convolutional Neural Network, CNN)是深度學習中一種常用的神經網絡結構,它是通過卷積層、池化層和全連接層等組合

2023-08-21 17:15:59 798

798 cnn卷積神經網絡簡介 cnn卷積神經網絡代碼 卷積神經網絡(Convolutional Neural Network,簡稱CNN)是目前深度學習領域中應用廣泛的一種神經網絡模型。CNN的出現

2023-08-21 17:16:13 1622

1622 Vitis AI 遞歸神經網絡 (RNN) 工具是 Vitis? AI 開發環境的一個子模塊,專注于在 Xilinx? 硬件平臺(包括 Alveo? 加速器卡)上實現 RNN。這些工具由優化的 IP

2023-09-13 17:32:53 0

0 卷積神經網絡(CNN 或 ConvNet)是一種直接從數據中學習的深度學習網絡架構。

CNN 特別適合在圖像中尋找模式以識別對象、類和類別。它們也能很好地對音頻、時間序列和信號數據進行分類。

2023-10-12 12:41:49 422

422

,非常適合RNN。與其他神經網絡不同,RNN具有內部存儲器,允許它們保留來自先前輸入的信息,并根據整個序列的上下文做出預測或決策。在本文中,我們將探討RNN的架構、它

2023-12-15 08:28:11 217

217

電子發燒友App

電子發燒友App

評論