近日,南開大學、牛津大學和加州大學默塞德分校的研究人員共同提出了一種面向目標檢測任務的新模塊Res2Net,新模塊可以和現有其他優秀模塊輕松整合,在不增加計算負載量的情況下,在ImageNet、CIFAR-100等數據集上的測試性能超過了ResNet。

2015年,由何愷明等四位華人所提出的ResNet一戰成名,可極快的加速神經網絡的訓練。

而近日,由南開大學、牛津大學和加州大學默塞德分校的研究人員共同提出的Res2Net,可以和現有其他優秀模塊輕松整合:在不增加計算負載量的情況下,在ImageNet、CIFAR-100等數據集上的測試性能超過了ResNet。

論文地址:

https://arxiv.org/pdf/1904.01169.pdf

關于代表性計算機視覺任務的進一步消融研究和實驗結果,即目標檢測,類激活 mapping和顯著目標檢測,進一步驗證了Res2Net相對于現有技術的基線方法的優越性。

面向視覺任務的多尺度表示對于目標檢測、語義分割和顯著目標檢測任務具有重大意義。通過CNN新模塊Res2Net,能夠實現與比以往優秀的基于CNNbackbone的模型(如ResNet,ResNeXt和DLA)更好的性能表現。

Res2Net:計算負載不增加,特征提取能力更強大

在多個尺度上表示特征對于許多視覺任務非常重要。卷積神經網絡(CNN) backbone 的最新進展不斷展示出更強的多尺度表示能力,從而在廣泛的應用中實現一致的性能提升。然而,大多數現有方法以分層方式(layer-wise)表示多尺度特征。

在本文中,研究人員在一個單個殘差塊內構造分層的殘差類連接,為CNN提出了一種新的構建模塊,即Res2Net——以更細粒度(granular level)表示多尺度特征,并增加每個網絡層的感受野(receptive fields)范圍。

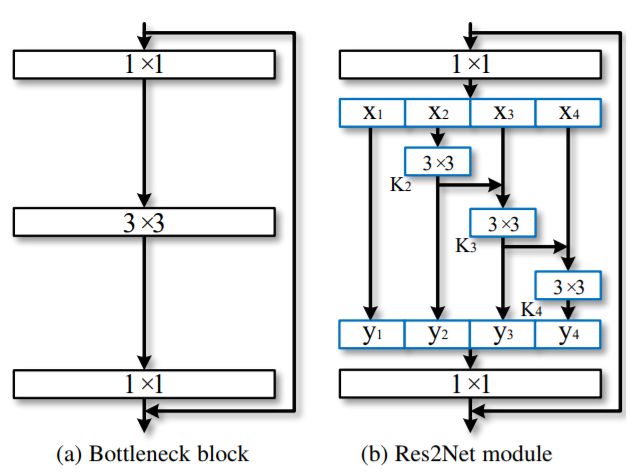

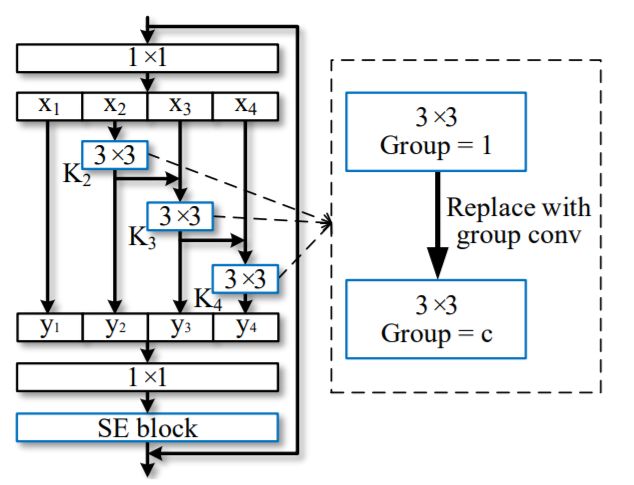

上圖中,左側為CNN網絡架構的基本構成,右側為本文新提出的Res2Net模塊。新模塊具備更強的多規模特征提取能力,但計算負載量與左側架構類似。具體而言,新模塊用一個較小的3×3過濾器取代了過濾器組,同時可以將不同的過濾器組以層級殘差式風格連接。模塊內部的連接形式與殘差網絡(ResNet)類似,故命名為Res2Net。

與其他現有模塊的整合

本文所提出的Res2Net模塊可以融合到最先進的backbone CNN模型中,例如ResNet,ResNeXt和DLA。研究人員在所有這些模型上評估 Res2Net 模塊,并在廣泛使用的數據集(例如CIFAR-100和ImageNet)上展示相對于基線模型的一致性能提升。

由于單獨的Res2Net模塊對于整體網絡結構沒有特定的要求,Res2Net模塊的多尺度表示能力也和CNN的分層特征聚合模型彼此獨立,所以可以很容易地將Res2Net模塊集成到現有的其他優秀CNN模型中。比如ResNet,ResNeXt 和DLA 等。集成后的模型可稱為Res2Net,Res2NeXt,和Res2Net-DLA。

Res2Net模塊性能及測試結果

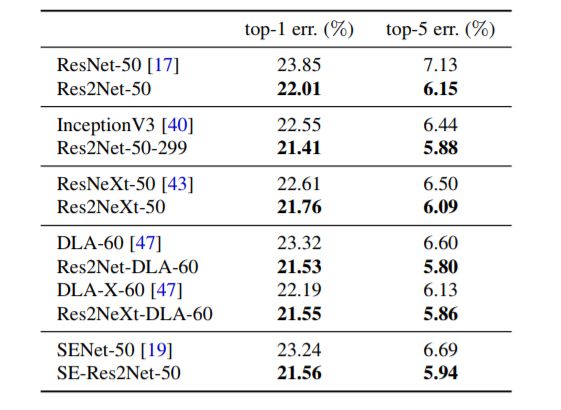

ImageNet數據集測試結果

ImageNet數據集Top1和Top5測試結果

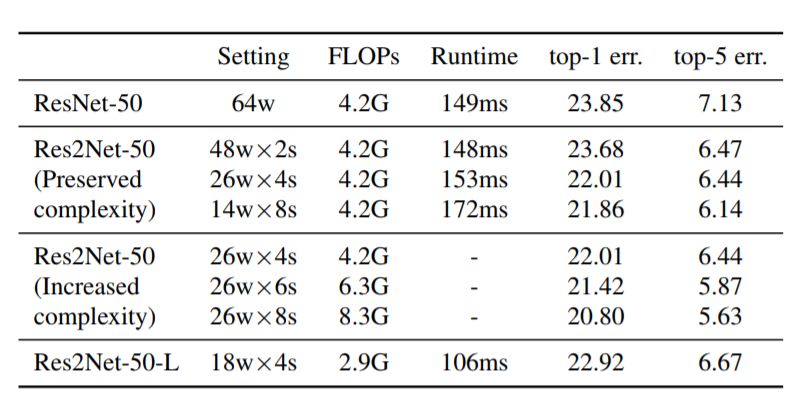

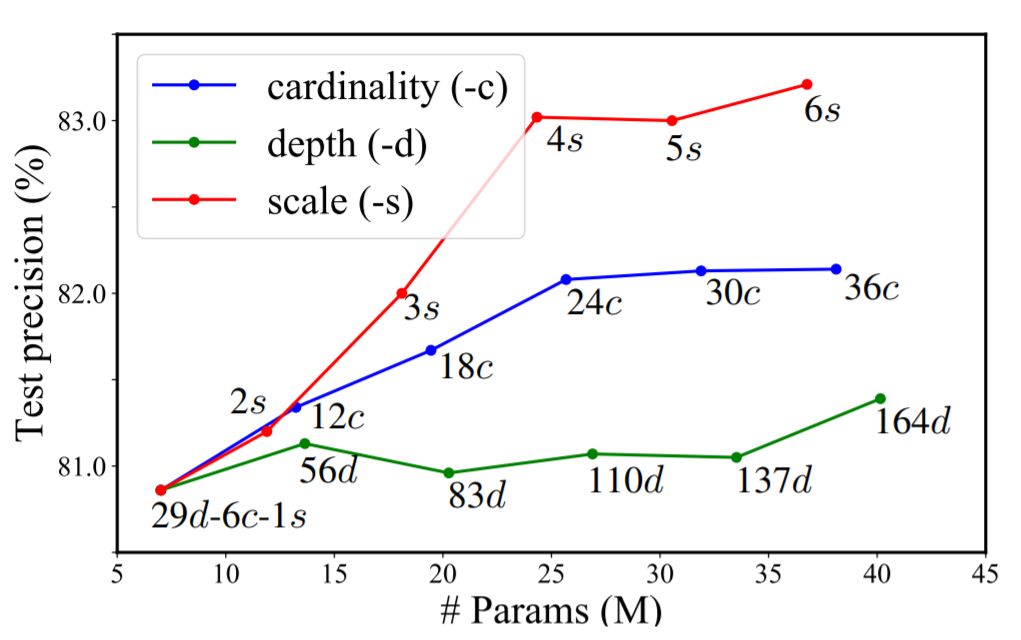

Res2Net-50在ImageNet數據集不同規模測試錯誤率結果。其中參數w為過濾器寬度,s為scale

CIFAR-100數據集測試結果

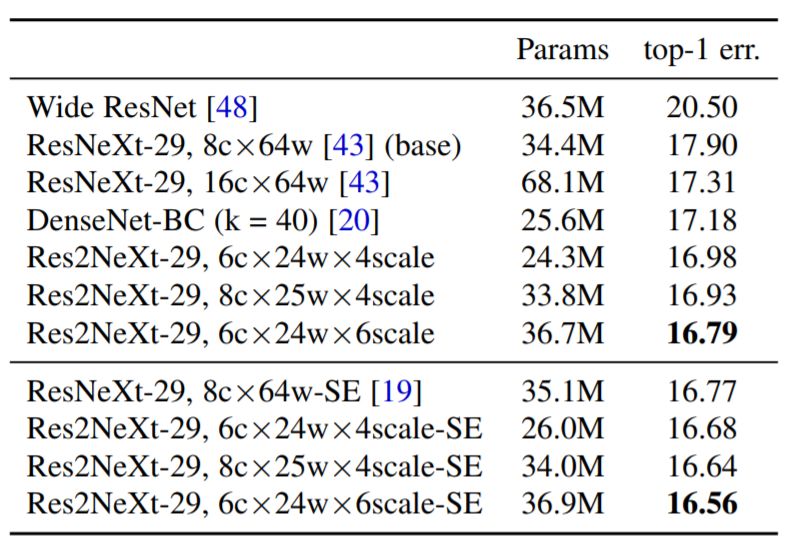

CIFAR-100數據集Top1錯誤率,以及模型大小

CIFAR-100數據集不同模型大小下的檢測準確率

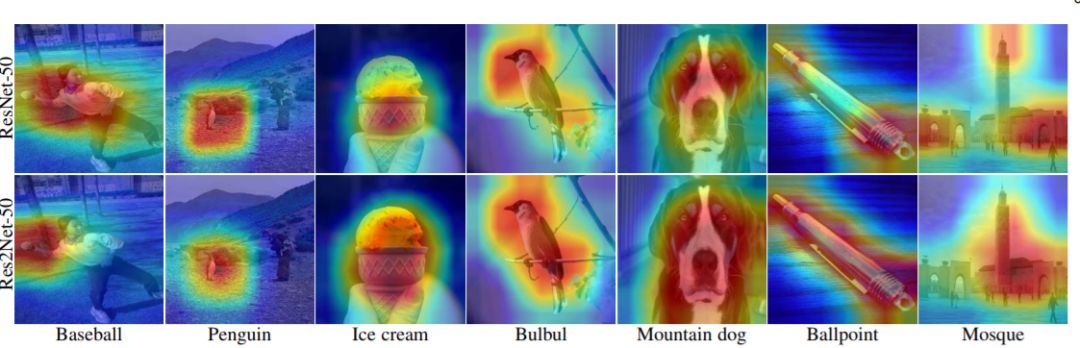

ResNet-50和Res2Net-50的類激活映射可視化對比

ResNet-101 和Res2Net-101的語義分割結果的可視化對比

ResNet-50 和Res2Net-50的顯著目標檢測結果對比(圖7)

結論及未來方向

Res2Net結構簡單,性能優秀,可以進一步探索CNN在更細粒度級別的多尺度表示能力。 Res2Net揭示了一個新的維度,即“尺度”(Scale),除了深度,寬度和基數的現有維度之外,“規模”是一個必不可少的更有效的因素。

Res2Net模塊可以很容易地與現有的最新模塊整合。對CIFAR100和ImageNet基準測試的圖像分類結果表明,使用Res2Net模塊的網絡始終在與對手的競爭中表現出更優秀的性能,這些對手包括ResNet,ResNeXt,DLA等。

Res2Net性能上的優越性已經在幾個具有代表性的計算機視覺任務體現出來,包括類激活映射,對象檢測和顯著對象檢測等。多尺度表示對于未來開拓更廣泛的應用領域至關重要。

本文相關源代碼將在論文被收稿后公開發布。

-

神經網絡

+關注

關注

42文章

4793瀏覽量

102006 -

計算機視覺

+關注

關注

8文章

1704瀏覽量

46394 -

數據集

+關注

關注

4文章

1218瀏覽量

25147

原文標題:超越ResNet:南開提出Res2Net,不增計算負載,性能全面升級!

文章出處:【微信號:AI_era,微信公眾號:新智元】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

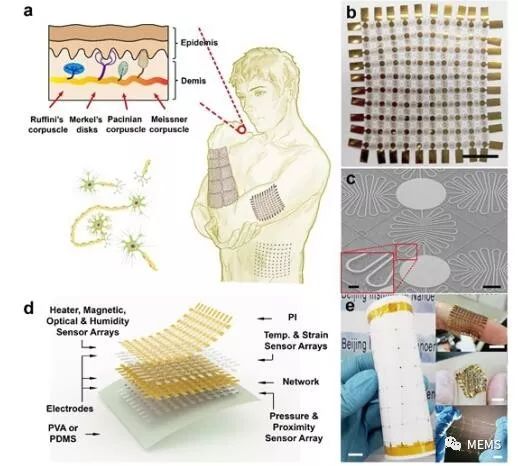

研究人員提出了一種柔性可拉伸擴展的多功能集成傳感器陣列

實驗室的最新工作——Res2Net,一種在目標檢測任務中新的Backbone網絡模塊

以色列研究人員開發出了一種能夠識別不同刺激的新型傳感系統

JD和OPPO的研究人員們提出了一種姿勢引導的時尚圖像生成模型

Facebook的研究人員提出了Mesh R-CNN模型

評論