2012年左右,多倫多大學的研究人員首次使用深度學習來贏下了ImageNet,它是一項非常受歡迎的計算機圖像識別競賽。對于那些參與AI行業的人來說,這是一個大問題,因為計算機視覺是使計算機能夠理解圖像背景的學科,也是人工智能中最具挑戰性的領域之一。

當然,與任何其他產生巨大影響的技術一樣,深度學習成為炒作的焦點。不同的公司和組織開始應用它來解決不同的問題(或假裝應用它)。許多公司開始使用深度學習和先進的人工智能技術重塑其產品和服務。

與此同時,媒體也經常撰寫有關人工智能和深度學習的故事,這些故事充滿誤導性,并且大多是由那些對技術運作方式沒有正確理解的人撰寫。他們大多使用關于人工智能的聳人聽聞的頭條來博眼球,這些也促成了圍繞深度學習的炒作。

經過媒體的炒作后,許多專家認為深度學習被夸大了,它最終會消退并可能導致另一個人工智能冬季,從而使人們對人工智能的興趣和資金投入大幅下降。其中一些著名專家也承認,深度學習已經觸底,其中包括一些深入學習的先驅者。

但根據著名數據科學家和深度學習研究員杰里米·霍華德的說法,“深度學習過度夸大”的論點有點夸張。霍華德是fast.ai的創始人,fast.ai是一個非營利性的在線深度學習課程。

今年,霍華德在USENIX Enigma會議上發表的演講中發表了許多反對深度學習的論點。整個視頻非常清楚地說明了深度學習究竟做了什么和不做什么,這個演講可以幫助你清楚地了解該領域。

以下是霍華德演講主要反駁的幾個論點:

深度學習只是一種時尚-明年它將是另一回事(NO!)

許多人認為深度學習是突然冒出來,最終也會突然消失。

霍華德反駁解釋到:“你今天在深度學習中實際看到的是幾十年研究的結果,而這幾十年的研究終于達到了實際上給出最先進成果的程度。”

人工神經網絡的概念是深度學習算法的主要組成部分,它已存在數十年,第一個神經網絡可以追溯到20世紀50年代。

Mark I Perceptron是1957年神經網絡的第一個實現

但是,由于數十年的研究以及數據和計算資源的可用性,深度學習的概念已經從實驗室走出并進入實際領域。

霍華德說:“利用深度學習,人們可以減少很多復雜的繁瑣的事務,我們應該期待看到[深度學習]繼續發展下去而不是消失。”

深度學習和機器學習是一回事(NO!)

濫用人工智能詞匯很容易導致了從業人員對行業的混淆和懷疑。有人說深度學習只是機器學習的另一個別稱,而其他人則認為它與其他AI技術(如支持向量機(SVM),隨機森林和邏輯回歸)屬于同一水平。

但深度學習和機器學習并不相同,深度學習是機器學習的一個子集。通常,機器學習適用于基于訓練數據的數學模型和行為規則的所有技術。ML技術已經投入生產使用了很長時間。

在深度學習之前,科學家們必須在編寫“功能”或模塊方面投入大量精力,這些功能可以執行模型想要執行的任務的一小部分。例如,如果你想創建一個可以檢測貓的圖像的AI模型,你將不得不編寫較小的程序來檢測貓的特征,如耳朵、尾巴、鼻子、皮毛。而且你必須使這些程序足夠強大,以便從不同角度和不同光照條件下檢測這些特征,并告訴不同貓種之間的差異。最后你才能在這些功能之上進行機器學習。

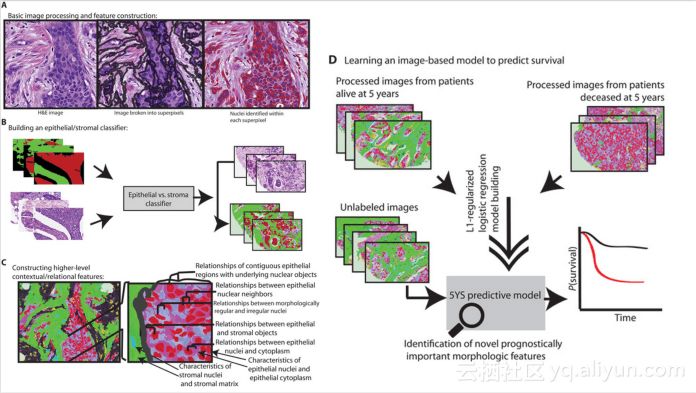

如果你想解決更復雜的問題,如通過MRI掃描檢測乳腺癌,那么創建特征將變得更具挑戰性。霍華德說:“你將需要數十名領域專家與數十名計算機程序員和數學家合作,提出這些功能概念并對其進行編程。最后使用一個經典的機器學習模型,如邏輯回歸。”這項工作大概需要數年的工作。

經典的機器學習方法涉及許多復雜的步驟,需要數十名領域專家、數學家和程序員的合作

深度學習用神經網絡取代了艱苦的經典機器學習過程。霍華德將神經網絡描述為“無限靈活的函數”。這意味著神經網絡可以應用于機器學習解決的大多數問題,而無需通過以前必須執行的所有特定于域的特征工程。

要想神經網絡解決特定問題,你需要調整其參數。為此,深度學習使用“梯度下降”,這是一種通用優化算法,可以將神經網絡的參數與其想要解決的問題相匹配。

最后,深度學習利用了近年來可用的GPU和專用硬件的強大功能,以合理快速和可擴展的方式執行這些任務。

霍華德說:“只有在過去的幾年里,這三件事情才能讓我們真正使用神經網絡來獲得最先進的結果。”

因此,深度學習不是通過以前機器學習方法所涉及的專業知識密集型和容易出錯的過程,而是提供樣本數據(例如標記為貓圖片,標記為癌癥或非癌癥的MRI掃描...)并訓練神經元使用梯度下降的網絡。神經網絡比較并找到這些數據樣本中的常見模式,并學習應用相同的知識來分類以前從未見過的新數據樣本。

這種方法在過去幾年中深入學習了最流行的人工智能技術,并引發了使用深度學習的應用程序的爆炸式增長。

深度學習只對圖像識別有益(NO!)

很多人都承認深度學習是一種非常有用的人工智能技術,但很多批評者都抱怨它的使用僅限于解決涉及圖像分類的問題!

“圖像識別非常重要!”霍華德說。幾年前,霍華德和一組研究人員在肺部CT掃描上訓練了一個深度神經網絡,并創建了一種算法,可以檢測惡性癌癥腫瘤,這個算法的結果診斷的結果與四名人類放射科醫師相比,假陽性和陰性率更低。

霍華德還指出,許多問題可以重新理解為圖像識別問題。例如,在中國古代游戲圍棋中擊敗世界冠軍的深度學習算法AlphaGo實際上是一個圖像識別的卷積神經網絡(CNN)。

“具體來說,AlphaGo所做的是看了很多在真人玩過的圍棋的例子”霍華德解釋道。“基本上,他們最終做了一個圖像識別神經網絡,他們試圖學習的東西不是這張照片是貓還是狗,而是這是一張白子贏或黑贏的圍棋照片。”這種方法一直是AlphaGo和許多掌握不同棋盤和視頻游戲的AI算法成功的關鍵因素。

關鍵是,許多問題可以轉化為圖像識別問題,并通過深度學習解決。例如,霍華德深度學習課程的學生創建了一個神經網絡,該網絡在鼠標移動和點擊的圖像行為上進行訓練。在這種情況下,他創建了一個卷積神經網絡,試圖根據這些圖片預測欺詐行為。

深度學習可以將鼠標移動和點擊的視覺表示轉變為欺詐檢測應用程序

也就是說,深度學習也證明了其超越計算機視覺和圖像識別領域的價值。

霍華德指出,深度學習現在也適用于大多數自然語言處理(NLP)問題,這包括機器翻譯和文本摘要等領域。NLP是一個關鍵組件,它可以使Siri,Alexa和Cortana等AI助手理解你的命令。(有一點要知道:深度學習對人類語言的掌握有限)

深度學習還可以解決涉及結構化數據的問題,例如電子表格中的行和列。例如,你可以為神經網絡提供一組代表金融交易及結果(欺詐或正常)的行,并對其進行訓練以預測欺詐性交易。

霍華德指出,深度學習也可以應用于時間序列和信號問題,例如連接到網絡的不同IP地址的事件順序或隨時間收集的傳感器數據。

深度學習的痛點

霍華德還指出了一些深度學習成效有限的領域,這些領域包括強化學習,對抗模型和異常檢測。

一些專家認為強化學習是當前人工智能的圣杯。強化學習涉及開發AI模型而不向他們提供大量標記數據。在強化學習中,你為模型提供問題域的約束,并讓它開發自己的行為規則。AlphaGo的高級版AlphaGo Zero就是使用強化學習從頭開始訓練自己,然后超過了AlphaGo。雖然深度強化學習是人工智能研究中比較有趣的領域之一,但它在解決現實問題方面沒有明顯的進展。Google Brain AI研究員Alex Irpan在深度強化學習的極限上有一篇引人深思的文章。

對抗模型是霍華德提及的另一個深度學習痛點。對抗性示例是操縱輸入可能導致神經網絡以非理性方式運行的實例。有很多研究人員展示了對抗性示例如何能夠成為對AI模型的攻擊者。雖然已經做了一些努力來加強深層學習模式以對抗對抗性攻擊,但到目前為止,成功有限。部分挑戰源于神經網絡非常復雜且難以解釋的事實。

異常檢測,霍華德談到的第三個深度學習痛點也非常具有挑戰性。一般概念是在基線數據上訓練神經網絡,并讓它確定偏離基線的行為。這是在網絡安全中使用AI的主要方法之一,一些公司正在探索這一概念。但是,它仍然無法將自己確立為對抗安全威脅的非常可靠的方法。

深度學習是一個黑盒子

這是一個真正令人擔憂的問題,尤其是在人工智能模型被賦予關鍵決策的領域,例如醫療保健、自動駕駛汽車和刑事司法。那些愿意讓深度學習代表他們做出決定的人需要知道推動這些決策的因素是什么?不幸的是,當你在訓練神經網絡時獲得的性能優勢會降低你在決策過程中獲得的可見性。這就是深度學習通常被稱為“黑匣子”的原因。

但是,現在已經有了很多有趣的研究來解釋AI決策,并幫助工程師和最終用戶理解影響神經網絡輸出的元素。

深度學習需要大量數據

一般認為,要創建一個新的深度學習模型,需要訪問數百萬和數十億個帶標簽的示例,這就是為什么只有大型科技公司才能創建它。

“需要大量數據的說法通常不正確,因為大多數人在實踐中使用遷移學習”霍華德說。

遷移學習是機器學習中的一門學科,其中一個模型獲得的知識被轉移到執行類似任務的另一個模型。與人類如何將知識從一個領域轉移到另一個領域相比,它非常原始。但是,遷移學習在深度學習領域是一個非常有用的工具,因為它使開發人員能夠用更少的數據創建新模型。

霍華德解釋說:“你從一個預先訓練好的[神經]網絡開始,然后為你的特定任務微調權重。一般來說,如果你有大約1,000個示例,你應該能夠建立一個良好的神經網絡。”

你需要博士學位才能進行核心深度學習

深度學習是一個非常復雜的計算機科學領域,它涉及許多高級數學概念。但是在過去幾年中,學術界已經創建了大量的工具和庫來抽象出潛在的復雜性,并使你能夠無須解決過多的數學問題來開發深度學習模型。

Fast.ai和Keras就是兩個現成的庫,可用于快速開發深度學習應用程序。還有很多在線課程,包括霍華德的fast.ai,Coursera和其他課程,使你能夠開始深入學習編程,只需要很少的編程知識。許多具有計算機科學以外背景的人已經能夠將這些課程應用于現實世界的問題。

需要明確的是,深度學習研究仍然是一個非常先進和復雜的領域,人才既稀缺又昂貴。開發新的深度學習技術的人是一些最令人垂涎和收入極高的研究人員。但這并不意味著其他人需要擁有相同水平的知識才能在他們的應用程序中使用這些研究項目的結果。

深度學習需要大量的計算能力

“你可能會擔心你需要一個充滿GPU的大房間,總的來說這并不是真的,我現在看到的絕大部分成功結果都是用一個GPU完成的。” 霍華德說

大型公司和組織進行的大型研究項目需要大量的GPU,例如一款機器人手用6144 CPU和8個GPU進行訓練出來的。另一個例子是OpenAI Five,一個訓練有素的AI模型,可以玩著名的Dota 2在線戰斗競技游戲,OpenAI Five是用了128,000個CPU內核和256個GPU的訓練的結果。

但是,大多數實際問題都可以通過單個GPU解決。例如,你可以通過一個GPU來完成霍華德的Fast.ai課程。

總結:

我建議你觀看整個視頻,其中,霍華德深入研究了一些更專業的主題,例如你是否可以將深度學習應用于信息安全。重要的是我們要了解深度學習的范圍和限制以及機會和優勢,因為它是我們這個時代最有影響力的技術之一。深度學習不是過分夸大,也許它只是沒有很好地被理解。

-

人工智能

+關注

關注

1794文章

47642瀏覽量

239651 -

深度學習

+關注

關注

73文章

5512瀏覽量

121410

原文標題:揭秘人工智能:深度學習是否過分夸大?

文章出處:【微信號:Imgtec,微信公眾號:Imagination Tech】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

NPU在深度學習中的應用

AI大模型與深度學習的關系

FPGA做深度學習能走多遠?

深度學習中的時間序列分類方法

深度學習中的無監督學習方法綜述

深度學習與nlp的區別在哪

深度學習中的模型權重

深度學習的典型模型和訓練過程

深度學習常用的Python庫

深度學習與傳統機器學習的對比

深度解析深度學習下的語義SLAM

解讀深度學習是否過分夸大

解讀深度學習是否過分夸大

評論