Sebastian Ruder 是一位 NLP 方向的博士生、研究科學家,目前供職于一家做 NLP 相關服務的愛爾蘭公司 AYLIEN,同時,他也是一位活躍的博客作者,發表了多篇機器學習、NLP 和深度學習相關的文章。最近,他基于十幾篇經典論文盤點了 2018 年 NLP 領域十個令人激動并具有影響力的想法,并將文章發布在 Facebook 上。

今年,我發現了 十個令人激動并具有影響力的想法,并將其匯總成了這篇文章。在未來,我們可能還會對它們有更多了解。

對于每個想法,我都挑選 1-2 篇對該想法執行良好的論文。我試圖保持這份清單的簡潔性,因此如果沒有覆蓋到所有相關工作,還請大家見諒。這份清單包含主要與遷移學習相關的想法及其概述,不過也必然會帶有一定的主觀性。其中的大部分(一些例外)并不是一種趨勢(但我預測其中的一些想法在 2019 年會變得更具趨勢性)。

最后,我希望在評論區中看到你的精彩評論或者其他領域的精彩文章。

1)無監督的機器翻譯翻譯(Unsupervised MT)

ICLR 2018 收錄的兩篇關于無監督機器翻譯翻譯的論文(https://arxiv.org/abs/1710.11041)中,無監督機器翻譯的整個過程的表現好得讓人感到驚訝,但結果卻不如監督系統。在 EMNLP 2018,兩篇同樣來自這兩個團隊的論文(https://arxiv.org/abs/1809.01272)顯著改進了之前的方法,讓無監督的機器翻譯取得了進展。代表性論文:

《基于短語和神經的無監督機器翻譯》(EMNLP 2018)

Phrase-Based & Neural Unsupervised Machine Translation

論文地址:https://arxiv.org/abs/1804.0775

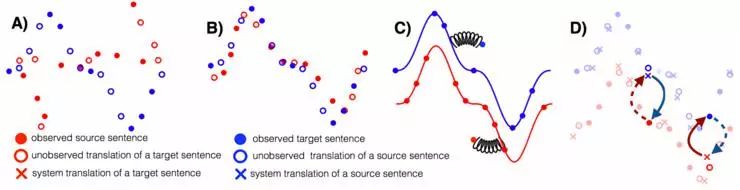

這篇論文很好地為無監督機器翻譯提取了三個關鍵要求:良好的初始化、語言建模以及你想任務建模(通過反向翻譯)。我們在下文中會看到,這三項要求同樣對其他的無監督場景有益。反向任務建模要求循環的一致性,其已在不同方法(尤其是 CycleGAN,https://arxiv.org/abs/1703.10593)中得到應用。這篇論文甚至在兩個低資源語言對——英語-烏爾都語以及英語-羅馬尼亞語上進行了廣泛的實驗和評估。未來我們有希望看到更多針對資源匱乏類語言的工作。

無監督機器翻譯三項原則的插圖說明:A)兩個單語數據集;B)初始化;C)語言建模;D)反向翻譯(Lample et al., 2018)。

2)預訓練的語言模型(Pretrained language models)

使用預訓練的語言模型可能是今年最重要的 NLP 趨勢,因此我在這里就不過多描述。針對預訓練的語言模型,這里有很多讓人印象深刻的方法:ELMo(https://arxiv.org/abs/1802.05365), ULMFiT(https://arxiv.org/abs/1801.06146)、 OpenAI Transformer以及 BERT(https://arxiv.org/abs/1810.04805)。代表性論文:

《深度的語境化詞語表示》(NAACL-HLT 2018)

《Deep contextualized word representations》

論文地址:https://arxiv.org/abs/1802.05365

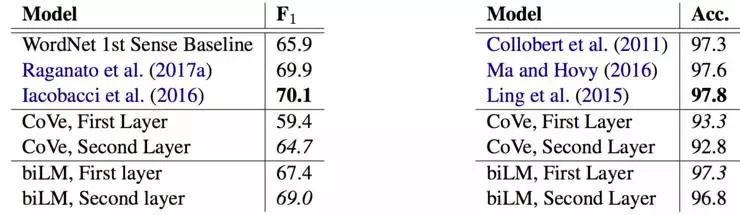

這篇論文介紹了 ELMo,頗受好評。除了實證結果讓人印象深刻,這篇論文的詳細的分析部分也非常顯眼,該部分梳理了各類因素的影響,并且分析了在表示中所捕獲的信息。詞義消歧(WSD)分析自身(下圖左)也執行得很好。這兩者都表明,機器學習本身就提供了接近最新技術的詞義消歧和詞性標注性能。

與基線相比的第一層和第二層雙向語言模型的詞義消歧(左)和詞性標注(右)結果(Peters et al., 2018)。

3)常識推理數據集(Common sense inference datasets)

將常識融入模型是向前發展的最重要方向之一。然而,創建好的數據集并不容易,甚至最常用的那些好的數據集還存在很大的偏差。今年出現了一些執行良好的數據集,它們試圖教模型一些常識,比如同樣都源自華盛頓大學的 Event2Mind(https://arxiv.org/abs/1805.06939)和 SWAG(https://arxiv.org/abs/1808.05326)。其中,SWAG 學到常識的速度出乎意料地快。代表性論文:

《視覺常識推理》(arXiv 2018)

Visual Commonsense Reasoning

論文地址:http://visualcommonsense.com/

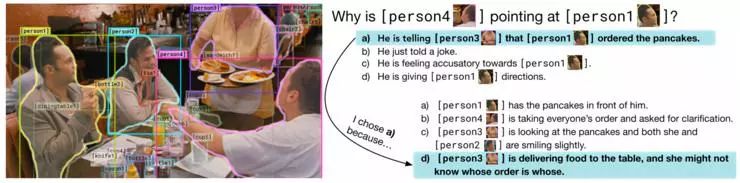

這是第一個包含了每個答案所對應的基本原理(解釋)的視覺 QA 數據集。此外,問題要求復雜的推理。創建者通過確保每個答案正確的先驗概率為 25%(每個答案在整個數據集中出現 4 次,其中,錯誤答案出現 3 次,正確答案出現 1 次)來不遺余力地解決可能存在的偏差;這就要求使用計算相關性和相似性的模型來解決約束優化問題。我希望,在創建數據集時預防可能的偏倚可以成為未來研究人員們的常識。最終,看看數據精彩地呈現出來就可以了。

VCR:給定一張圖片、一個區域列表和一個問題,模型必須回答這個問題,并給出一個可解釋其答案為何正確的理由。(Zellers et al., 2018).

4)元學習(Meta-learning)

元學習已在小樣本學習、強化學習和機器人技術中得到廣泛應用——最突出的例子是與模型無關的元學習(MAML,https://arxiv.org/abs/1703.03400),但其很少在 NLP 中得到成功應用。元學習對于訓練示例數量有限的問題非常有用。代表性論文:

《低資源神經機器翻譯的元學習》(EMNLP 2018)

Meta-Learning for Low-Resource Neural Machine Translation

論文地址:http://aclweb.org/anthology/D18-1398

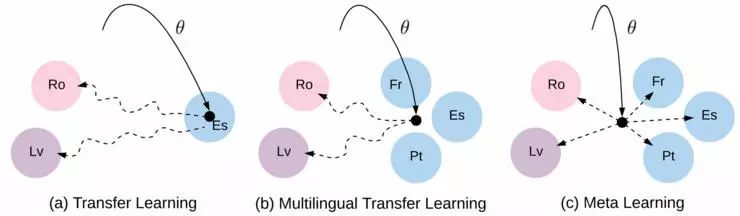

作者使用 MAML 方法學習翻譯的良好初始化,將每一個語言對都視為單獨的元任務。適應低資源語言對,可能是對 NLP 中的元學習最有用的設置。特別地,將多語種遷移學習(例如多語種 BERT,https://github.com/google-research/bert/blob/master/multilingual.md)、無監督學習和元學習結合起來是一個有前景的研究方向。

遷移學習、多語言遷移學習與元學習之間的區別。 實線:初始化學習。 虛線:調整路徑(Gu et al., 2018).

5)穩健的無監督方法(Robust unsupervised methods)

今年,我們(http://aclweb.org/anthology/P18-1072)和其他研究者(http://aclweb.org/anthology/D18-1056)都已經觀察到,當語言不同時,無監督的跨語言詞向量方法就會失效。這是遷移學習中的常見現象,其中源和目標設置(例如,域適應中的域https://www.cs.jhu.edu/~mdredze/publications/sentiment_acl07.pdf、連續學習https://arxiv.org/abs/1706.08840和多任務學習http://www.aclweb.org/anthology/E17-1005中的任務)之間的差異會導致模型的退化或失敗。因此,讓模型對于這些變化更加穩健非常重要。代表性論文:

《用于完全無監督的跨語言詞向量的穩健自學習方法》(ACL 2018)

A robust self-learning method for fully unsupervised cross-lingual mappings of word embeddings

論文地址:http://www.aclweb.org/anthology/P18-1073

該論文利用他們對問題的理解來設計更好的初始化,而不是在初始化上應用元學習。特別地,他們將兩種語言中與相似詞具有相似的詞分布的詞進行配對。這是利用領域專業知識和分析見解來使模型變得更穩健的非常好的案例。

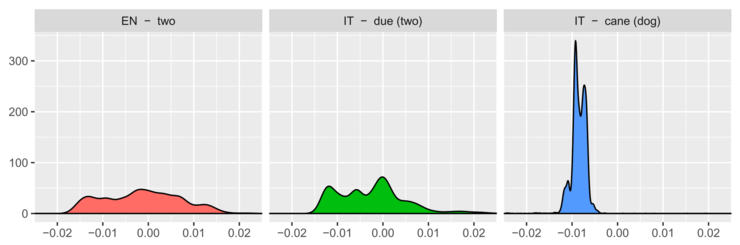

三個詞的相似度分布。 等效翻譯(「two」和「due」)的分布比非相關詞(「two」和「cane」——意思是「dog」)的分布更為相似。(Artexte et al., 2018)

6)理解表示(Understanding representations)

研究者們未來更好地理解表示,已經做了很多努力。特別是「診斷分類器」(diagnostic classifiers,https://arxiv.org/abs/1608.04207)(旨在評估學習到的表示能否預測某些屬性的任務) 已經變得非常常用(http://arxiv.org/abs/1805.01070)了。代表性論文:

《語境化詞向量解析:架構和表示》(EMNLP 2018)

Dissecting Contextual Word Embeddings: Architecture and Representation

論文地址:http://aclweb.org/anthology/D18-1179

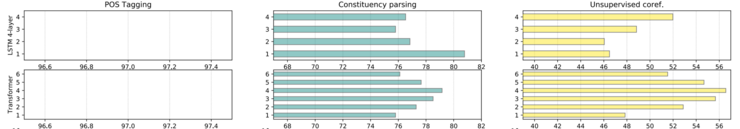

該論文對預訓練語言模型表示實現了更好的理解。作者在精心設計的無監督和有監督的任務上對詞和跨度表示進行了廣泛的學習研究。結果表明:預訓練的表示可以在較低的層中學習到低級形態和句法任務相關的任務,并且可以在較高的層中學習到更長范圍的語義相關的任務。

對我來說,這個結果真正表明了,預訓練語言模型確實捕獲到了與在 ImageNet 上預訓練的計算機視覺模型(https://thegradient.pub/nlp-imagenet/)相類似的屬性。

BiLSTM 和 Transformer預訓練表示在詞性標注、選區分析和無監督共指解析((從左到右)上每層的性能。(Peters et al., 2018)

7)巧妙的輔助任務(Clever auxiliary tasks)

在許多場景下,我們看到研究者越來越多地將精心挑選的輔助任務與多任務學習一起使用。一個好的輔助任務來說,它必須是易于獲取數據的。最重要的例子之一是 BERT(https://arxiv.org/abs/1810.04805),它使用下一個句子的預測(該預測方法在 Skip-thoughts,https://papers.nips.cc/paper/5950-skip-thought-vectors.pdf以及最近的 Quick-thoughts,https://arxiv.org/pdf/1803.02893.pdf中應用過)來產生很大的效果。代表性論文:

《語義結構的句法框架》(EMNLP 2018)

Syntactic Scaffolds for Semantic Structures

論文地址:http://aclweb.org/anthology/D18-1412

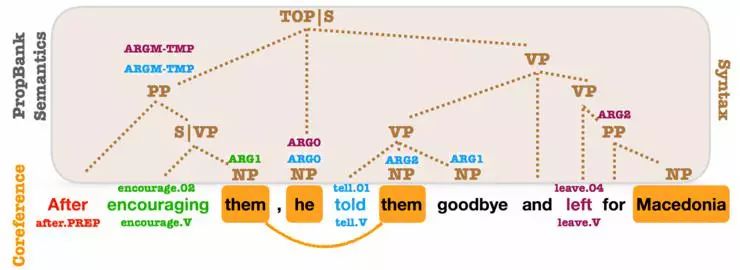

該論文提出了輔助任務,它通過預測每個跨度對應的句法成分類型,來對跨度表示進行預訓練。輔助任務雖然在概念上非常簡單,但它為語義角色標注和共指解析等跨級別預測任務帶來了大幅的改進。這篇論文表明,在目標任務(這里是指跨度任務)所要求的級別上所學到的特定的表示是效益巨大的。

pair2vec:用于跨句推理的組合詞對嵌入(arXiv 2018)

pair2vec: Compositional Word-Pair Embeddings for Cross-Sentence Inference

論文地址:https://arxiv.org/abs/1810.08854

類似地,本論文通過最大化詞對與其語境間的點互信息(pointwise mutual information),來對詞對表示進行預訓練。這就激勵了模型學習更有意義的詞對表示,而不使用語言建模等更通用的目標。在 SQuAD 和 MultiNLI 等要求跨句推理的任務中,預訓練表示是有效的。

我們可以期望未來,看到更多的預訓練任務,能夠捕獲特別適用于某些下游任務的屬性,并且能夠與語言建模等更多通用任務相輔相成。

OntoNotes的句法、PropBank和共指注釋。PropBank SRL參數和共指提及被標注在了句法成分的頂部。幾乎每一個參數都與一個句法成分有關。(Swayamdipta et al., 2018)

8)半監督學習和遷移學習相結合(Combining semi-supervised learning with transfer learning)

伴隨著遷移學習的最新進展,我們不應該忘記使用特定的目標任務數據的更明確的方法。事實上,預訓練表示與許多半監督學習方法是相輔相成的。我們已經探索了一種半監督學習的特殊方法——自我標注的方法(http://aclweb.org/anthology/P18-1096)。代表性論文:

《基于交叉視點訓練的半監督序列建模》(EMNLP 2018)

Semi-Supervised Sequence Modeling with Cross-View Training

論文地址:http://aclweb.org/anthology/D18-1217

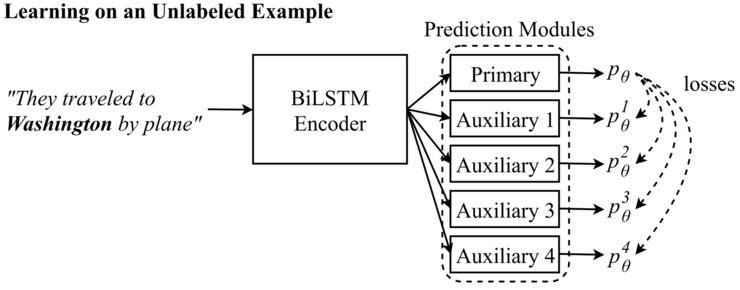

這篇論文表明,一個能確保對輸入的不同視點的預測與主模型的預測一致的概念上非常簡單的想法,可以在大量的任務上得到性能的提高。這個想法與詞 dropout 類似,但允許利用未標記的數據讓模型變得更穩健。與 mean teacher(https://arxiv.org/abs/1703.01780)等其他自集成模型相比,它是專門針對特定的 NLP 任務設計的。

隨著對半監督學習的研究越越來越多,我們將有望看到有更多明確地嘗試對未來目標預測進行建模的研究工作。

輔助預測模塊看到的輸入:輔助1 :They traveled to__________________. 輔助2:They traveled toWashington_______. 輔助3:_____________Washingtonby plane.輔助4:_____________by plane。(Clark et al., 2018)

9)大型文檔的問答和推理(QA and reasoning with large documents)

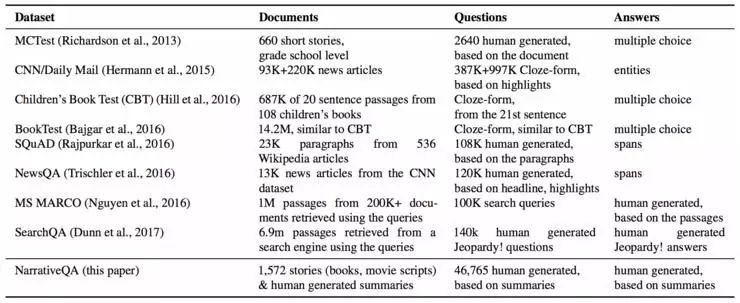

隨著一系列新的問答(QA)數據集(http://quac.ai/)的出現,問答系統有了很大的發展。除了對話式問答和多步推理,問答最具挑戰性的方面是對敘述和大體量信息進行合成。代表性論文:

《敘述答閱讀理解挑戰》(TACL 2018)

The NarrativeQA Reading Comprehension Challenge

論文地址:http://aclweb.org/anthology/Q18-1023

這篇論文基于對完整的電影劇本和書籍的提問和回答,提出了一個具有挑戰性的新的問答數據集。雖然依靠當前的方法還無法完成這項任務,但是模型可以選擇使用摘要(而不是整本書籍)作為選擇答案(而不是生成答案)的語境。這些變體讓任務的實現更加容易,也使得模型可以逐步擴展到整個語境設置。

我們需要更多這樣的數據集,它們能體現具有挑戰性的問題,并且有助于解決這些問題。

QA 數據集比較

10)歸納偏差(Inductive bias)

CNN 中的卷積、正則化、dropout 以及其他機制等歸納偏差,是神經網絡模型的核心部分,它們充當調節器的角色,使模型更具樣本效率。然而,提出一個應用更加廣泛的歸納偏差方法,并將其融入模型,是具有挑戰性的。代表性論文:

《基于人類注意力的序列分類》(CoNLL 2018)

Sequence classification with human attention

論文地址:http://aclweb.org/anthology/K18-1030

這篇論文提出利用視覺跟蹤語料庫中的人類注意力,來 RNN 中的注意力進行規則化處理。鑒于 Transformer 等當前許多模型都使用注意力這一方法,找到更有效得訓練它的方法是一個重要的方向。同時,論文還證明了另外一個案例——人類語言學習可以幫助改進計算模型。

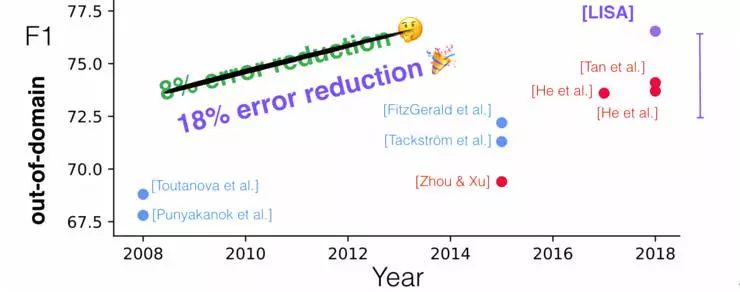

《語義角色標注的語言學信息的自我注意力》(EMNLP 2018)

Linguistically-Informed Self-Attention for Semantic Role Labeling

論文地址:http://aclweb.org/anthology/D18-1548

這篇論文有很多亮點:一個在句法和語義任務上進行聯合訓練的Transformer 模型;在測試時注入高質量語法分析的能力;以及域外評估。論文還通過訓練注意力頭來關注每個標注的句法 parents,來使轉換器的多頭注意力統一對句法更加敏感。

未來我們有望看到更多針對輸入特定場景,將 Transformer 注意力頭用作輔助預測器的案例。

PropBank語義角色標注的十年。語言學信息的自我注意力( LISA )與其他域外數據方法的比較。

-

深度學習

+關注

關注

73文章

5512瀏覽量

121426 -

nlp

+關注

關注

1文章

489瀏覽量

22077

原文標題:一文概述 2018 年深度學習 NLP 十大創新思路

文章出處:【微信號:AItists,微信公眾號:人工智能學家】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

2024年存儲行業十大事件盤點

佰維存儲榮獲十大數智化轉型創新企業

達實智能榮獲十大數字科技創新產品獎

華為榮獲2024年算力網絡產業十大創新成果獎

GPU深度學習應用案例

“智能網聯汽車全球十大發展突破”在京發布

深度學習與nlp的區別在哪

TensorFlow與PyTorch深度學習框架的比較與選擇

度亙核芯榮獲“2023年度中國十大光學產業技術”獎

回顧2018年深度學習NLP十大創新思路

回顧2018年深度學習NLP十大創新思路

評論