北京交通大學(xué)電子信息工程學(xué)院袁雪副教授給我們講解了在高級輔助駕駛系統(tǒng)(ADAS)中的多任務(wù)深度學(xué)習(xí)框架的應(yīng)用。

內(nèi)容提綱:

ADAS系統(tǒng)包括車輛檢測、行人檢測、交通標(biāo)志識別、車道線檢測等多種任務(wù),同時(shí),由于無人駕駛等應(yīng)用場景的要求,車載視覺系統(tǒng)還應(yīng)具備相應(yīng)速度快、精度高、任務(wù)多等要求。對于傳統(tǒng)的圖像檢測與識別框架而言,短時(shí)間內(nèi)同時(shí)完成多類的圖像分析任務(wù)是難以實(shí)現(xiàn)的。

袁雪副教授的項(xiàng)目組提出使用一個(gè)深度神經(jīng)網(wǎng)絡(luò)模型實(shí)現(xiàn)交通場景中多任務(wù)處理的方法。其中交通場景的分析主要包括以下三個(gè)方面:大目標(biāo)檢測(車輛、行人和非機(jī)動(dòng)車),小目標(biāo)分類(交通標(biāo)志和紅綠燈)以及可行駛區(qū)域(道路和車道線)的分割。

這三類任務(wù)可以通過一個(gè)深度神經(jīng)網(wǎng)絡(luò)的前向傳播完成,這不僅可以提高系統(tǒng)的檢測速度,減少計(jì)算參數(shù),而且可以通過增加主干網(wǎng)絡(luò)的層數(shù)的方式提高檢測和分割精度。

以下為當(dāng)天分享的內(nèi)容總結(jié)。

圖文分享總結(jié)

一、任務(wù)分析

WHO在2009年統(tǒng)計(jì)的一個(gè)數(shù)據(jù)顯示,在全世界范圍內(nèi)每年由交通事故死亡的人數(shù)有123萬人。但是我們知道,在朝鮮戰(zhàn)爭中,整個(gè)戰(zhàn)爭死亡的人數(shù)也差不多一百多萬。也就是說,每年死于交通事故的人數(shù)差不多等于一次非常慘烈的戰(zhàn)爭的死亡人數(shù)了。根據(jù)WHO統(tǒng)計(jì),在全世界范圍內(nèi)每年由交通事故造成的死亡人數(shù)有123萬之多;而發(fā)生交通事故90%是由司機(jī)人為原因造成的,比如注意力不集中、超速、安全意識弱等等。所以目前減少交通事故的最主要途徑通過采用高級輔助駕駛系統(tǒng)(ADAS)就是減少認(rèn)為錯(cuò)誤。

對于ADAS系統(tǒng),基本上包括這些功能:夜視輔助、車道保持、司機(jī)提醒、防撞提醒、車道變換輔助、停車輔助、碰撞疏解、死角障礙物檢測、交通標(biāo)志識別、車道線偏移提醒、司機(jī)狀態(tài)監(jiān)測、遠(yuǎn)光燈輔助等。這些功能是ADAS所必備的。

為了實(shí)現(xiàn)這些功能,一般其傳感器需要包括視覺傳感器、超聲波傳感器、GPS&Map傳感器、Lidar傳感器、Radar傳感器,還有一些別的通信設(shè)備。但是我們在市面上看到的大多數(shù)傳感器其功能其實(shí)是比較少的,例如mobile I,它只有車道保持、交通標(biāo)志識別、前車監(jiān)測和距離監(jiān)測的功能,但并不全面。從廠家或者用戶的角度來說,自然我們希望能用最便宜的傳感器來完成更多ADAS的功能。最便宜的傳感器基本上就是視覺傳感器。所以我們設(shè)計(jì)方案時(shí)就想,能不能通過算法將視覺傳感器實(shí)現(xiàn)更多ADAS系統(tǒng)的功能呢?這就是我們整個(gè)研發(fā)的初衷。

此外,我們還需要考慮ADAS的一些特點(diǎn)。ADAS系統(tǒng)(包括無人駕駛)是在一個(gè)嵌入式平臺下進(jìn)行的,也就是說它的計(jì)算資源很少。那么我們也必須考慮如何在這樣一個(gè)計(jì)算資源非常少的基礎(chǔ)上,保證ADAS系統(tǒng)能夠快速且高精度地響應(yīng),同時(shí)還能保證多任務(wù)的需求。這是我們第二個(gè)要考慮的問題。

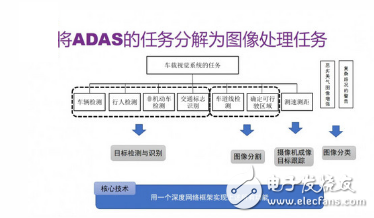

為了解決以上兩個(gè)問題,我們首先把ADAS的任務(wù)分解一下。如圖所示,我們將ADAS的任務(wù)分解成目標(biāo)檢測與識別、圖像分割、攝像機(jī)成像目標(biāo)跟蹤、圖像分割。我們過去一年多的研發(fā)工作其實(shí)就是,用一個(gè)深度學(xué)習(xí)框架來同時(shí)實(shí)現(xiàn)上述這四個(gè)的功能。

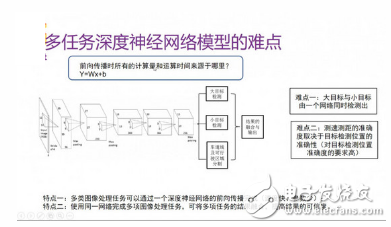

對于一個(gè)前向傳播的網(wǎng)絡(luò),其計(jì)算量和計(jì)算時(shí)間主要取決于它的參數(shù)數(shù)量,而80%的參數(shù)都來自全鏈接層,所以我們的第一個(gè)想法就是去掉全鏈接層。其次,網(wǎng)絡(luò)越深,它的參數(shù)就會越多所以如果我們把目標(biāo)檢測與識別、圖像分割、攝像機(jī)成像目標(biāo)跟蹤、圖像分割做成四個(gè)網(wǎng)絡(luò)的話,就會有X4倍的參數(shù)。

所以針對這兩個(gè)考量,我們用一個(gè)主干的網(wǎng)絡(luò)來做前面的運(yùn)算,然后在后面再根據(jù)具體的任務(wù)分成多個(gè)小的分支加到主干網(wǎng)絡(luò)上。這樣多個(gè)圖像處理的任務(wù)就可以通過一個(gè)主干網(wǎng)絡(luò)的前向傳播來完成了,其參數(shù)大大減少,計(jì)算速度也變的更快。同時(shí)我們也能實(shí)現(xiàn)多個(gè)任務(wù)同時(shí)進(jìn)行的需求。另外,在最后我們還可以將多個(gè)結(jié)果進(jìn)行融合,駕到訓(xùn)練過程的調(diào)整中,這樣就可以提高我們結(jié)果的可信性。

但是在這個(gè)過程中我們也碰到一些難點(diǎn)。第一個(gè)難點(diǎn)就是我們在同一個(gè)網(wǎng)絡(luò)中需要將較大的目標(biāo)(例如車輛)和較小的目標(biāo)(例如交通標(biāo)志)同時(shí)檢測出來。第二個(gè)難點(diǎn)是,測速測距時(shí)我們需要的目標(biāo)的位置是非常精確的,目前這個(gè)問題我們還沒有解決。

-

無人駕駛

+關(guān)注

關(guān)注

98文章

4088瀏覽量

120857 -

ADAS系統(tǒng)

+關(guān)注

關(guān)注

4文章

226瀏覽量

25749 -

深度學(xué)習(xí)

+關(guān)注

關(guān)注

73文章

5512瀏覽量

121430

發(fā)布評論請先 登錄

相關(guān)推薦

NPU在深度學(xué)習(xí)中的應(yīng)用

GPU深度學(xué)習(xí)應(yīng)用案例

AI大模型與深度學(xué)習(xí)的關(guān)系

FPGA做深度學(xué)習(xí)能走多遠(yuǎn)?

深度學(xué)習(xí)中的時(shí)間序列分類方法

深度學(xué)習(xí)中的無監(jiān)督學(xué)習(xí)方法綜述

深度學(xué)習(xí)與nlp的區(qū)別在哪

深度學(xué)習(xí)中的模型權(quán)重

深度學(xué)習(xí)常用的Python庫

深度學(xué)習(xí)與傳統(tǒng)機(jī)器學(xué)習(xí)的對比

深度解析深度學(xué)習(xí)下的語義SLAM

為什么深度學(xué)習(xí)的效果更好?

ADAS要如何運(yùn)用深度學(xué)習(xí)?

ADAS要如何運(yùn)用深度學(xué)習(xí)?

評論