- 引言

神經(jīng)網(wǎng)絡(luò)是一種模擬人腦神經(jīng)元結(jié)構(gòu)的計(jì)算模型,廣泛應(yīng)用于圖像識(shí)別、自然語(yǔ)言處理、語(yǔ)音識(shí)別等領(lǐng)域。在神經(jīng)網(wǎng)絡(luò)中,激活函數(shù)起著至關(guān)重要的作用,它決定了神經(jīng)元的輸出值,進(jìn)而影響整個(gè)網(wǎng)絡(luò)的性能。本文將詳細(xì)介紹激活函數(shù)的定義、類型。

- 激活函數(shù)的定義和基本功能

2.1 定義

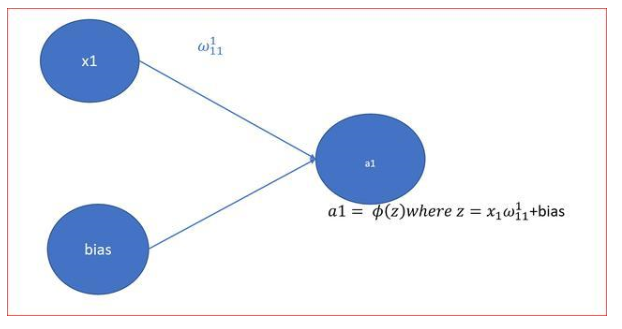

激活函數(shù)(Activation Function)是神經(jīng)網(wǎng)絡(luò)中的一種非線性函數(shù),用于將輸入信號(hào)轉(zhuǎn)換為輸出信號(hào)。在神經(jīng)網(wǎng)絡(luò)中,每個(gè)神經(jīng)元的輸出都是通過(guò)激活函數(shù)計(jì)算得到的。激活函數(shù)的引入使得神經(jīng)網(wǎng)絡(luò)能夠模擬復(fù)雜的非線性關(guān)系,從而提高網(wǎng)絡(luò)的表達(dá)能力和性能。

2.2 基本功能

激活函數(shù)的基本功能包括以下幾點(diǎn):

(1)引入非線性:激活函數(shù)將神經(jīng)元的線性輸出轉(zhuǎn)換為非線性輸出,使得神經(jīng)網(wǎng)絡(luò)能夠模擬復(fù)雜的非線性關(guān)系。

(2)控制神經(jīng)元的激活狀態(tài):激活函數(shù)可以控制神經(jīng)元的激活狀態(tài),即決定神經(jīng)元是否對(duì)輸入信號(hào)產(chǎn)生響應(yīng)。

(3)加速收斂:合適的激活函數(shù)可以加速神經(jīng)網(wǎng)絡(luò)的訓(xùn)練過(guò)程,提高收斂速度。

(4)防止梯度消失或爆炸:在神經(jīng)網(wǎng)絡(luò)的訓(xùn)練過(guò)程中,激活函數(shù)可以防止梯度消失或爆炸,從而保證網(wǎng)絡(luò)的穩(wěn)定性。

- 常見(jiàn)的激活函數(shù)類型

3.1 Sigmoid函數(shù)

Sigmoid函數(shù)是一種常見(jiàn)的激活函數(shù),其數(shù)學(xué)表達(dá)式為:

f(x) = 1 / (1 + exp(-x))

Sigmoid函數(shù)的輸出范圍在(0, 1)之間,具有S形曲線的特點(diǎn)。Sigmoid函數(shù)的優(yōu)點(diǎn)是平滑且連續(xù),但其缺點(diǎn)是存在梯度消失問(wèn)題,即當(dāng)輸入值非常大或非常小時(shí),梯度接近于0,導(dǎo)致網(wǎng)絡(luò)訓(xùn)練速度變慢。

3.2 Tanh函數(shù)

Tanh函數(shù)(雙曲正切函數(shù))是Sigmoid函數(shù)的一種變體,其數(shù)學(xué)表達(dá)式為:

f(x) = (exp(x) - exp(-x)) / (exp(x) + exp(-x))

Tanh函數(shù)的輸出范圍在(-1, 1)之間,其形狀與Sigmoid函數(shù)相似,但中心點(diǎn)在0。Tanh函數(shù)的優(yōu)點(diǎn)是輸出值以0為中心,可以減少學(xué)習(xí)過(guò)程中的對(duì)稱性問(wèn)題。然而,Tanh函數(shù)同樣存在梯度消失問(wèn)題。

3.3 ReLU函數(shù)

ReLU函數(shù)(Rectified Linear Unit,線性整流單元)是一種常用的激活函數(shù),其數(shù)學(xué)表達(dá)式為:

f(x) = max(0, x)

ReLU函數(shù)的優(yōu)點(diǎn)是計(jì)算簡(jiǎn)單,訓(xùn)練速度快,且在實(shí)踐中表現(xiàn)出較好的性能。然而,ReLU函數(shù)存在“死亡ReLU”問(wèn)題,即當(dāng)輸入值為負(fù)時(shí),梯度為0,導(dǎo)致部分神經(jīng)元不再更新。

3.4 Leaky ReLU函數(shù)

Leaky ReLU函數(shù)是對(duì)ReLU函數(shù)的一種改進(jìn),其數(shù)學(xué)表達(dá)式為:

f(x) = max(αx, x)

其中α是一個(gè)小于1的常數(shù)。Leaky ReLU函數(shù)在輸入值為負(fù)時(shí),仍然有一定的梯度,從而解決了ReLU函數(shù)的“死亡ReLU”問(wèn)題。

3.5 ELU函數(shù)

ELU函數(shù)(Exponential Linear Unit,指數(shù)線性單元)是一種自歸一化激活函數(shù),其數(shù)學(xué)表達(dá)式為:

f(x) = x if x > 0 else α(exp(x) - 1)

ELU函數(shù)在輸入值為正時(shí)與線性函數(shù)相同,而在輸入值為負(fù)時(shí),輸出值在(-α, 0)之間。ELU函數(shù)的優(yōu)點(diǎn)是可以自動(dòng)調(diào)節(jié)神經(jīng)元的輸出值,使得網(wǎng)絡(luò)在訓(xùn)練過(guò)程中更加穩(wěn)定。

3.6 Softmax函數(shù)

Softmax函數(shù)常用于多分類問(wèn)題中,其數(shù)學(xué)表達(dá)式為:

f(x_i) = exp(x_i) / Σ(exp(x_j))

其中x_i和x_j分別表示輸入向量的第i個(gè)和第j個(gè)元素。Softmax函數(shù)將輸入向量轉(zhuǎn)換為概率分布,使得每個(gè)類別的輸出值在(0, 1)之間,且所有類別的輸出值之和為1。

-

神經(jīng)網(wǎng)絡(luò)

+關(guān)注

關(guān)注

42文章

4779瀏覽量

101040 -

函數(shù)

+關(guān)注

關(guān)注

3文章

4345瀏覽量

62870 -

計(jì)算模型

+關(guān)注

關(guān)注

0文章

29瀏覽量

9868 -

自然語(yǔ)言處理

+關(guān)注

關(guān)注

1文章

619瀏覽量

13616

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

神經(jīng)網(wǎng)絡(luò)基本的訓(xùn)練和工作原理是什么

【PYNQ-Z2試用體驗(yàn)】神經(jīng)網(wǎng)絡(luò)基礎(chǔ)知識(shí)

神經(jīng)網(wǎng)絡(luò)移植到STM32的方法

ReLU到Sinc的26種神經(jīng)網(wǎng)絡(luò)激活函數(shù)可視化大盤(pán)點(diǎn)

神經(jīng)網(wǎng)絡(luò)初學(xué)者的激活函數(shù)指南

神經(jīng)網(wǎng)絡(luò)初學(xué)者的激活函數(shù)指南

神經(jīng)網(wǎng)絡(luò)中激活函數(shù)的定義及類型

神經(jīng)網(wǎng)絡(luò)中激活函數(shù)的定義及類型

評(píng)論