1 前言

點(diǎn)云作為一種重要的數(shù)據(jù)表示,廣泛應(yīng)用于自動(dòng)駕駛、增強(qiáng)現(xiàn)實(shí)和機(jī)器人技術(shù)等領(lǐng)域。由于點(diǎn)云數(shù)據(jù)量通常很大,對(duì)其進(jìn)行采樣以獲得一個(gè)具有代表性的點(diǎn)集子集是三維計(jì)算機(jī)視覺中的一個(gè)基礎(chǔ)和重要的任務(wù)。除了隨機(jī)采樣和最遠(yuǎn)點(diǎn)采樣之外,大多數(shù)傳統(tǒng)的點(diǎn)云采樣方法都是基于數(shù)學(xué)統(tǒng)計(jì)的,例如均勻采樣、網(wǎng)格采樣和幾何采樣等,這些方法對(duì)于點(diǎn)云密度和分布比較敏感。最近,一些基于神經(jīng)網(wǎng)絡(luò)的方法開始通過端到端的任務(wù)驅(qū)動(dòng)學(xué)習(xí)方式進(jìn)行更好的任務(wù)定向采樣,例如S-Net、SampleNet、DA-Net等。

但是這些方法大多是基于生成模型的,而不是直接選擇點(diǎn)。另一方面,為點(diǎn)云設(shè)計(jì)基于神經(jīng)網(wǎng)絡(luò)的局部特征聚合算子的工作越來越多。雖然其中一些(例如 PointCNN 、PointASNL 、GSS )在學(xué)習(xí)潛在特征時(shí)減少了點(diǎn)數(shù),但由于處理過程中不存在真正的空間點(diǎn),它們很難被認(rèn)為是真實(shí)意義上的采樣方法。此外,上述方法都沒有將形狀輪廓視為特殊特征。受 Canny 邊緣檢測(cè)算法和注意力機(jī)制的啟發(fā),本文提出了一種基于非生成注意力的點(diǎn)云邊緣采樣方法 (APES),結(jié)合了基于神經(jīng)網(wǎng)絡(luò)的學(xué)習(xí)和基于數(shù)學(xué)統(tǒng)計(jì)的直接點(diǎn)選擇。

APES使用注意力機(jī)制來計(jì)算相關(guān)圖和樣本邊緣點(diǎn),這些邊緣點(diǎn)的屬性反映在這些相關(guān)圖中。提出了兩種具有不同注意力模式的 APES。此外,我們的方法可以將輸入點(diǎn)云下采樣到任何所需的大小。基于鄰居到點(diǎn)(N2P)注意,計(jì)算每個(gè)點(diǎn)與其相鄰點(diǎn)之間的相關(guān)映射,提出了基于局部的APES基于點(diǎn)對(duì)點(diǎn) (P2P) 注意力,它計(jì)算所有點(diǎn)之間的相關(guān)性圖,提出了基于全局的 APES本文的貢獻(xiàn)如下:

1)一種點(diǎn)云邊緣采樣方法,稱為 APES,它結(jié)合了基于神經(jīng)網(wǎng)絡(luò)的學(xué)習(xí)和基于數(shù)學(xué)統(tǒng)計(jì)的直接點(diǎn)選擇2)通過使用兩種不同的注意力模式,基于局部的 APES 和基于全局的 APES 的兩種變體3)公共點(diǎn)云基準(zhǔn)上的良好定性和定量結(jié)果,證明了所提出的采樣方法的有效性。這里也推薦「3D視覺工坊」新課程三維點(diǎn)云處理:算法與實(shí)戰(zhàn)匯總2 相關(guān)背景

傳統(tǒng)點(diǎn)云采樣方法

隨機(jī)采樣(RS):簡(jiǎn)單高效,但無法控制采樣點(diǎn)分布。

最遠(yuǎn)點(diǎn)采樣(FPS):迭代選擇點(diǎn)云中最遠(yuǎn)點(diǎn),目前最廣泛使用。

均勻采樣:選擇點(diǎn)云中均勻分布的點(diǎn)。

網(wǎng)格采樣:使用規(guī)則網(wǎng)格采樣點(diǎn),無法精確控制點(diǎn)數(shù)。

幾何采樣:基于局部幾何信息采樣,例如曲率。

逆密度采樣(IDIS):采樣距離和值較小的點(diǎn)。

深度學(xué)習(xí)點(diǎn)云采樣方法

S-Net:直接從全局特征生成新點(diǎn)坐標(biāo)。

SampleNet:在S-Net基礎(chǔ)上引入軟投影操作。

DA-Net:考慮點(diǎn)云密度進(jìn)行自適應(yīng)采樣。

MOPS-Net:學(xué)習(xí)采樣變換矩陣與原點(diǎn)云相乘生成新點(diǎn)云。

PST-NET:使用self-attention層替代S-Net中的MLP層。

但是現(xiàn)有的深度學(xué)習(xí)采樣方法大多基于生成模型,不能直接選擇點(diǎn),也沒有考慮形狀邊緣作為特殊特征。

3 方法

3.1 圖像中的Canny邊緣檢測(cè)

Canny圖像邊緣檢測(cè)流程:

(i)應(yīng)用高斯濾波器平滑圖像;

(ii) 找到圖像的強(qiáng)度梯度;

(iii) 應(yīng)用梯度幅度閾值或下限截止抑制;

(iv) 應(yīng)用雙閾值來確定潛在邊;

(v) 通過抑制所有其他弱且不連接到強(qiáng)邊的邊來最終檢測(cè)邊緣。

替換的邊緣檢測(cè)

核心思想是計(jì)算每個(gè)像素的梯度強(qiáng)度。可以更通用地考慮:

定義像素與鄰域像素之間的相關(guān)特性

計(jì)算歸一化的相關(guān)性映射,是像素的鄰域;

計(jì)算的標(biāo)準(zhǔn)差,大的像素點(diǎn)為邊緣點(diǎn)

使用標(biāo)準(zhǔn)差代替了梯度計(jì)算,該方法相比原本的圖像的Canny邊緣檢測(cè)器計(jì)算成本更高,但卻可以將其應(yīng)用于點(diǎn)云邊緣采樣。相比圖像規(guī)整的排列,點(diǎn)云通常是不規(guī)則的,無序的,甚至是稀疏的,因此基于體素的3D卷積不適用。與圖像具有多種屬性(如RGB或灰度值)相比,對(duì)于許多點(diǎn)云來說,點(diǎn)坐標(biāo)可能是唯一可用的特征。

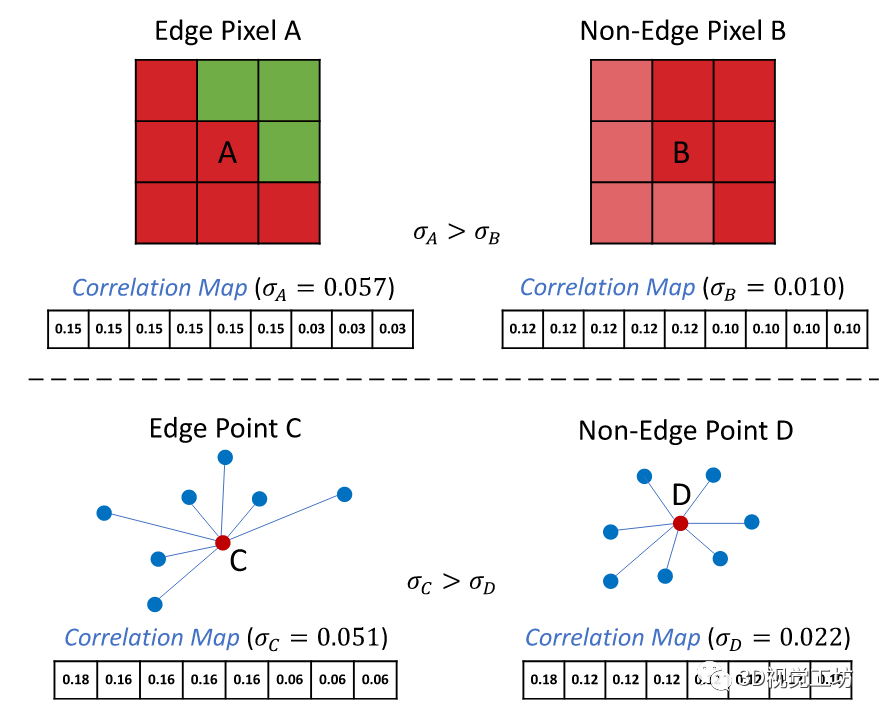

圖1 使用標(biāo)準(zhǔn)偏差來選擇邊緣像素/點(diǎn)的圖示。在中心像素/點(diǎn)與其相鄰像素之間計(jì)算歸一化相關(guān)圖。中心像素/點(diǎn)作為鄰居自包含。歸一化相關(guān)圖中的較大標(biāo)準(zhǔn)偏差意味著它是邊緣像素/點(diǎn)的可能性更高。

3.2 基于局部的點(diǎn)云邊緣采樣

對(duì)于點(diǎn)云,我們定義近鄰定義每個(gè)點(diǎn)的局部鄰域點(diǎn)云,然后延續(xù)剛剛的替換Canny邊緣檢測(cè)算法的思路。

定義點(diǎn)與鄰域點(diǎn)的基于局部的相關(guān)特性

計(jì)算歸一化的基于局部的相關(guān)性映射

計(jì)算的標(biāo)準(zhǔn)差,大的像素點(diǎn)為邊緣點(diǎn)

其中,與原始的Transformer的模型相比,和 分別表示應(yīng)用于查詢輸入和關(guān)鍵輸入的線性層,即為,特征維度計(jì)數(shù)平方根用作比例因子稱之為鄰域-點(diǎn)(N2P)注意力,它捕獲局部信息。

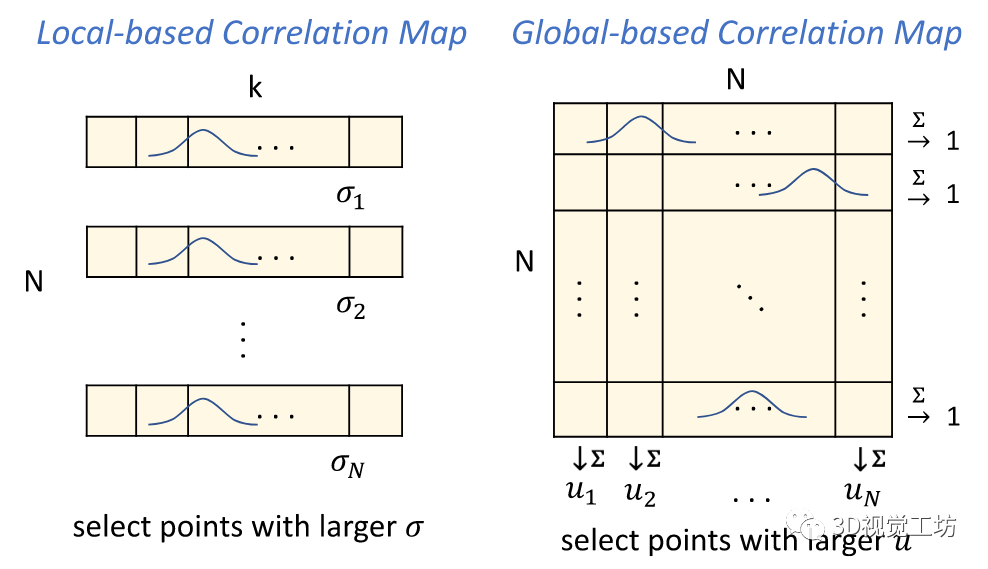

3.3 基于全局的點(diǎn)云邊緣采樣

對(duì)于采樣問題,全局信息也是至關(guān)重要的。考慮k = N的情況,利用線性層Q和K共享所有點(diǎn),將其稱為點(diǎn)對(duì)點(diǎn) (P2P) 注意力,基于全局的相關(guān)特性與相關(guān)性映射如下:得到全相關(guān)性圖本文改為按列計(jì)算和(而不是行),計(jì)算得到,較大的點(diǎn)作為邊緣點(diǎn)采樣。主要考慮到,如果點(diǎn)鄰近邊緣點(diǎn),那么應(yīng)較大,如果在中對(duì)應(yīng)的列元素的值也較大,那么也可能是邊緣點(diǎn)。

圖2 所提出方法的關(guān)鍵思想。N 表示點(diǎn)的總數(shù),而 k 表示用于基于局部采樣方法的鄰居數(shù)量。

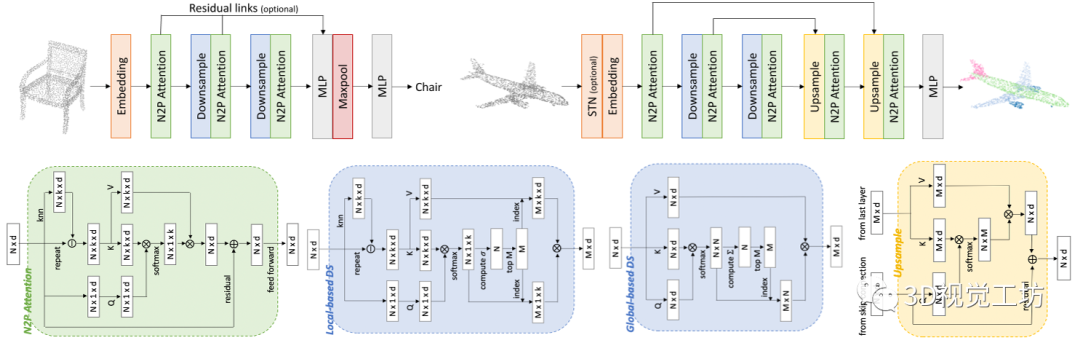

3.4 網(wǎng)絡(luò)框架

基于上述兩種模塊,本文構(gòu)建了分類網(wǎng)絡(luò)和分割網(wǎng)絡(luò),如下圖所示

圖3 用于分類的網(wǎng)絡(luò)架構(gòu)(左上)和分割(右上)。還給出了 N2P 注意力特征學(xué)習(xí)層(左下)、兩個(gè)替代下采樣層(左下)和上采樣層(右下)的結(jié)構(gòu)。這兩種下采樣層將點(diǎn)云從 N 個(gè)點(diǎn)下采樣到 M 個(gè)點(diǎn),而上采樣層將其從 M 個(gè)點(diǎn)上采樣到 N 個(gè)點(diǎn)。

主要組成部分:

編碼層:提取點(diǎn)云特征。

采樣層:應(yīng)用提出的基于局部或全局的邊緣點(diǎn)采樣方法進(jìn)行下采樣。

解碼層:使用注意力機(jī)制進(jìn)行上采樣。

4 實(shí)驗(yàn)

4.1 分類網(wǎng)絡(luò)

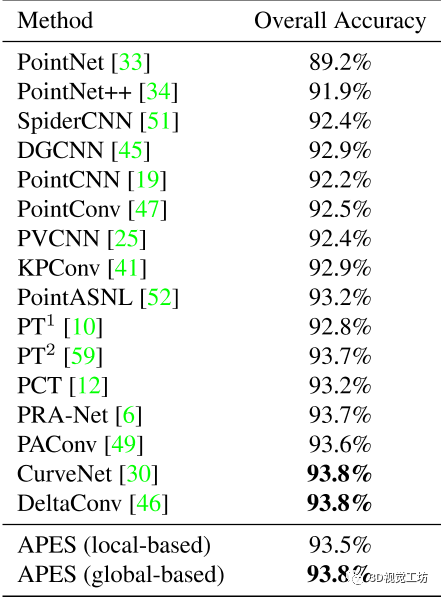

數(shù)據(jù)集:ModelNet40定量比較:分類精度與SOTA方法處于同水平

表1 ModelNet40 上的分類結(jié)果。與其他僅使用原始點(diǎn)云作為輸入的 SOTA 方法相比。請(qǐng)注意,我們報(bào)告的結(jié)果沒有考慮投票策略。

定性結(jié)果

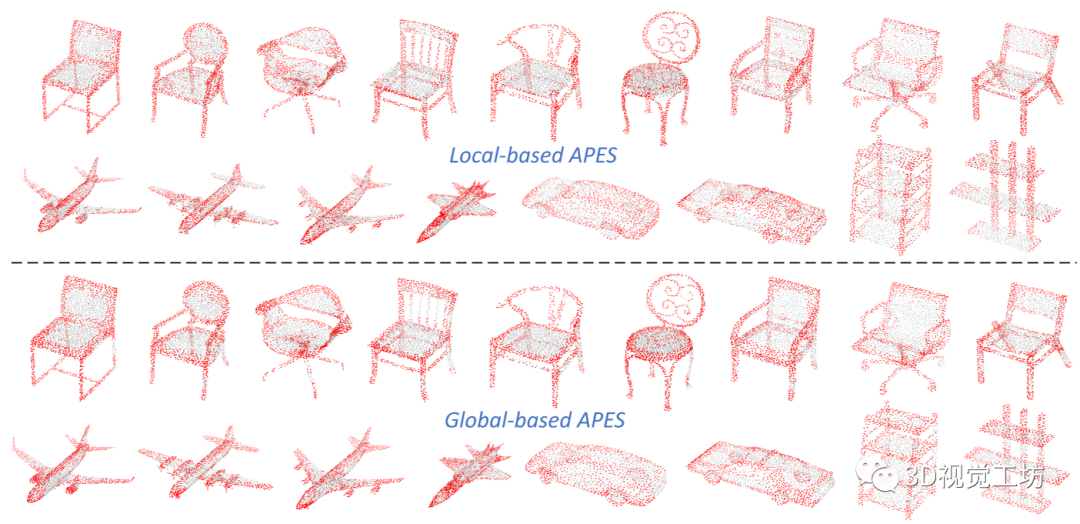

圖5 基于局部的APES和基于全局的APES在不同形狀上的可視化采樣結(jié)果。所有形狀都來自測(cè)試集。

4.2 分割網(wǎng)絡(luò)

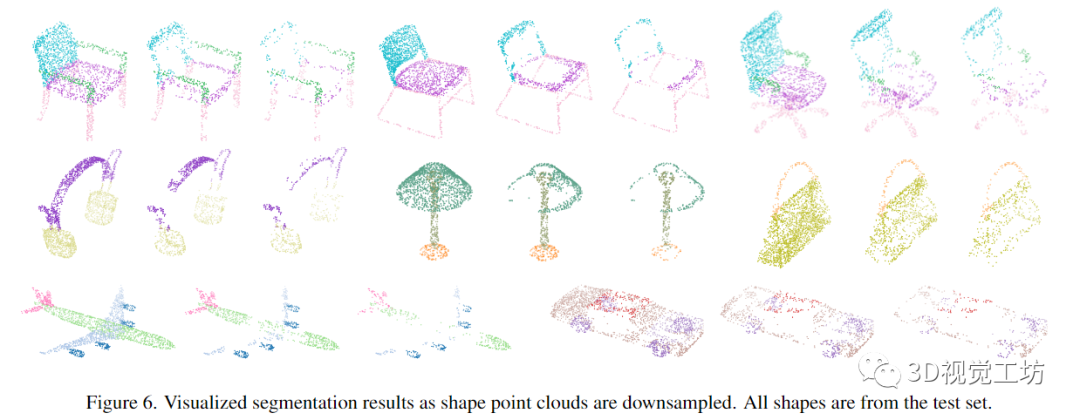

數(shù)據(jù)集:ShapeNetPart定量分析:分割精度略差于SOTA,但對(duì)下采樣點(diǎn)云的中間結(jié)果優(yōu)于SOTA,說明下采樣的邊緣點(diǎn)對(duì)于算法的性能貢獻(xiàn)較大,而由于邊緣下采樣改變了點(diǎn)云的分布,導(dǎo)致插值上采樣無法重構(gòu)。這里也推薦「3D視覺工坊」新課程三維點(diǎn)云處理:算法與實(shí)戰(zhàn)匯總定性結(jié)果

圖6 將可視化分割結(jié)果作為形狀點(diǎn)云進(jìn)行下采樣。所有形狀都來自測(cè)試集。

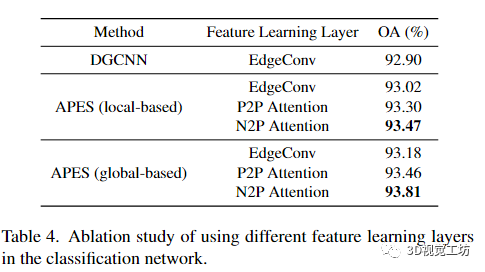

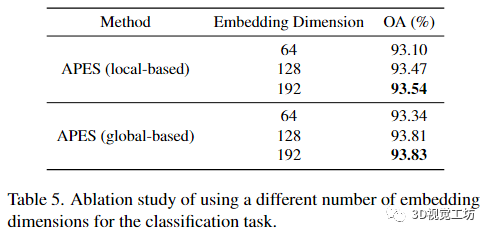

4.3 消融實(shí)驗(yàn)

數(shù)據(jù)集:ModelNet40Feature Learning Layer

Embedding Dimension

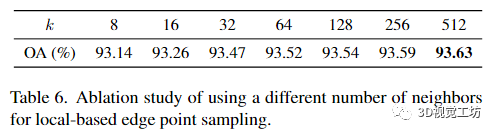

Choice of k in local-based APES

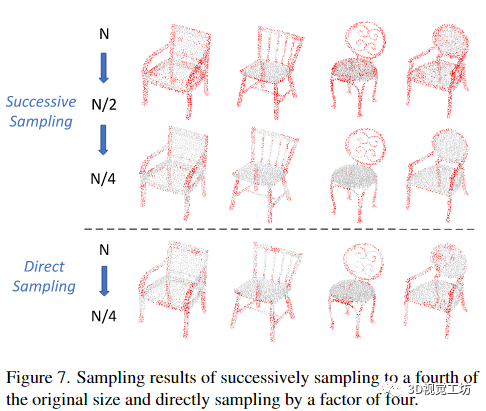

Successive sampling vs. Direct sampling

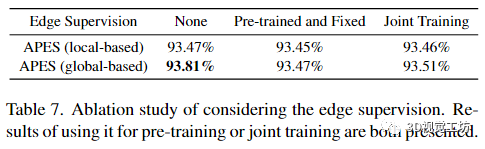

Additional edge point supervision

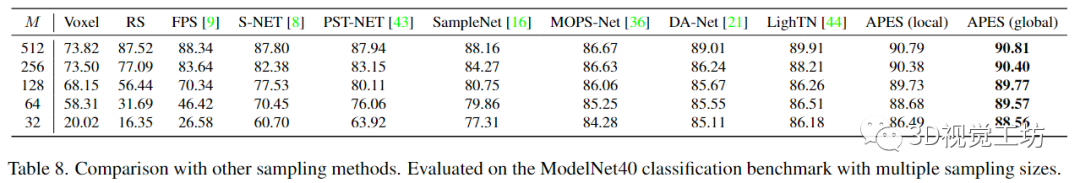

4.4 對(duì)比實(shí)驗(yàn)

數(shù)據(jù)集:ModelNet40定量分析:

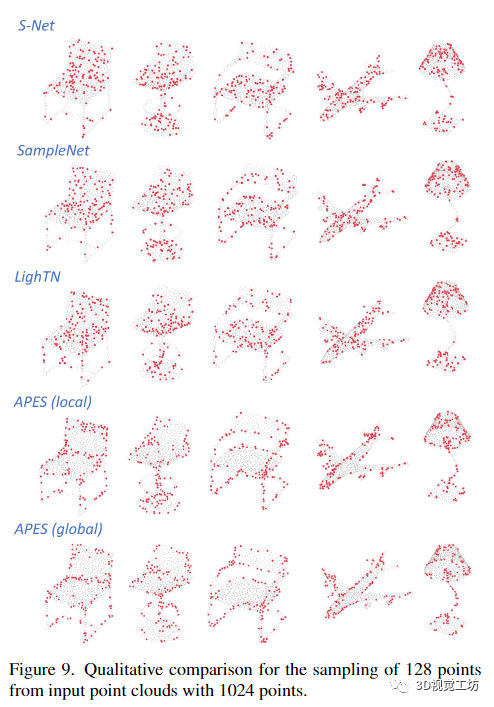

定性分析:

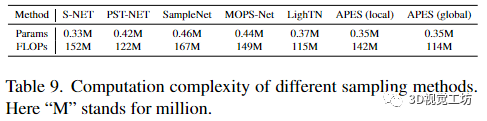

計(jì)算復(fù)雜度比較

5 總結(jié)

本文提出了一種基于注意力的點(diǎn)云邊緣采樣(APES)方法。它使用注意力機(jī)制相應(yīng)地計(jì)算相關(guān)圖并采樣邊緣點(diǎn)。基于不同的注意力模式,提出了基于局部 APES 和基于全局的 APES 的兩種變體。定性和定量結(jié)果表明,我們的方法在常見的點(diǎn)云基準(zhǔn)任務(wù)上取得了良好的性能。在未來的工作中,可以為訓(xùn)練設(shè)計(jì)其他補(bǔ)充損失。此外,我們注意到邊緣點(diǎn)采樣的不同點(diǎn)分布阻礙了后期上采樣操作和分割性能。設(shè)計(jì)能夠更好地應(yīng)對(duì)邊緣點(diǎn)采樣的上采樣方法會(huì)很有趣。

-

神經(jīng)網(wǎng)絡(luò)

+關(guān)注

關(guān)注

42文章

4779瀏覽量

101047 -

自動(dòng)駕駛

+關(guān)注

關(guān)注

784文章

13923瀏覽量

166821 -

深度學(xué)習(xí)

+關(guān)注

關(guān)注

73文章

5512瀏覽量

121410

原文標(biāo)題:CVPR2023 | 點(diǎn)云采樣方法新創(chuàng)新,深度學(xué)習(xí)與傳統(tǒng)的結(jié)合

文章出處:【微信號(hào):3D視覺工坊,微信公眾號(hào):3D視覺工坊】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

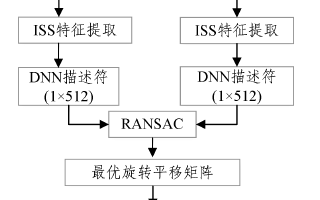

基于深度學(xué)習(xí)的三維點(diǎn)云配準(zhǔn)方法

校企雙進(jìn) | 機(jī)智云走進(jìn)華南農(nóng)業(yè)大學(xué)創(chuàng)新創(chuàng)業(yè)論壇

圖像分類的方法之深度學(xué)習(xí)與傳統(tǒng)機(jī)器學(xué)習(xí)

基于深度學(xué)習(xí)模型的點(diǎn)云目標(biāo)檢測(cè)及ROS實(shí)現(xiàn)

一種基于點(diǎn)云的Voxel(三維體素)特征的深度學(xué)習(xí)方法

基于深度學(xué)習(xí)的三維點(diǎn)云語義分割研究分析

基于深度學(xué)習(xí)的點(diǎn)云對(duì)齊算法3DMatch

針對(duì)復(fù)雜場(chǎng)景處理的點(diǎn)云深度學(xué)習(xí)網(wǎng)絡(luò)

結(jié)合基擴(kuò)展模型和深度學(xué)習(xí)的信道估計(jì)方法

深度學(xué)習(xí)和傳統(tǒng)計(jì)算機(jī)視覺技術(shù)在新興領(lǐng)域的比較

傳統(tǒng)CV和深度學(xué)習(xí)方法的比較

基于深度學(xué)習(xí)的點(diǎn)云分割的方法介紹

基于深度學(xué)習(xí)的3D點(diǎn)云實(shí)例分割方法

深度學(xué)習(xí)與傳統(tǒng)機(jī)器學(xué)習(xí)的對(duì)比

基于深度學(xué)習(xí)的三維點(diǎn)云分類方法

點(diǎn)云采樣方法新創(chuàng)新,深度學(xué)習(xí)與傳統(tǒng)的結(jié)合

點(diǎn)云采樣方法新創(chuàng)新,深度學(xué)習(xí)與傳統(tǒng)的結(jié)合

評(píng)論