目前 DETR 類(lèi)模型已經(jīng)成為了目標(biāo)檢測(cè)的一個(gè)主流范式。但 DETR 算法模型復(fù)雜度高,推理速度低,嚴(yán)重影響了高準(zhǔn)確度目標(biāo)檢測(cè)模型在端側(cè)設(shè)備的部署,加大了學(xué)術(shù)研究和產(chǎn)業(yè)應(yīng)用之間的鴻溝。

來(lái)自華為諾亞、華中科技大學(xué)的研究者們?cè)O(shè)計(jì)了一種新型的 DETR 輕量化模型 Focus-DETR 來(lái)解決這個(gè)難題。

為實(shí)現(xiàn)模型性能和計(jì)算資源消耗、顯存消耗、推理時(shí)延之間的平衡,F(xiàn)ocus-DETR 利用精細(xì)設(shè)計(jì)的前景特征選擇策略,實(shí)現(xiàn)了目標(biāo)檢測(cè)高相關(guān)特征的精確篩選;繼而,F(xiàn)ocus-DETR 進(jìn)一步提出了針對(duì)篩選后特征的注意力增強(qiáng)機(jī)制,來(lái)彌補(bǔ) Deformable attention 遠(yuǎn)距離信息交互的缺失。相比業(yè)界全輸入 SOTA 模型, AP 降低 0.5 以?xún)?nèi),計(jì)算量降低 45%,F(xiàn)PS 提高 41%,并在多個(gè) DETR-like 模型中進(jìn)行了適配。

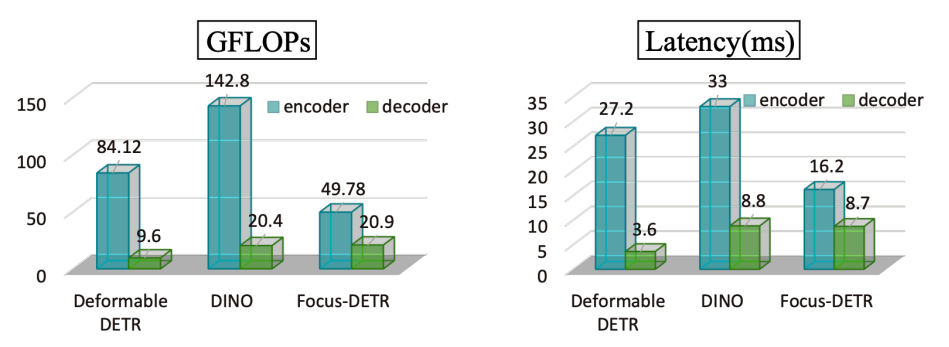

作者對(duì)多個(gè) DETR 類(lèi)檢測(cè)器的 GFLOPs 和時(shí)延進(jìn)行了對(duì)比分析,如圖 1 所示。從圖中發(fā)現(xiàn),在 Deformable-DETR 和 DINO 中,encoder 的計(jì)算量分別是 decoder 計(jì)算量的 8.8 倍和 7 倍。同時(shí),encoder 的時(shí)延大概是 decoder 時(shí)延的 4~8 倍。這表明,提升 encoder 的效率至關(guān)重要。

圖 1:多個(gè) DETR 類(lèi)檢測(cè)器的計(jì)算量和時(shí)延對(duì)比分析

網(wǎng)絡(luò)結(jié)構(gòu)

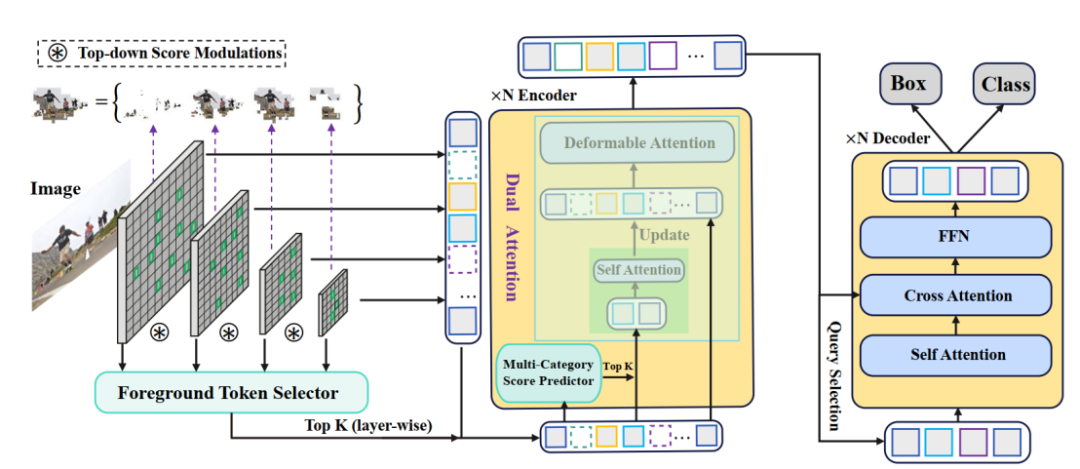

Focus-DETR 包括一個(gè) backbone,一個(gè)由 dual-attention 組成的 encoder 和一個(gè) decoder。前景選擇器(Foreground Token Selector)在 backbone 和 encoder 之間,是一個(gè)基于跨多尺度特征的自頂向下評(píng)分調(diào)制,用來(lái)確定一個(gè) token 是否屬于前景。Dual attention 模塊通過(guò)多類(lèi)別評(píng)分機(jī)制,選擇更細(xì)粒度的目標(biāo) token,然后將其輸入到一個(gè)自注意模塊來(lái)彌補(bǔ) token 交互信息的缺失。

圖 2 :Focus-DETR 整體網(wǎng)絡(luò)結(jié)構(gòu)

計(jì)算量降低:前景篩選策略

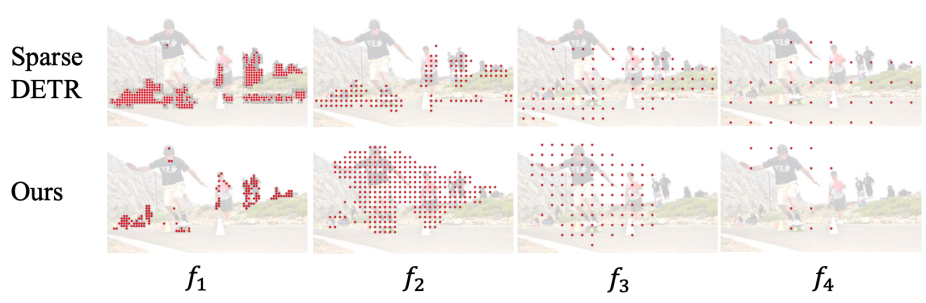

目前已經(jīng)有一些對(duì)于前景 token 進(jìn)行剪枝提升性能的方法。例如,Sparse DETR(ICLR2022)提出采用 decoder 的 DAM(decoder attention map)作為監(jiān)督信息。然而作者發(fā)現(xiàn),如圖 3 所示,Sparse DETR 篩選的 token 并不都是前景區(qū)域。作者認(rèn)為,這是由于 Sparse DETR 使用 DAM 來(lái)監(jiān)督前景 token 導(dǎo)致的,DAM 會(huì)在訓(xùn)練的時(shí)候引入誤差。而 Focus-DETR 使用 ground truth(boxes 和 label)來(lái)監(jiān)督前景的 token 的篩選。

圖 3:Focus-DETR 和 Sparse DETR 在不同 feature map 上保留的 token 對(duì)比

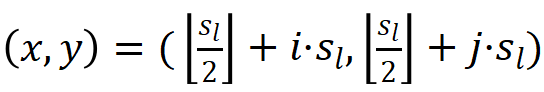

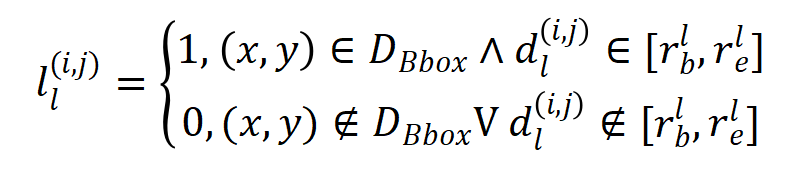

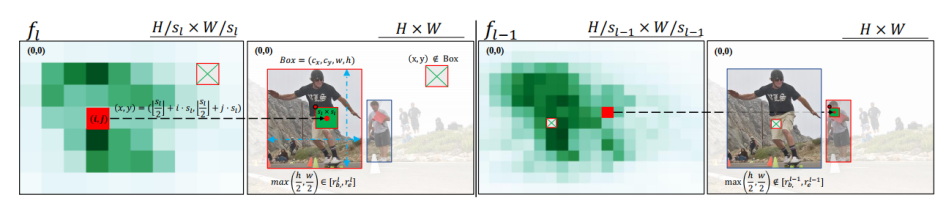

為了更好地訓(xùn)練前景篩選器,作者優(yōu)化了 FCOS 的前背景標(biāo)簽分配策略,如圖 4 所示。作者首先為不同特征映射的包圍框設(shè)置了一個(gè)大小范圍。與傳統(tǒng)的多尺度特征標(biāo)簽分配方法不同,它允許相鄰兩個(gè)特征尺度之間的范圍重疊,以增強(qiáng)邊界附近的預(yù)測(cè)能力。

對(duì)每個(gè)擁有步長(zhǎng) ?的特征?

?的特征? ,其中

,其中 代表多尺度特征的層級(jí)序號(hào),

代表多尺度特征的層級(jí)序號(hào), 代表在二維特征圖上的位置坐標(biāo),作者定義該特征在原圖上的映射位置為?

代表在二維特征圖上的位置坐標(biāo),作者定義該特征在原圖上的映射位置為? ,那么?

,那么? ,因此?

,因此? 特征所對(duì)應(yīng)的標(biāo)簽應(yīng)該為: ?

特征所對(duì)應(yīng)的標(biāo)簽應(yīng)該為: ?

其中 代表坐標(biāo)和真值框中心之間的最大棋盤(pán)距離,

代表坐標(biāo)和真值框中心之間的最大棋盤(pán)距離, 代表真值目標(biāo)框,

代表真值目標(biāo)框, 分別代表被第

分別代表被第 層特征圖預(yù)測(cè)的目標(biāo)的尺度的最大值和最小值,由于尺度重疊設(shè)置,

層特征圖預(yù)測(cè)的目標(biāo)的尺度的最大值和最小值,由于尺度重疊設(shè)置, 。 ?

。 ?

圖 4. 前背景標(biāo)簽分配可視化

此外,來(lái)自不同特征映射的特征選擇的差異也被忽略,這限制了從最合適的分辨率選擇特征的潛力。

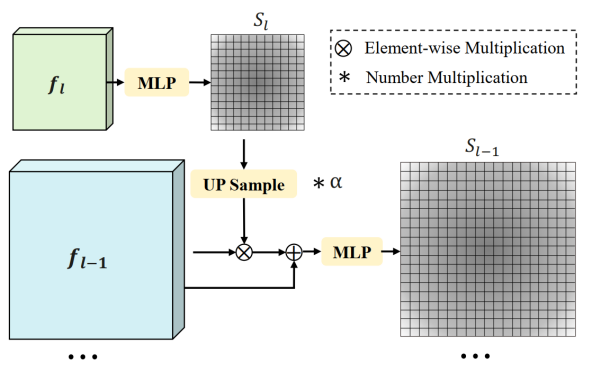

為彌補(bǔ)這一差距,F(xiàn)ocus-DETR 構(gòu)造了基于多尺度 feature map 的自頂向下的評(píng)分調(diào)制模塊,如圖 5 所示。

為了充分利用多尺度特征圖之間的語(yǔ)義關(guān)聯(lián),作者首先使用多層感知器 (MLP) 模塊來(lái)預(yù)測(cè)每個(gè)特征圖中的多類(lèi)別語(yǔ)義得分。

考慮到高層語(yǔ)義特征,低層語(yǔ)義特征包含更豐富的語(yǔ)義信息,作者利用高層 feature map 的 token 重要性得分,作為補(bǔ)充信息來(lái)調(diào)制低層 feature map 的預(yù)測(cè)結(jié)果。

圖 5:top-down 前景篩選評(píng)分調(diào)制策略

細(xì)粒度特征增強(qiáng)策略

在依靠前期設(shè)計(jì)的前景篩選器得到較為準(zhǔn)確的前景特征后,F(xiàn)ocus-DETR 使用一種有效的操作來(lái)獲得更為細(xì)粒度的特征,利用這些細(xì)粒度特征以獲得更好的檢測(cè)性能。直觀(guān)地說(shuō),作者假設(shè)在這個(gè)場(chǎng)景中引入更細(xì)粒度的類(lèi)別信息將是有益的。基于這一動(dòng)機(jī),作者提出了一種新的注意力機(jī)制,并結(jié)合前景特征選擇,以更好地結(jié)合利用細(xì)粒度特征和前景特征。

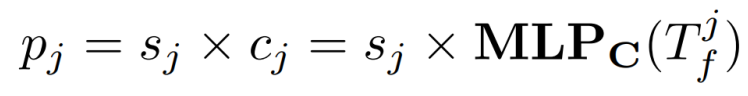

如圖 2 所示,為了避免對(duì)背景 token 進(jìn)行冗余的計(jì)算,作者采用了一種同時(shí)考慮位置信息和類(lèi)別語(yǔ)義信息的堆疊策略。具體來(lái)說(shuō),預(yù)測(cè)器 ?(?) 計(jì)算出的前景評(píng)分

?(?) 計(jì)算出的前景評(píng)分 和類(lèi)別評(píng)分

和類(lèi)別評(píng)分 的乘積將作為作者最終的標(biāo)準(zhǔn)

的乘積將作為作者最終的標(biāo)準(zhǔn) 來(lái)確定注意力計(jì)算中涉及的細(xì)粒度特征,即:

來(lái)確定注意力計(jì)算中涉及的細(xì)粒度特征,即:

?

?

其中 和

和 分別代表前景得分和類(lèi)別概率。 ?

分別代表前景得分和類(lèi)別概率。 ?

與兩階段 Deformable DETR 的 query 選擇策略不同,F(xiàn)ocus-DETR 的多類(lèi)別概率不包括背景類(lèi)別 (?)。該模塊可以被視為一個(gè) self-attention ,對(duì)細(xì)粒度特征進(jìn)行增強(qiáng)計(jì)算。然后,已增強(qiáng)的特征將被 scatter 回原始的前景特征并對(duì)其進(jìn)行更新。

實(shí)驗(yàn)結(jié)果

主要結(jié)果

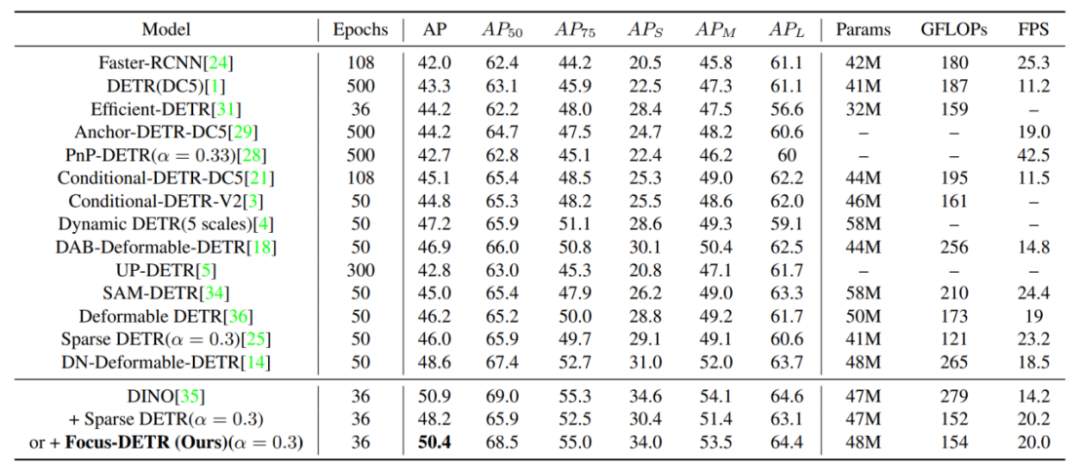

如表一所示,作者將 Focus-DETR 在 COCO 驗(yàn)證集上和其他模型的性能進(jìn)行比較。可以發(fā)現(xiàn)同樣基于 DINO,F(xiàn)ocus-DETR 僅使用 30% token 的情況下,超過(guò) Sparse DETR 2.2 個(gè) AP。相比原始 DINO,僅損失 0.5 個(gè) AP,但是計(jì)算量降低 45%,推理速度提升 40.8%。

表 1:總體對(duì)比實(shí)驗(yàn)結(jié)果

模型效能分析

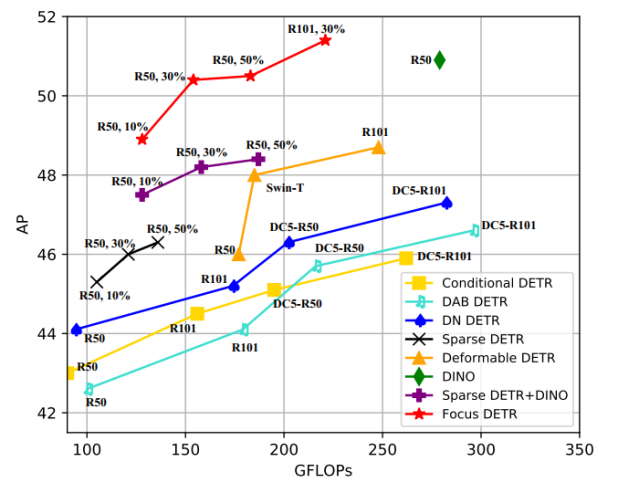

在圖 6 中,從不同模型的精度和計(jì)算量之間的關(guān)系來(lái)看,F(xiàn)ocus-DETR 在精度和計(jì)算復(fù)雜度之間達(dá)到了最好的平衡。整體來(lái)看對(duì)比其他模型,獲得了 SOTA 的性能。

圖 6 不同模型測(cè)試精度和計(jì)算復(fù)雜度之間的關(guān)聯(lián)分析

消融實(shí)驗(yàn)

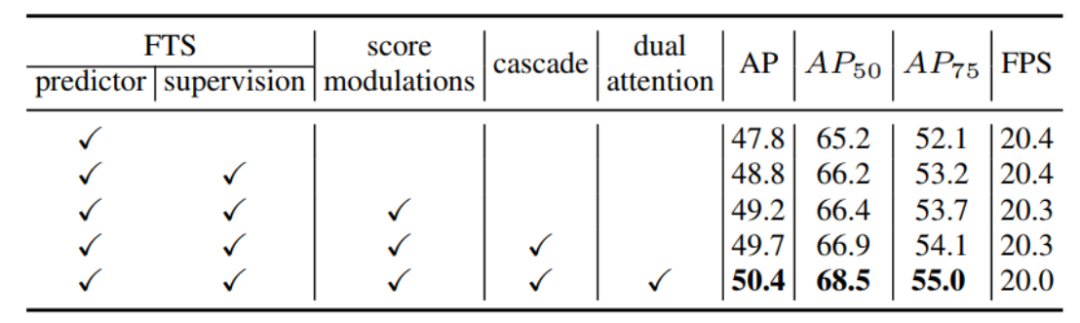

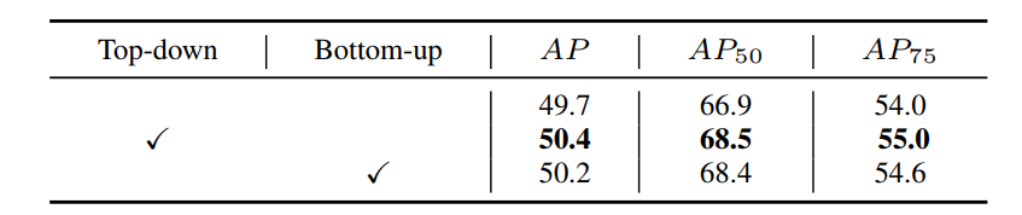

如表 2 所示,作者針對(duì)模型設(shè)計(jì)進(jìn)行消融實(shí)驗(yàn),以驗(yàn)證作者提出的算法的有效性。

?

?

表 2 本研究提出的前景特征剪枝策略和細(xì)粒度特征自注意力增強(qiáng)模塊對(duì)實(shí)驗(yàn)性能的影響

1. 前景特征選擇策略的影響

直接使用前景得分預(yù)測(cè) AP 為 47.8,增加 label assignment 策略生成的標(biāo)簽作為監(jiān)督,AP 提升 1.0。增加自上而下的調(diào)制策略,能夠提升多尺度特征圖之間的交互,AP 提升 0.4。這表明提出的策略對(duì)于提升精度是非常有效的。

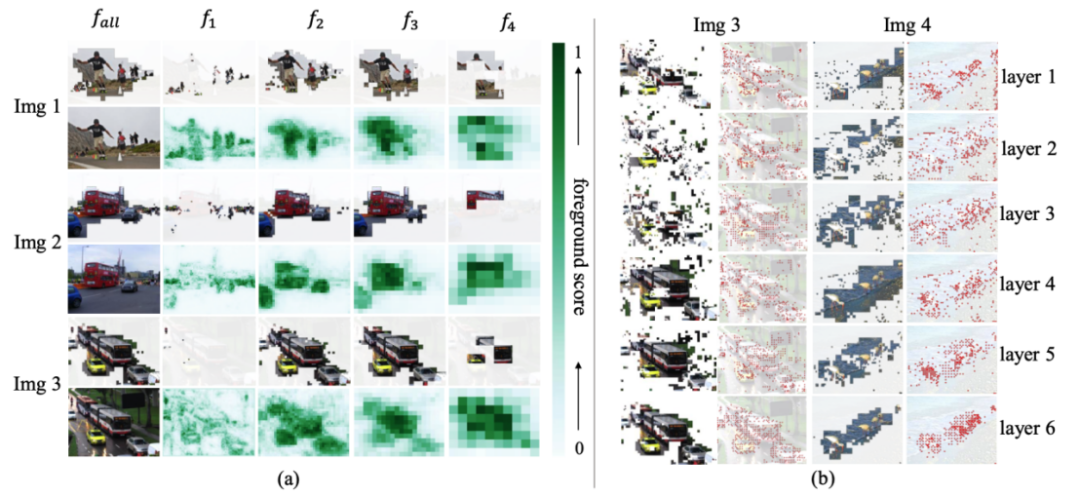

如圖 7 可視化可以發(fā)現(xiàn),F(xiàn)ocus-DETR 可以精確地選擇多尺度特征上的前景 token。并且可以發(fā)現(xiàn),在不同尺度的特征度之間,可以檢測(cè)的物體存在重疊,這正是因?yàn)?Focus-DETR 使用了交疊的設(shè)置導(dǎo)致的。

圖 7 多尺度特征保留的 token

2. 自上而下的評(píng)分調(diào)制策略的影響

表 3. 多尺度特征圖前景評(píng)分的關(guān)聯(lián)方法,作者嘗試自頂向下和自底向上的調(diào)制。

作者對(duì)比了自上而下的調(diào)制策略和自下而上的調(diào)制策略的影響,對(duì)比結(jié)果可以發(fā)現(xiàn),作者提出的自上而下的調(diào)制策略可以獲得更好的性能。

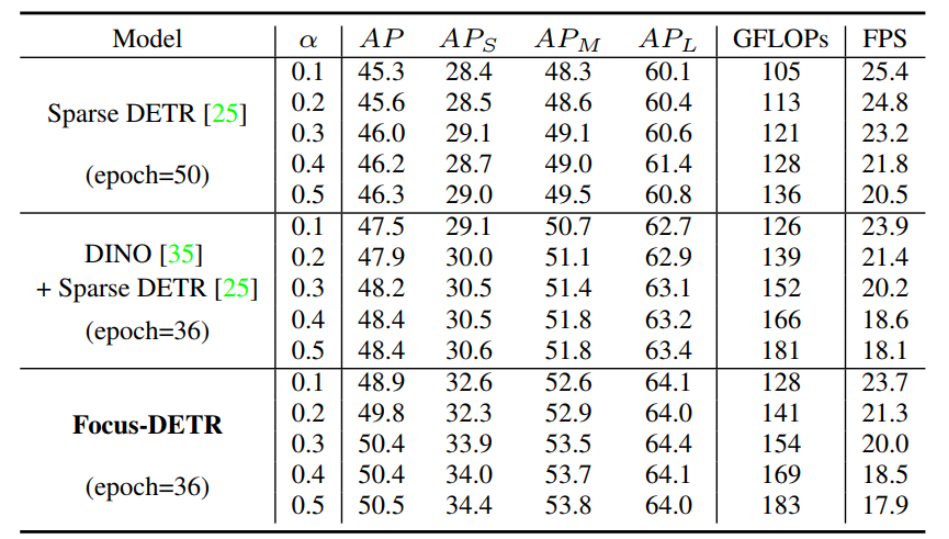

3. 前景保留比率對(duì)實(shí)驗(yàn)性能的影響

表 4.Focus-DETR、Sparse DETR 和 DINO+Sparse DETR 保留前景 token 的比例

作者對(duì)比了不同的剪枝比例的性能,從實(shí)驗(yàn)結(jié)果可以發(fā)現(xiàn),F(xiàn)ocus-DETR 在相同的剪枝比例情況下,均獲得了更優(yōu)的結(jié)果。

總結(jié)

Focus-DETR 僅利用 30% 的前景 token 便實(shí)現(xiàn)了近似的性能,在計(jì)算效率和模型精度之間取得了更好的權(quán)衡。Focus-DETR 的核心組件是一種基于多層次的語(yǔ)義特征的前景 token 選擇器,同時(shí)考慮了位置和語(yǔ)義信息。Focus-DETR 通過(guò)精確地選擇前景和細(xì)粒度特征,并且對(duì)細(xì)粒度特征進(jìn)行語(yǔ)義增強(qiáng),使得模型復(fù)雜度和精度實(shí)現(xiàn)更好平衡。

審核編輯:劉清

-

檢測(cè)器

+關(guān)注

關(guān)注

1文章

869瀏覽量

47760 -

FPS

+關(guān)注

關(guān)注

0文章

35瀏覽量

12024 -

DAM

+關(guān)注

關(guān)注

0文章

8瀏覽量

9529 -

MLP

+關(guān)注

關(guān)注

0文章

57瀏覽量

4262

原文標(biāo)題:華為 | Focus-DETR:30%Token就能實(shí)現(xiàn)SOTA性能,效率倍增

文章出處:【微信號(hào):zenRRan,微信公眾號(hào):深度學(xué)習(xí)自然語(yǔ)言處理】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

旋變位置不變的情況下,當(dāng)使能SOTA功能與關(guān)閉SOTA功能時(shí),APP中DSADC采樣得到的旋變sin和cos兩者值不一樣,為什么?

NB81是否支持OneNet SOTA功能?應(yīng)該如何激活SOTA?

SOTA的定義是什么?常規(guī)的實(shí)現(xiàn)方式有哪些

Json Web Token是什么?有哪些應(yīng)用呢

SOTA機(jī)制詳解

RT-DETR用114FPS實(shí)現(xiàn)54.8AP遠(yuǎn)超YOLOv8

通過(guò)A2B更新軟件—A2B如何給汽車(chē)應(yīng)用中的SOTA帶來(lái)變革

一種新型的DETR輕量化模型Focus-DETR

華為諾亞提出全新目標(biāo)檢測(cè)器Focus-DETR

人工智能SOTA什么意思

DETR架構(gòu)的內(nèi)部工作方式分析

基于OpenVINO Python API部署RT-DETR模型

基于OpenVINO C++ API部署RT-DETR模型

基于OpenVINO C# API部署RT-DETR模型

MS-DETR和其他SOTA方法的對(duì)比

Focus-DETR:30%Token就能實(shí)現(xiàn)SOTA性能,效率倍增

Focus-DETR:30%Token就能實(shí)現(xiàn)SOTA性能,效率倍增

評(píng)論