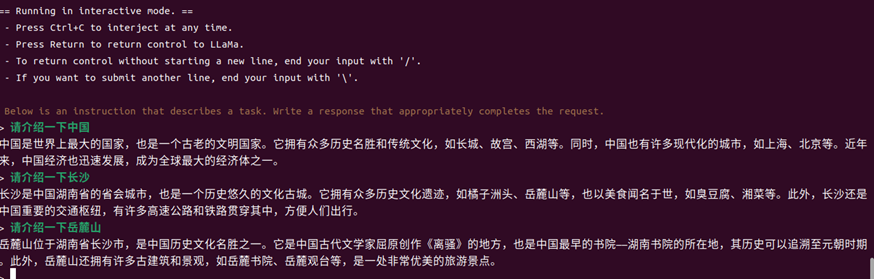

在我寫本文時(shí),剛好是WAIC 2023舉行的時(shí)候,感覺無(wú)處不是大模型。所以,RISC-V怎么能不刷刷大模型呢?廢話不多說(shuō),先上圖:

去年,ChatGPT的出現(xiàn)震驚了全世界,在短短幾個(gè)月的時(shí)間內(nèi),ChatGPT的月活躍用戶達(dá)到了1億。ChatGPT的成功讓許多人第一次知道了大語(yǔ)言模型(Large Language Model)的概念,而今年Meta發(fā)布的LLaMA則在ChatGPT的基礎(chǔ)上又往前跨了一大步,它大大降低了LLM的使用難度,讓LLM真正“走進(jìn)基層”。那LLaMA是什么呢?

1. LLaMA介紹

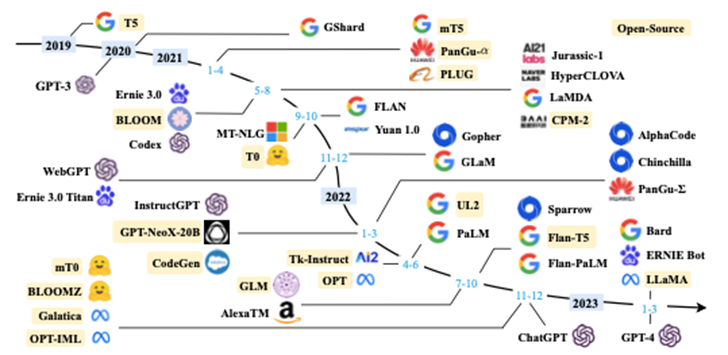

在介紹LLaMA之前,首先要介紹一下LLM(Large Language Model)。我們可以將LLM看成一位知識(shí)淵博的老師,在經(jīng)過(guò)大量的知識(shí)學(xué)習(xí)(大量文本數(shù)據(jù)的訓(xùn)練)后,LLM會(huì)基于它的知識(shí)庫(kù),給出問(wèn)題的最佳答案,我們可以使用LLM來(lái)完成文本總結(jié)、翻譯、情感分析等工作。最近幾年,是LLM的高速發(fā)展期,很多科技巨頭都在LLM投入大量的資金。下面是這幾年LLM的成果圖:

近年來(lái)現(xiàn)有大型語(yǔ)言模型(大小大于10B)的時(shí)間表

近年來(lái)現(xiàn)有大型語(yǔ)言模型(大小大于10B)的時(shí)間表但對(duì)于個(gè)人研究者而言,LLM的使用是有一定的門檻,一般的LLM模型對(duì)硬件的要求比較高,而一些開發(fā)公司出于商業(yè)的目的,并不打算將項(xiàng)目的源碼進(jìn)行開源,這都限制了個(gè)人研究者從更深的層次去了解LLM,在一定程度上這影響了LLM的發(fā)展(Android能有今天地位,離不開開源和方便使用,這為它后來(lái)的迅速發(fā)展打下了良好的基礎(chǔ))。好在今年Meta發(fā)布的LLaMA(Language Learning through Multimodal Autoregressive Models)給了對(duì)LLM感興趣的開發(fā)者另一個(gè)選項(xiàng),相較于其他的LLM模型而言,LLaMA優(yōu)勢(shì)在于它足夠親民且開源。

從親民的角度來(lái)說(shuō),LLaMA的規(guī)模僅為ChatGPT的“十分之一”,但性能卻優(yōu)于OpenAI的GPT-3模型,而且LLaMA只是一個(gè)基礎(chǔ)模型,它完全可以使用公開的數(shù)據(jù)模型進(jìn)行訓(xùn)練,這都使得LLaMA的使用門檻被大大降低;從開源的角度來(lái)說(shuō),LLaMA可以說(shuō)是被迫開源,因?yàn)榧夹g(shù)方面的問(wèn)題,Meta暫緩了開源過(guò)程,但在發(fā)布后的不久,LLaMA的模型文件就被泄露了,那么,問(wèn)題來(lái)了,這究竟是故意的還是不小心的呢?

2. llama.cpp

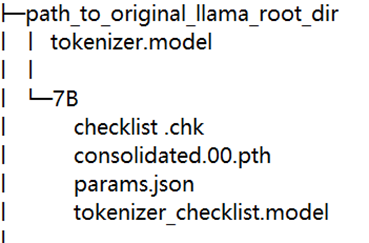

llama.cpp是由保加利亞索非亞的Georgi Gerganov基于LLaMA模型開發(fā)的純C版本。Georgi Gerganov是一位資深的開源社區(qū)開發(fā)者,曾經(jīng)還為OpenAI的自動(dòng)語(yǔ)音識(shí)別模型開發(fā)了whisper.cpp。llama.cpp可以讓使用者在沒有GPU的情況下也能運(yùn)行LLaMA模型。所以它一經(jīng)發(fā)布,就吸引了大量對(duì)LLaMA感興趣的人下載使用,很快就有人找到了在Windows上運(yùn)行LLaMA的方法,之后又實(shí)現(xiàn)了在手機(jī)上的運(yùn)行。llama.cpp大大降低了LLaMA的使用門檻,通過(guò)llama.cpp,LLaMA展現(xiàn)了它無(wú)與倫比的語(yǔ)言學(xué)習(xí)能力,為我們打開了一座探索語(yǔ)言世界的新大門。

值得一提的是,Georgi Gerganov在公布llama.cpp后的幾個(gè)月就自主創(chuàng)業(yè),成立了ggml.ai公司,這個(gè)公司的合伙人有GitHub前CEO Nat Friedman和Y-Combinator的Daniel Gross。ggml.ai的成立也引起了許多業(yè)內(nèi)大佬的注意,或許它之后會(huì)為AI的發(fā)展帶來(lái)一些不一樣的東西。

3. 硬件平臺(tái)簡(jiǎn)介

3.1 RISC-V簡(jiǎn)介

澎峰科技聯(lián)合創(chuàng)始人王軍輝說(shuō)“2023年是RISC-V高性能計(jì)算元年”。因?yàn)?023年算能推出了全球第一顆已量產(chǎn)的RISC-V服務(wù)器級(jí)64核CPU,這意味RISC-V進(jìn)入高性能計(jì)算領(lǐng)域的未來(lái)已經(jīng)不遠(yuǎn)了。那么,RISC-V到底是什么?

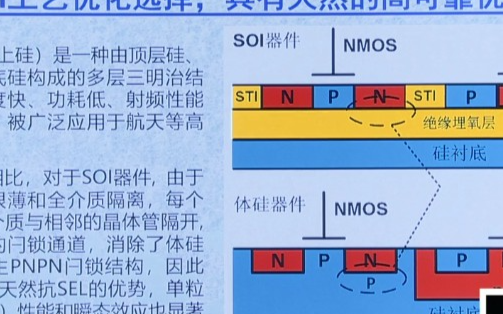

簡(jiǎn)單來(lái)說(shuō),RISC-V和我們熟悉的X86、ARM一樣,都是指令集架構(gòu),但X86屬于復(fù)雜指令集(CSIC),RISC-V和ARM屬于精簡(jiǎn)指令集(RISC)。雖然CISC指令豐富功能強(qiáng)大,但隨著CISC的逐步發(fā)展,過(guò)于復(fù)雜的指令不僅會(huì)導(dǎo)致指令使用率不均衡(效率低),也加大了超大規(guī)模集成電路實(shí)現(xiàn)的難度。相對(duì)的,RISC的優(yōu)勢(shì)在于指令簡(jiǎn)單,使用率均衡,執(zhí)行效率高。同時(shí),通常基于RISC的芯片易于實(shí)現(xiàn)電路設(shè)計(jì)和大規(guī)模集成。

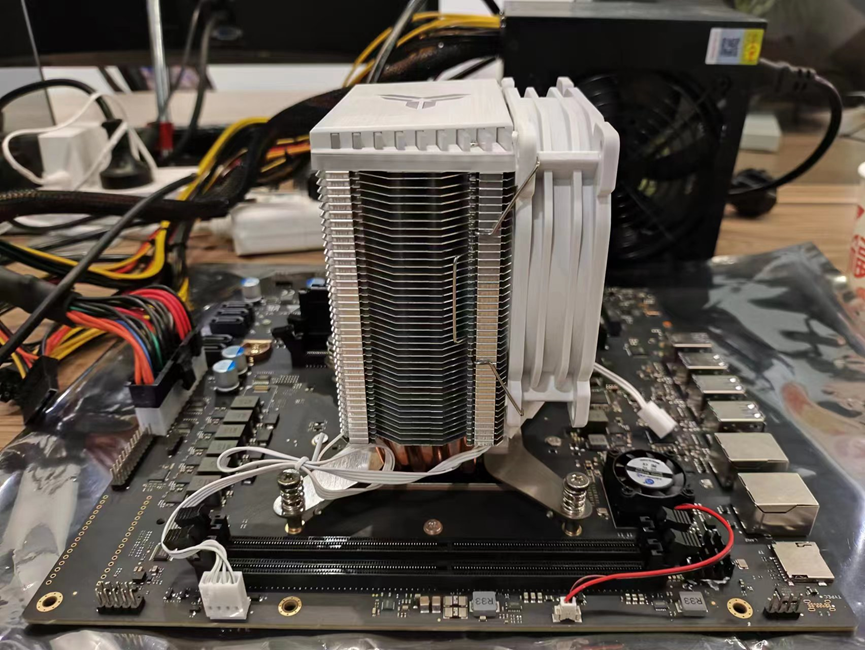

正如文章開篇所展示的,我在基于SG2042的RISC-V平臺(tái)上完成了LLaMA的移植。LLM和RISC-V都是近兩年比較熱門的東西,同時(shí)又有很大的空白供開發(fā)者們探索和建設(shè),所以我覺得把兩者結(jié)合這是一件很有意思也很有意義的事情。下面簡(jiǎn)單介紹一下我使用的開發(fā)平臺(tái)。

3.2 平臺(tái)

RISC-V服務(wù)器主板(搭載全球第一顆量產(chǎn)的服務(wù)器級(jí)64核RISC-V芯片SG2042)

3.3 基本配置

| 硬件平臺(tái)配置 | |

| CPU | SG2042(64 Core@2.0GHz) |

| DDR | 32GB 3200MHz |

| Local Storage | 1T M.2 NVMe SSD |

| 操作系統(tǒng)配置 | |

| OS | Ubuntu |

| Kernel | Linux 5.19.17 |

4. 結(jié)束語(yǔ)

本系列文章估計(jì)會(huì)分為四期:

第一期:RISC -V跑大模型(引言)。

第三期:軟件優(yōu)化進(jìn)行LLaMA加速

第四期:更多性能優(yōu)化策略。

-

RISC-V

+關(guān)注

關(guān)注

45文章

2322瀏覽量

46396 -

RISC-V處理器

+關(guān)注

關(guān)注

0文章

80瀏覽量

10062 -

ChatGPT

+關(guān)注

關(guān)注

29文章

1566瀏覽量

7946 -

大模型

+關(guān)注

關(guān)注

2文章

2541瀏覽量

3024 -

LLM

+關(guān)注

關(guān)注

0文章

298瀏覽量

366

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

RISC-V 跑大模型(三):LLaMA中文擴(kuò)展

如何設(shè)計(jì)一個(gè)好的RISC-V

全志V853常用模型跑分?jǐn)?shù)據(jù)

有RISC-V跑uCLinux或者NO MMU的Linux的項(xiàng)目嗎?

RISC-V規(guī)范的演進(jìn) RISC-V何時(shí)爆發(fā)?

RISC-V設(shè)計(jì)支持工具,支持RISC-V技術(shù)的基礎(chǔ)

解鎖RISC-V技術(shù)力量丨曹英杰:RISC-V與大模型探索

RISC-V Summit China 2024 青稞RISC-V+接口PHY,賦能RISC-V高效落地

加入全球 RISC-V Advocate 行列,共筑 RISC-V 的未來(lái) !

RISC -V跑大模型(一)

RISC -V跑大模型(一)

評(píng)論