摘要:近年來自動(dòng)駕駛場(chǎng)景中的預(yù)測(cè)任務(wù)逐漸興起一種新形式,即預(yù)測(cè)未來基于鳥瞰圖的空間占有柵格(occupancy)和光流(flow)。此類預(yù)測(cè)任務(wù)與傳統(tǒng)預(yù)測(cè)軌跡的任務(wù)相比在很多場(chǎng)景下會(huì)提供更多的信息,作為自動(dòng)駕駛上下游的一環(huán),有著更廣泛的應(yīng)用場(chǎng)景。在今年的Waymo Open Dataset Challenge 2022上,Waymo推出了此任務(wù)的全新挑戰(zhàn)賽。地平線在這個(gè)項(xiàng)目上研發(fā)出了一種全新的利用時(shí)空信息進(jìn)行編碼解碼的層級(jí)網(wǎng)絡(luò),通過多重編碼網(wǎng)絡(luò),多尺度時(shí)空融合,預(yù)測(cè)隱變量以及聯(lián)合柵格占有和光流的損失函數(shù)等創(chuàng)新性技術(shù),將這一任務(wù)的精度推上新的高度。

背景

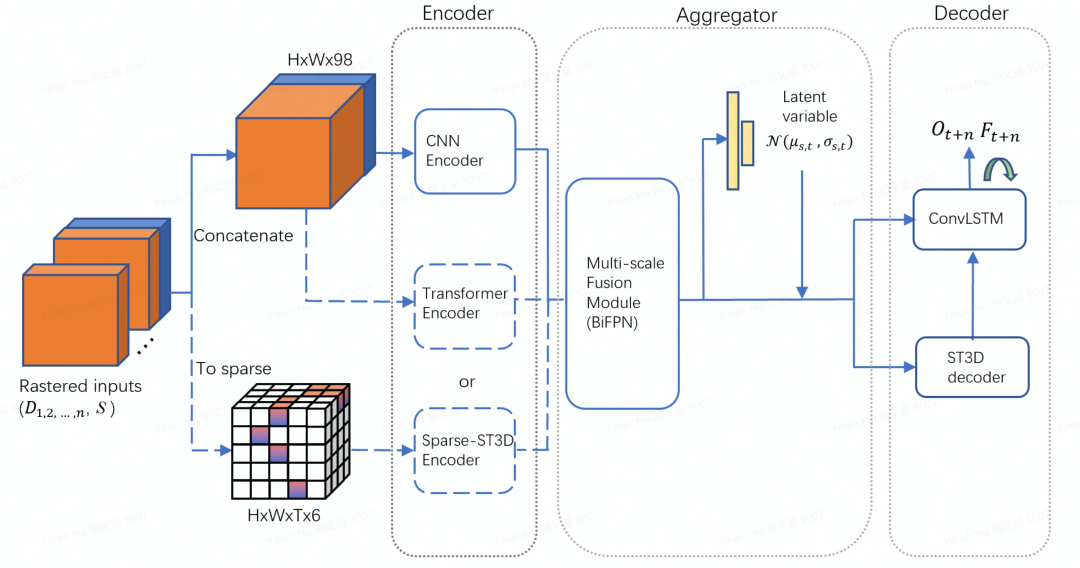

預(yù)測(cè)任務(wù)是自動(dòng)駕駛場(chǎng)景中至關(guān)重要的一項(xiàng)任務(wù),其目的是通過對(duì)運(yùn)動(dòng)物體的歷史軌跡和運(yùn)動(dòng)狀態(tài)的觀測(cè),結(jié)合道路信息,推測(cè)其未來的行為,為下游的規(guī)劃控制提供更豐富的預(yù)測(cè)信息。其表征形式通常為多條未來可能的軌跡。近年來,越來越多的研究表明,基于鳥瞰圖的空間占有柵格和光流的表征形式相比多條軌跡預(yù)測(cè)有更強(qiáng)的表征能力。相比于軌跡的形式,占有柵格有更豐富的空間分布信息,能更好的表征動(dòng)態(tài)物體的位置,形狀,身份的不確定性;其聯(lián)合概率分布的形式在一定程度上可以處理物體之間的交互的能力;同時(shí),所有的動(dòng)態(tài)物體可以同時(shí)并行處理,極大地提升了處理的效率;另外,此種方法還具有推測(cè)被遮擋物體的能力,能有效預(yù)防諸如“鬼探頭”等的情況;最后,其鳥瞰圖下的表征形式能更好地與上下游相結(jié)合。基于這個(gè)趨勢(shì),Waymo于今年推出了全新的自動(dòng)駕駛挑戰(zhàn)賽項(xiàng)目,即Occupancy and Flow Prediction Challenge。此挑戰(zhàn)賽給定過去一秒中動(dòng)態(tài)物體(車輛,自行車和行人)的運(yùn)動(dòng)軌跡,要求對(duì)未來八秒的可觀測(cè)物體的柵格占有、遮擋物體的柵格占有以及對(duì)應(yīng)光流做預(yù)測(cè)。本方法結(jié)合了CNN、transformer、三維稀疏卷積等優(yōu)勢(shì),利用隱變量豐富了未來的信息,創(chuàng)新性地引入了層級(jí)時(shí)序解碼機(jī)制,在此次Waymo挑戰(zhàn)賽中取得了極佳的成績(jī)。

方法

輸入

模型的輸入包含了動(dòng)態(tài)信息和靜態(tài)信息。其中動(dòng)態(tài)信息包含了歷史幀和當(dāng)前幀的動(dòng)態(tài)物體(車輛,自行車和行人)的空間占有柵格信息以及對(duì)應(yīng)物體的屬性信息(比如物體檢測(cè)框的長(zhǎng)寬高和速度等信息),靜態(tài)信息包含了整個(gè)場(chǎng)景的路面相關(guān)信息(比如道路中線,道路邊緣,路面其他特征等)。所有信息都被處理成二維鳥瞰圖并進(jìn)一步進(jìn)行時(shí)間尺度上的聚合。我們同時(shí)使用了2D編碼器和3D編碼器,其中針對(duì)2D編碼器,動(dòng)態(tài)信息輸入會(huì)直接在特征維上進(jìn)行時(shí)間拼接;而針對(duì)3D編碼器,時(shí)間會(huì)作為額外的維度(靜態(tài)信息在每一幀上進(jìn)行復(fù)制),并且輸入會(huì)作稀疏化處理。

編碼器

編碼器一共分為三種,分別是基本編碼器,注意力編碼器以及時(shí)空編碼器

基本編碼器:作為整個(gè)框架的基本編碼器,我們選擇使用了RegNet[1]模型。RegNet是一個(gè)設(shè)計(jì)完備且效率很高的模型。編碼器經(jīng)過層層降采樣編碼,生成了5個(gè)維度上的特征,對(duì)應(yīng)的尺度分別是輸入的1/2,1/4,1/8,1/16和1/32。

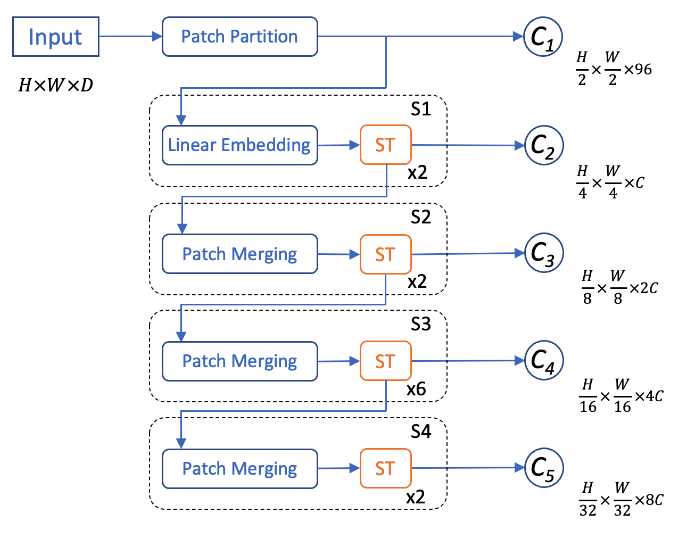

注意力編碼器:近年來,在檢測(cè)和分割任務(wù)中,SwinTransformer及其升級(jí)版SwinTransformerV2[2]取得了很好的結(jié)果。基于其獨(dú)特的局部窗口注意力機(jī)制,不僅能很好地編碼動(dòng)態(tài)物體和路面間的交互,還大量地減少了網(wǎng)絡(luò)計(jì)算量,因此我們使用了SwinTransformerV2來作為整個(gè)網(wǎng)絡(luò)的注意力編碼器。為了可以和基本編碼器輸出特征的尺度相對(duì)應(yīng),我們將每個(gè)patch的尺寸由4改成了2,由此注意力編碼器可以輸出和基本編碼器尺度相同的5個(gè)特征。

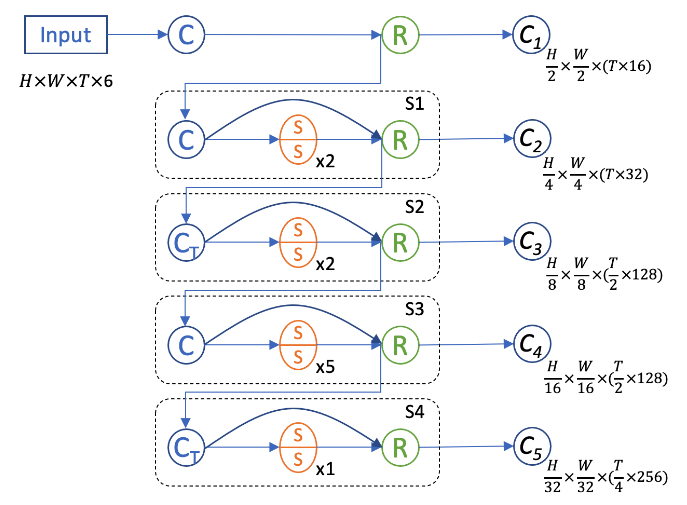

時(shí)空編碼器:為了更好地進(jìn)行幀間信息交互提取,我們?cè)O(shè)計(jì)了一個(gè)3D時(shí)空編碼器來額外捕捉時(shí)間尺度上的信息。因?yàn)槲覀兊妮斎胄畔⒃邙B瞰圖上有著很高的稀疏度,我們選擇使用3D稀疏卷積和子流形稀疏卷積[3]來搭建網(wǎng)絡(luò)。這樣既可以大量地加速3D卷積的計(jì)算也可以有效防止稀疏特征在早期過快地膨脹(dilation)。我們對(duì)應(yīng)其他編碼器,設(shè)計(jì)了5階段網(wǎng)絡(luò),其中時(shí)間維在2和4階段進(jìn)行下采樣。針對(duì)網(wǎng)絡(luò)的每個(gè)輸出特征,我們將時(shí)間維和特征維進(jìn)行合并來使特征降維。

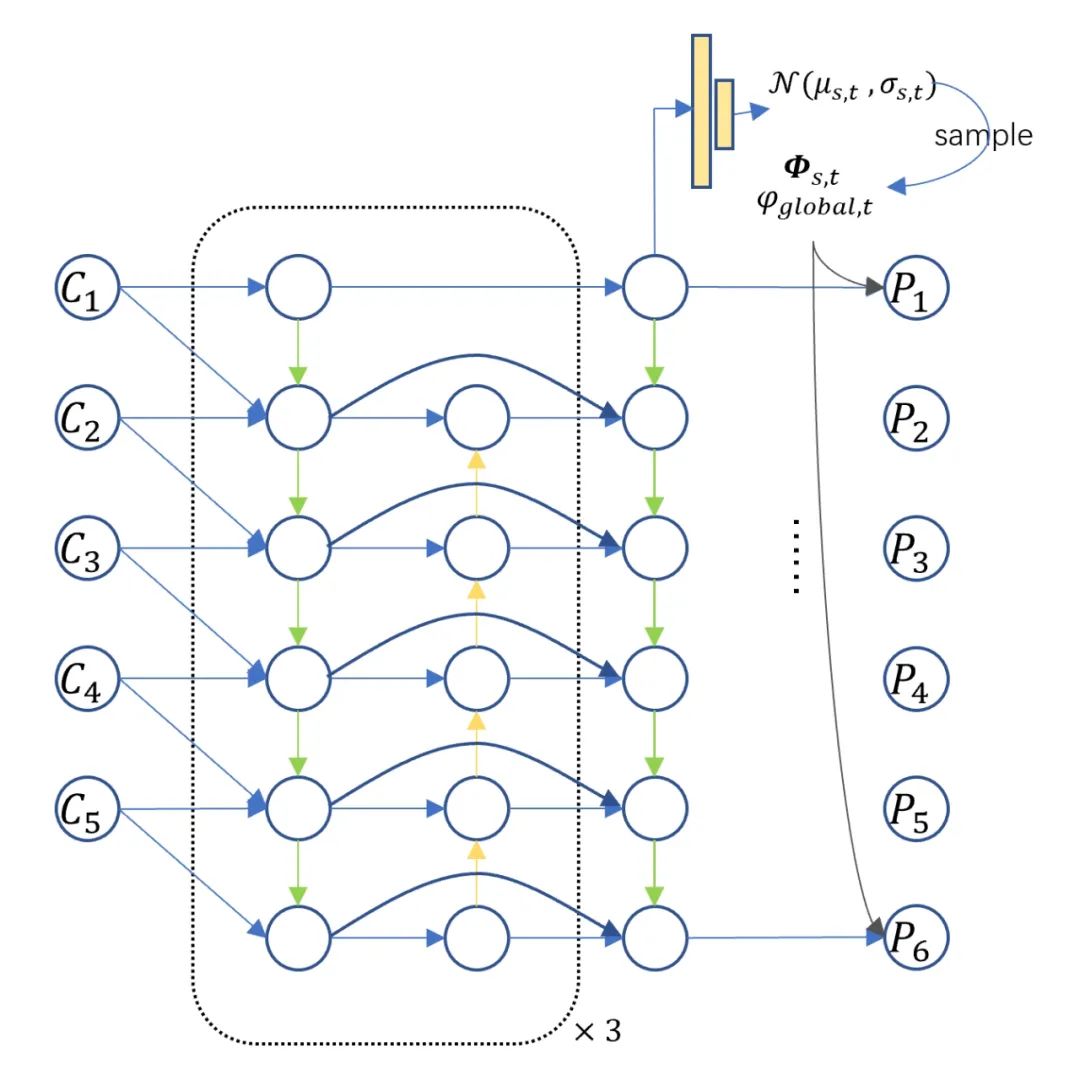

聚合器

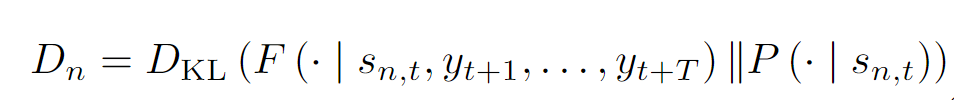

聚合器由兩部分組成,在空間尺度上,我們利用BiFPN做多尺度的聚合;在時(shí)間尺度上,我們利用隱變量模型來豐富未來的信息。類比于條件變分器,我們?cè)诿恳粋€(gè)尺度,每一個(gè)空間位置都對(duì)未來的概率進(jìn)行建模。在訓(xùn)練階段,我們基于現(xiàn)在時(shí)刻的概率分布做采樣。推理階段,我們直接采用概率分布均值。為了保證預(yù)測(cè)分布和已觀測(cè)分布的一致性,我們采用Kullback-Leibler divergence損失函數(shù)作為監(jiān)督信號(hào)。

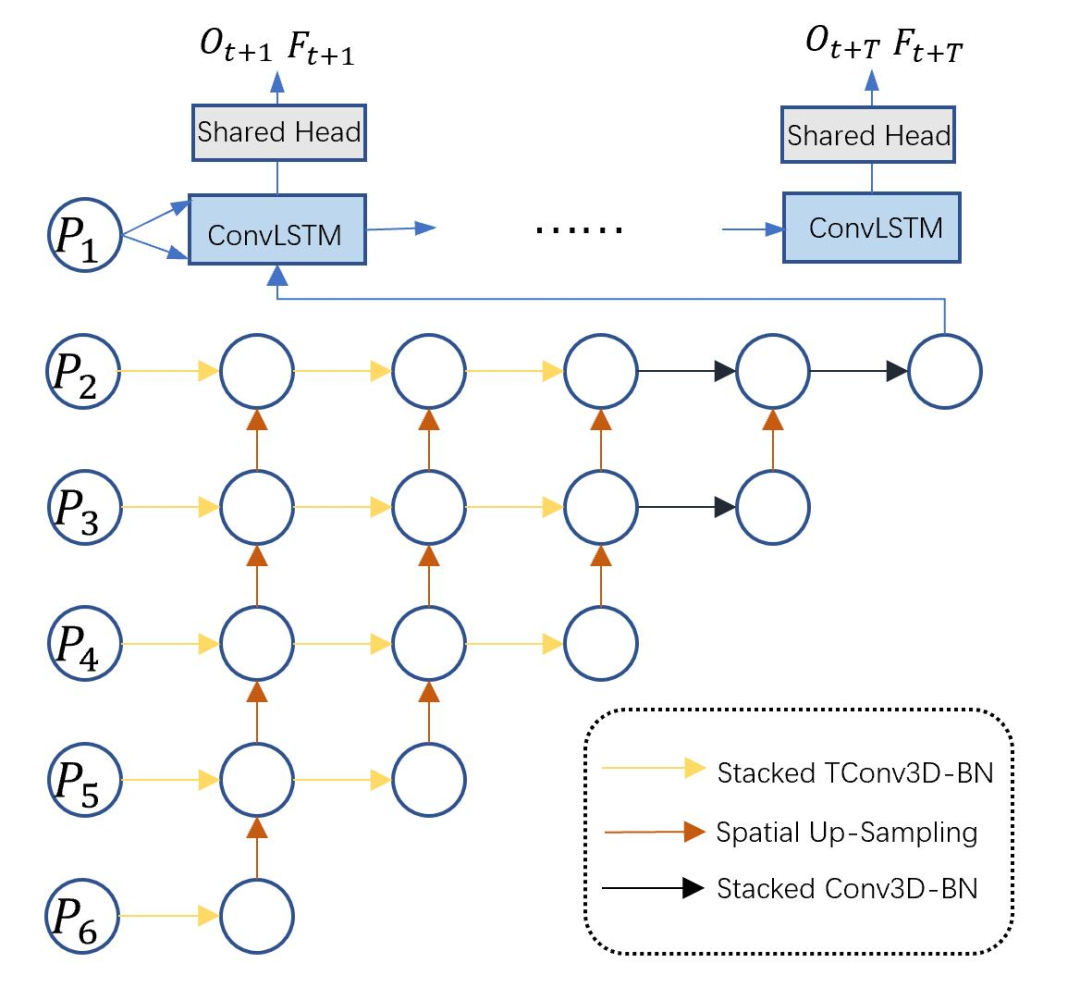

解碼器

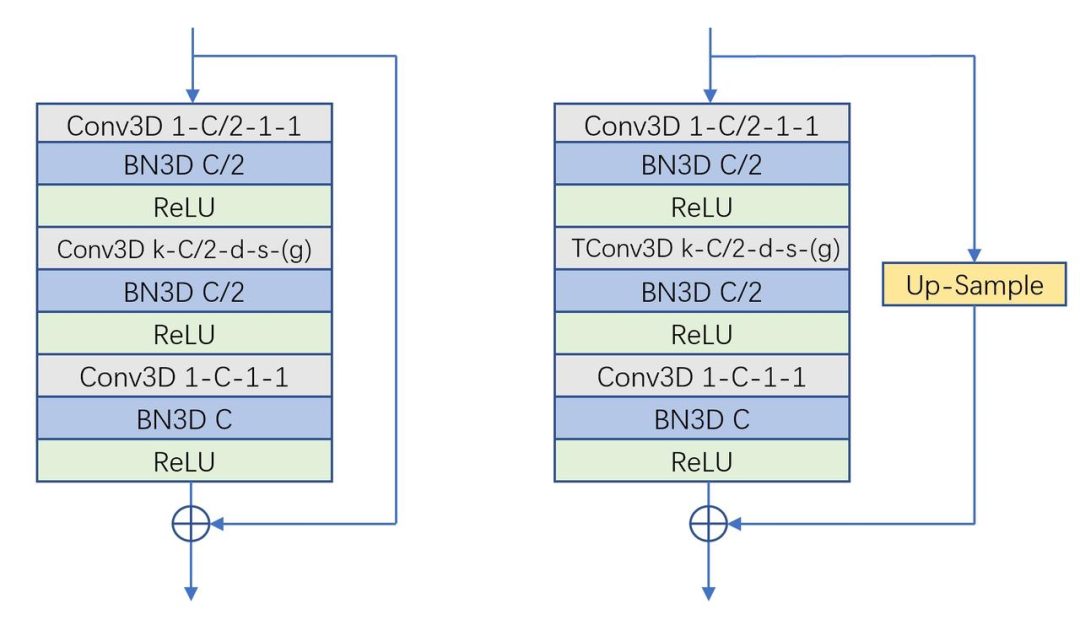

解碼器采用多層級(jí)多尺度的特征金字塔形式,基本的組成單元為3D卷積Bottleneck結(jié)構(gòu)。3D bottleneck中采用了膨脹卷積和分組卷積,可以極大地?cái)U(kuò)大感受野并節(jié)省計(jì)算量。同時(shí),為了將編碼后的2D特征做時(shí)序展開,我們引入了3D轉(zhuǎn)置卷積Bottleneck。這些堆疊的bottleneck通過上采樣進(jìn)行多尺度的鏈接,有效地融合了多尺度的信息。同時(shí),為了節(jié)省計(jì)算量,我們?cè)谳敵龀叨壬嫌肅onvLSTM做時(shí)序上的修正。

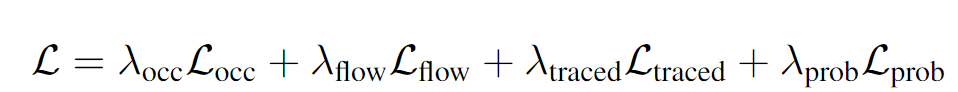

損失函數(shù)

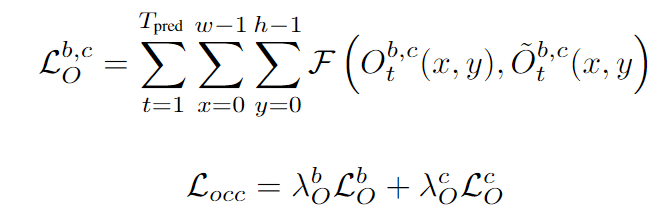

對(duì)于可觀測(cè)占有柵格和被遮擋占有柵格的預(yù)測(cè),我們采用Focal Loss作為其監(jiān)督信號(hào),兩者采用相同的權(quán)重進(jìn)行加權(quán)。

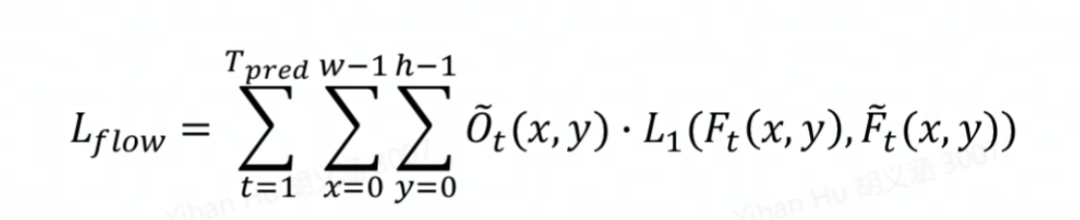

對(duì)于光流的預(yù)測(cè),我們采用Smooth L1損失函數(shù)。為了將光流和占有率的預(yù)測(cè)解耦,我們利用占有率的真值做加權(quán)。

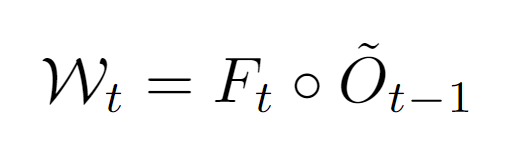

為了保證柵格占有率和光流預(yù)測(cè)的一致性,我們采用跟蹤損失函數(shù)進(jìn)行進(jìn)一步監(jiān)督。利用光流的預(yù)測(cè),我們可以對(duì)前一幀的柵格占有率進(jìn)行空間變形來得到當(dāng)前幀的基于光流的空間占有預(yù)測(cè)。

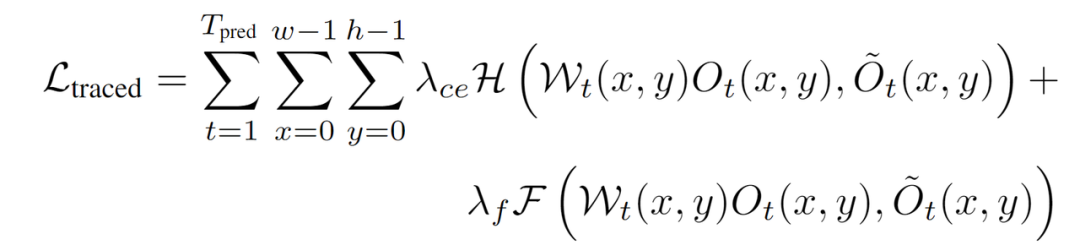

最后將基于光流的空間占有預(yù)測(cè)和當(dāng)前幀柵格占有預(yù)測(cè)相乘,來得到當(dāng)前幀的空間占有-光流聯(lián)合預(yù)測(cè),并用此聯(lián)合預(yù)測(cè)和當(dāng)前幀的柵格占有真值來計(jì)算損失函數(shù)traced loss。我們同時(shí)采用Focal loss和交叉熵?fù)p失函數(shù)進(jìn)行監(jiān)督[4]。

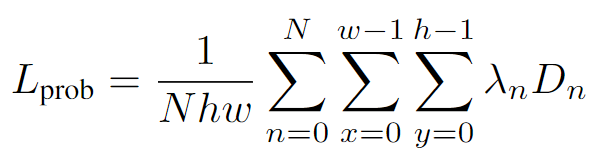

為保證聚合器中隱變量中現(xiàn)在和未來的一致性,我們采用Kullback-Leibler divergence損失函數(shù)作為監(jiān)督信號(hào)[5]來監(jiān)督預(yù)測(cè)的概率分布函數(shù)參數(shù)。

最后,所有的損失函數(shù)進(jìn)行加權(quán)和作為最后的損失函數(shù)。

實(shí)驗(yàn)結(jié)果

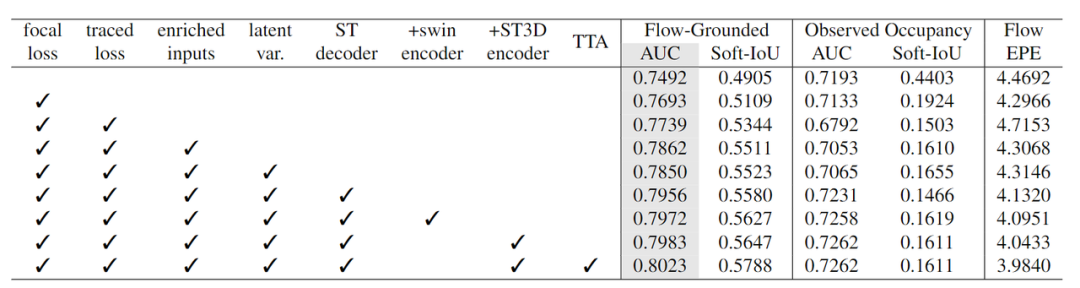

消融實(shí)驗(yàn)

本表展示了在Waymo數(shù)據(jù)集上的消融實(shí)驗(yàn)結(jié)果,灰色的一列為評(píng)測(cè)的主指標(biāo)。可以看出,loss的改進(jìn),如focal loss和traced loss分別帶來了2.01%和0.46%的提升。同時(shí),更豐富的柵格化輸入帶來了1.23%的提升。同時(shí),結(jié)構(gòu)化的改進(jìn),包括隱變量,時(shí)空解碼器,以及解碼器的改進(jìn)帶來了約1.21%的提升。最后TTA帶來了約0.40%的提升。值得一提的是,所有的實(shí)驗(yàn)都是在十分之一的數(shù)據(jù)集上做的驗(yàn)證。這些結(jié)果充分的說明了我們方法的有效性。

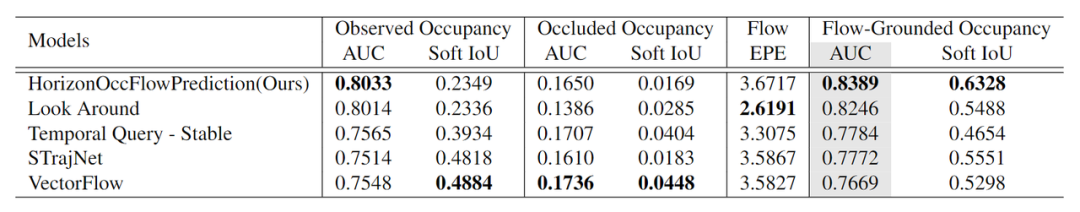

測(cè)試集表現(xiàn)

下表展示了我們方法在waymo測(cè)試集上的排名,灰色的一列代表評(píng)測(cè)的主指標(biāo),可以看出,我們的結(jié)果在主指標(biāo)上大幅領(lǐng)先對(duì)手,充分說明我們方法的優(yōu)越性。

結(jié)果可視化

下面展示我們的方法在特定場(chǎng)景下的對(duì)接下來8秒占有柵格(左)和光流(右)的可視化結(jié)果。下面列出了直行,紅綠燈路口左轉(zhuǎn)右轉(zhuǎn)掉頭,無保護(hù)左轉(zhuǎn),4-way-stop,無保護(hù)左轉(zhuǎn),自主避障,停車入庫,被遮擋物體的猜測(cè)等場(chǎng)景。可以看出,我們的方法能有效地處理復(fù)雜場(chǎng)景,能實(shí)現(xiàn)多動(dòng)態(tài)物體的交互,交通信息和規(guī)則的理解,自主避障,對(duì)被遮擋物體的推測(cè)等功能。

普通路面:主要展示對(duì)不同車速/加速減速情況的車流預(yù)測(cè),可以看出HOPE能對(duì)未來軌跡的不確定性進(jìn)行很好的建模

交叉路口:主要展示對(duì)不同轉(zhuǎn)彎,停車等待的車流預(yù)測(cè)

掉頭場(chǎng)景:復(fù)雜路口

不確定場(chǎng)景:直行、右轉(zhuǎn)兩條車道都有可能駛?cè)?/p>

右轉(zhuǎn):右轉(zhuǎn)車輛對(duì)直行車輛進(jìn)行了避讓

左轉(zhuǎn):根據(jù)路口紅綠燈、交通規(guī)則等綜合信息對(duì)路權(quán)進(jìn)行判斷

無保護(hù)左轉(zhuǎn):左轉(zhuǎn)車輛對(duì)直行車輛進(jìn)行了避讓

2 way stop:可以看見車輛交互,處理先來后到順序

遮擋繞行:可以看見車輛對(duì)前方靜止車輛進(jìn)行了繞行

停車入庫:小樣本、低速場(chǎng)景預(yù)測(cè),可以看見低速場(chǎng)景下軌跡的不確定性更高,模型可以有多種可能的軌跡預(yù)測(cè)

遮擋物體的猜測(cè):綠色的為被遮擋物體

原文標(biāo)題:開發(fā)者說 | HOPE:基于自動(dòng)駕駛場(chǎng)景Occupancy和Flow的運(yùn)動(dòng)預(yù)測(cè)

文章出處:【微信公眾號(hào):地平線HorizonRobotics】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

-

編碼解碼

+關(guān)注

關(guān)注

0文章

7瀏覽量

7200 -

自動(dòng)駕駛

+關(guān)注

關(guān)注

784文章

13924瀏覽量

166944 -

地平線

+關(guān)注

關(guān)注

0文章

354瀏覽量

15018

原文標(biāo)題:開發(fā)者說 | HOPE:基于自動(dòng)駕駛場(chǎng)景Occupancy和Flow的運(yùn)動(dòng)預(yù)測(cè)

文章出處:【微信號(hào):horizonrobotics,微信公眾號(hào):地平線HorizonRobotics】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

地平線引入國(guó)際公司高管!陳黎明博士履新地平線任總裁

地平線RDK系列再升級(jí),NodeHub驚喜發(fā)布

【地平線旭日X3派試用體驗(yàn)】開箱篇硬件介紹

一種對(duì)時(shí)空信息的kNN查詢處理方法

地平線推出全新一代 AIoT 邊緣 AI 芯片平臺(tái)

地平線推出自主研發(fā)的人工智能芯片

一種多層級(jí)特征融合就的深度卷積網(wǎng)絡(luò)

一種編碼解碼模式的肺分割算法

包含時(shí)空信息特征的視頻指紋算法

比亞迪與地平線正式宣布達(dá)成定點(diǎn)合作

地平線獲得一汽紅旗全新車型項(xiàng)目應(yīng)用

地平線GitLab使用指導(dǎo)

地平線研發(fā)一種全新利用時(shí)空信息進(jìn)行編碼解碼的層級(jí)網(wǎng)絡(luò)

地平線研發(fā)一種全新利用時(shí)空信息進(jìn)行編碼解碼的層級(jí)網(wǎng)絡(luò)

評(píng)論