1. 概述

人工智能技術(shù)迅猛發(fā)展,人機(jī)語音交互更加自然,搭載語音喚醒、識(shí)別技術(shù)的智能設(shè)備也越來越多。語音喚醒在學(xué)術(shù)上稱為 keyword spotting(簡(jiǎn)稱 KWS),即在連續(xù)語流中實(shí)時(shí)檢測(cè)出說話人特定片段(比如:叮當(dāng)叮當(dāng)、Hi Siri 等),是一種小資源的關(guān)鍵詞檢索任務(wù),也可以看作是一類特殊的語音識(shí)別,應(yīng)用在智能設(shè)備上起到了保護(hù)用戶隱私、降低設(shè)備功耗的作用,經(jīng)常扮演一個(gè)激活設(shè)備、開啟系統(tǒng)的入口角色,在手機(jī)助手、車載、可穿戴設(shè)備、智能家居、機(jī)器人等運(yùn)用得尤其普遍。

喚醒效果好壞的判定指標(biāo)主要有召回率 (recall,俗稱喚醒率)、虛警率 (false alarm,俗稱誤喚醒)、響應(yīng)時(shí)間和功耗四個(gè)指標(biāo)。召回率表示正確被喚醒的次數(shù)占總的應(yīng)該被喚醒次數(shù)的比例。虛警率表示不該被喚醒卻被喚醒的概率,工業(yè)界常以 12 或者 24 小時(shí)的誤喚醒次數(shù)作為系統(tǒng)虛警率的評(píng)價(jià)指標(biāo)。響應(yīng)時(shí)間是指用戶說出喚醒詞后,設(shè)備的反應(yīng)時(shí)間,過大的響應(yīng)時(shí)間會(huì)造成較差的用戶體驗(yàn)。功耗是指喚醒系統(tǒng)的耗電情況,多數(shù)智能設(shè)備都是電池供電,且需要保證長(zhǎng)時(shí)續(xù)航,要求喚醒系統(tǒng)必須是低耗能的。一個(gè)好的喚醒系統(tǒng)應(yīng)該保證較高的召回率、較低的虛警率、響應(yīng)延時(shí)短、功耗低。

喚醒技術(shù)落地的難點(diǎn)是要求在低功耗下達(dá)到高性能要求。一方面是目前很多智能設(shè)備為了控制成本,搭載的都是一些低端芯片,計(jì)算能力有限,需要喚醒模塊盡可能的減少計(jì)算計(jì)算量以減少能源消耗;一方面用戶使用場(chǎng)景多種多樣,設(shè)備也常沒有經(jīng)過專業(yè)聲學(xué)設(shè)計(jì),遠(yuǎn)場(chǎng)、大噪聲、強(qiáng)干擾、高回聲、高混響等情況下仍然面臨召回率低、虛警率高的問題。

針對(duì)此問題,騰訊 AI Lab 近期發(fā)表一篇論文,針對(duì)復(fù)雜聲學(xué)環(huán)境,特別是噪聲和干擾人聲場(chǎng)景,對(duì)送給喚醒模型的聲學(xué)信號(hào)進(jìn)行前處理,以提升其語音信號(hào)質(zhì)量。本論文已被 Interspeech 2020 接收。

很多智能設(shè)備安裝有多個(gè)麥克風(fēng),因此多通道的前端處理技術(shù)被應(yīng)用到喚醒的前端信號(hào)處理中。當(dāng)目標(biāo)說話人與干擾聲源分布在不同方向時(shí),多通道的語音增強(qiáng)技術(shù),例如波束形成 (beamformer), 能夠有效的增強(qiáng)目標(biāo)說話人,抑制其它干擾聲源。但是這一做法依賴較準(zhǔn)確的目標(biāo)說話人方向定位。在實(shí)際環(huán)境中,由于有干擾聲源的存在,使得很難從帶噪數(shù)據(jù)中準(zhǔn)確估計(jì)目標(biāo)說話人的方位,特別是當(dāng)有多人在同時(shí)說話時(shí),也無法判斷哪一個(gè)是目標(biāo)說話人。因此本文采用“耳聽八方” (多音區(qū)) 的思路,在空間中設(shè)定若干待增強(qiáng)的方向(look direction),然后區(qū)別于傳統(tǒng)的波束形成做法(這個(gè)做法已發(fā)表于 ICASSP 2020 [1]),本文提出了一個(gè)基于神經(jīng)網(wǎng)絡(luò)的多音區(qū)(multi-look)語音增強(qiáng)模型,可同時(shí)增強(qiáng)多個(gè)指定的方向聲源。這些多個(gè)方向增強(qiáng)輸出的信號(hào)再通過注意力機(jī)制進(jìn)行特征融合送予喚醒模型。由于前端的增強(qiáng)是通過神經(jīng)網(wǎng)絡(luò)處理的,這樣多音區(qū)的增強(qiáng)模型與喚醒模型可以進(jìn)行聯(lián)合優(yōu)化,實(shí)現(xiàn)真正的前后端一體的多音區(qū)語音喚醒。

基于神經(jīng)網(wǎng)絡(luò)的多音區(qū)語音增強(qiáng)模型是首個(gè)完全基于神經(jīng)網(wǎng)絡(luò)的多音區(qū)語音增強(qiáng)模型。相比于特定方向的語音增強(qiáng),本文提出的模型可同時(shí)增強(qiáng)多個(gè)方向聲源。同時(shí)這種基于神經(jīng)網(wǎng)絡(luò)的方法,在性能上顯著優(yōu)于基于傳統(tǒng)的波束形成做法。完全基于神經(jīng)網(wǎng)絡(luò)的多音區(qū)前端,與喚醒模型聯(lián)合訓(xùn)練,前后一體的做法進(jìn)一步提升模型的魯棒性和穩(wěn)定性。此模型適用于多麥克風(fēng)設(shè)備的語音喚醒。

以下為方案詳細(xì)解讀。

2. 方案詳解

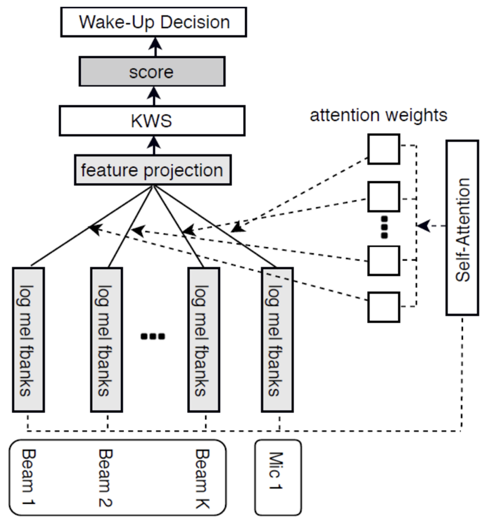

傳統(tǒng)的多音區(qū)語音處理的思路,是在空間中設(shè)定若干待增強(qiáng)的方向(look direction),每個(gè)方向分別應(yīng)用一個(gè)波束形成,增強(qiáng)這個(gè)方向的聲源,最終本文將每個(gè)方向增強(qiáng)輸出的信號(hào)輪流送給喚醒模塊,只要有一個(gè)方向觸發(fā)喚醒,則喚醒成功。這種基于多音區(qū)的多波束喚醒技術(shù)大大提高了噪聲下的喚醒性能,然而需要多次調(diào)用喚醒模塊,因此計(jì)算量較單路喚醒也成倍增加,功耗變大制約了應(yīng)用。針對(duì)這一情況,作者在早前一點(diǎn)的工作中 [1] 將注意力 (attention) 機(jī)制引入到喚醒框架下,如圖 1 所示,多個(gè) look-direction 增強(qiáng)的信號(hào)提取特征后通過 attention 層映射成單通道輸入特征,再送入單路喚醒網(wǎng)絡(luò)層,與單路喚醒相比僅僅增加了一層網(wǎng)絡(luò),既保證了喚醒性能,計(jì)算量又大大降低。

圖 1:基于多波束特征融合的喚醒模型 [1]

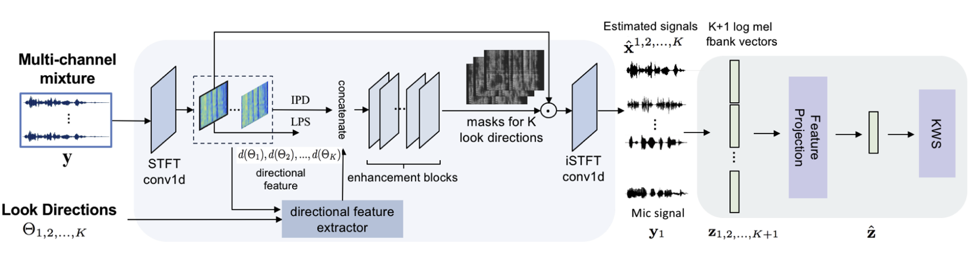

以上介紹的基于波束形成的多音區(qū)喚醒 [1],前端的信號(hào)處理(波束形成)和喚醒模塊還沒有做到聯(lián)合調(diào)優(yōu)。因此本文提出了一個(gè)基于神經(jīng)網(wǎng)絡(luò)的多音區(qū)語音增強(qiáng)模型。該模型讀取單個(gè)通道的語譜特征和多通道的相位差特征,同時(shí)根據(jù)預(yù)設(shè)的若干音區(qū)方向(look direction),作者分別提取對(duì)應(yīng)的方向特征 (directionalfeature)。這些方向特征表征每個(gè)時(shí)頻點(diǎn)是否被特定音區(qū)方向的聲源信號(hào)占據(jù),從而驅(qū)動(dòng)網(wǎng)絡(luò)在輸出端增強(qiáng)距離每個(gè)音區(qū)方向最近的那個(gè)說話人。為了避免因?yàn)橐魠^(qū)和說話人的空間分布導(dǎo)致目標(biāo)說話人經(jīng)過多音區(qū)增強(qiáng)模型處理后失真,實(shí)驗(yàn)中使用一個(gè)原始麥克風(fēng)信號(hào)與多個(gè)方向增強(qiáng)輸出的信號(hào)一起通過注意力機(jī)制進(jìn)行特征融合送予喚醒模型,由于前端的增強(qiáng)是通過神經(jīng)網(wǎng)絡(luò)處理的,這樣多音區(qū)的增強(qiáng)模型與喚醒模型可以進(jìn)行聯(lián)合優(yōu)化,實(shí)現(xiàn)真正的前后端一體的多音區(qū)語音喚醒。完整的模型結(jié)構(gòu)在圖 2 中描述。

圖 2: 本文提出的基于神經(jīng)網(wǎng)絡(luò)的多音區(qū)語音增強(qiáng)和喚醒模型 [2]

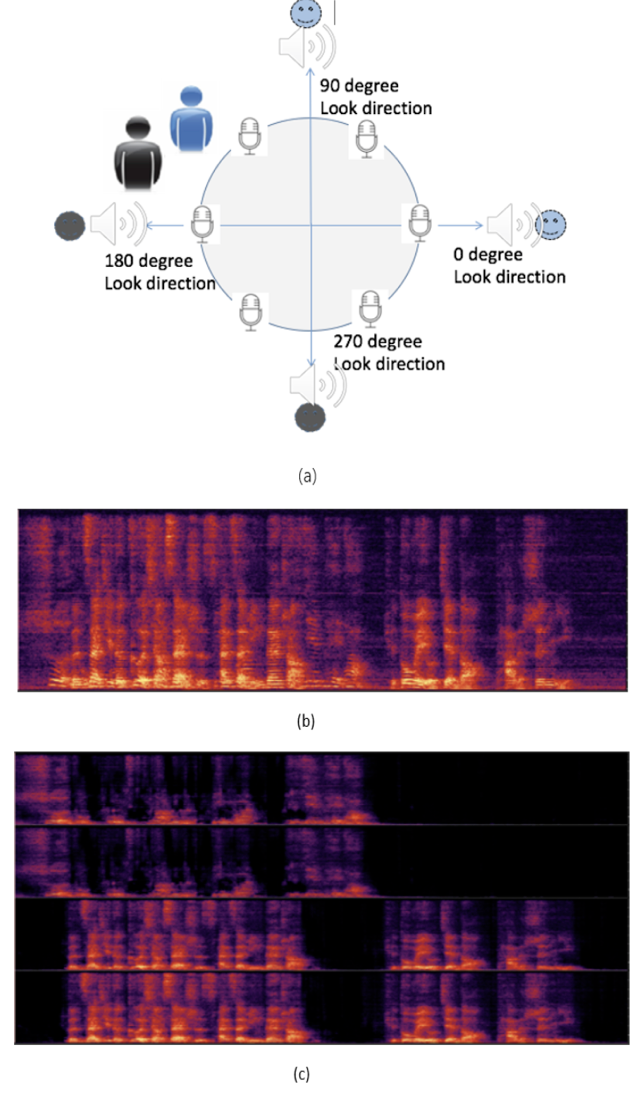

圖 3 是一個(gè)多音區(qū)增強(qiáng)的實(shí)例。兩個(gè)說話人分別位于圖 (a) 所示位置,麥克風(fēng)采集的兩人同時(shí)說話信號(hào)譜如圖 (b). 作者設(shè)定了 4 個(gè)待增強(qiáng)的方向(0 度,90 度,180 度和 270 度)。多音區(qū)增強(qiáng)模型將會(huì)在 0 度和 90 度方向增強(qiáng)藍(lán)色說話人,180 度和 270 度方向?qū)?huì)增強(qiáng)黑色說話人, 增強(qiáng)后的 4 個(gè)方向語譜如圖 (c)。

圖 3: 多音區(qū)增強(qiáng)網(wǎng)絡(luò)輸出實(shí)例

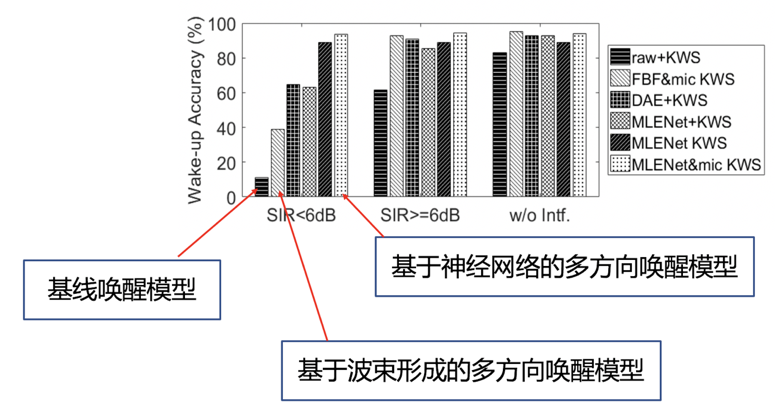

在圖 4 中,作者對(duì)比了基于神經(jīng)網(wǎng)絡(luò)的多音區(qū)增強(qiáng)喚醒模型與基于波束形成的多音區(qū)增強(qiáng)喚醒模型和基線的單通道喚醒模型。可以看出特別是在小于 6dB 的信干比聲學(xué)環(huán)境下,本文提出的做法顯著超越其它方法。不同方法喚醒率測(cè)試均在控制誤喚醒為連續(xù) 12 小時(shí)干擾噪聲下 1 次的條件下進(jìn)行的。

圖 4: 多音區(qū)喚醒模型的性能對(duì)比

3.總結(jié)及展望

本文提出的多音區(qū)語音增強(qiáng)和喚醒的做法,大幅降級(jí)了喚醒前端語音增強(qiáng)與喚醒結(jié)合使用的計(jì)算量,在未知目標(biāo)聲源方位的情形下,同時(shí)增強(qiáng)的多個(gè)方向聲源信號(hào)的特征融合可保證目標(biāo)語音得到增強(qiáng),給準(zhǔn)確的喚醒提供了保障。在論文中測(cè)試的多說話人帶噪聲的復(fù)雜聲學(xué)環(huán)境下,喚醒率達(dá)到 95%。

多音區(qū)的語音增強(qiáng)模型已經(jīng)與聲紋模型結(jié)合,形成多音區(qū)的說話人驗(yàn)證,提升聲紋系統(tǒng)在復(fù)雜遠(yuǎn)場(chǎng)聲學(xué)環(huán)境下的魯棒性。未來這一工作可與語音識(shí)別等其它語音任務(wù)相結(jié)合。

原文標(biāo)題:論文解讀丨基于神經(jīng)網(wǎng)絡(luò)的多音區(qū)語音喚醒

文章出處:【微信公眾號(hào):通信信號(hào)處理研究所】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

責(zé)任編輯:haq

-

神經(jīng)網(wǎng)絡(luò)

+關(guān)注

關(guān)注

42文章

4779瀏覽量

101059 -

人工智能

+關(guān)注

關(guān)注

1795文章

47642瀏覽量

239765

原文標(biāo)題:論文解讀丨基于神經(jīng)網(wǎng)絡(luò)的多音區(qū)語音喚醒

文章出處:【微信號(hào):tyutcsplab,微信公眾號(hào):智能感知與物聯(lián)網(wǎng)技術(shù)研究所】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

基于神經(jīng)網(wǎng)絡(luò)的多音區(qū)語音喚醒

基于神經(jīng)網(wǎng)絡(luò)的多音區(qū)語音喚醒

評(píng)論