論文:A Hierarchical Graph Network for 3D Object Detection on Point Clouds

由于大多數(shù)現(xiàn)有的點(diǎn)云對(duì)象檢測(cè)方法不能充分適應(yīng)點(diǎn)云的特征(例如稀疏性),所以一些關(guān)鍵的語義信息(如物體形狀)不能被很好的捕捉到。本文提出了一種基于層級(jí)圖網(wǎng)絡(luò)(HGNet)的圖卷積(GConv),可以直接將點(diǎn)云作為輸入來預(yù)測(cè) 3D 的邊界框。形狀注意圖卷積(SA-GConv)可以通過劍魔點(diǎn)的位置星系來描述物體形狀,基于 SA-GConv 的 U 形網(wǎng)絡(luò)可以通過改進(jìn)的 voting 模塊獲取多層級(jí)的特征進(jìn)而生成候選,然后一個(gè)基于圖卷積的候選推理模塊考慮全局的場(chǎng)景語義來對(duì)邊界框進(jìn)行預(yù)測(cè)。該框架在兩個(gè)大規(guī)模點(diǎn)云數(shù)據(jù)上的表現(xiàn)超過了目前最先進(jìn)的模型。

論文背景

由于點(diǎn)云的稀疏性,一些已有的為網(wǎng)格形式數(shù)據(jù)設(shè)計(jì)的方法(如CNN)在點(diǎn)云上的表現(xiàn)并不好,為解決這一問題,最近有一些對(duì)點(diǎn)云數(shù)據(jù)的方法被提出,例如基于投影的方法、基于體卷積的方法和基于 PointNet 的方法。前兩種試圖將點(diǎn)云數(shù)據(jù)嚴(yán)格轉(zhuǎn)換為網(wǎng)格結(jié)構(gòu)數(shù)據(jù),而后一種則在不明確考慮點(diǎn)的幾何位置的情況下聚合特征。

與其他方法相比,PointNet++ 可以保留點(diǎn)的稀疏特點(diǎn),因此被廣泛作為框架的骨架。當(dāng)目前仍有一些未能很好解決的挑戰(zhàn),首先由于沒有考慮點(diǎn)的相對(duì)幾何位置,因此使用 PointNet++ 作為主干忽略了一些局部形狀信息。其次,框架的結(jié)構(gòu)沒有充分利用多級(jí)語義,這可能會(huì)忽略一些有助于目標(biāo)檢測(cè)的信息。

本文提出了一個(gè)基于圖卷積(GCONV)的層級(jí)圖網(wǎng)絡(luò)(HGNet)用于基于點(diǎn)云的 3D 目標(biāo)檢測(cè)。HGNet 包含三部分:一個(gè)基于圖卷積的 U 形網(wǎng)絡(luò)(GUnet)、一個(gè)候選生成器以及一個(gè)候選推理模塊(ProRe Module)。基于層級(jí)圖網(wǎng)絡(luò)(HGNet)的圖卷積

整個(gè) HGNet 以端到端的方式進(jìn)行培訓(xùn)。在本文的框架中,點(diǎn)云的局部形狀信息、多級(jí)語義和全局場(chǎng)景信息(候選的特征)已被層級(jí)圖模型充分捕獲、聚合和合并,充分考慮了點(diǎn)云數(shù)據(jù)的特征。

本文的主要貢獻(xiàn)如下:

(A)開發(fā)了一種新的層級(jí)圖網(wǎng)絡(luò)(HGNet),用于在點(diǎn)云上進(jìn)行 3D 對(duì)象檢測(cè),其表現(xiàn)好于已有方法。

(B)提出了一種新穎的 SA-(De)GConv,它可以有效地聚合特征并捕獲點(diǎn)云中對(duì)象的形狀信息。

(C)構(gòu)建了一個(gè)新的 GU-net,用于生成多級(jí)特征,這對(duì)于 3D 對(duì)象檢測(cè)至關(guān)重要。

(D)利用全局信息,ProRe 模塊通過對(duì)候選進(jìn)行推理來提高效果。

論文模型

融合采樣

3D 目標(biāo)檢測(cè)有基于點(diǎn)和基于體素兩種框架,前者更加耗時(shí),由候選生成與預(yù)測(cè)細(xì)化兩個(gè)階段組成。

在第一個(gè)階段,SA 用于降采樣以獲得更高的效率以及擴(kuò)大感受野,F(xiàn)P 用來為降采樣過程中丟掉的點(diǎn)傳播特征。在第二階段,一個(gè)優(yōu)化模塊最優(yōu)化 RPN 的結(jié)果以獲得更準(zhǔn)確的預(yù)測(cè)。SA 對(duì)于提取點(diǎn)的特征是必需的。但 FP 和優(yōu)化模塊會(huì)限制效率。

形狀注意圖卷積

點(diǎn)云通常不能清楚地表示出物體的形狀,可以使用其相鄰點(diǎn)的相對(duì)幾何位置來描述點(diǎn)周圍的局部形狀。本文介紹了一種新穎的形狀注意圖卷積,它通過對(duì)點(diǎn)的幾何位置建模來捕獲對(duì)象形狀。

對(duì)于一個(gè)點(diǎn)集 X,其中每一個(gè)點(diǎn)由其集合位置 p_i 以及 D 維的特征 f_i 組成,我們想要生成一個(gè) X’,本文設(shè)計(jì)了圖卷積用于聚合從 X 到 X’ 的特征。與 PointNet++的采樣層相類似,本文首先從 n 個(gè)點(diǎn)中采樣 n’ 個(gè)點(diǎn),通常 K 最近鄰(KNN)被用來在采樣中保留局部信息將其作為中心點(diǎn)特征。

其中 g 表示 i 和 j 的相對(duì)位置,通過一個(gè)卷積將三維變?yōu)橐痪S,f 是 mlp,然后二者的乘積就是中心點(diǎn)的 knn,其中最大的作為 i 的特征。形狀注意操作不同于簡(jiǎn)單的基于 mlp 的操作主要就是因?yàn)檫@個(gè) g 函數(shù)。雖然形式上沒有 attention 中的 softmax 這樣的歸一化,但是 g 的輸出就和 attention一樣,每個(gè)點(diǎn)的 weights,然后對(duì)應(yīng)的乘以特征。

審核編輯:符乾江

-

目標(biāo)檢測(cè)

+關(guān)注

關(guān)注

0文章

217瀏覽量

15783 -

點(diǎn)云

+關(guān)注

關(guān)注

0文章

58瀏覽量

3878

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

一種以圖像為中心的3D感知模型BIP3D

對(duì)于結(jié)構(gòu)光測(cè)量、3D視覺的應(yīng)用,使用100%offset的lightcrafter是否能用于點(diǎn)云生成的應(yīng)用?

多維精密測(cè)量:半導(dǎo)體微型器件的2D&3D視覺方案

C#通過Halcon實(shí)現(xiàn)3D點(diǎn)云重繪

采用華為云 Flexus 云服務(wù)器 X 實(shí)例部署 YOLOv3 算法完成目標(biāo)檢測(cè)

AI模型部署邊緣設(shè)備的奇妙之旅:目標(biāo)檢測(cè)模型

一種基于因果路徑的層次圖卷積注意力網(wǎng)絡(luò)

安寶特產(chǎn)品 安寶特3D Analyzer:智能的3D CAD高級(jí)分析工具

卷積神經(jīng)網(wǎng)絡(luò)共包括哪些層級(jí)

基于深度學(xué)習(xí)的小目標(biāo)檢測(cè)

卷積神經(jīng)網(wǎng)絡(luò)分類方法有哪些

cnn卷積神經(jīng)網(wǎng)絡(luò)分類有哪些

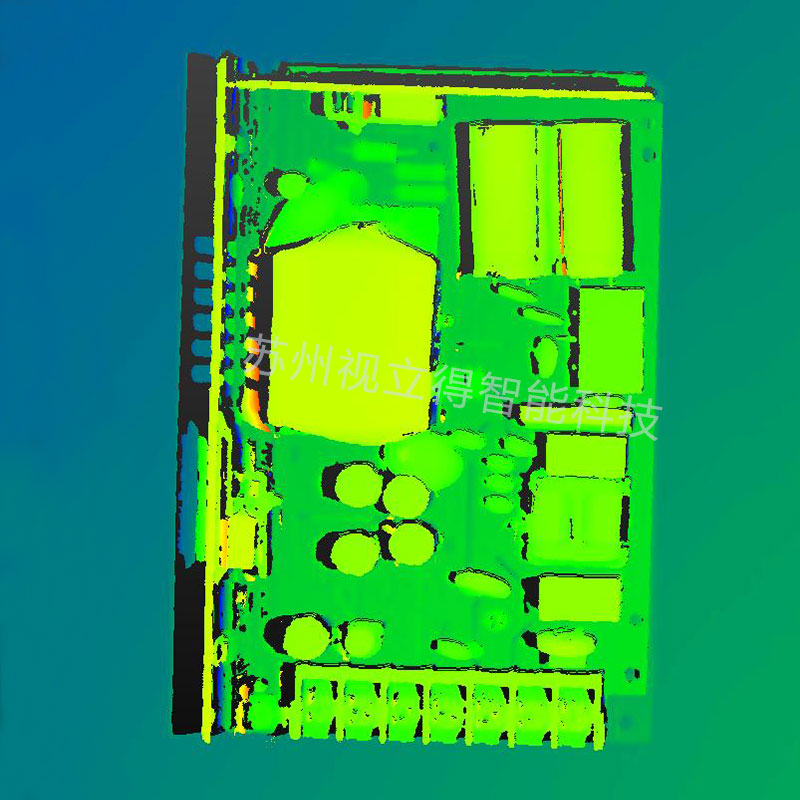

蘇州吳中區(qū)多色PCB板元器件3D視覺檢測(cè)技術(shù)

機(jī)器人3D視覺引導(dǎo)系統(tǒng)框架介紹

利用卷積神經(jīng)網(wǎng)絡(luò)實(shí)現(xiàn)SAR目標(biāo)分類的研究

評(píng)論