客座文章 / Michael J. Biercuk、Harry Slatyer 和 Michael Hush,來自Q-CTRL

Google 近期宣布推出 TensorFlow Quantum,這是一個將 SOTA 的機器學習技術與量子算法設計相結合的工具集。這是為量子應用的開發者,也就是主要在“棧頂”操作的用戶打造工具的重要一步。

與此同時,我們也在從硬件層面自下而上,從棧底著手打造基于 TensorFlow 的配套工具集。重點通過集成我們稱之為量子固件(Quantum Firmware) 的技術來提升量子計算硬件的性能。

在本文中,我們將對這項工作的動機做個概述,簡述如何對抗量子計算機中的噪聲和錯誤,并介紹 Q-CTRL 團隊如何使用 TensorFlow 有效地表征和抑制量子硬件中噪聲和缺陷的影響。在努力讓量子計算機發揮作用的進程中,這些都是全球用戶所面臨的關鍵挑戰。

量子計算機的致命弱點 - 噪聲和錯誤

量子物理定律是在微觀尺度上支配自然的規則,而量子計算,簡言之,就是利用這些定律來處理信息的新方式。在科學和工程領域付出數十年的努力后,我們現在已經做好準備將這些物理規則用于解決對于普通計算機而言異常困難的問題。

要在如今的系統上實現有用的計算,需要認識到性能主要受制于硬件的缺陷和故障,而非系統大小。量子計算機容易受到噪聲和錯誤的影響,這仍然是其致命弱點,也最終限制了算法在量子計算硬件上運行的范圍和效用。

就目前社區的平均水平而言,大多數量子計算機硬件在遠小于一毫秒的時間內只能進行幾十次計算,接著就會因為噪聲的影響而需要復位。具體情況略有不同,但這比筆記本電腦中的硬件差了大約 1024 倍!

這就是量子計算很難實現的核心問題所在。此處所述的“噪聲”指的是量子計算機中會造成干擾的所有事物。如同手機通話受到干擾后會導致通話中斷,量子計算機也很容易受到各種來源的干擾,比如受到 WiFi 的電磁信號或地球磁場的干擾。

當量子計算機的量子位暴露在這種噪聲中時,其中的信息就會降級,類似于通話受到干擾會降低音質的情況。這個過程在量子系統中被稱之為退相干 (Decoherence)。退相干會造成量子計算機中編碼的信息變得隨機化,從而導致我們執行算法時出現錯誤。噪聲的影響越大,算法能夠運行的時間就越短。

那么我們該如何解決這一點呢?首先,在過去二十年里,眾多團隊一直努力以被動的方式讓硬件更加穩定 - 屏蔽導致退相干的噪聲。與此同時,理論家設計了一種名為量子糾錯的巧妙算法,可以識別和修復硬件中的錯誤,這很大程度上是基于經典糾錯碼而構作出來的。這一點從根本上而言至關重要,但不足之處在于要想發揮作用,則必須將一個量子位中的信息分散到很多量子位上;要實現僅僅一個糾錯后的“邏輯的量子位”,可能需要 1000 個或更多的物理量子位。如今的機器還遠遠不能從此類量子糾錯中獲得益處。

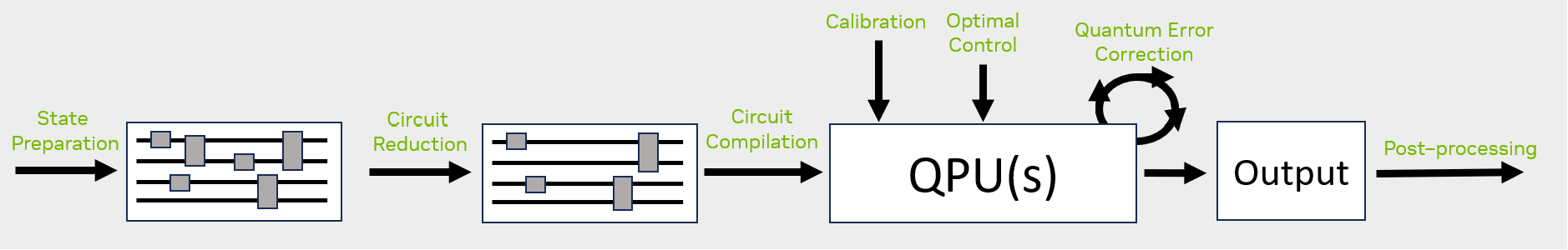

Q-CTRL 另外添加了稱之為量子固件的內容,可以在不需要額外資源的情況下穩定量子位,抵抗噪聲和退相干。量子固件通過在量子計算堆棧的最低層添加新的解決方案加以實現,進而提高硬件對錯誤的魯棒性。

使用 TensorFlow 構建量子固件

量子固件描述的是一組協議,其目的是向量子計算堆棧中更高層次的抽象提供性能擴充的量子硬件。“固件”這一命名反映了相關的例程通常是軟件定義的,但嵌入在物理層附近,對更高的層次抽象事實上是不可見的。

量子計算硬件通常依賴精確設計的光與物質相互作用來實現量子邏輯運算。這些運算在一定意義上構成了量子計算機的原生機器語言:一串計時微波脈沖與超導量子位的共振可以轉化為有效的比特翻轉運算,而另一串脈沖可以實現一對量子位之間的條件邏輯運算。通過適當組合,這些電磁信號就實現了目標量子算法。

量子固件決定了物理硬件應該如何操作, 重新定義 了硬件機器語言,從而提高抵抗退相干的穩定性。這個過程的關鍵在于利用從硬件本身收集的信息計算噪聲魯棒的運算。

對于 Q-CTRL 而言,為了從“自制”代碼過渡成為商業級的產品,在 TensorFlow 中構建變得至關重要。這些技術(嚴格來說來自量子控制領域)所依賴的是讓我們能夠執行復雜的梯度優化的工具。我們以數據流圖表達所有優化問題,描述了優化變量(優化器可以調整的變量)如何轉化為代價函數(即優化器試圖最小化的目標)。我們將自定義的便利函數與 TensorFlow 基元的訪問結合起來,從而高效地執行在工作流的許多不同部分中使用的優化。極為重要的是,我們利用 TensorFlow 的高效梯度計算工具來解決自制實現中最為薄弱的環節,尤其是相關函數的分析形式通常是非線性的,還包含許多復雜的依賴關系。

我們利用 TensorFlow 的高效梯度計算工具

https://arxiv.org/abs/2001.04060

非線性的

https://docs.q-ctrl.com/boulder-opal/user-guides/optimization#Example-non-linear-dependence-on-control-pulses

比方說,假設定義一個經數值優化的“錯誤魯棒量子位翻轉” (Error-Robust Quantum Bit Flip) 用于操縱量子位的情形,也就是經典的非門模擬。正如此前所述,在超導量子位中,這是使用一串微波脈沖實現的。我們可以自由地“塑造”脈沖包絡的各個方面,實現對常見噪聲源產生的魯棒性,如微波強度或頻率的波動,從而產生相同的數學轉換。

要做到這一點,我們首先要定義優化該量子位操作所使用的數據流圖,包括描述可用的調節“旋鈕”的對象、噪聲來源和目標運算(這里指的是阿達馬門)。

優化量子控制所用的數據流圖。左邊的循環通過我們的 TensorFlow 優化引擎運行

一旦在我們的上下文管理器中定義了流圖,就必須創建一個對象,將目標函數(此處指最小化合成門錯誤)與定義微波脈沖形狀的預期輸出聯系在一起。創建流圖對象后,可以使用服務運行優化,返回包含優化結果的一個新的流圖對象。

通過這種結構,我們只需創建輔助函數,讓物理激發的約束條件能夠直接建立在流圖中。例如,這些約束條件可能是對稱性要求、信號隨時間變化的限制,甚至是產生微波脈沖所用電子系統特性的包含條件。該輔助函數庫未直接覆蓋的任何其他功能也可以直接編碼為 TensorFlow 基元。

通過這種方法,我們得到了一個非常靈活的高性能優化引擎;我們的直接基準測試顯示,相對于現有的最佳替代架構,我們的方法在尋找解決方案的時間上有數量級的優勢。

直接基準測試顯示

https://arxiv.org/abs/2001.04060

該工具包所實現的功能跨越了穩定量子計算硬件和減少量子計算堆棧最低層錯誤所需的任務空間。更重要的是,這在真實量子計算硬件上得到了實驗驗證;經證實,量子固件可以降低出錯的可能性,減輕不同設備之間的系統性能變化,穩定硬件以防止慢慢偏離校準,甚至使量子邏輯運算與量子計算中更高層次的抽象(如量子糾錯)更加兼容。我們在《用戶指南》和《應用筆記》中公開提供了所有這些功能和真實硬件演示,可以通過可執行的 Jupyter 筆記本形式訪問。

證實

https://arxiv.org/abs/2001.04060

《用戶指南》

https://docs.q-ctrl.com/boulder-opal/user-guides/

《應用筆記》

https://docs.q-ctrl.com/boulder-opal/application-notes/

如果不集成量子固件的功能,我們認為構建和運行大規模量子計算系統從根本上而言是不可能的。在追求性能和自主性的過程中,可以從機器學習和機器人控制的各個領域中借鑒許多概念,而 TensorFlow 已經證明是一種支持開發關鍵工具集的高效語言。

QC 簡史,從 Shor 到量子機器學習

量子計算的熱潮始于 1994 年,Shor 的大數分解算法面世。公鑰密碼系統,也就是大多數加密技術,依靠分解質數的數學復雜程度來保證信息的安全,避免被別的計算機窺探。然而,憑借其編碼和處理信息的方式,人們推測量子計算機能以比經典機器快指數級的速度分解質數。從理論上而言,這不僅危及國家安全,也對加密貨幣等新興技術也構成了威脅。

這種意識推動了整個量子計算領域的發展。Shor 的算法促使 NSA 開啟了有史以來首個由大學主導的開放研究計劃,探尋建立此類系統的可能性。行進到 2020 年,量子霸權已經實現,這意味著一個真正的量子計算硬件系統已經完成了一個連世界上最大的超級計算機都不可能完成的任務。

量子霸權是一個重要的技術里程碑,對解決最終用戶的問題實際上有多重要,這一點尚不清楚。取得量子優勢是一個門檻,表明使用量子計算機解決有實際意義的問題會更便宜或更迅速,我們的社區正朝著這個方向不斷取得重大進展。而對于正確的問題,我們認為在未來 5 至 10 年內可以跨越這個門檻,使用的量子計算機與如今的大小差不多,只是性能更加出色。

那么,哪些問題是量子計算機首先要解決的正確問題呢?

從許多方面而言,隨著挑戰愈發嚴峻,Shor 算法已經不再那么重要。最近的一項技術分析表明,在 2039 年之前,我們不太可能看到 Shor 以有用的規模部署。如今,在世界各地的實驗室里都有小規模的機器,這些機器擁有幾十個相互作用的量子位,由超導電路、單個被捕捉原子或類似的奇異材料構建而成。問題在于這些早期的機器規模過小,又太脆弱,無法處理與分解相關的問題。

一項技術分析

https://arxiv.org/abs/2009.05045

要分解一個大到與密碼學產生關聯的數字,需要一個由數千個能夠各自處理數萬億次運算的量子位組成的系統。這對于傳統的機器來說不算什么,因為在傳統機器上,硬件能以每秒十億次的操作運行十億年,而且很少會出現故障。但正如我們所看到的,量子計算機的情況就完全不同了。

這些限制推動了材料科學和化學中新類型應用的出現,這些應用可能使用更小的系統而具有同樣的影響力。量子計算在短期內還可以幫助開發新一類的人工智能系統。最近的研究表明,量子計算和人工神經網絡之間存在著意想不到的緊密聯系,可能預示著機器學習的新方式。

化學

https://ai.googleblog.com/2020/08/scaling-up-fundamental-quantum.html

機器學習的新方式

http://spectrum.ieee.org/tech-talk/robotics/artificial-intelligence/kickstarting-the-quantum-startup-a-hybrid-of-quantum-computing-and-machine-learning-is-spawning-new-ventures

如果經典機器學習算法的輸入來自小型量子計算,或者數據在量子域中表示并實現學習過程,這類問題通常可以歸類為優化范疇。對于開發者而言,要想尋求新穎的、改進的方法來利用目前以及未來不久的小型量子計算機,TensorFlow Quantum 提供了令人振奮的工具集。

不過,即使是那些小機器,性能也不是特別好。Q-CTRL 的量子固件可以讓用戶從硬件中獲取最大性能。因此我們看到,從量子固件到量子機器學習的算法,TensorFlow 在新興的量子計算軟件堆棧中都可以發揮關鍵作用。

責任編輯:xj

原文標題:“量子固件”來了!利用 TensorFlow 提升量子計算硬件性能

文章出處:【微信公眾號:TensorFlow】歡迎添加關注!文章轉載請注明出處。

-

固件

+關注

關注

10文章

560瀏覽量

23113 -

量子

+關注

關注

0文章

480瀏覽量

25528 -

量子計算

+關注

關注

4文章

1108瀏覽量

35002 -

tensorflow

+關注

關注

13文章

329瀏覽量

60583

原文標題:“量子固件”來了!利用 TensorFlow 提升量子計算硬件性能

文章出處:【微信號:tensorflowers,微信公眾號:Tensorflowers】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

量子通信與量子計算的關系

英偉達與谷歌攜手加速量子計算設備設計

華為公開量子計算新專利

利用AI構建實用量子計算應用

如何利用 TensorFlow 提升量子計算硬件性能

如何利用 TensorFlow 提升量子計算硬件性能

評論