英特爾公司與佐治亞理工學(xué)院將為美國國防部啟動一項為期4年的項目,以研發(fā)防御技術(shù),防止AI和ML系統(tǒng)被攻擊、欺騙。

蓋世汽車訊 據(jù)外媒報道,當?shù)貢r間4月9日,英特爾公司(Intel Corp.)與佐治亞理工學(xué)院(Georgia Institute of Technology)宣布將為美國國防先進研究計劃署(U.S. Defense Advanced Research Projects Agency)領(lǐng)導(dǎo)一個項目團隊,研發(fā)防御技術(shù),防止人工智能系統(tǒng)被攻擊和欺騙。

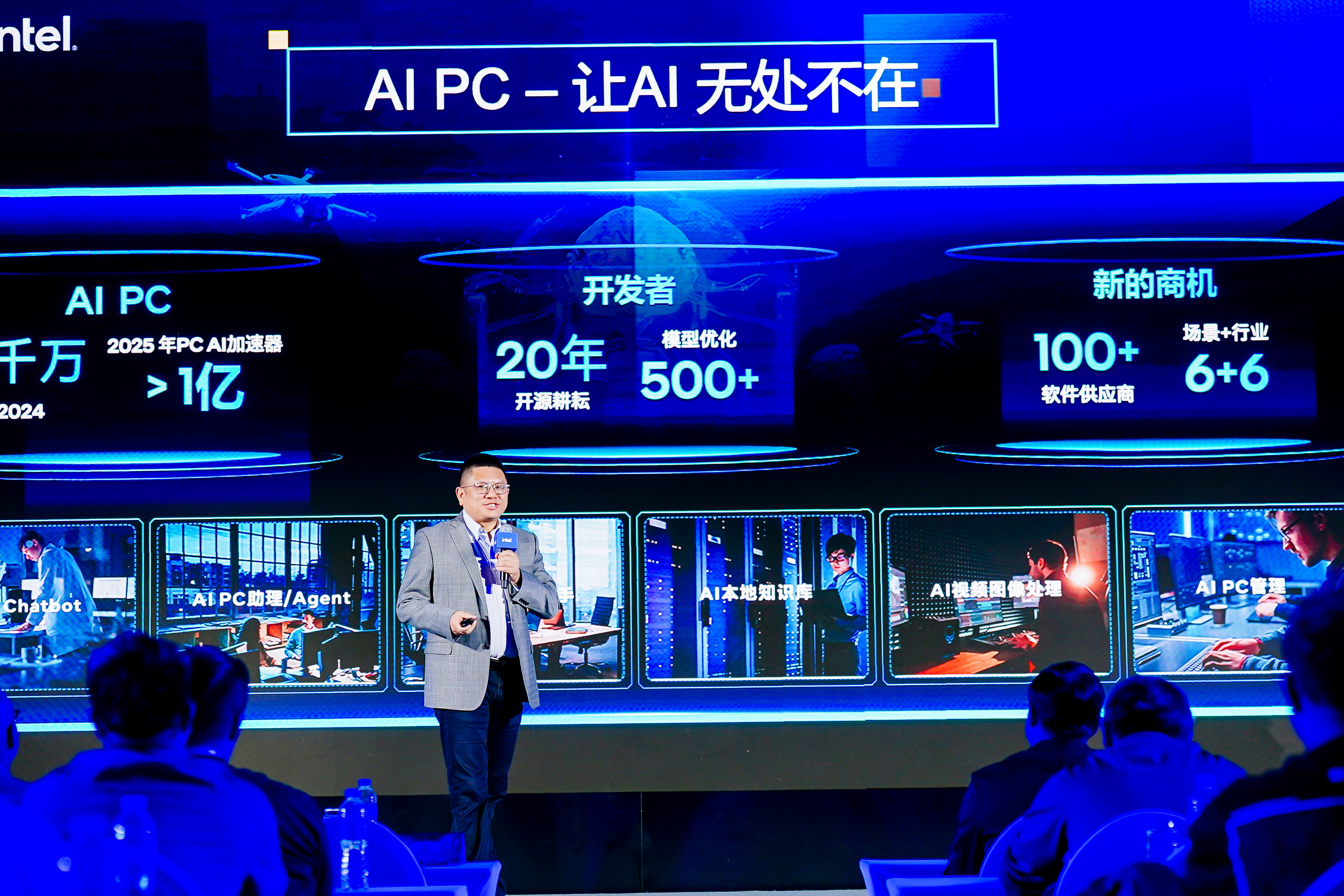

(圖片來源:英特爾)

該項目名為“確保人工智能足夠強大,以抵御欺騙”(Guaranteeing Artificial Intelligence Robustness against Deception,GARD),將持續(xù)4年,耗資數(shù)百萬美元,英特爾為主承包商,致力于改善網(wǎng)絡(luò)安全防御機制,防范會影響到機器學(xué)習(xí)模型的欺騙攻擊。

雖然針對機器學(xué)習(xí)(ML)系統(tǒng)的對抗性攻擊很少見,但是利用ML和AI進行操作的系統(tǒng)的數(shù)量在不斷增加。而此類技術(shù)是自動駕駛汽車等半自動和自動駕駛系統(tǒng)的重要部分,因此有必要繼續(xù)防止AI技術(shù)錯誤地對現(xiàn)實世界中的物體進行分類(例如,能夠區(qū)分停車標志與人類),因為在學(xué)習(xí)模型中插入有害信息或微微修改物體本身都會誤導(dǎo)物體識別。

GARD團隊的目標是為此類系統(tǒng)配備工具和增強性功能,更好地幫助其抵御此類攻擊。

其實,此類攻擊已經(jīng)出現(xiàn)多年。例如,2019年3月,騰訊科恩實驗室(Tencent’s Keen Security Lab)發(fā)布了一份報告,表示研究人員能夠利用貼在道路上的貼紙,誘使特斯拉Model S變道,并進入迎面而來的車流中。在2017年,研究人員3D打印了一種烏龜,而且配備了特別設(shè)計的外殼圖案,以欺騙谷歌的AI圖像識別算法,讓該算法誤認為烏龜是來復(fù)槍。

自此之后,研究人員一直在研究利用修改過的路標欺騙自動駕駛車輛的方法,例如,利用一塊黑色膠帶欺騙半自動駕駛汽車的攝像頭,讓其誤認為速度限制范圍比實際要更大。

因此,GARD的愿景是利用以前以及現(xiàn)在對影響計算機AI和ML視覺系統(tǒng)的缺陷和漏洞的研究,打造一個理論基礎(chǔ),幫助識別系統(tǒng)的漏洞,并確定極端情況的特征,以增強此類系統(tǒng)面對錯誤和攻擊的應(yīng)對能力。

在GARD項目的第一階段,英特爾和佐治亞理工學(xué)院將在靜態(tài)圖像和視頻中保持空間、時間和語義一致性,以提升物體識別能力,意味著AI和ML系統(tǒng)能夠在額外情境下得到訓(xùn)練,了解到在任何給定情況下會發(fā)生什么,并經(jīng)過設(shè)計,以標記場景或駁回不太可能的圖像場景。該階段的理念是通過在環(huán)境中引入更多解釋圖像的因素,開發(fā)出具有更好“判斷力”的AI。

例如,一名攻擊者可以通過改變停車標志,讓其外觀有點走樣,以欺騙AI,讓AI認為該停車標志不是一個停車標志。對于人類而言,該停車標志還是紅色、還是八角形的形狀,即使“停下”這個詞被改變了或者消失了,因而,大多數(shù)人類駕駛員還是會停車。不過,AI可能會誤解該標志,并繼續(xù)行駛。不過,如果能夠額外感知情境,即讓AI在識別十字路口、標志形狀、標志顏色等方面接受訓(xùn)練,就可以像人類駕駛員一樣,駁回錯誤的分類信息。

總而言之,英特爾和佐治亞理工學(xué)院的研究是為了實現(xiàn)更好的圖像識別系統(tǒng),以提高自動駕駛車輛的安全性,并讓各行業(yè)內(nèi)的ML系統(tǒng)能夠更好地分類物體。

-

英特爾

+關(guān)注

關(guān)注

61文章

10007瀏覽量

172145 -

人工智能

+關(guān)注

關(guān)注

1794文章

47634瀏覽量

239607

發(fā)布評論請先 登錄

相關(guān)推薦

嵌入式和人工智能究竟是什么關(guān)系?

《AI for Science:人工智能驅(qū)動科學(xué)創(chuàng)新》第一章人工智能驅(qū)動的科學(xué)創(chuàng)新學(xué)習(xí)心得

人工智能技術(shù)躍進:英特爾引領(lǐng)AI無處不在新紀元

英特爾攜手日企加碼先進封裝技術(shù)

英特爾帕特·基辛格:讓AI無處不在

英特爾人工智能創(chuàng)新應(yīng)用大賽最終獎項揭曉!酷睿Ultra助力選手創(chuàng)意開發(fā)

英特爾升級AI PC加速計劃

英特爾推動AI(人工智能)產(chǎn)業(yè)應(yīng)用型人才培養(yǎng)聚勢共贏

愛立信與英特爾攜手推動Open RAN與人工智能發(fā)展

新思科技與英特爾深化合作加速先進芯片設(shè)計

英特爾拿下微軟芯片代工訂單

英特爾首推面向AI時代的系統(tǒng)級代工—英特爾代工

英特爾研發(fā)防御技術(shù)可防止人工智能系統(tǒng)被攻擊

英特爾研發(fā)防御技術(shù)可防止人工智能系統(tǒng)被攻擊

評論