is user configured protected我能明白這個是因為 2104 一直處于掉電模式的原因,可是如何解除這種狀態,把現在FLASH 里的這段程序擦除掉啊

2023-04-19 14:30:25

1 個 AI 模型 = 5 輛汽車終身碳排量,AI 為何如此耗能?

2021-01-22 06:35:03

現在說AI是未來人類技術進步的一大方向,相信大家都不會反對。說到AI和芯片技術的關系,我覺得主要體現在兩個方面:第一,AI的發展要求芯片技術不斷進步;第二,AI可以幫助芯片技術向前發展。

2019-08-12 06:38:51

AI概念籠統,范圍廣大,到底什么才是AI的核心?手把手教你設計人工智能芯片及系統(全階設計教程+AI芯片FPGA實現+開發板)詳情鏈接:http://url.elecfans.com/u/c422a4bd15

2019-10-18 06:39:12

`自從AI概念被提出來,似乎很多東西都能跟它扯上點兒關系。比如——AI智能音箱。 當你為它接通電源,讓它為你放歌、報天氣和開燈時,你以為它真貼心。 不,真正貼心的是它—— 電源小板與主板相連 這個

2019-04-19 10:36:29

\"}\"

更換了x-cube-ai三個版本的庫(7.3.0/8.0.0/8.0.1),報錯都一樣。

求教ST官方是如何解決這個問題的?

2024-03-14 06:23:17

我知道當你有一個單端時鐘作為輸入時,你需要將它連接到全局時鐘的P引腳。當你有一個單端輸出時鐘時,你能把它放在N引腳上嗎?謝謝

2020-06-02 09:00:58

各位專家:兩塊AD9361開發板通信,發送板的I路和Q路發同樣的信號,接收板收到的I路和Q路數據會出現隨機的反向,即有時I路和Q路波形相同,有時I路和Q路波形反向。這種問題該如何解決呢?謝謝!

2018-08-03 07:42:56

在設計時對產品進行靜電干擾測試時,出現I2C的CLK被異常拉低,接上位機讀取I2C狀態寄存器,發現寄存器值有變化,這種問題如何解?

2020-02-07 15:23:49

Labview 似乎沒有繁體版? 這是在歧視彎彎嗎?最近發現 Labview 似乎沒有繁體版? 這是在歧視彎彎嗎?如果這樣的話 打開繁體的Labview程序 ,似乎不可避免的要出現亂碼了。你們是用 南極星 這樣的軟件 解決問題的嗎?

2016-04-16 14:51:25

本帖最后由 jinglixixi 于 2020-10-14 20:27 編輯

SLSTK3301A開發板被鎖定不能下載,該如何解鎖?

2020-10-13 15:46:11

STM32 不小心被鎖住,如何解開?具體實施辦法:1、按住單片機復位鍵不松開;2、同時下載程序3、彈出一個窗口,選擇NO4、再重新下載程序,即可。問題:STM32JTAG/SWD禁用導致無法燒寫由于

2022-01-10 08:02:03

大家好。 我在使用 X-CUBE-AI 7.1.0 版時遇到了問題。當我加載神經網絡的 TFlite 模型并生成代碼時,我在初始化輸入和輸出緩沖區時遇到了問題。特別是我對這個分配

2022-12-26 10:15:51

我想知道 X-CUBE-AI 和 NanoEdge AI Studio 在 ML 和 AI 開發環境中的區別。我可以在任何一個開發環境中做同樣的事情嗎?使用的設備有什么限制嗎?

2022-12-05 06:03:15

插入板子!運行程序出現這樣的。好像軟件好像沒辦法連接到板子。把那提示的文件夾里面的文件換了也沒用!還是一樣。求如何解決

2017-03-02 19:01:11

在使用cube-ai時,會彈出對話框,并一致卡死在0%,嘗試手動安裝GNU工具也無效。請問該如何解決?

2024-03-21 07:42:41

與喚醒4.3、前車拍4.4、駕駛行為分析算法4.5、車輛物體檢測及跟蹤算法5、基于HiSpark AI Camera制作3D打印外殼發布過的作品:關于NanoPi(RK3399)系列帖子,其中有兩篇被

2020-09-25 10:12:07

:cifar10_uint8.tflite問題描述:使用RT-AK部署成功后(CUBE-AI版本為7.0.0):在Studio更新軟件包,刷新后報錯:使用RT-AK部署成功后(CUBE-AI版本為5.2.0):在Studio更新軟件包,刷新后編譯成功:問題:為什么使用cube-ai 7.0.0 會報錯,如何解決這個問題

2022-04-24 09:52:26

為什么需要嵌入式AI?嵌入式AI還有瓶頸半導體廠商的新商機

2021-01-22 06:14:40

將數據導出到另一個平臺。自己做如果您想把數據保留在自己手中,您可以聘請自己的AI專家內部團隊。 如果AI是您的業務戰略的長期部分,這種方法是非常好的 然而,在競爭激烈的市場中聘請優秀人才需要較長

2017-09-25 10:03:05

什么是人工智能(AI)芯片?AI芯片的主要用處有哪些?在AI任務中,AI芯片到底有多大優勢?

2021-09-22 08:00:01

使用ENV生成工程時自己添加的文件被清如何解決呢

2022-12-01 15:11:36

前言:AI(人工智能),是目前科技行業最火的話題。從Alpha Go戰勝圍棋世界冠軍柯潔,到德勤與Kira Systems 聯手,將AI引入會計、稅務、審計等財務工作領域,可以看出,AI離我們的生活越來越近了。

2019-07-26 06:00:38

我用一個不超過聲卡允許輸入的正弦信號通過聲卡的line in輸入電腦,然后通過LV采集,采用的是范例里面那個,幅值為1,但是信號無論調多大,電腦接收的就只有0.5。請問聲卡采集信號和聲卡作為信號發生器輸入輸出被限幅如何解決??

2017-12-18 16:58:37

如何解決藍牙協議棧被鎖問題

2024-03-21 08:21:01

許多情況下也導致了錯誤看法的出現。AI是由偉大的思想家和學術研究者建立的,接著被世界各地的學術界和工業界進一步發展,它的發展速度比任何人所預料的都要快。事到如今,人類自身的生物局限性正日益成為創建智能

2019-05-06 16:46:05

`程序通過GPIB通訊,運行后提示圖中所示錯誤(未檢測到偵聽器條件(NRFD和NDAC被置為無效))錯誤代碼-1073807265,現在不知道這個錯誤的含義,不知道該如何解決,煩請各位幫忙給出個解決辦法,萬分感謝啊~~`

2018-04-02 14:12:39

。AI的演進速度要比它要處理的數據的演進快得多,所以這注定了它不僅折射和反映出過去的偏見,而且還延長并加強了它們。因此,當判斷被移交給機器之后,那些曾經是包括警察、法院在內的機構系統性歧視目標的群體

2018-06-02 12:51:50

將AI推向邊緣的影響通過在邊緣運行ML模型可以使哪些具體的AI項目更容易運行?

2021-02-23 06:21:10

,他應當尊重人類文化的多樣性。 隱私性原則。納德拉呼吁以精密的技術來保護個人和群體信息。 算法可靠準則。這樣一來,人類就可以解除AI帶來的意料之外的傷害。 防偏見準則。應該通過研究確保AI不會

2016-07-11 10:34:16

到的。硬件部分:daq卡外接了一個接線盒被擴展為64路ai,2路ao,8個io),據說是以前的某位前輩自己做的,沒有留下任何的說明;軟件部分:直接采用了daq自帶的vi,以ai_scan為例,ai

2015-08-12 11:47:53

請問大神,這種數據結構一般如何解析額。。 不太懂。。

2020-06-10 09:27:38

請問采集電壓的時候Instant AI和waveform AI有什么區別,我用的是熱電偶測溫,那我應該選擇哪種輸入

2017-05-20 11:51:28

自動駕駛車輛中的AI分析車輛中的AI應用

2021-03-09 07:53:23

不足,并不是因為她們在工作場所面臨偏見和歧視,而是由于男女之間固有的生物學上的差距,如果強行多元化,則對部分雇員不公道。在這封信被泄漏后,這名工程師立刻被Google CEO,印度裔的劈柴(Sundar

2017-08-15 10:36:25

汽車電池沒電了如何解決?教你“借電”技巧

要發動汽車,卻發現電池沒電了,想必許多人都遇到過這種情況。所以,如何正確“借電”也是開車的一門

2009-11-06 08:44:44 7603

7603 據《每日郵報》報道,計算機程序員們正試圖教育機器人減少性別歧視,其方法是幫助它們擺脫某些單詞所帶來的偏見。雖然計算機可能是中性的,但人類的偏見可能無意識地體現在對語言進行分析的機器學習算法。這種偏見

2017-09-20 09:32:48 0

0 偏見是人工智能面臨一個挑戰,主要是來自算法偏見,當然偏見并不止這些。與人類不同,算法不能撒謊,那么產生結果的不同必將是數據帶來的問題。人工智能算法及系統的測試與驗證,如何避免人工智能的偏見呢?

2018-02-06 14:04:36 11418

11418 人們都曾看過機器控制了世界而人類被毀滅的電影。好在這些電影是娛樂性的,而且人們都認為這些場景是不會發生的。然而,一個更應該關注的現實問題是:算法偏見。

2018-02-08 10:10:38 4361

4361 人工智能本來并不存在偏見,它不會因為無法通過邏輯來解釋的理由而“想”某些東西是真的或假的。不幸的是,從創建算法到解釋數據,機器學習中存在著人類的偏見,并且直到現在,幾乎沒有人試圖解決這個嚴重的問題。

2018-04-23 15:56:00 888

888 機器學習還能產生“偏見”?機器學習也會對數據產生偏見,從而導致錯誤的預測。我們該如何解決這一問題? Google的新論文或許會揭曉答案。機器學習中的機會均等 隨著機器學習計算穩步發展,越來越多人開始關注其對于社會的影響。機器學習的成功分支之一是監督學習。

2018-05-14 18:20:00 3168

3168

在我們的生活中,許多重要決策都是由某種系統做出的,很多系統都存在明顯的偏見,無論這系統是人、機器還是二者的組合。機器學習在決策制度中的作用越來越大,這為我們提供了一個建立更少偏見的系統的機會,當然也面臨著加劇這一問題的風險。

2018-06-23 12:34:00 621

621 IBM推出最新AI里程碑Project Debater,可創造引人入勝且信息豐富的無偏見觀點,有望幫助人類權衡重要決定。

2018-07-04 15:01:57 2786

2786 隨著人工智能(AI)技術的廣泛應用,確保AI技術沒有偏見變得越來越重要。IBM計劃發布一個大型的、無偏見的人臉圖像數據集,以推動無偏見的人臉識別研究。

2018-07-13 09:34:02 3898

3898 當使用谷歌翻譯將西班牙語的新聞翻譯為英語時,涉及到女性的短語通常都會翻譯為“他說”或“他寫道”。

2018-08-15 15:53:24 3188

3188 帶有這樣的偏見的詞嵌入模型,會給下游的NLP應用帶來嚴重問題。例如,基于詞嵌入技術的簡歷自動篩選系統或工作自動推薦系統,會歧視某種性別的候選人(候選人的姓名反映了性別)。除了造成這種明顯的歧視現象,有偏見的嵌入還可能暗中影響我們日常使用的NLP應用。

2018-09-23 09:25:00 3560

3560 10月4日,麻省理工學院計算機科學與人工智能實驗室(CSAIL)宣布與卡塔爾計算研究所(Qatar Computing Research Institute)合作,研究出一種可以鑒別信息來源準確性和個人政治偏見的AI系統。

2018-10-10 15:37:47 3654

3654 對于一直尋求智能化的亞馬遜而言,僅在倉儲和物流管理上使用AI技術是遠遠不能滿足的,因此這項2014年啟動的AI招聘原本是亞馬遜探尋進一步智能化的實驗,卻偏偏出了簍子。

2018-10-12 09:28:55 1671

1671 這種關于人AI技術的新立場是受到谷歌出現問題的影響而提出的。除了“大猩猩”事件之外,哈佛大學研究人員Latanya Sweeney發現谷歌搜索中的存在種族歧視。當搜索類似黑人名字時,會比搜索類似白人名字更有可能出現與“被逮捕”相關的廣告。

2018-11-12 10:22:44 2731

2731 人們都曾看過電影里機器控制了世界而人類被毀滅的場景。好在這些電影只是娛樂性的,現實世界是不會發生的。然而,一個更應該關注的問題是:算法偏見。

2018-11-15 14:57:37 3293

3293 等場景中時,更多關乎生命、公平、道德等的問題將會出現。此前,亞馬遜用AI招聘出現了性別歧視問題就是有力的證明。

2018-11-19 10:52:29 1341

1341 AI與女性之間的關系,似乎一直不太好。

提到AI,我們看到的往往是“AI篩選簡歷帶有性別歧視,更偏向于男性員工”“AI取代秘書、翻譯和速記正在讓女性失業”“一切AI助理都是女性配音加重男權主義

2018-12-23 10:08:51 2799

2799 IBM、谷歌、微軟、亞馬遜以及機器學習API提供商將發布更具包容性的數據集,以應對人工智能內嵌的歧視和偏見問題

2019-01-05 09:39:49 542

542 根據英國《自然·醫學》雜志8日在線發表的一篇論文,一款人工智能在接受上萬張真實患者面部圖像訓練后,能夠以高準確率識別罕見的遺傳綜合征。科學家同時強調,由于個人面部圖像是敏感但易得的數據,因此必須小心處理,以防該技術的歧視性濫用。

2019-03-10 10:52:26 229

229 科技中立,但人制造出來的 AI 卻可能帶有偏見或歧視。AI 偏見情況像是性別歧視、種族歧視,例如面部偵測算法在識別白人時的準確率比識別黑人高許多,男性跟女性類別也存在類似問題,讓軟件識別犯罪嫌犯人選、企業挑選求職者時,也曾引發歧視問題。

2019-02-13 08:47:33 421

421 AI Now研究院最近發布的一份報告發現,80%的AI教授、85%的Facebook公司AI研究人員以及90%的谷歌研究人員都是男性。另外,有色人種在大型科技企業員工當中的占比也非常有限。

2019-05-26 11:01:39 1035

1035 在大多數科幻電影里,冷漠又殘酷是 AI 的典型形象,它們從來不會考慮什么是人情世故,既沒有人性光輝的閃耀,也沒有人性墮落的七宗罪。

2019-06-13 16:25:10 431

431 在這個數據即生產力的時代,與互聯網時刻鏈接的我們正在數據AI的時代中不停地“裸奔”。

2019-09-09 14:45:32 466

466 這種按需網絡研討會演示了如何解決模擬混合信號設計挑戰增加可靠性和速度與AMS墊專業產品開發。

2019-10-18 07:08:00 3298

3298 啥是AI?很多人可能不知道如何回答。但其實,隨著自動駕駛、生物識別、智能機器人等的快速發展和應用,AI的概念早已變得日漸清晰。當你放下對AI的狹隘偏見,你會發現它不僅僅是震驚棋壇的阿法狗或者才藝

2019-10-27 12:31:00 468

468 你對AI有什么印象,沒有感情、不會犯錯,還是公正客觀?但總之,AI是不食人間煙火的,既不會閃耀人性的光輝,也不存在“七宗罪”。實際上,AI并非那么沒有人性,不過這并非一件好事。AI獲得智能的同時,也學會了人類的“歧視”與“偏見”。

2019-11-14 14:37:35 324

324 人們最初確實天真地以為,算法能比人類更能避免偏見。人工智能學習人類知識,同時也吸收人類偏見。這種擔憂由來已久。但谷歌的一項新發明極大推進了人工智能從文本材料中學習的速度,也使解決機器偏見問題迫在眉睫。

2019-11-26 17:19:12 641

641 AI正以相當顯眼得方式重塑著我們的世界,數據驅動著全球數字生態系統,AI技術則揭示了數據中的模式。智能手機,智能家居以及智慧城市在影響著我們生活和交互方式,AI系統越來越多用于公司招聘、醫療診斷和司法裁決。這是一個烏托邦時代還是反烏托邦時代,全看你怎么看。

2019-12-04 09:03:27 308

308 你對AI有什么印象,沒有感情、不會犯錯,還是公正客觀?但總之,AI是不食人間煙火的,既不會閃耀人性的光輝,也不存在“七宗罪”。實際上,AI并非那么沒有人性,不過這并非一件好事。AI獲得智能的同時,也學會了人類的“歧視”與“偏見”。

2019-12-25 15:25:41 416

416 隨著人工智能繼續進軍企業,許多IT專業人士開始對其使用的系統中可能存在的AI偏見表示擔憂。一份來自DataRobot的最新報告發現,美國和英國近一半的人工智能專業人士“非常”擔心人工智能的偏見。

2020-01-20 17:35:00 1169

1169 谷歌剛剛宣布,其使用AI工具的“谷歌云服務”將不再根據性別來標記人們。AI工具通過將人的圖像標記為“男人”或“女人”來識別個人的性別。盡管這是一種針對機器學習模型的訓練方法,但Google仍在使用它以避免性別偏見。

2020-03-20 09:56:04 521

521 不公正的數據集是偏見的土壤如果用于訓練機器學習算法的數據集無法代表客觀現實情況,那么這一算法的應用結果往往也帶有對特定群體的歧視和偏見。

2020-03-30 11:45:27 1332

1332 根據伯恩霍爾茨的說法,所有數據都是有偏見的,因為是人們在收集數據。她強調說:“而且我們正在將偏見建立到數據科學中,然后將這些工具導出到偏見系統中。” “你猜怎么著?問題變得越來越嚴重。因此,讓我們停止這樣做。”

2020-04-09 14:44:16 1598

1598 對于人類和機器而言,至關重要的原則是避免偏見并因此防止歧視。AI系統中的偏差主要發生在數據或算法模型中。在開發我們可以信賴的AI系統的過程中,至關重要的是使用無偏數據開發和訓練這些系統,并開發易于解釋的算法。

2020-04-11 09:57:20 1915

1915 諸如Facebook(我的前雇主),Google和Twitter之類的公司因各種帶有偏見的算法而反復受到攻擊。為了應對這些合理的恐懼,他們的領導人發誓要進行內部審計,并聲稱他們將與這一指數級威脅作斗爭。

2020-04-11 10:19:11 1521

1521 現在,我擔心我們會在人工智能方面走類似的道路。市場上的AI技術開始顯示有意和無意的偏見-從按人口統計或背景將候選人簡歷分組的人才搜索技術到不敏感的自動填充搜索算法。

2020-04-14 09:59:46 1584

1584 如何解決AI應用中出現的“數據孤島”和用戶隱私難題?國際人工智能聯合會議2019理事會主席、微眾銀行首席人工智能官楊強給出了解決方案:“聯邦學習或是解決這兩個核心問題的同一個解決思路。”

2020-04-15 17:33:20 3949

3949 人工智能在招聘中的應用有望將偏見最小化。

2020-04-17 15:53:06 688

688 通過與弗吉尼亞大學的研究人員合作,Salesforce 提出了有助于減輕 AI 性別偏見的新方法。 通常情況下,研究人員需要為 AI 模型投喂許多單次來展開訓練,但其中不可避免地會摻雜一些或隱性、或顯性的性別偏見。 然后在執行語言翻譯或其它預測任務的時候,這些 AI 也會沾染上一些不良習性。

2020-07-05 09:31:48 2007

2007

以Allegheny家庭篩選工具為例。它旨在預測哪些福利兒童可能會受到養父母虐待的威脅。但是,此解決方案的最初推出面臨一些挑戰。當地的人類服務部承認該工具可能存在種族和收入偏見。

2020-07-07 14:26:10 1720

1720 親自處理AI偏見的人表示自己的偏見已減少。例如,愛立信使用情景規劃方法來挑戰整個組織的戰略思維,并在戰略制定過程的多個階段測試和篩選偏見(Gartner 在“研發決策的常見認知偏見”中對此進行了描述)。

2020-08-12 16:28:19 623

623 隨著人工智能在企業和社會的應用變得越來越普遍,企業需要注意機器模型中不斷涌現的人類偏見。企業可以利用人類的智慧來獲取訓練算法所需的各種數據和輸入。

2020-09-24 14:35:47 1196

1196 其中一份報告側重于如何確保安全,透明和問責制,防止偏見和歧視,促進社會和環境責任以及確保尊重基本權利。報告的作者伊班·加西亞·布蘭科(IbánGarcíadel Blanco)說:“公民是這項建議的核心。”

2020-10-24 10:06:03 2692

2692 !然而,這完全是萬無一失的還是不偏不倚的?這種現代科技能像人類一樣容易產生偏見嗎? 偏差風險因業務、行業和組織而異。他們可以通過多種方式進入人工智能系統。例如,它可以被有意地通過隱形攻擊引入人工智能系統,也可以

2021-02-26 12:08:40 2259

2259 法國私營部門的AI用戶告訴FRA,識別AI中的歧視非常復雜,“因為某些種族中某些疾病的發病率更高。預測要考慮到性別,種族,遺傳特征。但這不是歧視或侵犯人權。”

2020-12-16 09:22:50 1241

1241 在我們的世界里,算法無處不在,偏見也是一樣。從社會媒體新聞的提供到流式媒體服務的推薦到線上購物,計算機算法,尤其是機器學習算法,已經滲透到我們日常生活的每一個角落。至于偏見,我們只需要參考 2016 年美國大選就可以知道,偏見是怎樣在明處與暗處影響著我們的社會。

2020-12-25 19:12:28 468

468 隨著人工智能技術研究不斷推薦,由算法生成的藝術作品的受歡迎程度也在持續增長。從創作繪畫到發明新的藝術風格,基于人工智能的生成藝術已經在一系列的應用中展示。

2020-12-29 14:30:01 1602

1602 本篇連載文章中,我們將討論哪些AI應用能真正從這種方法中受益。

2022-02-11 11:11:24 504

504 ? 據本周四披露的法庭文件顯示,美國司法部正在調查 SpaceX 公司是否在雇傭中歧視非美國公民。文件還表示,SpaceX 正在阻撓法院傳喚,拒絕提供信息。 此前,美國司法部的移民和雇員權利部門收到

2021-02-01 09:03:00 918

918 日本富士通的一支研究團隊利用有向無環圖模型(DAG)研究AI生成藝術中的偏見現象。該研究發現,目前的AI模型在藝術創作時展現出對特定流派、創作風格、種族、思想運動等因素的明顯傾向性。 據分析,這種

2021-04-19 14:33:16 1409

1409

本文介紹了EPON在無線通信體系中的網絡結構及工作原理,分析了這種接入方式如何解決小區切換及微移動問題,最后探討了這種應用的特點及優勢。

2021-06-14 11:49:00 2478

2478

得益于神經機器翻譯 (NMT) 的進步,譯文更加自然流暢,但與此同時,這些譯文也反映出訓練數據存在社會偏見和刻板印象。因此,Google 持續致力于遵循 AI 原則,開發創新技術,減少機器翻譯

2021-08-24 10:14:42 2515

2515 人工智能風險管理旨在最大限度地減少人工智能的負面影響,包括對公民自由和權利的威脅等。而在談論人工智能風險時,“偏見”是一個重要話題。

2022-04-17 10:21:12 1182

1182 了解如何在訓練您的 AI 驅動系統時避免數據集、關聯、自動化和其他類型的偏見。 科技行業對人工智能的使用越來越興奮,因為它開辟了新的引人入勝的體驗,并為企業家和最終用戶帶來了前所未有的效率。但是

2022-07-30 11:19:58 3865

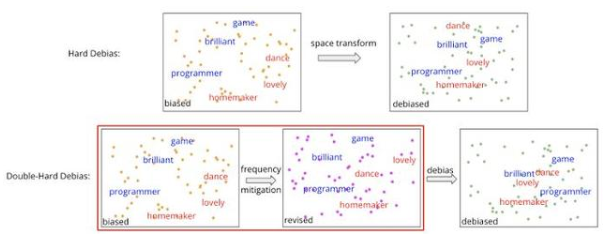

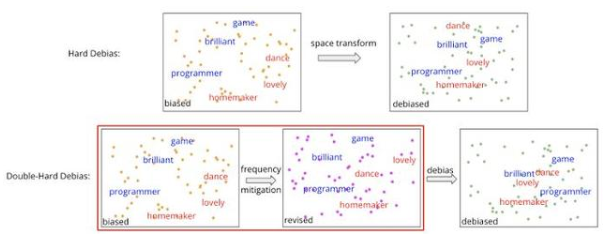

3865 大規模語言模型(LMs)已經成為了現在自然語言處理的關鍵技術,但由于訓練語料中常帶有主觀的性別偏見、歧視等,在大模型的使用過程中,它們時常會被放大,因此探測和緩解數據中的性別偏見變得越來越重要。

2023-02-10 13:49:39 441

441 當你老了,科技AI你。

2023-03-12 18:21:55 266

266 人工智能系統需要使用數據進行訓練。但數據集往往是由有偏見或不準確的人制作的。因此,人工智能系統會使偏見長期存在。在招聘實踐和刑事司法中尤其如此,管理這些偏見可能很困難。

2023-11-16 10:21:36 245

245 13、如何解決直插差模電感的異響

2023-11-20 09:35:05 3

3 TechCrunch獲取的文件要求,科技企業需保證其服務或產品“杜絕所有形式的偏見與歧視”。雖然此文件無法律約束力,但印度信息技術部副部長錢德拉塞卡爾坦言,這個通知預示著未來監管趨向。

2024-03-04 17:05:17 277

277

電子發燒友App

電子發燒友App

評論