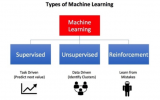

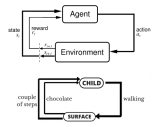

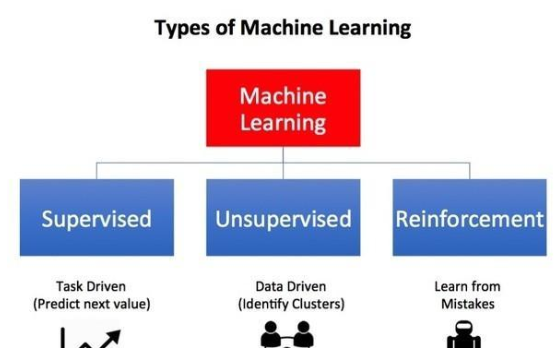

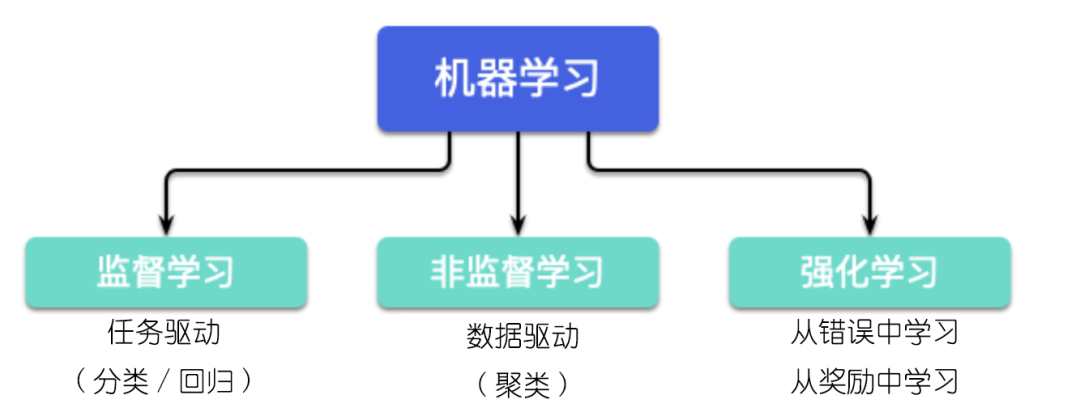

強化學(xué)習(xí)屬于機器學(xué)習(xí)中的一個子集,它使代理能夠理解在特定環(huán)境中執(zhí)行特定操作的相應(yīng)結(jié)果。目前,相當(dāng)一部分機器人就在使用強化學(xué)習(xí)掌握種種新能力。

強化學(xué)習(xí)是一種行為學(xué)習(xí)模型,由算法提供數(shù)據(jù)分析反饋,引導(dǎo)用戶逐步獲取最佳結(jié)果。

不同于使用樣本數(shù)據(jù)集訓(xùn)練機器模型的各類監(jiān)督學(xué)習(xí),強化學(xué)習(xí)嘗試通過反復(fù)試驗掌握個中訣竅。通過一系列正確的決策,模型本身將得到逐步強化,慢慢掌控解決問題的更佳方法。

強化學(xué)習(xí)與人類在嬰幼兒時期的學(xué)習(xí)過程非常相似。我們每個人的成長都離不開這種學(xué)習(xí)強化——正是在一次又一次跌倒與父母的幫扶之下,我們才最終站立起來。

這是一種基于經(jīng)驗的學(xué)習(xí)流程,機器會不斷嘗試、不斷犯錯,最終找到正確的解決思路。

我們只需要為機器模型提供最基本的“游戲規(guī)則”,余下的就完全交給模型自主探索。模型將從隨機嘗試開始,一步步建立起自己的復(fù)雜戰(zhàn)術(shù),通過無數(shù)次嘗試達(dá)成任務(wù)、獲得獎勵。

事實證明,強化學(xué)習(xí)已經(jīng)成為培養(yǎng)機器人想象力的重要方法之一。不同于普通人類,人工智能將從成千上萬輪游戲中積累知識,而強大的計算機基礎(chǔ)設(shè)施則為這類模型提供可靠的算力支持。

YouTube上的視頻就是強化學(xué)習(xí)的應(yīng)用實例。在觀看當(dāng)前視頻之后,該平臺會向你展示它認(rèn)為你可能感興趣的類似內(nèi)容。如果你點開了推薦視頻但卻沒有看完,機器會認(rèn)為此次推薦失敗,并在下一次嘗試其他推薦方法。

強化學(xué)習(xí)的挑戰(zhàn)

強化學(xué)習(xí)面對的核心挑戰(zhàn),在于如何規(guī)模模擬環(huán)境。模擬環(huán)境在很大程度上由有待執(zhí)行的任務(wù)所決定。我們以國際象棋、圍棋或者雅達(dá)利游戲為例,這類模擬環(huán)境相對簡單也易于構(gòu)建。但是,要想用同樣的方法訓(xùn)練出安全可靠的自動駕駛汽車,就必須創(chuàng)建出非常逼真的街道原型環(huán)境,引入突然闖出的行人或者可能導(dǎo)致碰撞事故的各類因素。如果仿真度不夠,那么模型在從訓(xùn)練環(huán)境轉(zhuǎn)移到現(xiàn)實場景之后,就會出現(xiàn)一系列問題。

另一個難題,在于如何擴展及修改代理的神經(jīng)網(wǎng)絡(luò)。除了獎勵與處罰之外,我們再無其他方法與該網(wǎng)絡(luò)建立聯(lián)系。這有可能引發(fā)嚴(yán)重的“健忘”癥狀,即網(wǎng)絡(luò)在獲取新信息后,會將一部分可能非常重要的舊知識清除出去。換句話說,我們需要想辦法管理學(xué)習(xí)模型的“記憶”。

最后,我們還得防止機器代理“作弊”。有時候,機器模型能夠獲得良好的結(jié)果,但實現(xiàn)方式卻與我們的預(yù)期相去甚遠(yuǎn)。一部分代理甚至?xí)诓煌瓿蓪嶋H任務(wù)的情況下,通過“渾水摸魚”拿到最大獎勵。

強化學(xué)習(xí)的應(yīng)用領(lǐng)域

游戲

機器學(xué)習(xí)之所以具有極高的知名度,主要源自它在解決各類游戲問題時展現(xiàn)出的驚人實力。

最著名的自然是AlphaGo與AlphaGo Zero。AlphaGo通過無數(shù)人類棋手的棋譜進行大量訓(xùn)練,憑借策略網(wǎng)絡(luò)中的蒙特卡洛樹價值研究與價值網(wǎng)絡(luò)(MCTS)獲得了超人的棋力。但研究人員隨后又嘗試了另一種更加純粹的強化學(xué)習(xí)方法——從零開始訓(xùn)練機器模型。最終,新的代理AlphaGo Zero出現(xiàn),其學(xué)習(xí)過程完全源自自主摸索、不添加任何人為數(shù)據(jù),最終以100-0的碾壓性優(yōu)勢戰(zhàn)勝了前輩AlphaGo。

個性化推薦

新聞內(nèi)容推薦是一項歷史性難題,快速變化的新聞動態(tài)、隨時可能轉(zhuǎn)變的用戶喜好再加上與用戶留存率若即若離的點擊率都讓研究人員頭痛不已。Guanjie等研究者發(fā)布的《DRN:用于新聞推薦的深度強化學(xué)習(xí)框架》一文,希望探討如何將強化學(xué)習(xí)技術(shù)應(yīng)用于新聞推薦系統(tǒng)以攻克這一重大挑戰(zhàn)。

為此,他們構(gòu)建起四種資源類別,分別為:1)用戶資源;2)上下文資源(例如環(huán)境狀態(tài)資源);3)用戶新聞資源;4)新聞資源(例如行動資源)。他們將這四種資源插入深度Q網(wǎng)絡(luò)(DQN)以計算Q值。隨后,他們以Q值為基礎(chǔ)選擇一份新聞列表進行推薦,并將用戶對推薦內(nèi)容的點擊情況作為強化學(xué)習(xí)代理的重要獎勵指標(biāo)。

作者們還采用其他技術(shù)以解決相關(guān)難題,包括記憶重復(fù)、生存模型、Dueling Bandit Gradient Descent等方法。

計算機集群中的資源管理

如何設(shè)計算法以將有限的資源分配給不同任務(wù)同樣是一項充滿挑戰(zhàn)的課題,而且往往需要人為啟發(fā)的引導(dǎo)。

題為《使用深度強化學(xué)習(xí)實現(xiàn)資源管理》的論文介紹了如何使用強化學(xué)習(xí)讓模型自動探索如何為保留的作業(yè)分配及調(diào)度計算機資源,借此最大程度降低平均作業(yè)(任務(wù))的處理時長。

這種方法用“狀態(tài)空間”來表現(xiàn)當(dāng)前資源分配與作業(yè)的資源配置方式。而在行動空間方面,他們使用一種技巧,允許代理在各個時間階段選擇多項行動。獎勵則是系統(tǒng)中所有作業(yè)的總和(-1/作業(yè)持續(xù)時間)。接下來,他們將強化學(xué)習(xí)算法與基準(zhǔn)值相結(jié)合,借此計算策略梯度,找出最佳策略參數(shù),憑借這些參數(shù)計算出能夠?qū)崿F(xiàn)目標(biāo)最小化的行動概率分布。

交通燈控制

在題為《基于強化學(xué)習(xí)的多代理交通信號網(wǎng)絡(luò)控制系統(tǒng)》一文中,研究人員嘗試設(shè)計一種交通信號燈控制方案,借此解決交通擁堵問題。他們的方法僅在模擬環(huán)境下進行了測試,并表現(xiàn)出優(yōu)于傳統(tǒng)方法的性能水平,這也體現(xiàn)出在交通系統(tǒng)設(shè)計中引入多代理強化學(xué)習(xí)技術(shù)的潛在可行性。

他們在五個路口的交通網(wǎng)絡(luò)中部署了五個代理,并在中央路口處部署強化學(xué)習(xí)代理以控制交通信號。他們將交通狀態(tài)定義為8維向量,每個元素代表各條車道的相對交通流量。每個代理可以從8種選項中任選其一,各選項代表每個階段的組合,獎勵條件則是新的組合必須在交通流量延遲方面優(yōu)于前一組合。作者們使用SQN計算{狀態(tài),行動}對的Q值。

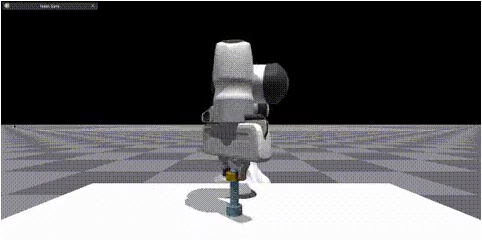

機器人

強化學(xué)習(xí)在機器人技術(shù)領(lǐng)域的應(yīng)用同樣大放異彩。感興趣的朋友請關(guān)注強化學(xué)習(xí)在機器人領(lǐng)域的研究成果。在這方面,研究人員們通過訓(xùn)練引導(dǎo)機器人學(xué)習(xí)策略,嘗試將原始視頻圖像與機器人的行動映射起來。將RGB圖像輸入CNN進行計算,最終輸出的則是各臺驅(qū)動引擎的扭矩。強化學(xué)習(xí)組件負(fù)責(zé)根據(jù)訓(xùn)練數(shù)據(jù)中的狀態(tài)分布總結(jié)出準(zhǔn)確的轉(zhuǎn)換策略。

網(wǎng)絡(luò)系統(tǒng)配置

網(wǎng)絡(luò)系統(tǒng)當(dāng)中往往包含超過100項可配置參數(shù),而參數(shù)調(diào)整過程則需要合格的操作人員持續(xù)進行跟蹤與錯誤測試。

題為《強化在線網(wǎng)絡(luò)系統(tǒng)自我配置能力的學(xué)習(xí)方法》的論文,介紹了研究人員如何在基于動態(tài)虛擬機的環(huán)境中自動重新配置多層網(wǎng)絡(luò)系統(tǒng)內(nèi)各項參數(shù)的首次嘗試。

研究人員可以將重新配置的流程公式化為有限MDP(馬爾科夫決策流程)的形式。其中的狀態(tài)空間為系統(tǒng)配置,各參數(shù)的行動空間則包括{增加,減少,保持不變}。獎勵被定義為預(yù)期響應(yīng)時間與實測響應(yīng)時間之差。作者使用Q學(xué)習(xí)算法執(zhí)行這項任務(wù)。

當(dāng)然,作者也使用了其他一些技術(shù)(例如策略初始化)以解決較大狀態(tài)空間與復(fù)雜問題場景下的計算難度問題,因此并不能算單純依靠強化學(xué)習(xí)與神經(jīng)網(wǎng)絡(luò)組合實現(xiàn)。但可以相信,這項開拓性工作為未來的探索鋪平了道路。

化學(xué)

強化學(xué)習(xí)在優(yōu)化化學(xué)反應(yīng)方面同樣表現(xiàn)出色。研究人員們發(fā)現(xiàn),他們的模型已經(jīng)摸索出極為先進的算法,《通過深度強化學(xué)習(xí)優(yōu)化化學(xué)反應(yīng)》一文還探討了如何將這種算法推廣到多種不同的潛在場景當(dāng)中。

配合LSTM(長短期記憶網(wǎng)絡(luò))對策略特征進行建模,強化學(xué)習(xí)代理通過以{S,A,P,R}為特征的馬爾科夫決策流程(MDP)優(yōu)化了化學(xué)反應(yīng)。其中的S代表一組實驗條件(例如溫度、pH等),A為可以調(diào)整的一切可能行動的集合,P為從當(dāng)前實驗條件轉(zhuǎn)換至下一條件的概率,R則為狀態(tài)獎勵函數(shù)。

這套應(yīng)用方案很好地演示了強化學(xué)習(xí)技術(shù)如何在相對穩(wěn)定的環(huán)境下減少試錯次數(shù)并縮短學(xué)習(xí)周期。

拍賣與廣告

阿里巴巴公司的研究人員發(fā)表了《在廣告展示中采用多代理強化學(xué)習(xí)進行實時競拍》一文,表示其基于集群的分布式多代理解決方案(DCMAB)取得了可喜的成果,并計劃在下一步研究中投放淘寶平臺進行實際測試。

總體而言,淘寶廣告平臺負(fù)責(zé)為經(jīng)銷商提供可供競拍的廣告展示區(qū)域。目前大多數(shù)代理無法快速解決這個問題,因為交易者往往互相競標(biāo),而且出價往往與其業(yè)務(wù)及決策密切相關(guān)。在這篇論文中,研究人員將商戶與客戶劃分為不同的組以降低計算復(fù)雜性。各代理的狀態(tài)空間表示代理本身的成本-收入狀態(tài),行動空間為(連續(xù))競標(biāo),獎勵則為客戶集群收入。

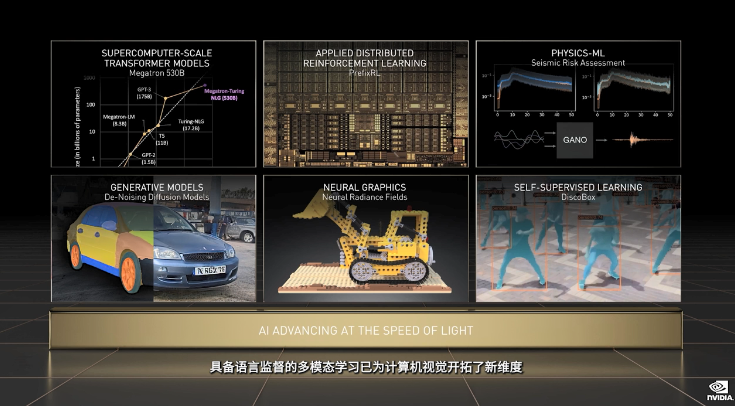

近期,越來越多研究人員開始嘗試將強化學(xué)習(xí)與其他深度學(xué)習(xí)架構(gòu)相結(jié)合,并帶來了令人印象深刻的成果。

其中最具影響力的成果之一,正是DeepMind將CNN與強化學(xué)習(xí)相結(jié)合做出的嘗試。以此為基礎(chǔ),代理可以通過高維傳感器“觀察”環(huán)境,而后學(xué)習(xí)如何與之交互。

CNN配合強化學(xué)習(xí)已經(jīng)成為人們探索新思路的有力組合。RNN是一種具有“記憶”的神經(jīng)網(wǎng)絡(luò)。與強化學(xué)習(xí)結(jié)合使用,RNN將為代理提供記憶能力。例如,研究人員將LSTM與強化學(xué)習(xí)進行組合,創(chuàng)建出一套深循環(huán)Q網(wǎng)絡(luò)(DRQN)并學(xué)習(xí)如何游玩雅達(dá)利游戲。他們還使用LSTM加強化學(xué)習(xí)解決了化學(xué)反應(yīng)優(yōu)化問題。

DeepMind還展示了如何使用生成模型與強化學(xué)習(xí)生成程序。在這套模型中,以對抗方式訓(xùn)練而成的代理會將對抗信號作為改善行動的獎勵,這種方式與GAN(生成對抗網(wǎng)絡(luò))將梯度傳播至入口空間的方法有所不同。

總結(jié):何時開始使用強化學(xué)習(xí)?

所謂強化,是指根據(jù)制定的決策配合獎勵摸索最佳方法;這類能夠隨時與環(huán)境交互并從中學(xué)習(xí)。每做出一項正確行動,我們都將予以獎勵;錯誤行動則對應(yīng)懲罰。在行業(yè)當(dāng)中,這類學(xué)習(xí)方法將有助于優(yōu)化流程、模擬、監(jiān)控、維護并有望催生出強大的自治型系統(tǒng)。

大家可以參考以下標(biāo)準(zhǔn)思考何時在何處使用強化學(xué)習(xí)技術(shù):

? 需要對復(fù)雜甚至存在一定危險性的特定流程進行模擬時。

? 處理某些需要大量人類分析師及領(lǐng)域?qū)<业奶囟▎栴}時。強化學(xué)習(xí)方法能夠模仿人類的推理過程,而非單純預(yù)測最佳策略。

? 能夠為學(xué)習(xí)算法提供良好的獎勵定義時。你可以在每次交互中正確對模型進行校準(zhǔn),借此保證獎勵總比懲罰多,幫助模型逐步摸索出正確的解決路線。

? 當(dāng)缺少關(guān)于特定問題的充足數(shù)據(jù)時。除了工業(yè)領(lǐng)域之外,強化學(xué)習(xí)也廣泛適用于教育、衛(wèi)生、金融、圖像以及文本識別等各個行業(yè)。

除了工業(yè)領(lǐng)域之外,強化學(xué)習(xí)也廣泛適用于教育、衛(wèi)生、金融、圖像以及文本識別等各個行業(yè)。

責(zé)編AJX

電子發(fā)燒友App

電子發(fā)燒友App

評論