互聯(lián)網(wǎng)是由一個(gè)個(gè)站點(diǎn)和網(wǎng)絡(luò)設(shè)備組成的大網(wǎng),我們通過瀏覽器訪問站點(diǎn),站點(diǎn)把HTML、JS、CSS代碼返回給瀏覽器,這些代碼經(jīng)過瀏覽器解析、渲染,將豐富多彩的網(wǎng)頁呈現(xiàn)我們眼前。

一、爬蟲是什么?

如果我們把互聯(lián)網(wǎng)比作一張大的蜘蛛網(wǎng),數(shù)據(jù)便是存放于蜘蛛網(wǎng)的各個(gè)節(jié)點(diǎn),而爬蟲就是一只小蜘蛛,沿著網(wǎng)絡(luò)抓取自己的獵物(數(shù)據(jù))爬蟲指的是:向網(wǎng)站發(fā)起請(qǐng)求,獲取資源后分析并提取有用數(shù)據(jù)的程序。

從技術(shù)層面來說就是 通過程序模擬瀏覽器請(qǐng)求站點(diǎn)的行為,把站點(diǎn)返回的HTML代碼/JSON數(shù)據(jù)/二進(jìn)制數(shù)據(jù)(圖片、視頻) 爬到本地,進(jìn)而提取自己需要的數(shù)據(jù),存放起來使用;

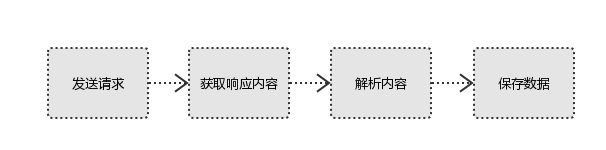

二、爬蟲的基本流程

用戶獲取網(wǎng)絡(luò)數(shù)據(jù)的方式:

方式1:瀏覽器提交請(qǐng)求--->下載網(wǎng)頁代碼--->解析成頁面

方式2:模擬瀏覽器發(fā)送請(qǐng)求(獲取網(wǎng)頁代碼)->提取有用的數(shù)據(jù)->存放于數(shù)據(jù)庫或文件中

爬蟲要做的就是方式2。

1、發(fā)起請(qǐng)求

使用http庫向目標(biāo)站點(diǎn)發(fā)起請(qǐng)求,即發(fā)送一個(gè)Request

Request包含:請(qǐng)求頭、請(qǐng)求體等

Request模塊缺陷:不能執(zhí)行JS 和CSS 代碼

2、獲取響應(yīng)內(nèi)容

如果服務(wù)器能正常響應(yīng),則會(huì)得到一個(gè)Response

Response包含:html,json,圖片,視頻等

3、解析內(nèi)容

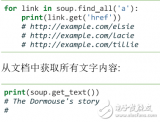

解析html數(shù)據(jù):正則表達(dá)式(RE模塊),第三方解析庫如Beautifulsoup,pyquery等

解析json數(shù)據(jù):json模塊

解析二進(jìn)制數(shù)據(jù):以wb的方式寫入文件

4、保存數(shù)據(jù)

數(shù)據(jù)庫(MySQL,Mongdb、Redis)

文件

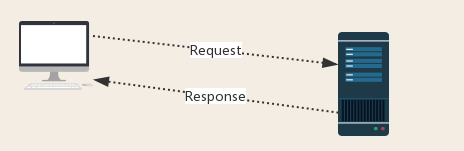

三、http協(xié)議 請(qǐng)求與響應(yīng)

Request:用戶將自己的信息通過瀏覽器(socket client)發(fā)送給服務(wù)器(socket server)

Response:服務(wù)器接收請(qǐng)求,分析用戶發(fā)來的請(qǐng)求信息,然后返回?cái)?shù)據(jù)(返回的數(shù)據(jù)中可能包含其他鏈接,如:圖片,js,css等)

ps:瀏覽器在接收Response后,會(huì)解析其內(nèi)容來顯示給用戶,而爬蟲程序在模擬瀏覽器發(fā)送請(qǐng)求然后接收Response后,是要提取其中的有用數(shù)據(jù)。

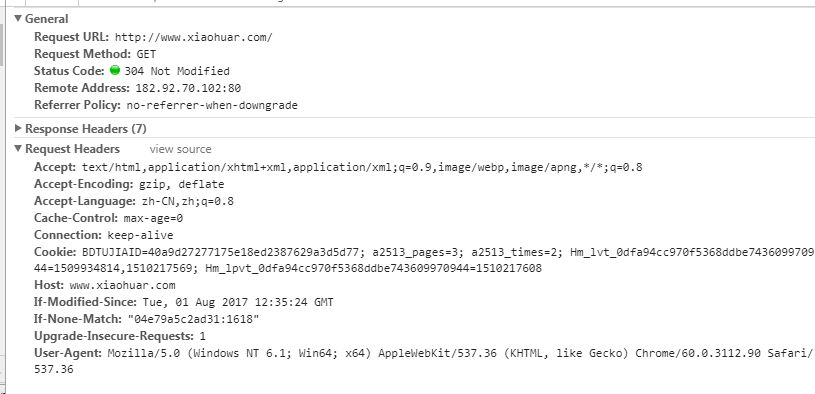

四、 request

1、請(qǐng)求方式:

常見的請(qǐng)求方式:GET / POST

2、請(qǐng)求的URL

url全球統(tǒng)一資源定位符,用來定義互聯(lián)網(wǎng)上一個(gè)唯一的資源 例如:一張圖片、一個(gè)文件、一段視頻都可以用url唯一確定

url編碼

https://www.baidu.com/s?wd=圖片

圖片會(huì)被編碼(看示例代碼)

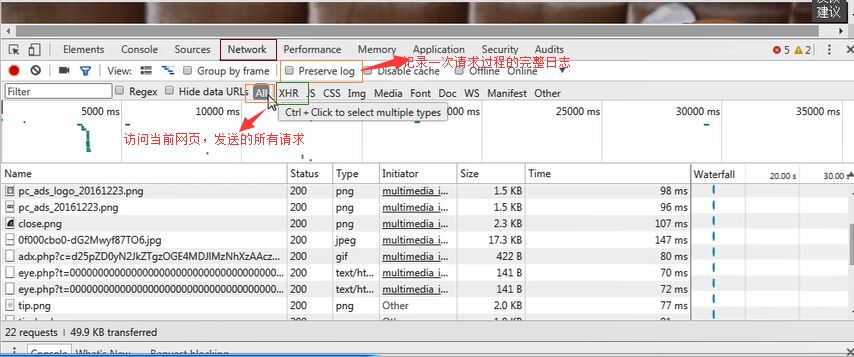

網(wǎng)頁的加載過程是:

加載一個(gè)網(wǎng)頁,通常都是先加載document文檔,

在解析document文檔的時(shí)候,遇到鏈接,則針對(duì)超鏈接發(fā)起下載圖片的請(qǐng)求

3、請(qǐng)求頭

User-agent:請(qǐng)求頭中如果沒有user-agent客戶端配置,服務(wù)端可能將你當(dāng)做一個(gè)非法用戶host;

cookies:cookie用來保存登錄信息

注意:一般做爬蟲都會(huì)加上請(qǐng)求頭

請(qǐng)求頭需要注意的參數(shù):

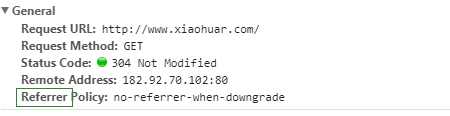

(1)Referrer:訪問源至哪里來(一些大型網(wǎng)站,會(huì)通過Referrer 做防盜鏈策略;所有爬蟲也要注意模擬)

(2)User-Agent:訪問的瀏覽器(要加上否則會(huì)被當(dāng)成爬蟲程序)

(3)cookie:請(qǐng)求頭注意攜帶

4、請(qǐng)求體

如果是get方式,請(qǐng)求體沒有內(nèi)容 (get請(qǐng)求的請(qǐng)求體放在 url后面參數(shù)中,直接能看到)如果是post方式,請(qǐng)求體是format data

ps:

1、登錄窗口,文件上傳等,信息都會(huì)被附加到請(qǐng)求體內(nèi)

2、登錄,輸入錯(cuò)誤的用戶名密碼,然后提交,就可以看到post,正確登錄后頁面通常會(huì)跳轉(zhuǎn),無法捕捉到post

五、 響應(yīng)Response

1、響應(yīng)狀態(tài)碼

200:代表成功

301:代表跳轉(zhuǎn)

404:文件不存在

403:無權(quán)限訪問

502:服務(wù)器錯(cuò)誤

2、respone header

響應(yīng)頭需要注意的參數(shù):

(1)Set-Cookie:BDSVRTM=0; path=/:可能有多個(gè),是來告訴瀏覽器,把cookie保存下來

(2)Content-Location:服務(wù)端響應(yīng)頭中包含Location返回瀏覽器之后,瀏覽器就會(huì)重新訪問另一個(gè)頁面

3、preview就是網(wǎng)頁源代碼

JSO數(shù)據(jù)

如網(wǎng)頁html,圖片

二進(jìn)制數(shù)據(jù)等

六、總結(jié)

1、總結(jié)爬蟲流程:

爬取--->解析--->存儲(chǔ)

2、爬蟲所需工具:

請(qǐng)求庫:requests,selenium(可以驅(qū)動(dòng)瀏覽器解析渲染CSS和JS,但有性能劣勢(shì)(有用沒用的網(wǎng)頁都會(huì)加載);)解析庫:正則,beautifulsoup,pyquery存儲(chǔ)庫:文件,MySQL,Mongodb,Redis

基于搜狗微信搜索的微信公眾號(hào)爬蟲接口,可以擴(kuò)展成基于搜狗搜索的爬蟲,返回結(jié)果是列表,每一項(xiàng)均是公眾號(hào)具體信息字典。

DouBanSpider [2]- 豆瓣讀書爬蟲。可以爬下豆瓣讀書標(biāo)簽下的所有圖書,按評(píng)分排名依次存儲(chǔ),存儲(chǔ)到Excel中,可方便大家篩選搜羅,比如篩選評(píng)價(jià)人數(shù)>1000的高分書籍;可依據(jù)不同的主題存儲(chǔ)到Excel不同的Sheet ,采用User Agent偽裝為瀏覽器進(jìn)行爬取,并加入隨機(jī)延時(shí)來更好的模仿瀏覽器行為,避免爬蟲被封。

-

互聯(lián)網(wǎng)

+關(guān)注

關(guān)注

54文章

11171瀏覽量

103526 -

python

+關(guān)注

關(guān)注

56文章

4800瀏覽量

84844

原文標(biāo)題:想成為Python高手,必須看這篇爬蟲原理介紹!(附29個(gè)爬蟲項(xiàng)目)

文章出處:【微信號(hào):mcuworld,微信公眾號(hào):嵌入式資訊精選】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

Python數(shù)據(jù)爬蟲學(xué)習(xí)內(nèi)容

Python爬蟲與Web開發(fā)庫盤點(diǎn)

0基礎(chǔ)入門Python爬蟲實(shí)戰(zhàn)課

Python爬蟲簡(jiǎn)介與軟件配置

python網(wǎng)絡(luò)爬蟲概述

python爬蟲入門教程之python爬蟲視頻教程分布式爬蟲打造搜索引擎

python爬蟲框架有哪些

Python爬蟲:使用哪種協(xié)議的代理IP最佳?

python實(shí)現(xiàn)簡(jiǎn)單爬蟲的資料說明

成為Python高手必須懂的爬蟲原理

成為Python高手必須懂的爬蟲原理

評(píng)論