最新研究發現,只要一張打印出來的貼紙,就能“欺騙”AI系統,讓最先進的檢測系統也無法看到眼前活生生的人。該研究也可能用于現實的視頻監控系統,引起熱議。

一張貼紙讓你在AI面前”隱身“。

來自比利時魯汶大學 (KU Leuven) 幾位研究人員最近的研究發現,借助一張簡單打印出來的圖案,就可以完美避開 AI 視頻監控系統。

研究人員表示,他們設計的圖像可以將整個人隱藏起來,不會讓計算機視覺系統發現。這項研究在YOLO (v2) 的開源對象識別系統上進行了演示。

如上圖所示,AI 系統成功檢測到左邊的人,而右邊的人被忽略了。右邊的人身上掛著一塊彩色紙板,在論文中被稱為“對抗性補丁”(adversarial patch),正是這塊補丁 “欺騙” 了 AI 系統,讓系統無法發現畫面中還有一個人。

這種欺騙利用了一種稱為對抗性機器學習的方法。大多數計算機視覺系統依賴訓練 (卷積) 神經網絡來識別不同的東西,方法是給它提供大量樣本,調整它的參數,直到它能正確地分類對象。通過將樣本輸入一個訓練好的深度神經網絡并監控輸出,可以推斷出哪些類型的圖像讓系統感到困惑。

他們發表了題為Fooling automated surveillance cameras: adversarial patches to attack person detection的論文,并公布了用于生成圖像補丁的源代碼。

地址:

https://gitlab.com/EAVISE/adversarial-yolo

生成的補丁 (patch)能夠成功地將人在檢測器視線中隱藏起來。例如,這種攻擊可能被惡意地用來繞過監視系統,入侵者只要將一小塊硬紙板放在身體前面,面向監視攝像頭,就能不被監視系統發現。

研究結果顯示,這個系統能夠顯著降低人體檢測器的精度。該方法在真實場景中也能很好地發揮作用。

如下面的 demo 所示,使用 YOLOv2 檢測拍攝的錄像,畫面中人、椅子、桌子等都被準確地檢測出來,但只要拿上這塊 “補丁”,系統就無法檢測到人。

生成“神奇補丁”,秒變隱形人

他們是如何生成這塊神奇的 “對抗性補丁” 的呢?

優化目標包括以下三個部分:

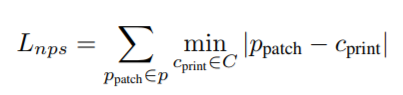

Lnps:非可打印性得分,這個因子表示貼紙中的顏色在多大程度上可由普通打印機打印出來。有下式:

其中 ppatch 是貼紙中的一個像素,而 cprint 是一組可打印顏色 C 中的顏色。這種損失有利于確保圖像中的顏色與可打印顏色集中的顏色密切相關。

Ltv:圖像總變化。該損失函數損失確保優化器支持平滑顏色過渡的圖像并防止圖像噪聲。可以由 P 計算 Ltv:

如果相鄰像素相似則得分較低,如果相鄰像素不同則得分較高。

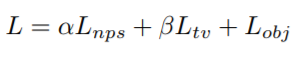

Lobj:圖像中的最大對象分數。補丁的目標是隱藏圖像中的人。所以訓練的目標是對探測器輸出的目標或類別分數實現最小化。將這三個部分相加得到總損失函數:

采用由經驗確定的因子 α 和 β 對三個部分進行按比例縮放,然后求和,并使用 Adam 算法進行優化。優化器的目標是總損失 L 的最小化。在優化過程中凍結網絡中的所有權重,并僅更改 patch 中的值。在過程開始時,以隨機值對 patch 進行初始化。

圖 3 所示為目標損失的計算,遵循相同的程序來計算類概率

YOLOv2 對象檢測器輸出一個單元網格,每個單元格包含一系列錨點(默認值為五個)。每個錨點包含邊界框的位置、對象概率和類別得分。為了讓探測器忽略圖像中的人,研究人員嘗試了三種不同的方法:最小化類人的分類概率(圖 4d),最小化對象得分(圖 4c),或兩者的組合(圖 4b 和 4a)。

研究人員分別嘗試了每一種方法。最小化類分數傾向于將類中的人員移至不同的類。在使用 MS COCO 數據集訓練的 YOLO 探測器的實驗中,研究人員發現生成的貼紙會作為 COCO 數據集中的另一個類被檢測到。圖 4a 和 4b 分別為采用類和對象概率的實例。

研究人員提出的最小化對象性得分的另一種方法則不存在這個問題。雖然在優化過程中僅僅將其其置于 “人” 這一類別之上,但是生成的貼紙對于某個類的特定性低于其他方法,如圖 4c 所示。

研究團隊對各種類型的 patch 進行了實驗,比如隨機生成的圖像噪聲或者模糊化的圖像,最后,他們發現經過多次圖像處理的隨機物體的照片的效果最好。

例如,他們提出的圖像補丁 (圖 4c) 是通過隨機選取一幅圖像來創建的,圖像經過了旋轉,隨機放大和縮小,隨機添加隨機噪聲,隨機修改正確率和對比度。

實驗結果:顯著降低警報,安全攝像頭還安全嗎?

通過實驗結果評估 patch 的有效性。過程與訓練過程相同(包括隨機變換),將結果應用于 Inria 測試集上來進行評估。

換句話說,研究人員提出一個問題:監控系統產生的警報,有多少可以通過使用貼紙來規避?

上表所示為使用不同貼紙的警報觸發分析結果。可以清楚地看到,貼紙(OBJ-CLS,OBJ 和 CLS)顯著降低了警報數量。

上圖所示為在 Inria 測試集中使用不同貼紙的效果對比示例。首先將 YOLOv2 檢測器用于沒有貼 patch 的圖像中(第 1 行),然后是使用隨機貼紙(第 2 行)以及生成的最佳貼紙的效果(第 3 行)。在大多數情況下,貼紙能夠成功地將人員隱藏在探測器中。如果效果不好,則可能是貼紙沒有和人對齊。因為在優化期間,貼紙的中心對齊是僅僅由圖像邊框確定的。

上圖測試了印刷版貼紙在現實世界中的效果。一般情況下,效果還是不錯的。由于上文所述的圖像訓練對齊的原因,將貼紙保持在正確位置似乎是非常重要的。

結果生成的 “補丁”,可以應用在衣服、包或其他物體上,佩戴這種 “補丁” 的人將成為隱形人—— 使用 AI 檢測算法無法檢測到。

這種方法也可以用來隱藏某些對象。例如,如果監視系統被設計為檢測物體而不是人,那么 “補丁” 也可以將汽車之類的物體隱藏起來。

可以想象,這種伎倆可以讓騙子躲避安全攝像頭。“我們的工作證明,使用對抗性補丁繞過攝像機監控系統是可能的,” 作者之一 Wiebe Van Ranst。

Van Ranst 說,將這種方法應用于現成的視頻監控系統應該不會太難。“目前我們還需要知道使用的是哪種檢測器。我們未來想做的是生成一個補丁,可以同時在多個檢測器上工作,” 他說。“如果這種方法有效,那么這個補丁也很有可能對監控系統中使用的檢測器有效。”

當然,這個 “補丁” 目前并非萬無一失,如果它在畫面中不是清晰可見的,或者角度發生了變化,AI 系統都能迅速 “發現” 畫面中的人類。

不過,這項研究是學術界首次嘗試使用 2D 打印技術將人類從檢測系統中隱藏起來。之前的工作主要是使用帶有特殊框架的眼鏡來欺騙人臉識別軟件,或使用對抗樣本欺騙圖像分類系統,例如用一張貼紙就能令 AI 將香蕉誤認為是烤面包機,用幾張貼紙就能將自動駕駛系統 “騙” 進反車道。

-

神經網絡

+關注

關注

42文章

4778瀏覽量

101013 -

AI

+關注

關注

87文章

31405瀏覽量

269815 -

視頻監控系統

+關注

關注

1文章

122瀏覽量

28459

原文標題:一張貼紙欺騙AI,對抗性補丁讓人類隱身,監控攝像危險了!

文章出處:【微信號:AI_era,微信公眾號:新智元】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

labview調用bartender模板打印出來的標簽中有些文本字符出錯。

如何讓VNA打印出來?

為什么AD6.9打印出來的間距不對?

為什么我打印出來的都是同一時間的CPU使用率?

UCOSIII里printf打印出來有數據顯示是為什么?

CAD制圖軟件中繪制的彩色圖紙打印出來后變成灰色了怎么辦?

CAD制圖軟件中繪制的彩色圖紙打印出來后變成灰色的原因以及解決辦法

CAD中怎么設置線寬?CAD圖紙打印出來線條太粗怎么辦?

為什么CAD將圖紙打印出來線顯得特別虛

PCB設計:利用腳本把PCB鉆孔的信息打印出來資料下載

借助一張簡單打印出來的圖案,就可以完美避開AI視頻監控系統

借助一張簡單打印出來的圖案,就可以完美避開AI視頻監控系統

評論