如今有一種觀點認為,GPU并非為深度學習而生,只是恰好并行計算滿足大數據處理需求而已。那么,GPU會在深度學習領域失寵嗎?NVIDIA全球副總裁、中國區總經理張建中在AI WORLD 2018世界人工智能峰會分享以《AI與自動駕駛》為主題的演講時表示:GPU是做AI和深度學習最好的架構,它已不再只是單純的圖像處理器。張建中認為,在很多場景下,AI應用需要高精確度的推理平臺,尤其是在自動駕駛場景下。

近年來,深度學習在很多行業得以廣泛應用,這很大程度上得益于神經網絡和硬件的飛速發展。

如今存在著這樣一種論調:GPU并非為深度學習而生,只是恰好并行計算滿足大數據處理需求而已。那么,GPU會在深度學習領域失寵嗎?

9月20日,NVIDIA全球副總裁、中國區總經理張建中在AI WORLD 2018世界人工智能峰會上談到了這一問題,他表示:GPU是做AI和深度學習最好的架構。從摩爾定律到AI摩爾定律,計算力為人工智能的飛速發展提供了強大支撐。

張建中說:“如果我們看今天的GPU,實際上它已經不再是傳統的圖形處理器了,而在圖靈最新的技術當中,里面已經集成了很多不同的核心處理器。”

張建中以自動駕駛為例,著重介紹了GPU在推理(Inference)情況下的應用。NVIDIA不久前在日本GTC發布的AGX,可以作為極小的單芯片Xavier對接自動駕駛汽車的各種不同接口,也可以用兩個Xavier芯片加上兩個GPU(名為Drive Pegasus),用在L3~L5等不同的自動駕駛場景中。張建中提到很多人以為推理的模型是越小越好,對精確度的要求并不高。而事實上,AI的應用,尤其是在自動駕駛場景下,需要保證其推理平臺的精確度越高越好,端側推理也需要強大的計算平臺。

國際AI企業TOP10:Amazon、Google、Microsoft、Apple、Facebook、DeepMind、NVIDIA、IBM、Boston Dynamics、Waymo

AI WORLD 2018世界人工智能峰會重磅發布了AI領域年度大獎——AI Era創新大獎,NVIDIA Drive Xavier成功入圍「AI產品影響力TOP10」。NVIDIA憑借領先的技術成功登榜「國際AI企業TOP10」,NVIDIA聯合創始人兼CEO黃仁勛也被評選為「華人AI人物TOP10」。

AI華人影響力TOP10:陳天石、胡郁、黃仁勛、李飛飛、劉慶峰、王海峰、王小川、吳恩達、顏水成、余凱

AI產品影響力TOP10:寒武紀智能芯片MLU100、華為麒麟980、曠視Brain++、訊飛翻譯機2.0、百度Apollo3.0、阿里云ET城市大腦、英偉達Drive Xavier、百度大腦3.0、浪潮AI服務器、阿里量子計算云平臺

NVIDIA全球副總裁、中國區總經理張建中也在此次峰會上分享了以《AI與自動駕駛》為主題的演講,讓人們看到更全面的英偉達,以下為演講的主要內容:

張建中:尊敬的各位來賓,大家上午好!NVIDIA是一家AI Computing Company,過去我們每天的工作都在不停進步,把AI的基礎架構和在每一個不同深度學習的模型架構(Framework)的加速作為我們的研究方向。

我相信如果你們參加我們的GTC( GPU Technology Conference,GPU 技術大會))就會發現,在過去的幾年中,摩爾定律的發明者所講述的CPU計算性能,隨著每年每隔一代的制程,加上CPU的研發性能都在不停地提升,但隨著最近幾年的變化,摩爾定律遇到了一定的難度,因為物理極限導致CPU的性能無法像以前那么快地飛速成長。

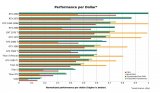

當然,在計算的過程中,我們發現浮點計算以及并行計算領域,GPU的性能還是能夠保持持續的增長,其中的主要原因并不是由于制程的變化,大部分計算性能的提升是來自于幾個方面的結果:首先要有一個很好的架構(Architecture),要把并行計算的架構設計能夠適應新的計算的需要。其次,還要有一個很好的軟件支持,這種Software SDK支持并行計算的速度成長,對整體GPU性能的提升是非常重要的。當然還涉及很多的應用層面,所以從SDK到芯片再到應用層面的結合,我們就可以看到GPU的性能在每一代的計算方面的提升是非常驚人的。

如果看一看過去每隔十年的發展,GPU本身的計算速度大概是呈現1000倍地成長,以這么快的成長速度才能支撐今天人工智能深度學習的計算力要求,也正是因為GPU計算力的提升,大概在今后的幾年中,它的速度應該也會一直不停地增加。

GPU是做AI和深度學習最好的架構

近日,Jensen(黃仁勛)在日本GTC上了在推理(Inference)情況下,使用我們最新的架構圖靈,這種GPU用在推理時,它的性能其實比帕斯卡架構提升差不多10倍數量級,這樣的數量級在于圖靈Architecture的變化。如果看這種AI Interflow Performance可以看到大概是260Tops,這樣的速度可以幫助我們很快地、快速地處理大量人以前無法處理的信息,尤其是在、視頻的管理、語音的翻譯,大量的計算速度都可以在云端快速地透過T4幫助我們實現。

這個架構本身來自于新的架構(Architecture),有人說GPU是不是一個最好的架構來做AI呢?很多人都在爭論這個問題,如果我們看今天的GPU,實際上它已經不再是傳統的圖形處理器了,而在圖靈最新的技術當中,里面已經整合了多種不同的核心處理器,包括今天要跟大家分享的RTX。

RTX實現了在過去計算機圖形當中最難做的一件事情,很多人以前在計算機圖形領域的研究就會發現,RTX以前是要靠一個非常非常龐大的超級計算機幫助我們實現,但是如果要做到實時計算的話,工作量是巨大的。上次我們GTC Demo就實現了用實時去做光線追蹤(Ray Tracing)的第一次成功,所用的正是NVIDIA的DGX,4個最新的處理器Volta架構實現實時光線追蹤,但是用圖靈架構的處理器就可以直接做到實時。這種RTX技術不光是幫助我們去做實時的光線追蹤,同時可以去做很多AI的應用,其中包括里面集成的AI推理代碼。

如果我們看整個RTX的重要性,可以發現其實RTX真正改變了我們今天所有的圖形應用計算,今后你們所看到的電影沒有必要再去等待很長時間去做后期的制作,導演用RTX就可以實時決定電影后期制作的效果,無需等待,以前的Rundown可以被一張顯卡代替。當然,RTX帶來的最大改變是內容制作的真實度,可以看到今后游戲行業的變化會是巨大的,如今的游戲在里面的每一楨畫面要靠GPU做實時的渲染,但在今后可能不一定要再去靠GPU100%渲染,可以靠AI和光線追蹤,得到的效果就會變成照片級的游戲畫面效果,計算機制作的游戲和后期電影的效果和我們看到的每張大片都是一樣的。

關于這些實時光線追蹤達到的效果,可以看到無論是機理的表現方面,還是材質的反映方面都可以達到更加真實的性能。以前我們看到的材料,比如金屬、皮質、木材,每種材料的表現是不一樣的,今天在實時光線追蹤的技術可以把這些材料通過技術描述出來,通過GPU渲染出想要的不同材質的效果。因為這是實時光線追蹤,所有光線的陰影都是很Soft、很真實的。如果我們有機會去看RTX Demo的話,可以看到在多光源不同的環境下的渲染效果跟真實的場景是沒有分別的。

當然,如果光線追蹤帶來的特效反映在不同的光影反射的情況中,其實在其它的方面可以增加更好的表現力,比如做人臉表情的模擬仿真,可以把它變得更加真實,例如,3D作出的人臉表情的模仿,和真人的效果基本上沒有差別。

AI應用需要高精確度的推理平臺

單看GPU的計算力在不同場景下的應用,實際上給我們帶來的變化遠遠不止在服務器端。AI最大的應用其實是在兩端的:一是訓練,二是推理。既然有強大的計算力把訓練的模型建好,那么在推理這一端是不是要強大的計算力平臺讓它去包括呢?

其實答案是肯定的,很多人以為推理的模型是越小越好,但是在很多的場景下面、很多的環境下,AI的應用要保證它的精確度越高越好,尤其是在自動駕駛場景下,安全幾乎已經成為所有人關心的第一大問題。既然是這樣,怎么提高它的安全性呢?除了此前周志華教授介紹的各種不同魯棒性的研發之外,我們還可以建立很好的模型,但歸根結底還是要有一個很強大的計算平臺迅速地把你的結果算出來。

要想建立一個很強大的,或者是人工智能推理平臺,NVIDIA推出的AGX芯片就是一個SoC,但是可以做到有強大的計算能力,最高可以達到300個Tops,所以可以看到AI推理速度有多快。如果只看這個芯片本身,可以看到它不只是一顆CPU,當然也不只是一顆GPU,里面有8個核心的CPU處理能力,同時里面還有視頻處理器、圖像處理器,接入各種不同的傳感器,可以支持所有工業級的不同接口。

如果我們來看這個系統芯片,它的應用能力基本上可以應用在各種不同的機器自動應用產品,英偉達也在日本發布了NVIDIA AGX,AGX是專門用來處理自動智能工具的一個嵌入式(Embedded)平臺,基本上可以變成單片應用或者是雙片應用,加上一個獨立的GPU應用,所以應用場景會非常廣泛,可以看到AGX是一個非常小的單芯片接上汽車的自動駕駛各種不同的接口,也可以是雙芯片獨立的GPU,我們把它叫做 Drive Pegasus,可以在不同的場景使用,包括汽車駕駛的Level3,甚至Level5,也可以應用在其它不同的機器人場景當中。

如果我們看一看兩種不同的應用場景,我們相信凡是能夠運動或者移動的物體今后都將是智能化的,任何一部車無論是轎車、卡車、運貨的小車,或者是農用的機械工具等等都可以使用AGX實現自動化。

NVIDIA推出汽車自動駕駛測試仿真系統,仿真成為重要一環

除了硬件本身的計算平臺之外,它是不夠的,怎樣賦能一個100%或者能夠全智能化的機器人?我們要給它提供一整套的軟件,NVIDIA基本上把整個的定位、感知、決策和各種不同的傳感器接口都設計得很好,所以我們有軟件接口、硬件接口,軟件架構方面NVIDIA可以提供所有的Drive全套的N2N Software集成。

所有的這些智能機器人當中,最核心的模塊就是今后很多公司花了很多時間研發的感知系統,這種感知系統的研發核心的裝置或者核心的系統還是要設計N2N的感知系統基礎架構。首先要有一個很好的、很強大數據能力的數據中心,其中必須要有足夠強大的計算力處理感知、前端、收集各種不同的標注數據,把這些數據在數據中心進行處理以后才可以得到想要的模型,應用在我們各個不同的智能機器人里面。

今后如果我們去看整個自動駕駛的研發,比如測試自動駕駛的模型,仿真(Simulation)是很重要的一環。NVIDIA推出的汽車自動駕駛測試仿真系統(DRIVE Constellation),運行NVIDIA DRIVE Sim軟件 ,可以測試汽車上路之前研發的各種不同的算法在計算機當中、在云端和在(Data Center)進行測試模擬。當然,模擬的環境和真實的環境一樣,我們可以做到各種不同環境的模擬測試。當然,最后的感知效果是的可以看見的:在不同的氣候和路況下都能夠使用我們自動駕駛的算法。

一個好的自動駕駛環境當中,NVIDIA Drive考慮的是從數據的感知到本身平臺的系統模擬,再到最后真正在汽車上實際運行的NVIDIA Drive我們都有N2N的解決方案。如果只是我們自己去研發肯定不能完善,或者不能很快地讓自動駕駛的產品和技術上市,我們在全球有超過450家的合作伙伴,這些合作伙伴每一個都在用NVIDIA Drive平臺,無論是大大小小的AGX平臺或者是在NVIDIA Drive Software上進行自動駕駛的研發。我們也希望今年在中國的GTC上面能夠展示我們在中國本土的自動駕駛研發方面的科研成果,歡迎大家到時候去蘇州參觀!

-

gpu

+關注

關注

28文章

4754瀏覽量

129073 -

大數據

+關注

關注

64文章

8897瀏覽量

137536 -

深度學習

+關注

關注

73文章

5507瀏覽量

121298

原文標題:GPU是做AI和深度學習最好的架構?端側推理也需要強大的計算平臺!

文章出處:【微信號:AI_era,微信公眾號:新智元】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

相比GPU和GPP,FPGA是深度學習的未來?

FPGA在深度學習應用中或將取代GPU

新手小白怎么學GPU云服務器跑深度學習?

Nanopi深度學習之路(1)深度學習框架分析

深度學習框架TensorFlow&TensorFlow-GPU詳解

Mali GPU支持tensorflow或者caffe等深度學習模型嗎

什么是深度學習?使用FPGA進行深度學習的好處?

深度學習方案ASIC、FPGA、GPU比較 哪種更有潛力

基于深度學習的ADAS系統,是GPU的主力市場

深度學習如何挑選GPU?

GPU會在深度學習領域失寵嗎?

GPU會在深度學習領域失寵嗎?

評論