提及谷歌大腦、seq2seq、AutoML,許多人已是耳熟能詳。在成功的背后,定是有許多研究人員的默默付出。而Quoc Le就是其中一位,堪稱谷歌真正的“隱藏人物”、幕后英雄!他,是真正的幕后英雄!

瘦弱的身材,安靜的性格,戴著一副厚厚的眼鏡,你絕對猜不到如此其貌不揚的Quoc Le,正式引領人工智能革命的領軍人物之一。

2011年,Le和他的博士生導師Andrew Ng、谷歌同時Jeff Dean和谷歌研究員Greg Corrado,共同創(chuàng)建了谷歌大腦(Google Brain)。目標是在谷歌龐大的數據背景下探索深度學習。在此之前,Le在斯坦福大學開展了一些關于無監(jiān)督深度學習的開創(chuàng)性工作。

2012年,Le在ICML上發(fā)表了一篇文章,引起了人們對深度學習的濃厚興趣:他開發(fā)了一種深度神經網絡模型,可以根據Youtube上的1000萬張數字圖像以及ImageNet數據集中的3000多個對象來識別貓。這個巨型系統由16000臺機器和10億個突觸組成,是以往研究規(guī)模的100倍。同年,Le又發(fā)表了關于AlexNet的論文,對整個深度學習領域產生了牽引力。

雖然后來證明無監(jiān)督學習方法對于商業(yè)用途是不切實際的(至少在那段時間),但Le在2015年《Wired》采訪中表示,“如果我們能挖掘一種算法來解決這個問題就太好不過了,因為實際的情況是,我們無標記的數據遠遠多于有標記的數據。”

從“序列”到“序列學習”

Le在2013年畢業(yè)后正式加入谷歌,成為一名研究科學家,很快就在機器翻譯領域取得了驚人的突破(機器翻譯是機器學習領域最活躍的研究領域之一)。

為了實現這一結果,他必須超越已有深度學習的方法,這些方法適用于圖像和語音,可以使用固定大小的輸入進行分析。 而對于自然語言,句子的長度各不相同,詞語的順序也很重要。

2014年,Le與谷歌研究人員Ilya Sutskever和Oriol Vinyals一起提出了序列到序列(seq2seq)學習。它是一個通用的encoder-decoder框架,訓練模型將序列從一個域轉換到另一個域(例如不同語言之間的句子)。

seq2seq學習在工程設計選擇方面的需求較少,并允許Google翻譯系統高效準確地處理非常大的數據集。它主要用于機器翻譯系統,并被證明適用于更廣泛的任務,包括文本摘要,會話AI和問答。

Le進一步發(fā)明了doc2vec,這是一種非監(jiān)督算法,它從句子、段落和文檔等不同長度的文本片段中學習固定長度的特征表示。Doc2vec是word2vec的擴展,word2vec于2013年由谷歌成員Tomas Mikolov發(fā)布。其思想是每個單詞都可以用一個向量表示,這個向量可以從集合文本中自動學習。Le添加了段落向量,因此模型可以生成文檔的表示形式,從而不考慮文檔的長度。

Le的研究最終得到了回報。在2016年,谷歌宣布了神經機器翻譯系統,它利用AI進行學習,能夠得到更好更自然的翻譯。

2015年,Le在榮登MIT Technology Review的“35歲以下創(chuàng)新者”排行榜,因為他的目標是“讓軟件變得更智能,幫助人們提高生活品質”。

AutoML:神經網絡學習自我提升

訓練深層神經網絡需要大量的標記數據和反復的實驗:選擇一個架構,構建隱含層,并根據輸出調整權重。對于機器學習專業(yè)知識有限的人來說,訓練過程時既費時又費力的。

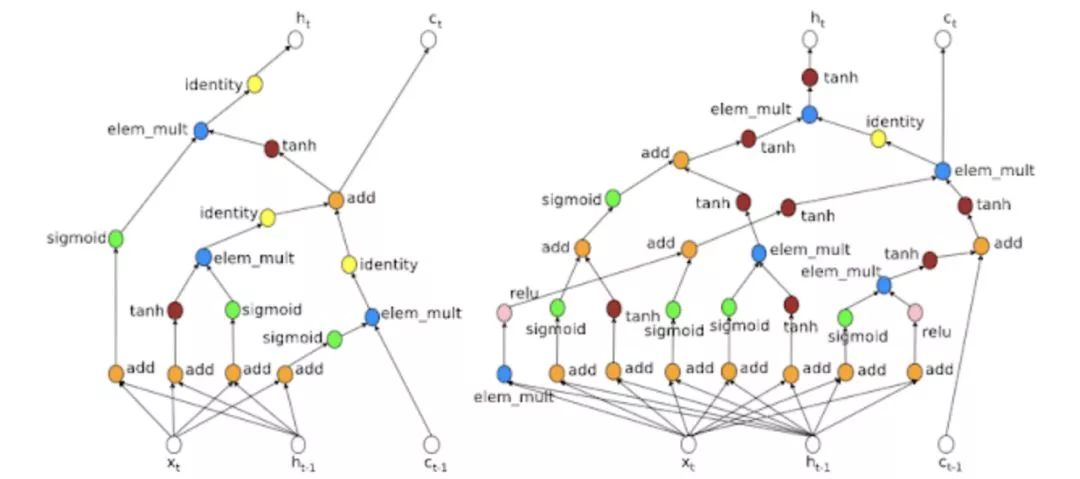

2016年,Le和另一位谷歌同事Barret Zoph提出了神經結構搜索。他們使用一個循環(huán)網絡來生成神經網絡的模型描述,并通過強化學習來訓練這個RNN,以最大限度地提高在驗證集上生成的體系結構的預期精度。

這種新方法可以幫助研究人員設計一種新的網絡體系結構,在CIFA-10數據集的測試集精度方面與人類發(fā)明的最佳體系結構相匹配。一年后,Le和Zoph將他們的研究提升到了一個新的高度,他們提出了NASNet-A,一個可移植的大型圖像數據集架構。

Le的研究為AutoML奠定了基礎,AutoML是一套谷歌產品,專為缺乏機器學習經驗和資源的開發(fā)人員設計的。然而,在早期階段,AutoML是用于解決現實問題的:數據科學家使用AutoML建立了一個基于面條圖像識別餐廳的模型,準確度幾乎達到95%; 日本開發(fā)人員使用AutoML構建了一個可以使用其品牌名稱對圖像進行分類的模型。

在過去的六年里,Le一直處于深度學習發(fā)展的前沿。這位36歲的谷歌研究科學家現在準備將深度學習提升到一個新的高度。

-

谷歌

+關注

關注

27文章

6172瀏覽量

105631 -

人工智能

+關注

關注

1792文章

47425瀏覽量

238965

原文標題:大神Quoc Le:谷歌 AutoML幕后的傳奇英雄

文章出處:【微信號:worldofai,微信公眾號:worldofai】歡迎添加關注!文章轉載請注明出處。

發(fā)布評論請先 登錄

相關推薦

天合光能高海純榮登2024福布斯中國出海全球化領軍人物TOP30榜單

文遠知行韓旭收獲福布斯出海領軍人物獎,開拓全球自動駕駛“大航海時代”

人工智能革命的領軍人物 谷歌AutoML幕后的傳奇英雄

人工智能革命的領軍人物 谷歌AutoML幕后的傳奇英雄

評論