電子發(fā)燒友網(wǎng)報道(文/黃晶晶)數(shù)據(jù)中心向來是耗電大戶,過去出于更經(jīng)濟(jì)的考慮氣冷型服務(wù)器占據(jù)主流,如今隨著大語言模型的快速發(fā)展以及Meta的Llama-3和Mistral的Mixtral 8x22B等開源模型不斷推出,采用液冷技術(shù)的總擁有成本效益更加突出。未來液冷服務(wù)器的比重將顯著上升。

液冷產(chǎn)品簡化AI基礎(chǔ)設(shè)施

最近,Supermicro推出可立即部署式液冷型AI數(shù)據(jù)中心,此數(shù)據(jù)中心專為云原生解決方案而設(shè)計,通過SuperCluster加速各界企業(yè)對生成式AI的運(yùn)用,并針對NVIDIA AI Enterprise軟件平臺優(yōu)化,適用于生成式AI的開發(fā)與部署。

Supermicro的SuperCluster解決方案針對LLM訓(xùn)練、深度學(xué)習(xí)以及大規(guī)模與大批量推理優(yōu)化Supermicro的SuperCluster支持NVIDIA AI Enterprise,其中包括NVIDIA NIM微服務(wù)和NVIDIA NeMo平臺,能實現(xiàn)端對端生成式AI客制,并針對NVIDIA Quantum-2 InfiniBand以及具有每GPU 400Gb/s網(wǎng)速的新型NVIDIA Spectrum-X以太網(wǎng)絡(luò)平臺優(yōu)化,可擴(kuò)展到具有數(shù)萬個GPU的大型計算叢集。

通過Supermicro的4U液冷技術(shù),NVIDIA近期推出的Blackwell GPU能在單一GPU上充分發(fā)揮20 PetaFLOPS的AI性能,且與較早的GPU相比,能提供4倍的AI訓(xùn)練性能與30倍的推理性能,并節(jié)省額外成本。

Supermicro總裁兼首席執(zhí)行官梁見后表示,我們的解決方案針對NVIDIA AI Enterprise軟件優(yōu)化,滿足各行各業(yè)的客戶需求,并提供世界規(guī)模級效率的全球制造產(chǎn)能。因此我們得以縮短交付時間,更快提供搭配NVIDIA HGX H100和H200,以及即將推出的B100、B200和GB200解決方案的可立即使用型液冷或氣冷計算叢集。

液冷型被越來越多的采用

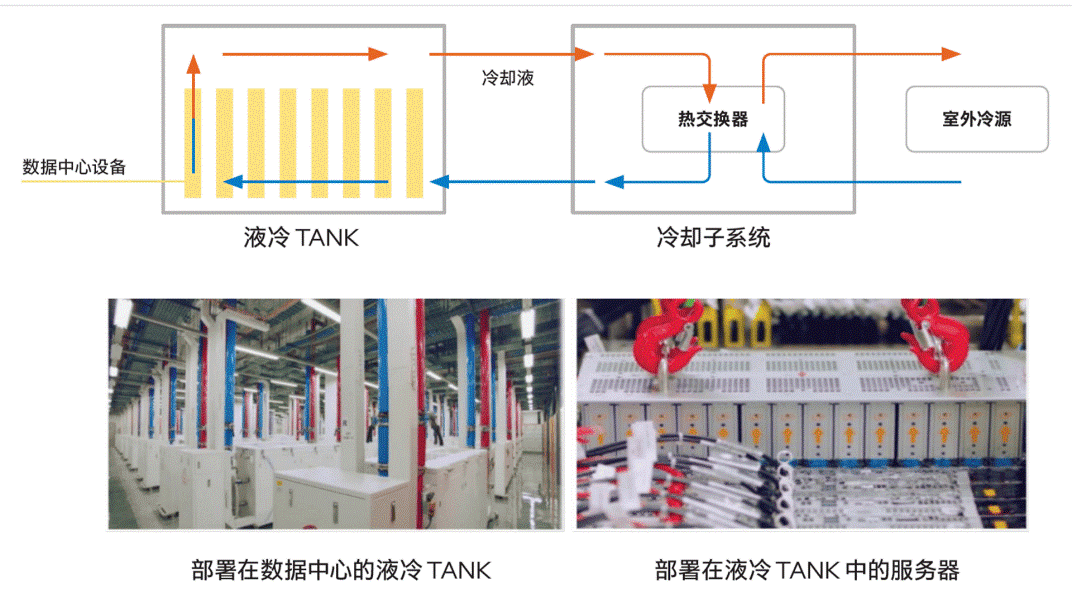

Supermicro提供的數(shù)據(jù)中心的液冷配置設(shè)計可幾近免費(fèi),并通過能持續(xù)降低用電量的優(yōu)勢為客戶提供額外價值。采用液冷方案的整體擁有成本將非常可觀,例如來自于后期運(yùn)營過程當(dāng)中的電力消耗的減少,5年可以節(jié)省高達(dá)6000萬美元的電費(fèi)支出。Supermicro從液冷板到CDU乃至冷卻塔,其機(jī)柜級全方位液冷解決方案最大可以降低數(shù)據(jù)中心40%的持續(xù)用電量。

液冷并非新的技術(shù),它存在已經(jīng)超過30年,不過在采訪中,梁見后表示,之前液冷方案需求量小,并且交期長約4-12個月,以小型OEM為主。如今,Supermicro與客戶重新進(jìn)行子系統(tǒng)和組件設(shè)計來提升數(shù)據(jù)中心的性能,并改善了交期,滿足更快的交付要求。

今年以來,客戶要求新建數(shù)據(jù)中心時直接采用液冷方案,也希望將舊有的氣冷數(shù)據(jù)中心部分轉(zhuǎn)換成液冷配置。在此需求刺激下,公司液冷業(yè)務(wù)的增長非常快,產(chǎn)能處于供不應(yīng)求的狀態(tài)。

公司在荷蘭、美國和馬來西亞等全球各地擴(kuò)大生產(chǎn)規(guī)模,預(yù)計2-3個月內(nèi)馬來西亞新廠區(qū)即可投產(chǎn)。產(chǎn)能爬坡,供應(yīng)能力增加,令客戶享受更低成本的初始投資方案以及更低的總擁有成本。

隨著大語言模型的服務(wù)器集群的需求增長,液冷方案有望成為主流。過去三十年液冷的市場份額估計都不到1%,但數(shù)據(jù)中心對液冷方案的采用逐漸增多,這一市占有望提高到15%以上。

不斷拓展液冷型產(chǎn)品線

NVIDIA創(chuàng)始人兼首席執(zhí)行官黃仁勛對于Supermicro的設(shè)計給出高度評價,他表示生成式AI正在推動整個計算堆棧的重置,新的數(shù)據(jù)中心將會通過GPU進(jìn)行計算加速,并針對AI優(yōu)化。Supermicro設(shè)計了頂尖的NVIDIA加速計算和網(wǎng)絡(luò)解決方案,使價值數(shù)兆美元的全球數(shù)據(jù)中心能夠針對AI時代優(yōu)化。

Supermicro目前的生成式AI SuperCluster液冷型產(chǎn)品包括Supermicro NVIDIA HGX H100/H200 SuperCluster,具有256個H100/H200 GPU,為5個機(jī)柜規(guī)模的可擴(kuò)展計算單元(包括1 個專用網(wǎng)絡(luò)機(jī)柜)。即將推出的SuperCluster液冷型產(chǎn)品包括Supermicro NVIDIA HGX B200 SuperCluster液冷型,Supermicro NVIDIA GB200 NVL72 或NVL36 SuperCluster液冷型。

當(dāng)然除了液冷型之外,也推出了氣冷型產(chǎn)品,例如氣冷型Supermicro NVIDIA HGX H100/H200 SuperCluster,具有256個HGX H100/H200 GPU,為9個機(jī)柜規(guī)模的可擴(kuò)展計算單元(包括1個專用網(wǎng)絡(luò)機(jī)柜),以及后續(xù)將推出的Supermicro NVIDIA HGX B100/B200 SuperCluster氣冷型。

Supermicro是主流的AI 服務(wù)器制造商之一。受益于 ChatGPT 引發(fā)的人工智能熱潮,再加上與英偉達(dá)的密切合作,這兩年Supermicro業(yè)績飆升,并受到資本市場的追捧。如今,Supermicro的液冷服務(wù)器技術(shù)直擊 AI 處理器功耗高的痛點,技術(shù)創(chuàng)新和產(chǎn)能提升下,公司的液冷服務(wù)器業(yè)務(wù)將成為強(qiáng)勁的成長動力。

-

NVIDIA

+關(guān)注

關(guān)注

14文章

5106瀏覽量

104456 -

gpu

+關(guān)注

關(guān)注

28文章

4830瀏覽量

129774 -

Supermicro

+關(guān)注

關(guān)注

0文章

32瀏覽量

9404 -

液冷

+關(guān)注

關(guān)注

4文章

111瀏覽量

5175

發(fā)布評論請先 登錄

相關(guān)推薦

影響服務(wù)器GPU租用價格的因素

GPU加速云服務(wù)器怎么用的

GPU云服務(wù)器租用費(fèi)用貴嗎

GPU云服務(wù)器租用多少錢

租用GPU服務(wù)器一般多少錢

英偉達(dá)CEO確認(rèn):液冷Grace Blackwell服務(wù)器無過熱問題

ADS1298將SPI提升到更高頻率將無法讀取任何信息,為什么?

GPU服務(wù)器和傳統(tǒng)的服務(wù)器有什么區(qū)別

GPU服務(wù)器AI網(wǎng)絡(luò)架構(gòu)設(shè)計

GPU高性能服務(wù)器配置

gpu服務(wù)器與cpu服務(wù)器的區(qū)別對比,終于知道怎么選了!

算力服務(wù)器為什么選擇GPU

基于ESP32S進(jìn)行BLE MESH開發(fā),基于的是BLE4.2,是否可以提升到BLE5.0?

PUE的拯救者,液冷服務(wù)器

NVIDIA最新GPU帶動,液冷服務(wù)器市占有望從1%提升到15%

NVIDIA最新GPU帶動,液冷服務(wù)器市占有望從1%提升到15%

評論