在生成式 AI 領域,構建企業級大語言模型(LLM)需要具備采集高質量數據、設置加速基礎設施和優化模型方面的專業知識。

開發者可以從預訓練模型開始,根據自己的用例對模型進行微調,從而節省時間并使其解決方案更快地投入市場。開發者需要一種簡單的方法來試用模型,并通過 API 集成這些模型來評估其能力。這有助于他們確定哪種模型最適合其應用。

NVIDIA AI Foundation Models

NVIDIA AI Foundation Models是由精心挑選的社區模型和 NVIDIA 構建的模型組成,并針對峰值性能進行了優化。開發者可以通過 API 或圖形用戶界面直接在瀏覽器中快速使用這些模型,無需進行任何設置。這些模型通過NVIDIA TensorRT-LLM和激活感知權重量化(AWQ)技術進行優化,以便確定最高吞吐量和最低延遲的配置,并且在 NVIDIA 加速計算堆棧上大規模運行。

NVIDIA Nemotron-3 8B 系列 LLM 介紹

NVIDIA Nemotron-3 8B系列模型為想要構建生產就緒生成式 AI 應用的客戶提供了基礎。這些模型是基于可靠的數據集構建,其運行性能可媲美規模遠超它們的模型,因此非常適合企業部署。

NVIDIA Nemotron-3 8B 系列模型的一大關鍵優勢在于其具有多語言功能,這使其成為全球企業的理想選擇。這些模型精通 53 種語言,包括英語、德語、俄語、西班牙語、法語、日語、中文、意大利語和荷蘭語。

該系列模型還采用了一系列對齊技術,包括監督微調(SFT)、人類反饋強化學習(RLHF)以及全新的NVIDIA SteerLM定制化技術,使客戶可以在推理時調整模型。無論是自定義模型還是從頭開始運行模型,這些變體為支持各種不同的用例打下了基礎。

Nemotron-3 8B 系列模型包含:

-

Nemotron-3-8B-Chat-SteerLM:一個基于 NV-Nemotron-3-8B 基本模型的生成式語言模型,專為在推理過程中使用戶能夠采用 SteerLM 技術控制模型輸出而定制。

-

Nemotron-3-8B-QA:一個基于 NV-Nemotron-3-8B 基礎模型的生成式語言模型,可針對問題回答指令進行進一步微調。

經過 NVIDIA 優化的社區模型

此外,NVIDIA 還提供領先的社區模型,這些模型均經過 NVIDIA TensorRT-LLM 的優化,具有最高的性價比,企業機構可根據企業應用對它們進行自定義。這些模型包括:

-

Llama 2:最流行的 LLM 之一,能夠根據提示生成文本。

-

Stable Diffusion XL:一種熱門的生成式 AI 模型,可使用文本創建富有表現力的圖像。

-

Mistral 7B:一種能遵循指令、完成請求并生成有創意的文本格式的 LLM。

-

Contrastive Language-Image Pre-Training (CLIP):一種流行的開源模型,能同時理解圖像和文本,從而完成圖像分類、物體檢測等任務。

當開發者確定了合適的基礎模型后,就可以輕松地對這些模型進行微調和部署,無論是在自己的基礎設施上,還是通過NVIDIA DGX Cloud在 NVIDIA 維護的基礎設施上。

下面讓我們一起體驗、定制和部署微調后的 Llama 2 模型。

體驗 Llama 2

NVIDIA 提供了一個易于使用的界面,使開發者能夠直接在瀏覽器上與 Llama 2 模型進行交互。只需在提示字段中輸入文本并點擊生成,模型就會立即開始生成信息回復。

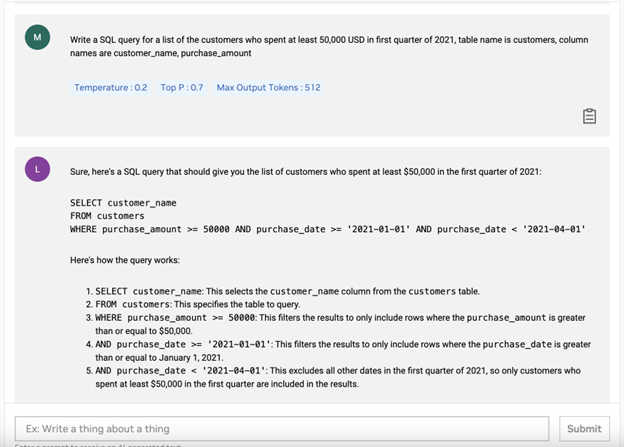

在圖 1 中,用戶要求模型進行 SQL 查詢,檢索 2021 年第一季度至少消費 50,000 美元的客戶名單。模型不但正確理解了用戶的查詢,并提供了答案和詳細解釋。

圖 1. Llama 2 模型對 SQL 查詢“獲取 2021 年第一季度

至少消費 50,000 美元的客戶名單”所做出的響應

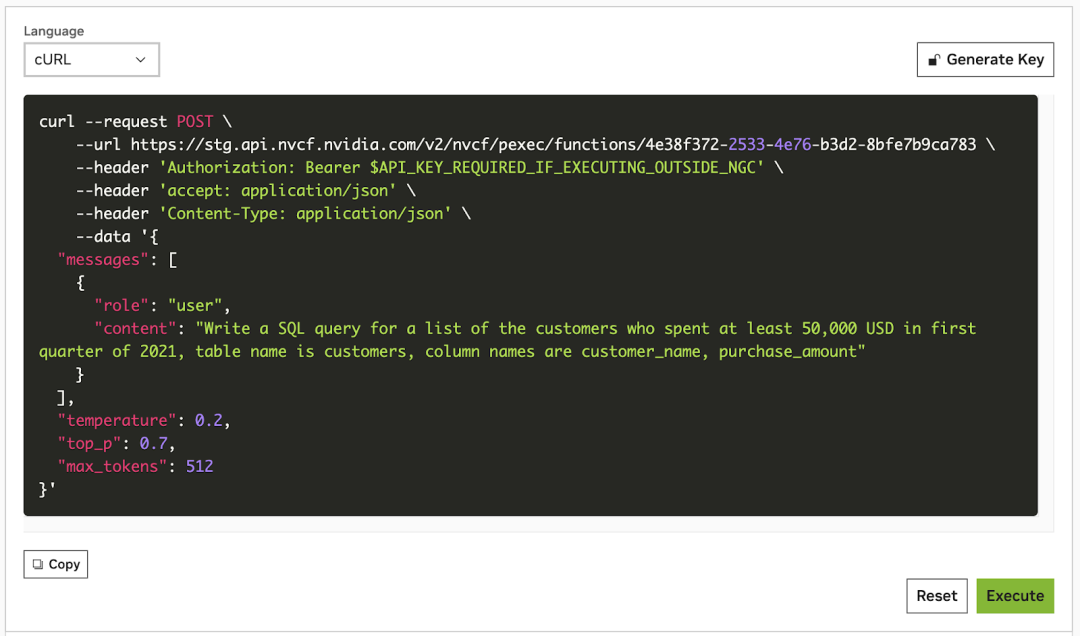

而開發者通常對代碼更感興趣。因此,NVIDIA 也直接在瀏覽器中提供了一個 API 小工具,讓用戶可以通過 API 無縫體驗這些模型。

如要試用這個瀏覽器內置的 API,請單擊 API 模式,然后從下拉菜單中選擇您傾向的語言。圖 2 顯示了通過 cURL 調用該 API 的 API 指令。

圖 2. 用于體驗 Llama 2 模型的

瀏覽器內置 API 小工具(cURL 語言)

自定義模型

通常情況下,一般模型無法滿足開發者的需求,必須使用專有數據進行微調。因此,NVIDIA 提供了多種自定義可用模型的途徑。

NVIDIA NeMo是一個端到端企業級云原生框架,開發者可用它來構建、定制和部署具有數十億參數的生成式 AI 模型。此外,NeMo 還提供用于微調 LLM(如 Llama)的 API。

為了快速上手,我們也提供了一個 NVIDIA LaunchPad 實驗室。這個通用的試驗場可對最新的 NVIDIA 企業級軟硬件進行全方位測試。

該 LaunchPad 實驗室體驗中的以下示例使用自定義數據集對 Llama 2 7B 文本-文本模型進行了微調,以更好地執行問答任務。

-

如要開始使用,請單擊“Llama 2 微調實驗室”(https://www.nvidia.com/en-us/launchpad/ai/customize-llama-2-with-enterprise-data/)并申請訪問。在 Launchpad 上工作時,Llama 2 模型文件會以 .nemo 檢查點的形式預先下載,從而實現與 NVIDIA NeMo Framework 的微調兼容性。

-

模型準備就緒后,我們從 Hugging Face 加載 Dolly 數據集(https://huggingface.co/datasets/databricks/databricks-dolly-15k)并對其進行預處理,刪除不必要的字段、重命名某些字段,以更好地適應提示調整任務,并將數據集分割成訓練文件和測試文件。

dataset=load_dataset("aisquared/databricks-dolly-15k")上面所示的是一個數據樣本。為了適應特定的用例,數據集可以互換。

{ "question": "When did Virgin Australia start operating?", "context": "Virgin Australia, the trading name of Virgin Australia Airlines Pty Ltd, is an Australian-based airline. It is the largest airline by fleet size to use the Virgin brand. It commenced services on 31 August 2000 as Virgin Blue, with two aircraft on a single route.[3] It suddenly found itself as a major airline in Australia's domestic market after the collapse of Ansett Australia in September 2001. The airline has since grown to directly serve 32 cities in Australia, from hubs in Brisbane, Melbourne and Sydney.[4]", "answer": "Virgin Australia commenced services on 31 August 2000 as Virgin Blue, with two aircraft on a single route.", "taskname": "genqa" } -

然后,通過更新默認 NeMo 配置文件的某些字段來設置微調作業,以適應當前的訓練任務。接著,使用 NeMo 訓練腳本啟動作業,運行微調并在過程中生成模型檢查點。

-

微調任務完成后,我們就可以運行筆記本內推理,生成一些示例輸出,并評估微調后模型的性能。

-

接著讓我們來看看這樣一個示例輸出。我們在上下文中提供了兩種產品的描述:割草機和廚房機器人,并詢問模型割草機是否由太陽能供電。

該模型準確地把握了上下文,并給出了“是”的回答。在對該模型進行微調后,它就能夠根據所提供的上下文準確回答我們的問題了。

{ "input": "Context: The Auto Chef Master is a personal kitchen robot that effortlessly turns raw ingredients into gourmet meals with the precision of a Michelin-star chef. The Eco Lawn Mower is a solar powered high-tech lawn mower that provides an eco-friendly and efficient way to maintain your lawn. Question: Is the lawn mower product solar powered? Answer:", "pred": "Yes", "label": "Yes, the Eco Lawn Mower is solar powered.", "taskname": "genqa" }

部署模型

NVIDIA AI FoundationEndpoints提供完全無服務器和可擴展的 API,這些 API 可部署在您自己的云或NVIDIA DGX Cloud上。填寫此表(https://developer.nvidia.com/login)即可開始使用 AI Foundation Endpoints。

您還可以使用NVIDIA AI Enterprise在自己的云或數據中心基礎設施上進行部署。這一端到端的云原生軟件平臺憑借其企業級的安全性、穩定性、可管理性和支持,能夠加速生產級生成式 AI 的開發和部署。當您準備從實驗轉向生產階段時,就可以使用 NVIDIA AI Enterprise 的企業級運行時來微調和部署這些模型。

更多信息

通過這篇文章,我們了解了 NVIDIA AI Foundation 模型是如何通過提供易于使用的模型體驗界面,以及簡化的模型微調和部署路徑,從而幫助企業開發者找到適合各種用例的模型。

歡迎探索NVIDIA NGC 目錄中提供的不同AI Foundation 模型(https://catalog.ngc.nvidia.com/ai-foundation-models),找到適合您的模型。

GTC 2024 將于 2024 年 3 月 18 至 21 日在美國加州圣何塞會議中心舉行,線上大會也將同期開放。點擊“閱讀原文”或掃描下方海報二維碼,立即注冊 GTC 大會。

原文標題:利用 NVIDIA AI Foundation Models 構建自定義企業級生成式 AI

文章出處:【微信公眾號:NVIDIA英偉達企業解決方案】歡迎添加關注!文章轉載請注明出處。

-

英偉達

+關注

關注

22文章

3800瀏覽量

91346

原文標題:利用 NVIDIA AI Foundation Models 構建自定義企業級生成式 AI

文章出處:【微信號:NVIDIA-Enterprise,微信公眾號:NVIDIA英偉達企業解決方案】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

NVIDIA推出多個生成式AI模型和藍圖

NVIDIA助力Amdocs打造生成式AI智能體

在設備上利用AI Edge Torch生成式API部署自定義大語言模型

生成式AI在制造業的應用現狀和前景展望

NVIDIA與思科合作打造企業級生成式AI基礎設施

NVIDIA AI助力SAP生成式AI助手Joule加速發展

NVIDIA攜手Meta推出AI服務,為企業提供生成式AI服務

NVIDIA AI Foundry 為全球企業打造自定義 Llama 3.1 生成式 AI 模型

揭秘NVIDIA AI Workbench 如何助力應用開發

利用 NVIDIA AI Foundation Models 構建自定義企業級生成式 AI

利用 NVIDIA AI Foundation Models 構建自定義企業級生成式 AI

評論