算法創新分為三種方式

第一種:面目一新的創新,比如Yolov1、Faster-RCNN、Centernet等,開創出新的算法領域,不過這種也是最難的。

第二種:守正出奇的創新,比如將圖像金字塔改進為特征金字塔。

第三種:各種先進算法集成的創新,比如不同領域發表的最新論文的tricks,集成到自己的算法中,卻發現有出乎意料的改進。

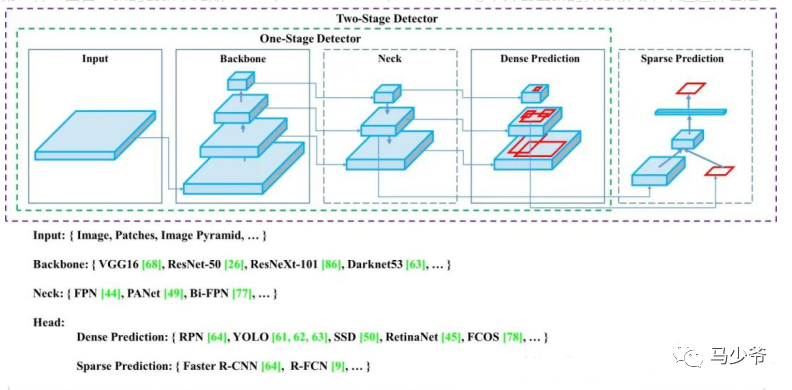

1)Backbone -形成圖像特征。

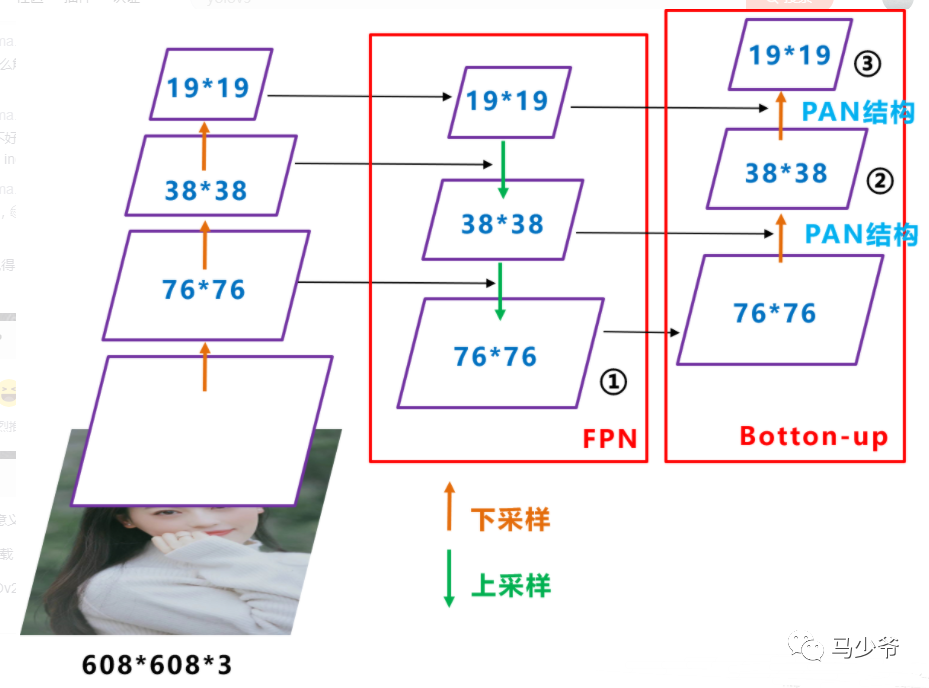

2)Neck:對圖像特征進行混合和組合,生成特征金字塔

3)Head:對圖像特征進行預測,應用錨定框,生成帶有類概率、對象得分和邊界框的最終輸出向量。

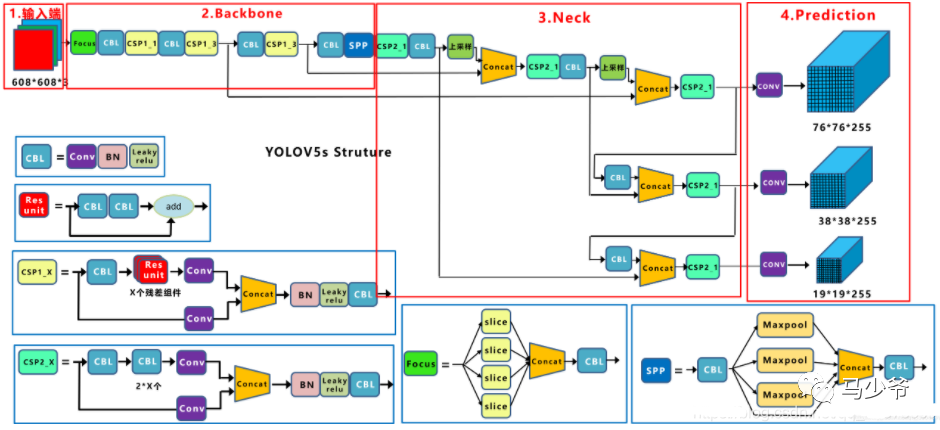

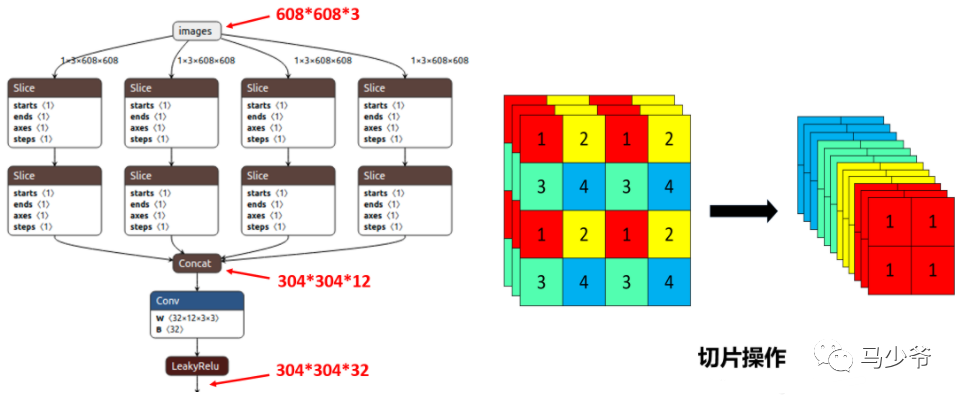

【Yolov5網絡結構圖】

可視化結構圖:

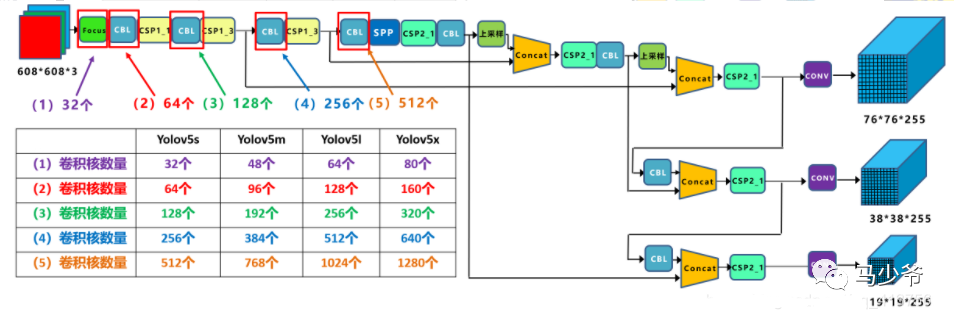

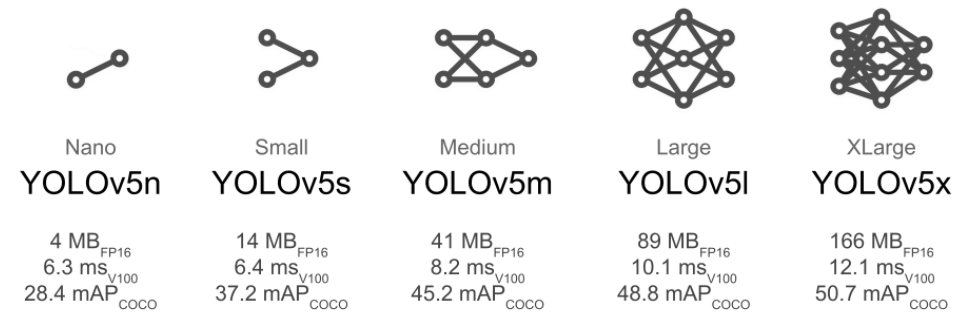

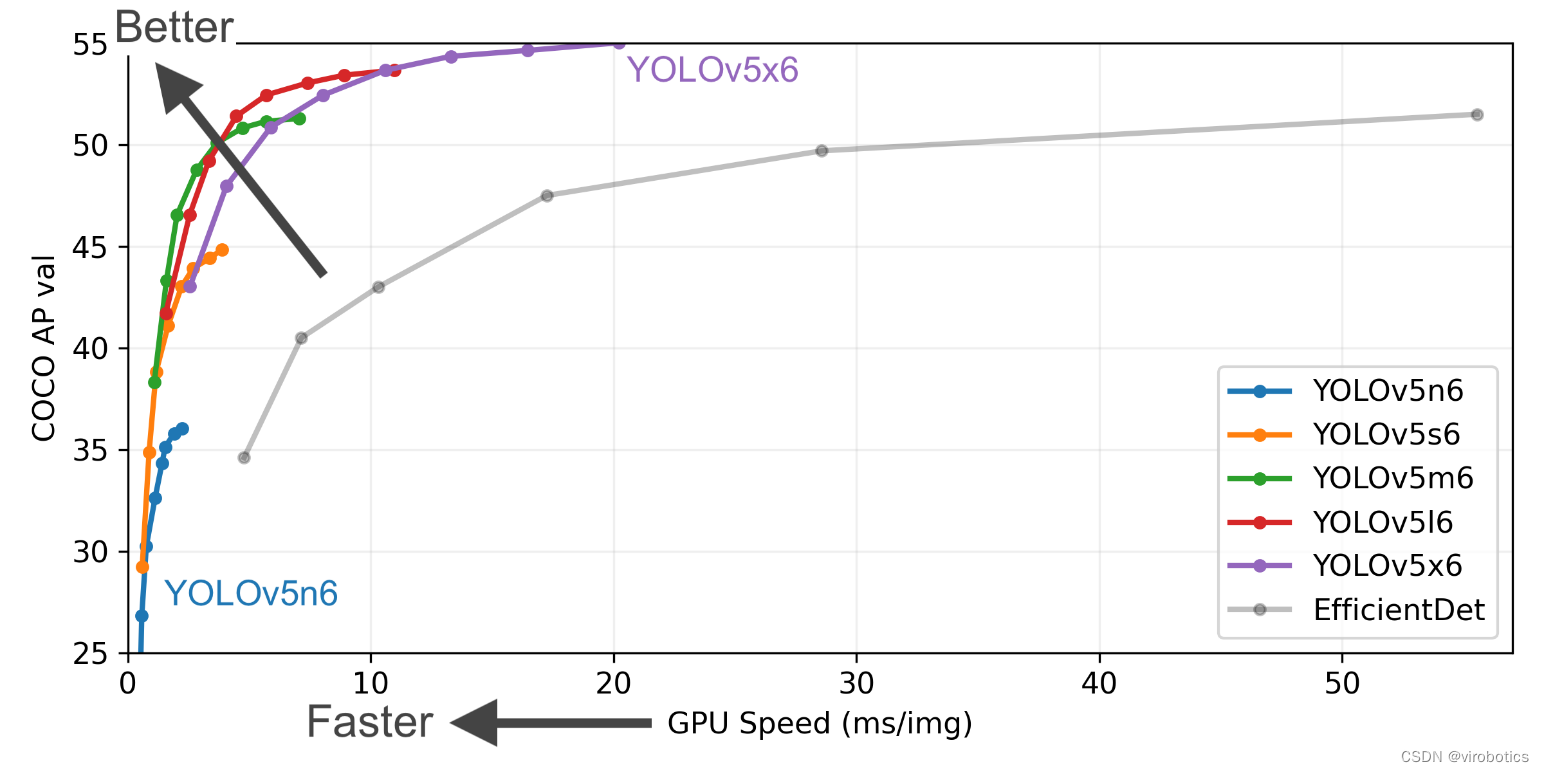

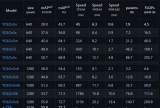

不同網絡的寬度:

V5x: 367MB,V5l: 192MB,V5m: 84MB,V5s: 27MB,YOLOV4: 245 MB

四種Yolov5結構在不同階段的卷積核的數量都是不一樣的,因此直接影響卷積后特征圖的第三維度

Yolov5s第一個Focus結構中:最后卷積操作時,卷積核的數量是32個,特征圖的大小變成304×304×32。

而Yolov5m:卷積操作使用了48個卷積核,特征圖變成304×304×48。

…后面卷積下采樣操作也是同樣的原理

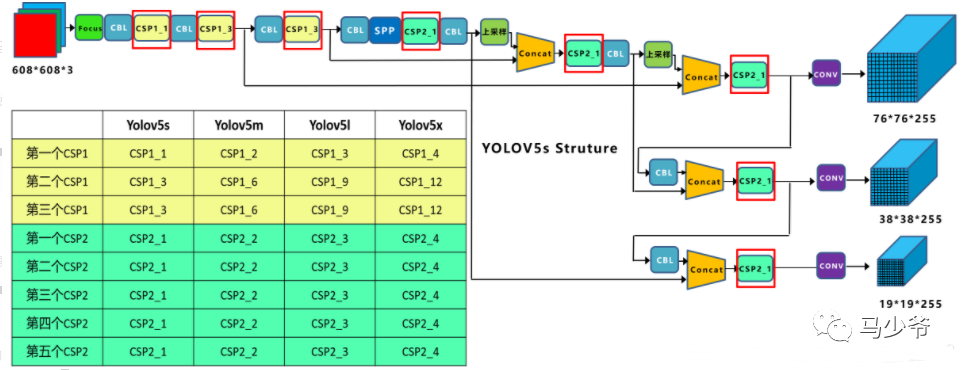

不同網絡的深度:

四種網絡結構中每個CSP結構的深度都是不同的

CSP1結構主要應用于Backbone中:

Yolov5s的CSP1:使用了1個殘差組件,CSP1_1。

Yolov5m:使用了2個殘差組件,CSP1_2。

Yolov5l,使用了3個殘差組件,

Yolov5x,使用了4個殘差組件。

主要的不同點:

(1)輸入端:Mosaic數據增強、自適應錨框計算、自適應圖片縮放

(2)Backbone:Focus結構,CSP結構

(3)Neck:FPN+PAN結構

【輸入端】

①數據增強:

Mosaic數據增強

②自適應錨定框Auto Learning Bounding Box Anchors

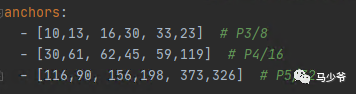

網絡在初始錨框的基礎上 基于訓練數據 輸出預測框,因此初始錨框也是比較重要的一部分。見配置文件*.yaml, yolov5預設了COCO數據集640×640圖像大小的錨定框的尺寸:

每次訓練時,自適應的計算不同訓練集中的最佳錨框值。如果覺得計算的錨框效果不是很好,也可以在代碼中將自動計算錨框功能關閉。具體操作為train.py中下面一行代碼,設置成False

③自適應圖片縮放

在常用的目標檢測算法中,一般將原始圖片統一縮放到一個標準尺寸,再送入檢測網絡中。Yolo算法中常用416416,608608等尺寸。因為填充的比較多,會存在信息冗余,所以yolov5對原始圖像自適應的添加最少的黑邊。

【Backbone】

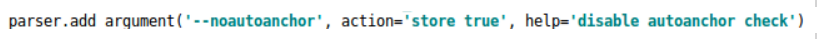

①Focus結構

以Yolov5s的結構為例,原始608x608x3的圖像輸入Focus結構,采用切片操作,先變成304x304x12的特征圖,再經過一次32個卷積核的卷積操作,最終變成304x304x32的特征圖。

②CSP結構

作者認為推理計算過高的問題是由于網絡優化中的梯度信息重復致,CSPNet(Cross Stage Paritial Network, 跨階段局部網絡),主要從網絡結構設計的角度解決推理中計算量很大的問題。

Yolov5中設計了兩種CSP結構,以Yolov5s網絡為例,CSP1_X結構應用于Backbone主干網絡,另一種CSP2_X結構則應用于Neck中。

【Neck】

FPN+PAN,網絡特征融合的能力更強

PAN(路徑聚合網絡)借鑒了圖像分割領域PANet的創新點

該作者認為在對象檢測中,特征融合層的性能非常重要,根據谷歌大腦的研究,[BiFPN]才是特征融合層的最佳選擇。誰能整合這項技術,很有可能取得性能大幅超越。

【輸出端】

①Activation Function

在 YOLO V5中,中間/隱藏層使用了 Leaky ReLU 激活函數,最后的檢測層使用了 Sigmoid 形激活函數

②nms非極大值抑制

在同樣的參數情況下,將nms中IOU修改成DIOU_nms。對于一些遮擋重疊的目標,會有一些改進。

③Optimization Function

YOLO V5的作者為我們提供了兩個優化函數Adam和SGD,并都預設了與之匹配的訓練超參數。默認為SGD。

④Cost Function

loss = objectness score+class probability score+ bounding box regression score

YOLO V5使用 GIOU Loss作為bounding box的損失。

YOLO V5使用二進制交叉熵和 Logits 損失函數計算類概率和目標得分的損失。同時我們也可以使用fl _ gamma參數來激活Focal loss計算損失函數。

-

算法

+關注

關注

23文章

4620瀏覽量

93047 -

圖像分割

+關注

關注

4文章

182瀏覽量

18019 -

函數

+關注

關注

3文章

4338瀏覽量

62739

原文標題:Yolov5理論學習筆記

文章出處:【微信號:vision263com,微信公眾號:新機器視覺】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

【YOLOv5】LabVIEW+YOLOv5快速實現實時物體識別(Object Detection)含源碼

龍哥手把手教你學視覺-深度學習YOLOV5篇

怎樣使用PyTorch Hub去加載YOLOv5模型

如何YOLOv5測試代碼?

yolov5模型onnx轉bmodel無法識別出結果如何解決?

基于YOLOv5的目標檢測文檔進行的時候出錯如何解決?

在C++中使用OpenVINO工具包部署YOLOv5模型

淺析基于改進YOLOv5的輸電線路走廊滑坡災害識別

yolov5和YOLOX正負樣本分配策略

Yolov5理論學習筆記

Yolov5理論學習筆記

評論