環境配置

安裝依賴包

如果在當前python環境下能利用pip install onnx輕松安裝onnx,直接配置YOLOv5的環境即可;如果環境安裝有一些限制,建議跑模型的python環境為3.10。

# 在指定路徑下創建虛擬環境,我的anaconda安裝在c盤,但我想把環境放在d盤,所以利用--prefix D:\Anaconda3\envs\yolov5指定路徑 conda create --prefix D:\Anaconda3\envs\yolov5 python=3.10 # 切換虛擬環境 conda activate D:\Anaconda3\envs\yolov5 # 安裝關鍵包ONNX pip install -i https://pypi.tuna.tsinghua.edu.cn/simple onnx # 安裝yolov5依賴的pytorch pip install "torch-1.11.0+cu113-cp310-cp310-win_amd64.whl" "torchaudio-0.11.0+cu113-cp310-cp310-win_amd64.whl" "torchvision-0.12.0+cu113-cp310-cp310-win_amd64.whl" -i https://pypi.tuna.tsinghua.edu.cn/simple # 安裝yolov5需要的包 pip install -i https://pypi.tuna.tsinghua.edu.cn/simple matplotlib>=3.2.2 numpy>=1.18.5 opencv-python>=4.1.1 Pillow>=7.1.2 PyYAML>=5.3.1 requests>=2.23.0 scipy>=1.4.1 tqdm>=4.64.0 tensorboard>=2.4.1 pandas>=1.1.4 seaborn>=0.11.0 ipython psutil thop>=0.1.1

運行YOLOv5

下載文件,參照如下流程操作:

①解壓yolov5-master.zip;

②將zidane.jpg放到yolov5-master文件夾中;

③將yolov5s.pt放到yolov5-master/models文件夾中;

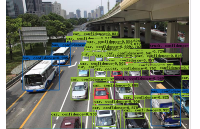

④進入yolov5-master文件夾,輸入python .\detect.py --weights .\models\yolov5s.pt --source zidane.jpg,代碼會輸出檢測結果保存路徑(以我為例:Results saved to runs\detect\exp9)檢測結果如下所示。

PyTorch的pt模型文件轉onnx

注意:BPU的工具鏈沒有支持onnx的所有版本的算子,即當前BPU支持onnx的opset版本為10和11。

# 錯誤的轉換指令 python .\export.py --weights .\models\yolov5s.pt --include onnx # 正確的轉換指令 python .\export.py --weights .\models\yolov5s.pt --include onnx --opset 11

轉換后,控制臺會輸出一些log信息,轉換后的模型文件在.\models\yolov5s.pt。

export: data=D:\05 - \01 - x3\BPUCodes\yolov5\yolov5-master\data\coco128.yaml, weights=['.\\models\\yolov5s.pt'], imgsz=[640, 640], batch_size=1, device=cpu, half=False, inplace=False, train=False, keras=False, optimize=False, int8=False, dynamic=False, simplify=False, opset=12, verbose=False, workspace=4, nms=False, agnostic_nms=False, topk_per_class=100, topk_all=100, iou_thres=0.45, conf_thres=0.25, include=['onnx'] YOLOv5 2022-9-1 Python-3.10.4 torch-1.11.0+cu113 CPU Fusing layers... YOLOv5s summary: 213 layers, 7225885 parameters, 0 gradients PyTorch: starting from models\yolov5s.pt with output shape (1, 25200, 85) (14.1 MB) ONNX: starting export with onnx 1.12.0... ONNX: export success 3.6s, saved as models\yolov5s.onnx (28.0 MB) Export complete (4.2s) Results saved to D:\05 - \01 - x3\BPUCodes\yolov5\yolov5-master\models Detect: python detect.py --weights models\yolov5s.onnx Validate: python val.py --weights models\yolov5s.onnx PyTorch Hub: model = torch.hub.load('ultralytics/yolov5', 'custom', 'models\yolov5s.onnx') Visualize: https://netron.app

模型轉換

新建一個文件夾bpucodes(可根據喜好自行命名),把前面轉好的yolov5s.onnx放進這個文件夾里,在docker中,進入bpucodes文件夾,開始我們的模型轉換。

(PS:模型轉換需在docker中轉換,怎么安裝docker,怎么進入OE,怎么掛載硬盤等相關問題可在系列一中進行查看)

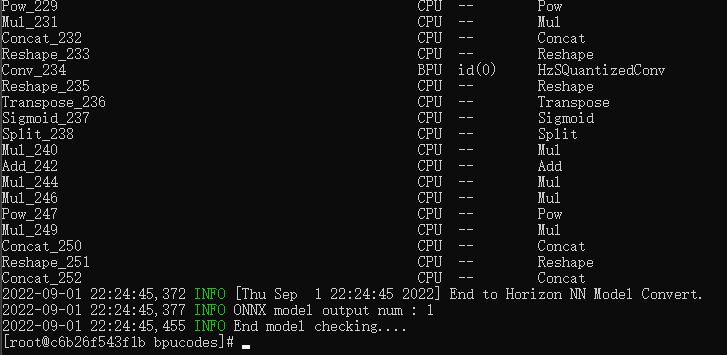

模型檢查

模型檢測的目的是檢測有沒有不支持的算子,輸入指令hb_mapper checker --model-type onnx --march bernoulli2 --model yolov5s.onnx,開始檢查模型,顯示如下內容表示模型檢查通過。這時可以發現網絡的后端部分存在一些層是運行在CPU上的,這會導致耗時多一些。

準備校準數據

校準數據的代碼參考系列一中的YOLOv3的校準代碼,整體沒有太多改變,輸入prepare_calibration_data.py可以得到校準數據。

# 修改輸入圖像大小為640x640 img = imequalresize(img, (640, 640)) # 指定輸出的校準圖像根目錄 dst_root = '/data/horizon_x3/codes/yolov5/bpucodes/calibration_data

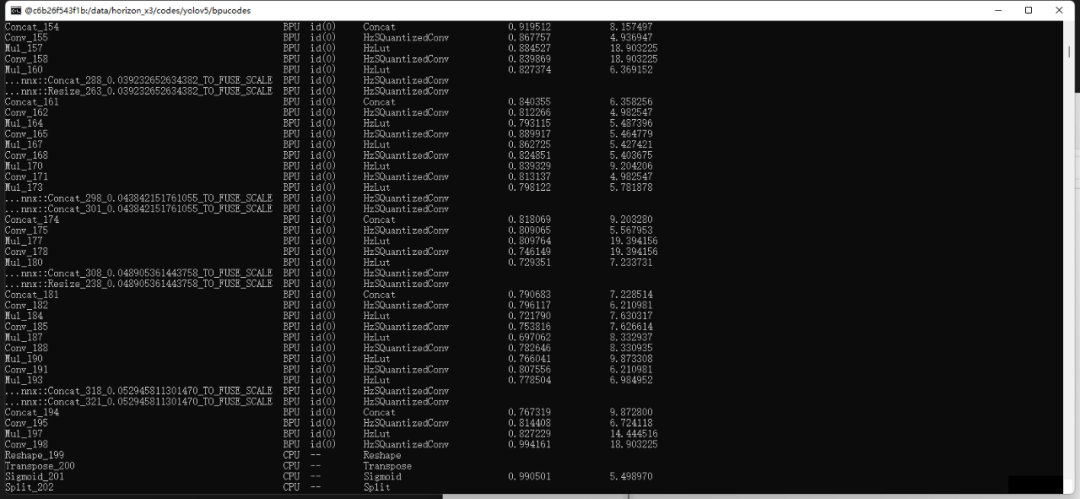

開始轉換BPU模型

輸入命令hb_mapper makertbin --config convert_yolov5s.yaml --model-type onnx開始轉換我們的模型。校準過后會輸出每一層的量化損失,轉換成功后,得到model_output/yolov5s.bin,這個文件拿出來,拷貝到旭日X3派上使用,它也是我們上板運行所需要的模型文件。

上板運行

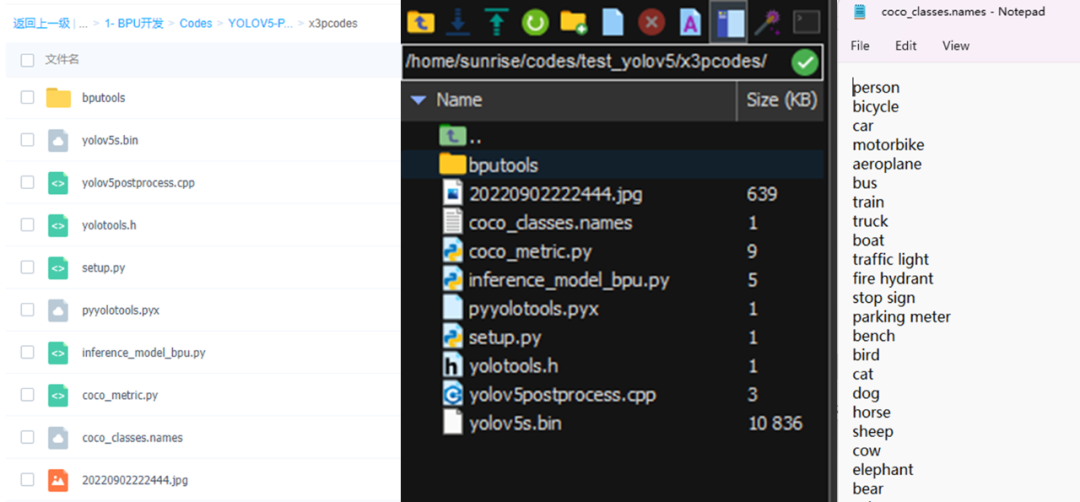

文件準備

下載百度云的文件,拷貝到旭日X3派開發板中,其中yolov5s.bin就是我們轉換后的模型,coco_classes.names僅用在畫框的時候,如果用自己的數據集的話,參考coco_classes.names創建個新的名字文件即可。

輸入sudo apt-get install libopencv-dev安裝opencv庫,之后進入代碼根目錄,輸入python3 setup.py build_ext --inplace,編譯后處理代碼,得到lib/pyyolotools.cpython-38-aarch64-linux-gnu.so文件。

運行推理代碼

模型推理的代碼如下所示,其中yolotools.pypostprocess_yolov5為C++實現的后處理功能,推理代碼在我這里保存為inference_model_bpu.py。

import numpy as np import cv2 import os from hobot_dnn import pyeasy_dnn as dnn from bputools.format_convert import imequalresize, bgr2nv12_opencv # lib.pyyolotools為封裝的庫 import lib.pyyolotools as yolotools def get_hw(pro): if pro.layout == "NCHW": return pro.shape[2], pro.shape[3] else: return pro.shape[1], pro.shape[2] def format_yolov5(frame): row, col, _ = frame.shape _max = max(col, row) result = np.zeros((_max, _max, 3), np.uint8) result[0:row, 0:col] = frame return result # img_path 圖像完整路徑 img_path = '20220904134315.jpg' # model_path 量化模型完整路徑 model_path = 'yolov5s.bin' # 類別名文件 classes_name_path = 'coco_classes.names' # 設置參數 thre_confidence = 0.4 thre_score = 0.25 thre_nms = 0.45 # 框顏色設置 colors = [(255, 255, 0), (0, 255, 0), (0, 255, 255), (255, 0, 0)] # 1. 加載模型,獲取所需輸出HW models = dnn.load(model_path) model_h, model_w = get_hw(models[0].inputs[0].properties) print(model_h, model_w) # 2 加載圖像,根據前面模型,轉換后的模型是以NV12作為輸入的 # 但在OE驗證的時候,需要將圖像再由NV12轉為YUV444 imgOri = cv2.imread(img_path) inputImage = format_yolov5(imgOri) img = imequalresize(inputImage, (model_w, model_h)) nv12 = bgr2nv12_opencv(img) # 3 模型推理 t1 = cv2.getTickCount() outputs = models[0].forward(nv12) t2 = cv2.getTickCount() outputs = outputs[0].buffer # 25200x85x1 print('time consumption {0} ms'.format((t2-t1)*1000/cv2.getTickFrequency())) # 4 后處理 image_width, image_height, _ = inputImage.shape fx, fy = image_width / model_w, image_height / model_h t1 = cv2.getTickCount() class_ids, confidences, boxes = yolotools.pypostprocess_yolov5(outputs[0][:, :, 0], fx, fy, thre_confidence, thre_score, thre_nms) t2 = cv2.getTickCount() print('post consumption {0} ms'.format((t2-t1)*1000/cv2.getTickFrequency())) # 5 繪制檢測框 with open(classes_name_path, "r") as f: class_list = [cname.strip() for cname in f.readlines()] t1 = cv2.getTickCount() for (classid, confidence, box) in zip(class_ids, confidences, boxes): color = colors[int(classid) % len(colors)] cv2.rectangle(imgOri, box, color, 2) cv2.rectangle(imgOri, (box[0], box[1] - 20), (box[0] + box[2], box[1]), color, -1) cv2.putText(imgOri, class_list[classid], (box[0], box[1] - 10), cv2.FONT_HERSHEY_SIMPLEX, .5, (0,0,0)) t2 = cv2.getTickCount() print('draw rect consumption {0} ms'.format((t2-t1)*1000/cv2.getTickFrequency())) cv2.imwrite('res.png', imgOri)

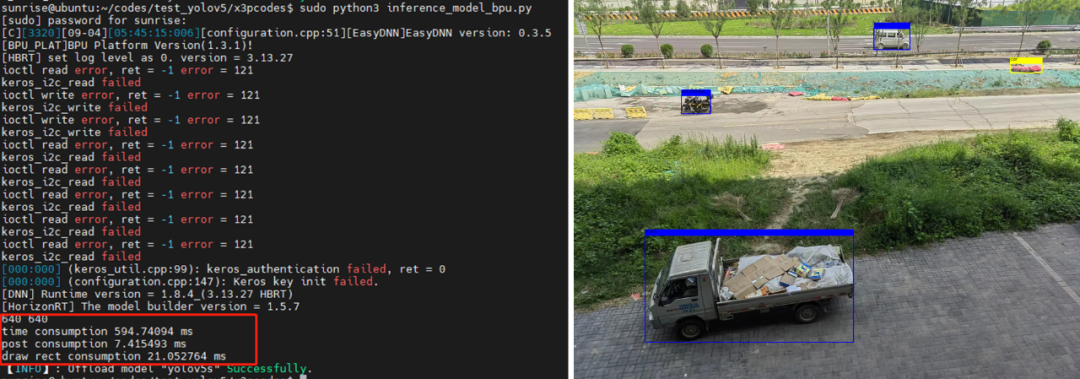

輸入sudo python3 inference_model_bpu.py,推理結果保存為res.png,相關結果如下所示,可以看出,后處理部分耗時為7ms,C++和Python混編有效提升了代碼的運行速度。

利用Cython封裝后處理代碼

①寫后處理的C++代碼

首先,創建頭文件yolotools.h,用來記錄函數聲明,方便其他代碼調用。因為Cython調用時,調用C++的一些類并不方便,所以寫成C語言接口更方便調用。后處理的函數名為postprocess_yolov5,創建yolov5postprocess.cpp來對后處理函數進行實現。

②寫Cython所需的Pyx文件

同級目錄下創建pyyolotools.pyx,切記文件名不要跟某個CPP重復了,因為cython會將pyyolotools.pyx轉為pyyolotools.cpp,如果有重復的話可能會導致文件被覆蓋掉。

③寫編譯Pyx所需的python代碼

創建setup.py文件,將下面代碼放進去,配置好opencv的頭文件目錄、庫目錄、以及所需的庫文件。在Extension中配置封裝的函數所依賴的文件,然后在控制臺輸入python3 setup.py build_ext --inplace即可。

本文轉自地平線開發者社區

原作者:小璽璽

-

python

+關注

關注

56文章

4800瀏覽量

84821 -

BPU

+關注

關注

0文章

4瀏覽量

1958

發布評論請先 登錄

相關推薦

《手把手教你做PC》課程即將啟動!深開鴻引領探索KaihongOS筆記本電腦開發實戰

采用華為云 Flexus 云服務器 X 實例部署 YOLOv3 算法完成目標檢測

在RK3568教學實驗箱上實現基于YOLOV5的算法物體識別案例詳解

在樹莓派上部署YOLOv5進行動物目標檢測的完整流程

YOLOv6在LabVIEW中的推理部署(含源碼)

基于迅為RK3588【RKNPU2項目實戰1】:YOLOV5實時目標分類

YOLOv5的原理、結構、特點和應用

手把手教你排序算法怎么寫

用yolov5的best.pt導出成onnx轉化成fp32 bmodel后在Airbox上跑,報維度不匹配怎么處理?

maixcam部署yolov5s 自定義模型

yolov5轉onnx在cubeAI上部署失敗的原因?

基于OpenCV DNN實現YOLOv8的模型部署與推理演示

旭日X3派BPU部署教程系列之手把手帶你成功部署YOLOv5

旭日X3派BPU部署教程系列之手把手帶你成功部署YOLOv5

評論