?背景

?背景

在機(jī)器學(xué)習(xí)領(lǐng)域中,學(xué)習(xí)不平衡的標(biāo)注數(shù)據(jù)一直是一個(gè)常見(jiàn)而具有挑戰(zhàn)性的任務(wù)。近年來(lái),視覺(jué) Transformer 作為一種強(qiáng)大的模型,在多個(gè)視覺(jué)任務(wù)上展現(xiàn)出令人滿意的效果。然而,視覺(jué) Transformer 處理長(zhǎng)尾分布數(shù)據(jù)的能力和特性,還有待進(jìn)一步挖掘。

目前,已有的長(zhǎng)尾識(shí)別模型很少直接利用長(zhǎng)尾數(shù)據(jù)對(duì)視覺(jué) Transformer(ViT)進(jìn)行訓(xùn)練。基于現(xiàn)成的預(yù)訓(xùn)練權(quán)重進(jìn)行研究可能會(huì)導(dǎo)致不公平的比較結(jié)果,因此有必要對(duì)視覺(jué) Transformer 在長(zhǎng)尾數(shù)據(jù)下的表現(xiàn)進(jìn)行系統(tǒng)性的分析和總結(jié)。

論文鏈接:

https://arxiv.org/abs/2212.02015代碼鏈接:

https://github.com/XuZhengzhuo/LiVT 本文旨在填補(bǔ)這一研究空白,詳細(xì)探討了視覺(jué) Transformer 在處理長(zhǎng)尾數(shù)據(jù)時(shí)的優(yōu)勢(shì)和不足之處。本文將重點(diǎn)關(guān)注如何有效利用長(zhǎng)尾數(shù)據(jù)來(lái)提升視覺(jué) Transformer 的性能,并探索解決數(shù)據(jù)不平衡問(wèn)題的新方法。通過(guò)本文的研究和總結(jié),研究團(tuán)隊(duì)有望為進(jìn)一步改進(jìn)視覺(jué) Transformer 模型在長(zhǎng)尾數(shù)據(jù)任務(wù)中的表現(xiàn)提供有益的指導(dǎo)和啟示。這將為解決現(xiàn)實(shí)世界中存在的數(shù)據(jù)不平衡問(wèn)題提供新的思路和解決方案。 文章通過(guò)一系列實(shí)驗(yàn)發(fā)現(xiàn),在有監(jiān)督范式下,視覺(jué) Transformer 在處理不平衡數(shù)據(jù)時(shí)會(huì)出現(xiàn)嚴(yán)重的性能衰退,而使用平衡分布的標(biāo)注數(shù)據(jù)訓(xùn)練出的視覺(jué) Transformer 呈現(xiàn)出明顯的性能優(yōu)勢(shì)。相比于卷積網(wǎng)絡(luò),這一特點(diǎn)在視覺(jué) Transformer 上體現(xiàn)的更為明顯。另一方面,無(wú)監(jiān)督的預(yù)訓(xùn)練方法無(wú)需標(biāo)簽分布,因此在相同的訓(xùn)練數(shù)據(jù)量下,視覺(jué) Transformer 可以展現(xiàn)出類似的特征提取和重建能力。 基于以上觀察和發(fā)現(xiàn),研究提出了一種新的學(xué)習(xí)不平衡數(shù)據(jù)的范式,旨在讓視覺(jué) Transformer 模型更好地適應(yīng)長(zhǎng)尾數(shù)據(jù)。通過(guò)這種范式的引入,研究團(tuán)隊(duì)希望能夠充分利用長(zhǎng)尾數(shù)據(jù)的信息,提高視覺(jué) Transformer 模型在處理不平衡標(biāo)注數(shù)據(jù)時(shí)的性能和泛化能力。 ?文章貢獻(xiàn)

本文是第一個(gè)系統(tǒng)性的研究用長(zhǎng)尾數(shù)據(jù)訓(xùn)練視覺(jué) Transformer 的工作,在此過(guò)程中,做出了以下主要貢獻(xiàn):

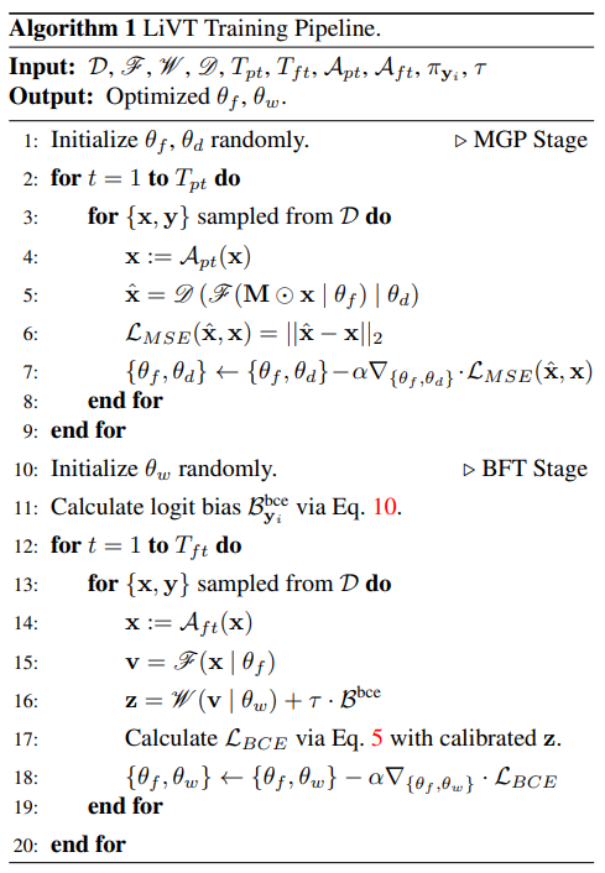

首先,本文深入分析了傳統(tǒng)有監(jiān)督訓(xùn)練方式對(duì)視覺(jué) Transformer 學(xué)習(xí)不均衡數(shù)據(jù)的限制因素,并基于此提出了雙階段訓(xùn)練流程,將視覺(jué) Transformer 模型內(nèi)在的歸納偏置和標(biāo)簽分布的統(tǒng)計(jì)偏置分階段學(xué)習(xí),以降低學(xué)習(xí)長(zhǎng)尾數(shù)據(jù)的難度。其中第一階段采用了流行的掩碼重建預(yù)訓(xùn)練,第二階段采用了平衡的損失進(jìn)行微調(diào)監(jiān)督。

?文章貢獻(xiàn)

本文是第一個(gè)系統(tǒng)性的研究用長(zhǎng)尾數(shù)據(jù)訓(xùn)練視覺(jué) Transformer 的工作,在此過(guò)程中,做出了以下主要貢獻(xiàn):

首先,本文深入分析了傳統(tǒng)有監(jiān)督訓(xùn)練方式對(duì)視覺(jué) Transformer 學(xué)習(xí)不均衡數(shù)據(jù)的限制因素,并基于此提出了雙階段訓(xùn)練流程,將視覺(jué) Transformer 模型內(nèi)在的歸納偏置和標(biāo)簽分布的統(tǒng)計(jì)偏置分階段學(xué)習(xí),以降低學(xué)習(xí)長(zhǎng)尾數(shù)據(jù)的難度。其中第一階段采用了流行的掩碼重建預(yù)訓(xùn)練,第二階段采用了平衡的損失進(jìn)行微調(diào)監(jiān)督。

?

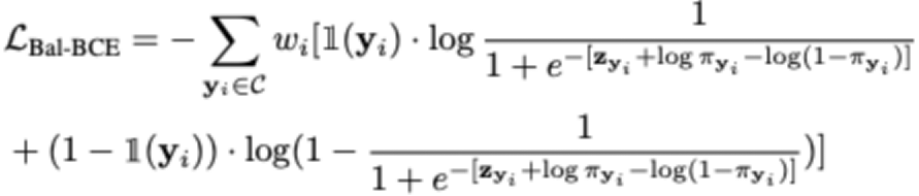

?其次,本文提出了平衡的二進(jìn)制交叉熵?fù)p失函數(shù),并給出了嚴(yán)格的理論推導(dǎo)。平衡的二進(jìn)制交叉熵?fù)p失的形式如下:

?

?其次,本文提出了平衡的二進(jìn)制交叉熵?fù)p失函數(shù),并給出了嚴(yán)格的理論推導(dǎo)。平衡的二進(jìn)制交叉熵?fù)p失的形式如下:

?

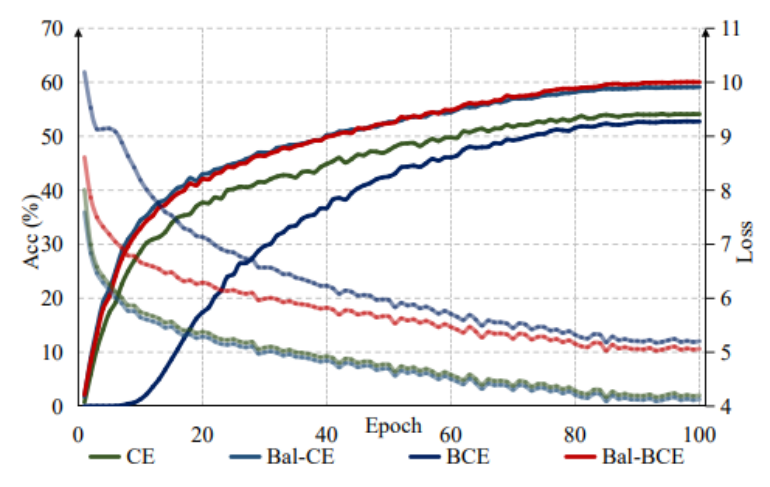

?與之前的平衡交叉熵?fù)p失相比,本文的損失函數(shù)在視覺(jué) Transformer 模型上展現(xiàn)出更好的性能,并且具有更快的收斂速度。研究中的理論推導(dǎo)為損失函數(shù)的合理性提供了嚴(yán)密的解釋,進(jìn)一步加強(qiáng)了我們方法的可靠性和有效性。

?

?與之前的平衡交叉熵?fù)p失相比,本文的損失函數(shù)在視覺(jué) Transformer 模型上展現(xiàn)出更好的性能,并且具有更快的收斂速度。研究中的理論推導(dǎo)為損失函數(shù)的合理性提供了嚴(yán)密的解釋,進(jìn)一步加強(qiáng)了我們方法的可靠性和有效性。

▲不同損失函數(shù)的收斂速度的比較

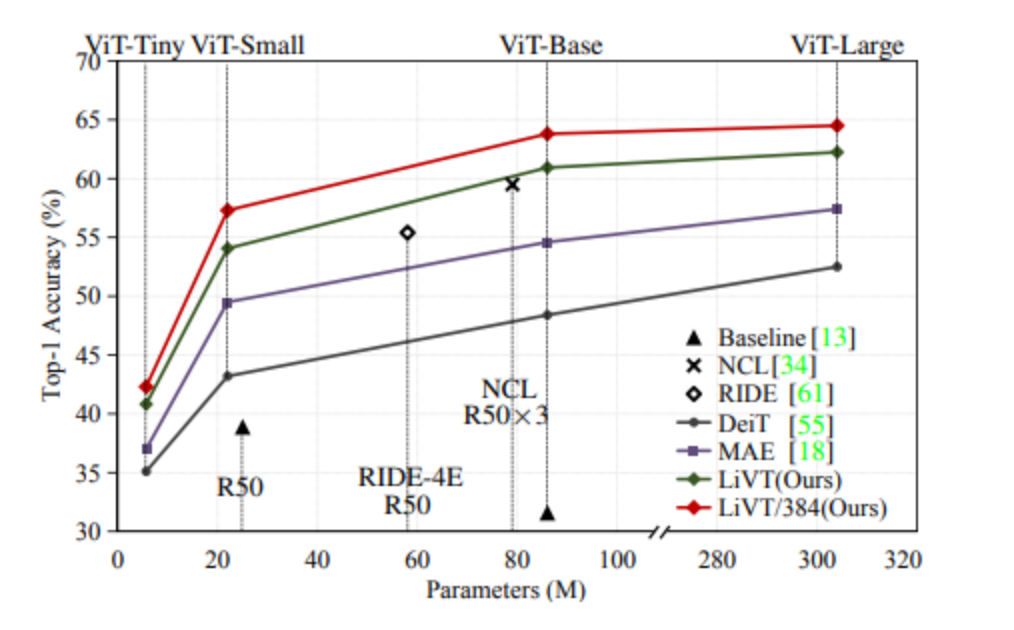

基于以上貢獻(xiàn),文章提出了一個(gè)全新的學(xué)習(xí)范式 LiVT,充分發(fā)揮視覺(jué) Transformer 模型在長(zhǎng)尾數(shù)據(jù)上的學(xué)習(xí)能力,顯著提升模型在多個(gè)數(shù)據(jù)集上的性能。該方案在多個(gè)數(shù)據(jù)集上取得了遠(yuǎn)好于視覺(jué) Transformer 基線的性能表現(xiàn)。

▲不同損失函數(shù)的收斂速度的比較

基于以上貢獻(xiàn),文章提出了一個(gè)全新的學(xué)習(xí)范式 LiVT,充分發(fā)揮視覺(jué) Transformer 模型在長(zhǎng)尾數(shù)據(jù)上的學(xué)習(xí)能力,顯著提升模型在多個(gè)數(shù)據(jù)集上的性能。該方案在多個(gè)數(shù)據(jù)集上取得了遠(yuǎn)好于視覺(jué) Transformer 基線的性能表現(xiàn)。

▲不同參數(shù)量下在ImageNet-LT上的準(zhǔn)確性

▲不同參數(shù)量下在ImageNet-LT上的準(zhǔn)確性

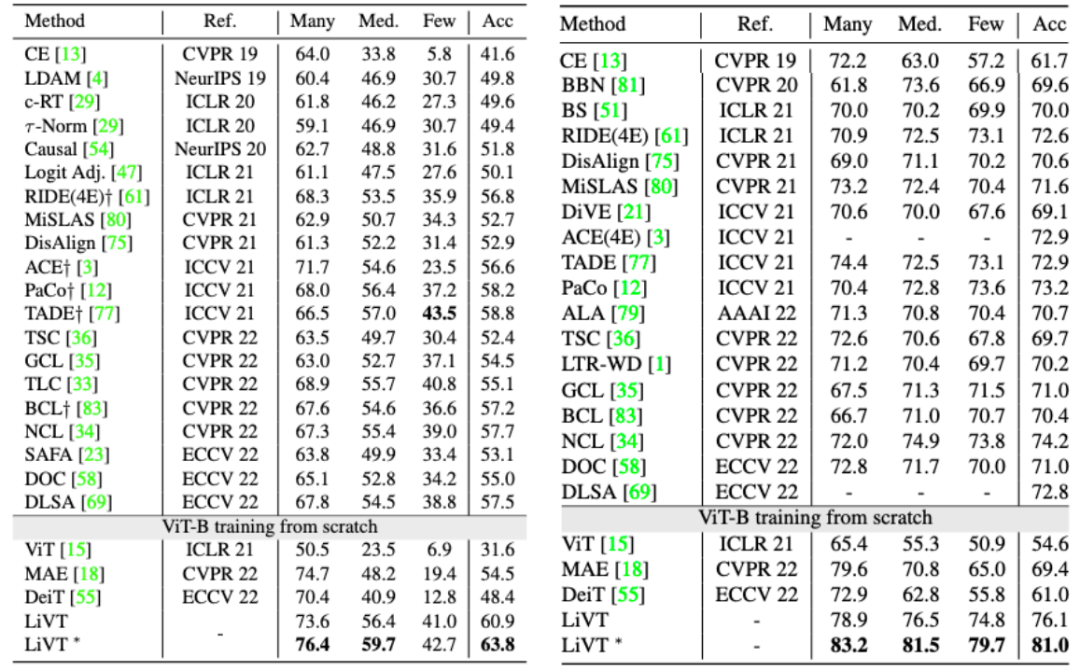

▲在ImagNet-LT(左)和iNaturalist18(右)數(shù)據(jù)集上的性能表現(xiàn)

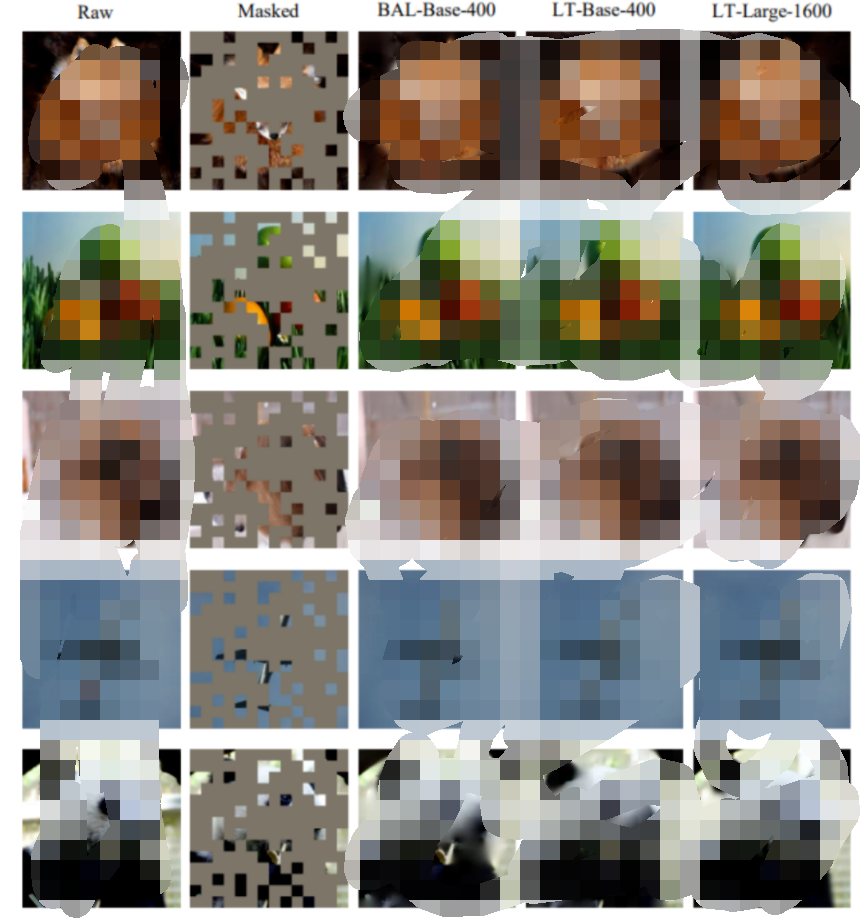

▲在ImagNet-LT(左)和iNaturalist18(右)數(shù)據(jù)集上的性能表現(xiàn)同時(shí),本文還驗(yàn)證了在相同的訓(xùn)練數(shù)據(jù)規(guī)模的情況下,使用ImageNet的長(zhǎng)尾分布子集(LT)和平衡分布子集(BAL)訓(xùn)練的 ViT-B 模型展現(xiàn)出相近的重建能力。如 LT-Large-1600 列所示,在 ImageNet-LT 數(shù)據(jù)集中,可以通過(guò)更大的模型和 MGP epoch 獲得更好的重建結(jié)果。

?

?

?

? ?

?總結(jié)

本文提供了一種新的基于視覺(jué) Transformer 處理不平衡數(shù)據(jù)的方法 LiVT。LiVT 利用掩碼建模和平衡微調(diào)兩個(gè)階段的訓(xùn)練策略,使得視覺(jué) Transformer 能夠更好地適應(yīng)長(zhǎng)尾數(shù)據(jù)分布并學(xué)習(xí)到更通用的特征表示。該方法不僅在實(shí)驗(yàn)中取得了顯著的性能提升,而且無(wú)需額外的數(shù)據(jù),具有實(shí)際應(yīng)用的可行性。 論文的更多細(xì)節(jié)請(qǐng)參考論文原文和補(bǔ)充材料。

原文標(biāo)題:CVPR 2023 | 清華大學(xué)提出LiVT,用視覺(jué)Transformer學(xué)習(xí)長(zhǎng)尾數(shù)據(jù)

文章出處:【微信公眾號(hào):智能感知與物聯(lián)網(wǎng)技術(shù)研究所】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

-

物聯(lián)網(wǎng)

+關(guān)注

關(guān)注

2912文章

44877瀏覽量

375665

原文標(biāo)題:CVPR 2023 | 清華大學(xué)提出LiVT,用視覺(jué)Transformer學(xué)習(xí)長(zhǎng)尾數(shù)據(jù)

文章出處:【微信號(hào):tyutcsplab,微信公眾號(hào):智能感知與物聯(lián)網(wǎng)技術(shù)研究所】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

清華大學(xué)未央書院一行到訪光峰科技參觀交流

清華大學(xué)師生到訪智行者科技交流學(xué)習(xí)

清華大學(xué)創(chuàng)新領(lǐng)軍工程博士團(tuán)隊(duì)調(diào)研芯和半導(dǎo)體

博世與清華大學(xué)續(xù)簽人工智能研究合作協(xié)議

京微齊力受邀參加2024年清華大學(xué)工程博士論壇

英諾達(dá)與清華大學(xué)攜手,共促國(guó)產(chǎn)EDA進(jìn)步

清華新力量,滬上芯征程!清華大學(xué)上海校友會(huì)半導(dǎo)體專委會(huì)2024思瑞浦迎新日

熱烈歡迎清華大學(xué)電子工程系學(xué)子來(lái)武漢六博光電交流實(shí)踐!

易華錄無(wú)錫數(shù)據(jù)湖與清華大學(xué)蘇州汽車研究院(吳江)合作挖掘智能駕駛數(shù)據(jù)新價(jià)值

清華大學(xué)研發(fā)新型仿生三維電子皮膚系統(tǒng)

世界首款!又是清華:類腦互補(bǔ)視覺(jué)芯片“天眸芯”

清華大學(xué)創(chuàng)新領(lǐng)軍工程博士團(tuán)訪問(wèn)摩爾線程

清華大學(xué)創(chuàng)新領(lǐng)軍工程博士代表團(tuán)到訪摩爾線程,深化產(chǎn)學(xué)合作

清華大學(xué)聯(lián)合中交興路發(fā)布《中國(guó)公路貨運(yùn)大數(shù)據(jù)碳排放報(bào)告》

CVPR 2023 | 清華大學(xué)提出LiVT,用視覺(jué)Transformer學(xué)習(xí)長(zhǎng)尾數(shù)據(jù)

CVPR 2023 | 清華大學(xué)提出LiVT,用視覺(jué)Transformer學(xué)習(xí)長(zhǎng)尾數(shù)據(jù)

評(píng)論