摘要

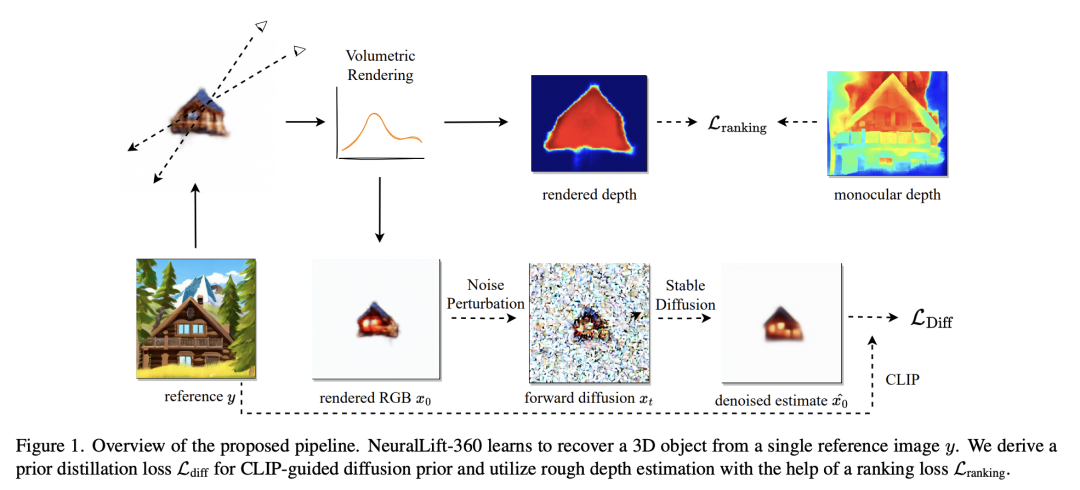

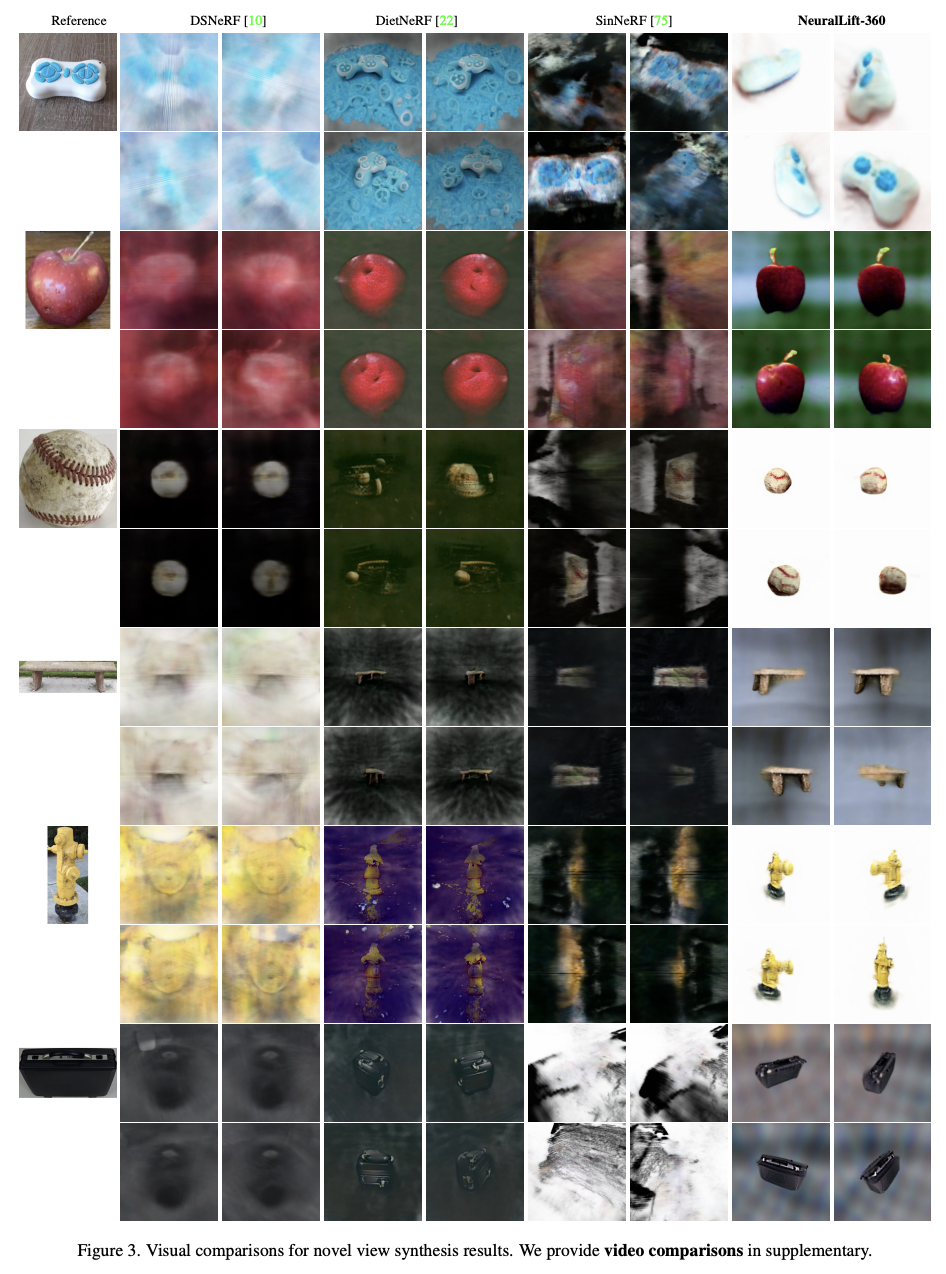

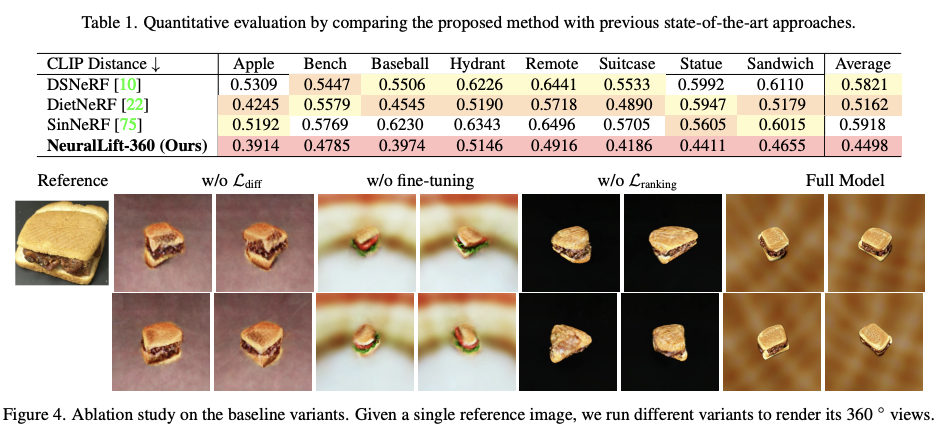

虛擬現實和增強現實(XR)帶來了對3D內容生成的不斷增長需求。然而,創建高質量的3D內容需要人類專家進行繁瑣的工作。在本文中,我們研究了將單個圖像提升為3D對象的具有挑戰性的任務,并首次展示了能夠生成與給定參考圖像相對應的具有360°視圖的可信3D對象。通過條件化參考圖像,我們的模型可以滿足從圖像合成物體新視角的永恒好奇心。我們提出了NeuralLift-360,一種新穎框架,利用深度感知神經輻射場生成可信3D對象,并通過CLIP引導擴散先驗學習概率驅動3D提升,并通過比例不變深度排名損失減輕深度誤差。我們在真實和合成圖像上進行了全面實驗,在這些實驗中,NeuralLift-360優于當前最先進方法。

主要貢獻

? 針對野外的單張圖片,我們展示了將其提升到3D的有前景的結果。我們使用NeRF作為有效的場景表示,并整合來自擴散模型的先驗知識。

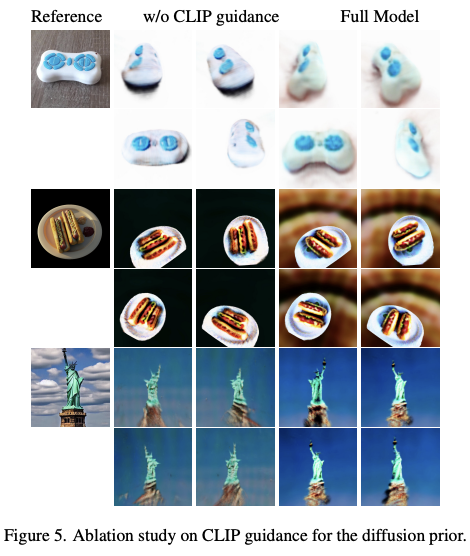

? 我們提出了一種以CLIP為引導的采樣策略,有效地將擴散模型的先驗知識與參考圖像結合起來。

? 當參考圖像難以精確描述時,我們在保持其生成多樣內容以指導NeRF訓練的能力的同時,對單張圖像進行擴散模型的微調。

? 我們引入了一種使用排名信息的尺度不變深度監督。這種設計減輕了對準確多視角一致深度估計的需求,并擴大了我們算法的應用范圍。

主要方法

1.從單個2D圖像中生成3D點云:首先,使用一個預訓練的2D圖像到3D點云模型來生成初始點云。然后,使用一個深度感知神經輻射場來對點云進行細化和修正。具體地,該神經輻射場將每個點的深度值作為輸入,并輸出一個向量場,該向量場將每個點移動到其正確的位置。

2.從3D點云中生成可渲染的3D網格:使用一個基于深度學習的方法來將點云轉換為可渲染的3D網格。具體地,該方法使用一個編碼器網絡將3D點云編碼為特征向量,并使用一個解碼器網絡將特征向量解碼為可渲染的3D網格。

3.從可渲染的3D網格中生成360°視圖:使用一個基于深度學習的方法來生成與給定參考圖像相對應的具有360°視圖的可信3D對象。具體地,該方法使用一個編碼器網絡將參考圖像編碼為特征向量,并使用一個解碼器網絡將特征向量解碼為360°視圖。

4.使用CLIP引導擴散先驗學習概率驅動3D提升:使用一個基于擴散的方法來生成3D對象,并使用CLIP模型來指導擴散過程。具體地,該方法使用一個初始的3D對象,并通過多次迭代來擴散該對象。在每次迭代中,使用CLIP模型來計算當前3D對象與參考圖像之間的相似度,并將相似度作為概率分布來指導擴散過程。

5.使用比例不變深度排名損失減輕深度誤差:使用一個比例不變深度排名損失來訓練模型,以減輕深度誤差。具體地,該損失函數將每個像素的深度值與其在圖像中的排名相關聯,并使用比例不變的方式來計算損失。這種方法可以減輕深度誤差,并提高模型的性能。

主要結果

審核編輯 :李倩

-

編碼器

+關注

關注

45文章

3651瀏覽量

134769 -

網格

+關注

關注

0文章

139瀏覽量

16027 -

深度學習

+關注

關注

73文章

5507瀏覽量

121296

原文標題:NeuralLift-360:將野外的2D照片提升為3D物體

文章出處:【微信號:3D視覺工坊,微信公眾號:3D視覺工坊】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

如何同時獲取2d圖像序列和相應的3d點云?

視覺處理,2d照片轉3d模型

2D到3D視頻自動轉換系統

NeuralLift-360:將野外的2D照片提升為3D物體

NeuralLift-360:將野外的2D照片提升為3D物體

評論