超級智能 AI 不會有人類的情感,因此在本質(zhì)上不會是仁慈或惡毒的。

這么多的可能性;我們已經(jīng)面對如此多的現(xiàn)實。無論普通人是否意識到,人工智能 (AI) 和機(jī)器學(xué)習(xí) (ML) 已經(jīng)控制了他們大部分的在線生活。例如,這些技術(shù)決定了他們的新聞提要中顯示的內(nèi)容,并定制了他們在訪問亞馬遜時看到的內(nèi)容。

現(xiàn)在,算法決定了我們的保險費率是多少,我們是否有資格獲得貸款,或者我們的簡歷是否會被選中進(jìn)行進(jìn)一步審查。人工智能和機(jī)器學(xué)習(xí)現(xiàn)在在醫(yī)學(xué)領(lǐng)域很“熱門”,可以進(jìn)行診斷、預(yù)測疾病爆發(fā)等等。

我們正面臨物聯(lián)網(wǎng) (IoT) 的一場革命——無人駕駛汽車、智能家居、智能家電、智能電網(wǎng),甚至是智能城市。醫(yī)療專業(yè)人員遠(yuǎn)程監(jiān)控患者,當(dāng)然,我們不能忘記 Siri 和 Alexa。

確實,我們生活在一個技術(shù)的美好世界,該技術(shù)有望繼續(xù)讓我們的生活更輕松、更高效。

權(quán)力和責(zé)任

所有這些改變我們生活的權(quán)力也帶來了更大的責(zé)任——濫用這種權(quán)力是許多人(例如埃隆·馬斯克)擔(dān)心的問題。最近,在一次采訪中,Elon 談到了 AI 和 ML:

“我們正在迅速朝著超越任何人類的數(shù)字超級智能邁進(jìn)——我認(rèn)為這很明顯……如果一家公司或一小群人設(shè)法開發(fā)出神一樣的數(shù)字超級智能,他們可以接管世界……至少當(dāng)有一個邪惡的獨裁者時,那個人會死,但對于人工智能來說,就不會死。它將永遠(yuǎn)存在,然后你將擁有一個不朽的獨裁者,我們永遠(yuǎn)無法逃脫。”

馬斯克已經(jīng)加入了許多研究人員和科學(xué)家的行列,例如斯蒂芬霍金,他們預(yù)測如果 AI 和 ML 研究和實施沒有得到嚴(yán)格監(jiān)管,就會出現(xiàn)這樣的世界末日。

這場爭論的另一面是反對者,他們堅持認(rèn)為 AI 和 ML 永遠(yuǎn)不會取代完整的人類智能,因此是可以控制的。

AI 和 ML 到底有什么危險?

這是爭議的關(guān)鍵。目前,我們擁有所謂的窄人工智能或弱人工智能,旨在完成一組離散任務(wù)(駕駛汽車、保護(hù)電網(wǎng)、下棋、通過面部識別識別人等)。

然而,許多人的長期目標(biāo)是開發(fā)能夠執(zhí)行認(rèn)知(思考、推理)任務(wù)的所謂強(qiáng)人工智能。例如,想象一下一個致命的武器系統(tǒng),它可以在沒有任何人為干預(yù)或控制的情況下決定何時何地部署其武器。這樣的制度,在一個民族國家的手中,可能會讓世界其他地方屈服。

另一個危險?超級智能 AI 不會有人類的情感,因此在本質(zhì)上不會是仁慈或惡毒的。但是,它將是有效的,并采取“最短路徑”來實現(xiàn)目標(biāo),而不考慮它在此過程中可能會破壞什么。例如,假設(shè)一臺配備人工智能的機(jī)器的任務(wù)是為新的鐵路系統(tǒng)清理大片土地。如果在執(zhí)行這項任務(wù)的過程中,它破壞了地下輸油管道,從而釋放出破壞該地區(qū)整個生態(tài)系統(tǒng)并使當(dāng)?shù)厮到y(tǒng)處于危險之中的有毒污泥,會發(fā)生什么?如果保護(hù)生態(tài)系統(tǒng)沒有被定義為機(jī)器的目標(biāo)之一,它可能會不顧一切地繼續(xù)下去。

那些擔(dān)心這些場景(認(rèn)知 AI 和 ML 不斷學(xué)習(xí)并變得比人類更“聰明”)的人表示,我們必須弄清楚如何在 AI 系統(tǒng)變得超級智能之前將我們自己的目標(biāo)嵌入到系統(tǒng)中。

預(yù)計短期內(nèi)不會出現(xiàn)革命,而是進(jìn)化認(rèn)知人工智能。事實上,即使是專家也不同意超智能 AI 成為現(xiàn)實需要多長時間,如果——確實——真的如此的話。但隨著技術(shù)的發(fā)展,我們確實必須提前計劃可能發(fā)生的事情,以免發(fā)生在我們身上,惡意的人會卷入其中或出現(xiàn)意想不到的后果。

許多認(rèn)知人工智能不會產(chǎn)生可怕的后果,但可能性仍然令人擔(dān)憂。想想今天的許多學(xué)生已經(jīng)找到了為他們寫論文和論文的方法。有些公司,例如Wow Grade.net,提供寫作和內(nèi)容創(chuàng)作服務(wù)。未來使用認(rèn)知人工智能將允許學(xué)生簡單地翻轉(zhuǎn)一個主題,讓超級智能技術(shù)做出關(guān)于論文的所有決定、識別資源并創(chuàng)建“原創(chuàng)”作文。雖然學(xué)生顯然沒有完成這項工作,但如果孤立地考慮,后果并不嚴(yán)重,盡管學(xué)生實際上沒有學(xué)習(xí)任何東西(除了如何作弊)這一事實對未來來說并不是一個好兆頭。

讓我們回到我們之前的場景中,一個人工智能系統(tǒng)的任務(wù)是做一些有益的事情,但無意中導(dǎo)致了毀滅性的后果;i、 例如,生態(tài)系統(tǒng)和當(dāng)?shù)毓┧獾狡茐摹3壷悄蹵I避免此類行為本應(yīng)在中編程。

因此,超智能人工智能的整個問題似乎不是人工智能的效率(它將是完全有效的),而是將其認(rèn)知智能與我們自己的人類目標(biāo)相結(jié)合。如果我們只關(guān)注效率,那么我們將通過人工智能選擇的任何方式得到我們想要的東西。

規(guī)劃和法規(guī)必須從現(xiàn)在開始在波多黎各舉行

的2015 年生命未來人工智能安全會議上,大多數(shù)人工智能研究人員預(yù)測,認(rèn)知人工智能將在 2060 年出現(xiàn)在我們面前。如果是這樣,那么安全研究必須現(xiàn)在就開始。

人類目前統(tǒng)治著地球,因為我們是地球上所有物種中最聰明的。但是,當(dāng)一個超級智能的 AI 繼續(xù)自我學(xué)習(xí)和自我改進(jìn)時會變得更聰明時會發(fā)生什么?屆時誰來統(tǒng)治?

審核編輯 黃昊宇

-

AI

+關(guān)注

關(guān)注

87文章

31155瀏覽量

269487 -

人工智能

+關(guān)注

關(guān)注

1792文章

47442瀏覽量

239004 -

ML

+關(guān)注

關(guān)注

0文章

149瀏覽量

34670

發(fā)布評論請先 登錄

相關(guān)推薦

AI for Science:人工智能驅(qū)動科學(xué)創(chuàng)新》第4章-AI與生命科學(xué)讀后感

為AI、ML和數(shù)字孿生模型建立可信數(shù)據(jù)

芯科科技前沿的MCU+AI/ML開發(fā)工具解決方案

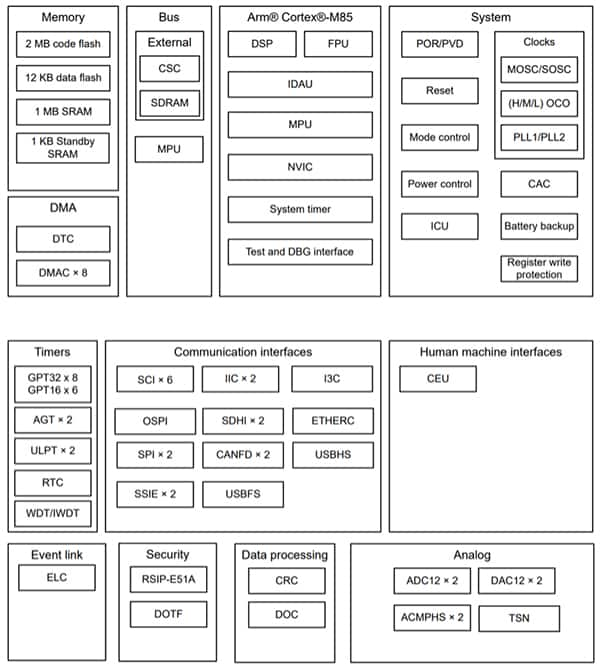

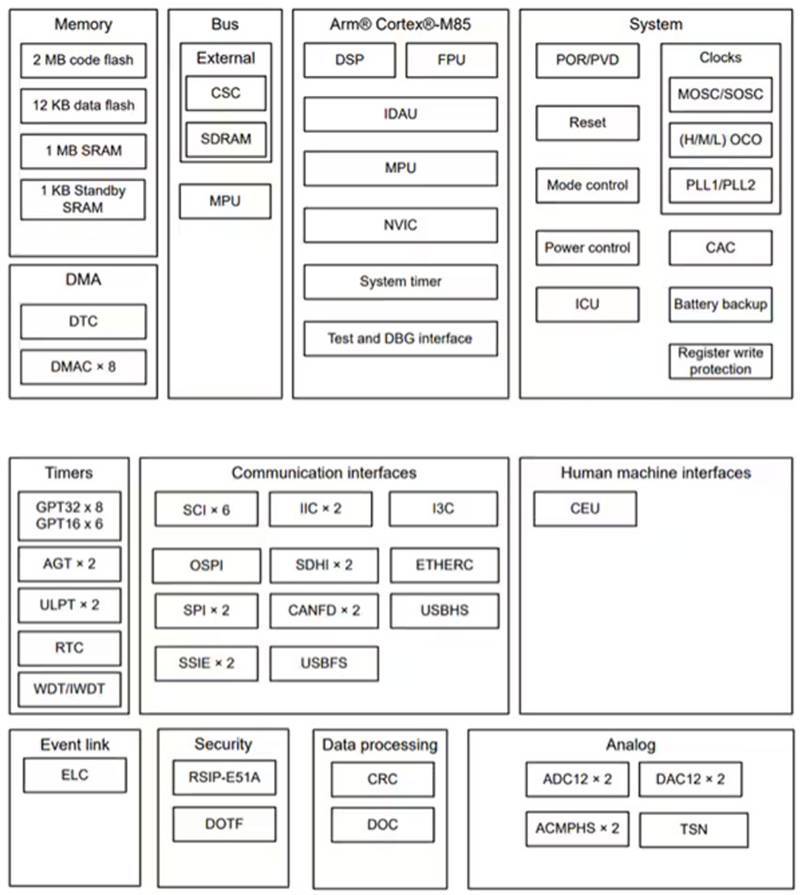

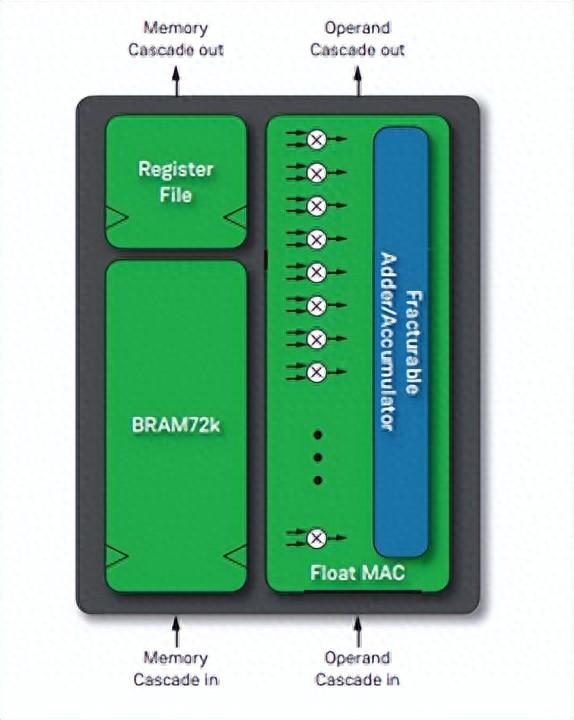

使用 Renesas RA8M1 MCU 快速地部署強(qiáng)大高效的 AI 和 ML 功能

基于 Renesas 的 RA8M1 實現(xiàn) AI 和 ML 部署

通過無代碼方法開發(fā)Edge AI和ML

Alif Semiconductor宣布推出先進(jìn)的BLE和Matter無線微控制器,搭載適用于AI/ML工作負(fù)載的神經(jīng)網(wǎng)絡(luò)協(xié)同處理器

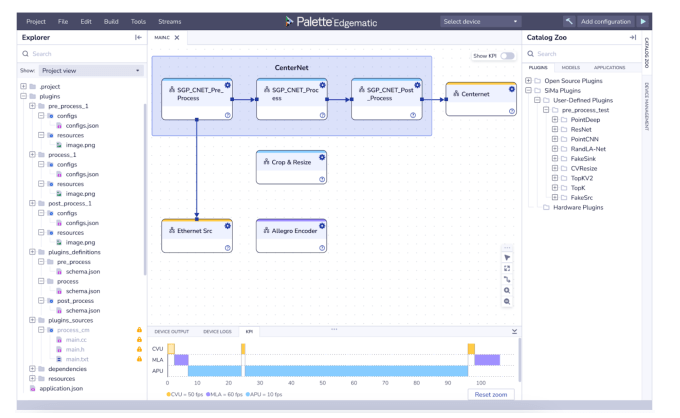

新型的FPGA器件將支持多樣化AI/ML創(chuàng)新進(jìn)程

Achronix新推出一款用于AI/ML計算或者大模型的B200芯片

是德科技推出AI數(shù)據(jù)中心測試平臺

是德科技推出AI數(shù)據(jù)中心測試平臺旨在加速AI/ML網(wǎng)絡(luò)驗證和優(yōu)化的創(chuàng)新

國際最新AI算力評測標(biāo)準(zhǔn)SPEC ML即將發(fā)布,浪潮信息連任SPEC ML主席

AI 和 ML:我們應(yīng)該擔(dān)心嗎?

AI 和 ML:我們應(yīng)該擔(dān)心嗎?

評論