谷歌本周發(fā)布了一個工具集附件,允許開發(fā)人員使用機(jī)器學(xué)習(xí)模型更好地控制私有數(shù)據(jù)的泄漏。

TensorFlow隱私模塊采用了一種更新的方法來測試海量數(shù)據(jù)集中的漏洞,該數(shù)據(jù)集中包含用于醫(yī)療,面部識別和監(jiān)視等目的的信息。

Google于一年前建立了TensorFlow隱私庫,以幫助開發(fā)人員在機(jī)器學(xué)習(xí)項(xiàng)目中實(shí)現(xiàn)更高的準(zhǔn)確性,同時降低損害數(shù)據(jù)庫中所包含主題的個人數(shù)據(jù)的風(fēng)險。谷歌當(dāng)時表示:“現(xiàn)代機(jī)器學(xué)習(xí)正越來越多地用于創(chuàng)建令人驚嘆的新技術(shù)和用戶體驗(yàn),其中許多涉及培訓(xùn)機(jī)器,以負(fù)責(zé)任地從敏感數(shù)據(jù)(例如個人照片或電子郵件)中學(xué)習(xí)。我們打算將TensorFlow Privacy開發(fā)為同類最佳的技術(shù)中心,用于訓(xùn)練具有強(qiáng)大隱私保護(hù)功能的機(jī)器學(xué)習(xí)模型。”

在2019年發(fā)布時,TensorFlow Privacy依靠一種稱為差異隱私的概念,在該概念中,數(shù)據(jù)集內(nèi)的組模式在公共范圍內(nèi)共享,而屏蔽了構(gòu)成數(shù)據(jù)集的個人的鏈接。在深度學(xué)習(xí)應(yīng)用程序中,開發(fā)人員通常旨在對通用模式進(jìn)行編碼,而不是幫助識別參與者并威脅匿名的特定細(xì)節(jié)。

實(shí)現(xiàn)此目的的一種方法是引入有限的“噪聲”,以幫助保護(hù)用戶的身份。然而,這種噪聲具有降低精度的風(fēng)險。

Google在本周宣布的TensorFlow模塊中采用了一種新方法。TensorFlow Privacy應(yīng)用名為“成員推斷攻擊”的測試,可以建立一個分?jǐn)?shù),揭示模型對泄露信息的脆弱程度。

谷歌在其TensorFlow博客上表示:“具有成本效益的成員推斷攻擊可以預(yù)測在培訓(xùn)期間是否使用了特定的數(shù)據(jù)。”“如果攻擊者能夠進(jìn)行高精度的預(yù)測,那么他們很可能會成功地弄清楚訓(xùn)練集中是否使用了數(shù)據(jù)。成員推斷攻擊的最大優(yōu)點(diǎn)是易于執(zhí)行且不會需要任何再培訓(xùn)。”

谷歌說:“這些測試最終可以幫助開發(fā)者社區(qū)確定更多結(jié)合了隱私設(shè)計(jì)原則和數(shù)據(jù)處理選擇的架構(gòu)。”

Google認(rèn)為這是“健壯的隱私測試套件”的起點(diǎn),由于其易用性,各種技能水平的機(jī)器學(xué)習(xí)開發(fā)人員都可以使用它。

隨著越來越多的機(jī)構(gòu)依賴于需要大量數(shù)據(jù)的機(jī)器學(xué)習(xí)項(xiàng)目,對隱私的關(guān)注也越來越高。去年,由于在出版之前未征得受試者的許可,微軟被迫從其全球分布的MS Celeb面部識別培訓(xùn)計(jì)劃中刪除了超過1000萬張圖像。越來越多的人擔(dān)心胸部X光片可能會暴露個人信息,因此Google匆匆放棄了與Ascension的健康數(shù)據(jù)共享項(xiàng)目。

蘋果和谷歌對圍繞數(shù)以百萬計(jì)的AI代理(例如Siri和Google Assistant)的用戶使用弱保護(hù)隱私的行為提出了批評,據(jù)報道,人們在未經(jīng)授權(quán)的情況下存儲和訪問了來自人手機(jī)及其房屋的錄音。

-

Google

+關(guān)注

關(guān)注

5文章

1772瀏覽量

57790 -

機(jī)器學(xué)習(xí)

+關(guān)注

關(guān)注

66文章

8438瀏覽量

133063 -

數(shù)據(jù)集

+關(guān)注

關(guān)注

4文章

1209瀏覽量

24827

發(fā)布評論請先 登錄

相關(guān)推薦

谷歌發(fā)布“深度研究”AI工具,利用Gemini模型進(jìn)行網(wǎng)絡(luò)信息檢索

SOLIDWORKS增效插件 SolidKits工具集

谷歌推新AI音樂工具,發(fā)布第六代TPU芯片

谷歌發(fā)布多模態(tài)AI新品,加劇AI巨頭競爭

谷歌DeepMind發(fā)布人工智能模型AlphaFold最新版本

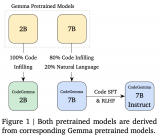

谷歌發(fā)布用于輔助編程的代碼大模型CodeGemma

谷歌推出能制作旅行攻略的AI工具

基于DfuSe工具從APP跳轉(zhuǎn)到DFU,工具附件()無法下載的原因?

谷歌模型合成工具在哪下載安裝

谷歌模型合成工具在哪找到

谷歌模型訓(xùn)練軟件有哪些?谷歌模型訓(xùn)練軟件哪個好?

谷歌模型合成工具怎么用

谷歌發(fā)布全新AI模型Genie

谷歌發(fā)布開源AI大模型Gemma

谷歌發(fā)布了一個工具集附件

谷歌發(fā)布了一個工具集附件

評論