在加速計(jì)算領(lǐng)域25年,英偉達(dá)用15億塊GPU的出貨量交上了一份學(xué)霸成績(jī)單。

這每一塊GPU都兼容CUDA,都采用同一個(gè)架構(gòu)——這是黃仁勛的GPU帝國(guó)中最可圈可點(diǎn)的一筆。統(tǒng)一的架構(gòu),可以用于各種工作負(fù)載去實(shí)現(xiàn)加速計(jì)算;在芯片起點(diǎn)之上,通過(guò)完整的堆棧工程可進(jìn)一步實(shí)現(xiàn)加速。

CUDA平臺(tái)具有豐富的庫(kù)、工具和應(yīng)用程序,僅去年就發(fā)布了500多個(gè)SDK和庫(kù),其中既有全新內(nèi)容,也有更新版本。通過(guò)不斷優(yōu)化,深度學(xué)習(xí)訓(xùn)練在3年內(nèi)提升了4倍、深度學(xué)習(xí)推理在1年內(nèi)提高了2倍。

過(guò)去幾年內(nèi),AI取得了巨大的進(jìn)展,開(kāi)始逐步改變各個(gè)行業(yè)。從圖象識(shí)別、圖象分類到識(shí)別不同的物體等,甚至能夠識(shí)別圖象中的每一個(gè)像素。這背后,深度學(xué)習(xí)的驅(qū)動(dòng)力量是巨大的。在今年的GTC上,黃仁勛也重點(diǎn)介紹了英偉達(dá)在推薦系統(tǒng)和會(huì)話式AI二大方向的重大進(jìn)展。

在線推薦系統(tǒng)為“雙11”提速

推薦系統(tǒng)已經(jīng)成為互聯(lián)網(wǎng)的重要引擎。我們?cè)诰€購(gòu)物時(shí)有數(shù)十億的產(chǎn)品有待選擇,上萬(wàn)億的網(wǎng)頁(yè)可供瀏覽、上百萬(wàn)的視頻以及應(yīng)用……如何將合適的內(nèi)容、產(chǎn)品在合適的時(shí)間推送給用戶?這是所有電商平臺(tái)、社交媒體等面臨的最大痛點(diǎn)。

這背后需要非常深入地理解每一個(gè)用戶的偏好、歷史行為等,以及每一個(gè)產(chǎn)品多種多樣的特性,這幾乎形成了一個(gè)TB級(jí)的數(shù)據(jù)集。

而一個(gè)最為生動(dòng)的案例就是阿里巴巴的年度購(gòu)物節(jié)“雙11”。今年“雙11”,阿里巴巴創(chuàng)造了380億美元的銷售額,相比于去年的310億美元,增長(zhǎng)了近四分之一,是“黑色星期五”和“網(wǎng)購(gòu)星期一”的網(wǎng)購(gòu)銷售額總和的兩倍多。

對(duì)于阿里巴巴來(lái)說(shuō),推薦系統(tǒng)是一個(gè)至關(guān)重要的應(yīng)用程序。該系統(tǒng)可以向用戶展示與其喜好相匹配的商品,從而提高點(diǎn)擊率。而點(diǎn)擊率在電商行業(yè)一直都是提高銷售量的重要驅(qū)動(dòng)力。點(diǎn)擊率的每一次小幅提高都會(huì)直接影響用戶的體驗(yàn)和商家的營(yíng)收。

阿里巴巴使用NVIDIA GPU支持資源分配、模型量化和圖變換三項(xiàng)優(yōu)化策略,從而提高吞吐量和響應(yīng)性。通過(guò)NVIDIA T4 GPU,能夠?yàn)橥扑]模型提供加速,實(shí)現(xiàn)每秒處理780個(gè)查詢,遠(yuǎn)遠(yuǎn)領(lǐng)先于基于CPU每秒3個(gè)查詢的推理。

英偉達(dá)加速計(jì)算產(chǎn)品管理總監(jiān)Paresh Kharya表示,推薦系統(tǒng)所面臨的挑戰(zhàn)是巨大的,主要體現(xiàn)在兩方面:第一,這些模型極其復(fù)雜,因?yàn)樾枰幚淼臄?shù)據(jù)量是海量的。為了提升推薦的相關(guān)度,必須要對(duì)所有參數(shù)來(lái)進(jìn)行建模。比如:用戶的一些購(gòu)買(mǎi)記錄、瀏覽記錄等,要處理的參數(shù)非常多。第二,這些模型要做出實(shí)時(shí)的計(jì)算,因?yàn)橛脩粼跒g覽時(shí)需要立刻看到推薦結(jié)果,不可能等待很長(zhǎng)時(shí)間。

這兩大挑戰(zhàn)都需要以非常快的速度完成計(jì)算,阿里巴巴從CPU轉(zhuǎn)移到GPU的使用后,點(diǎn)擊通過(guò)率提升了10%。而事實(shí)上,這樣的“點(diǎn)擊率”每提升一點(diǎn)點(diǎn)都是非常困難的,GPU由于其實(shí)時(shí)性、大規(guī)模運(yùn)行的特性能夠用于這一系統(tǒng)中。

而不僅僅是電子商務(wù)領(lǐng)域,只要是需要將產(chǎn)品與人之間進(jìn)行匹配都需要用到這樣的推薦系統(tǒng)。百度、快手、美團(tuán)、微軟必應(yīng),甚至一些傳統(tǒng)企業(yè)如:沃爾瑪、美國(guó)郵政等等,都在其推薦系統(tǒng)中采用了英偉達(dá)的GPU平臺(tái)。

值得一提的是,其他的處理器如FPGA目前也在發(fā)力推薦系統(tǒng)這一領(lǐng)域。Paresh Kharya表示,AI的更新迭代非常快,模型的規(guī)模非常大,每隔幾分鐘就在進(jìn)行更新,整個(gè)推理過(guò)程不斷在變化,因此需要不斷對(duì)這些模型進(jìn)行訓(xùn)練,才可以進(jìn)行有效的推薦,這需要大量的算力。GPU可以說(shuō)是AI領(lǐng)域的專用芯片,有指令集優(yōu)勢(shì)、全可編程、并且是軟件定義的。此外,架構(gòu)也是向前兼容的,整個(gè)硬件架構(gòu)可以隨著軟件不斷更新,而且是在軟件庫(kù)就可以直接更新。

不光是GPU能提供的算力,英偉達(dá)也在通過(guò)工具和軟件來(lái)提供支持。比如通過(guò)最新的TensorRT來(lái)支持模型在各種情景下的部署,并且支持上百萬(wàn)用戶在每秒內(nèi)做數(shù)十億的搜索。

會(huì)話式AI通往真正的人工智能人機(jī)交互

在會(huì)話式AI方面,黃仁勛宣布了最新版本的推理軟件NVIDIA Tensor RT7,它能夠?qū)崿F(xiàn)更智能的AI人機(jī)交互,可實(shí)現(xiàn)與語(yǔ)音代理、聊天機(jī)器人和推薦引擎等應(yīng)用進(jìn)行實(shí)時(shí)互動(dòng)。

實(shí)現(xiàn)會(huì)話式AI的難點(diǎn)主要在于什么?Paresh Kharya表示,要實(shí)現(xiàn)會(huì)話式AI,首先,需要理解用戶到底在說(shuō)什么,然后將他所說(shuō)的語(yǔ)音轉(zhuǎn)化成文字,然后理解文字的意思,再把它轉(zhuǎn)化成語(yǔ)言,所以涉及很多模型同時(shí)發(fā)揮作用,需要多種多樣的神經(jīng)網(wǎng)絡(luò)提供支持。第二,所有這個(gè)復(fù)雜計(jì)算的過(guò)程必須要在300毫秒之內(nèi)完成,假設(shè)如果需要幾秒鐘的話,這在實(shí)際的對(duì)話中是無(wú)法容忍的時(shí)延,會(huì)話式AI也就失去了意義。

TensorRT 7內(nèi)置新型深度學(xué)習(xí)編譯器。該編譯器能夠自動(dòng)優(yōu)化和加速遞歸神經(jīng)網(wǎng)絡(luò)與基于轉(zhuǎn)換器的神經(jīng)網(wǎng)絡(luò)。與在CPU上運(yùn)行時(shí)相比,會(huì)話式AI組件速度提高了10倍以上,從而得以實(shí)現(xiàn)所需的300毫秒閾值以下。

對(duì)于在會(huì)話式AI領(lǐng)域的投入,黃仁勛表示:“我們已進(jìn)入了一個(gè)機(jī)器可以實(shí)時(shí)理解人類語(yǔ)言的AI新時(shí)代。TensorRT 7使這成為可能,為世界各地的開(kāi)發(fā)者提供工具,使他們能夠構(gòu)建和部署更快、更智能的會(huì)話式AI服務(wù),實(shí)現(xiàn)更自然的AI人機(jī)交互。”

TensorRT是英偉達(dá)的推理優(yōu)化軟件。英偉達(dá)的GPU不論是用在自動(dòng)駕駛、數(shù)據(jù)中心,還是嵌入式設(shè)備等領(lǐng)域,都需要運(yùn)行在PyTorch、TensorFlow等多個(gè)框架中訓(xùn)練自我優(yōu)化的AI模型,TensorRT能夠提供這種優(yōu)化的模型。

由于AI有多種多樣的使用場(chǎng)景,不同場(chǎng)景由不同的神經(jīng)網(wǎng)絡(luò)提供支持。而為了優(yōu)化AI性能,也需要優(yōu)化各種各樣的神經(jīng)網(wǎng)絡(luò)。TensorRT 7的推出算是跨出了巨大的一步,Transformer和RNN這些模型,都可以用TensorRT 7來(lái)進(jìn)行優(yōu)化。其中,Transformer典型的模型是BERT,有很多非常先進(jìn)的自然語(yǔ)言理解的功能;RNN的典型例子就是語(yǔ)音識(shí)別或者將文本轉(zhuǎn)化成語(yǔ)音。

英偉達(dá)對(duì)TensorRT 7也進(jìn)行了大量的優(yōu)化,例如很多數(shù)學(xué)的運(yùn)算,確保能夠更加高效、并且減少使用的內(nèi)存。另外,TensorRT 7中引入了內(nèi)核生成的功能,用任何RNN都可以生成一個(gè)優(yōu)化的內(nèi)核。對(duì)比TensorRT 5僅能支持種類很少的幾個(gè)神經(jīng)網(wǎng)絡(luò),TensorRT 7基本上可以支持各大類神經(jīng)網(wǎng)絡(luò),這些模型對(duì)于“會(huì)話式AI”是至關(guān)重要的。

首次兼容arm架構(gòu)做加速計(jì)算

在GTC上,英偉達(dá)還釋放出了一個(gè)很值得玩味的信息:宣布推出基于arm的首個(gè)參考架構(gòu)——NVIDIA HPC for arm.雙方這一合作,究竟是英偉達(dá)加入arm的生態(tài),還是arm擁抱英偉達(dá)的江湖?

英偉達(dá)方面只是淡淡一句:希望不論是數(shù)據(jù)中心還是邊緣計(jì)算,不論是AI還是高性能計(jì)算,都能給客戶更多選擇。之前arm不支持CUDA,客戶已反復(fù)要求我們使用CUDA加速arm,并將arm服務(wù)器打造成HPC和AI的理想選擇。

全球有1500億臺(tái)基于arm架構(gòu)的設(shè)備,為客戶想實(shí)現(xiàn)的創(chuàng)新提供多種功能:包括互聯(lián)、內(nèi)存、CPU內(nèi)核、計(jì)算能力等多元化的支持。

在邊緣計(jì)算領(lǐng)域,英偉達(dá)已有arm架構(gòu)許可;超算領(lǐng)域,雙方于今年6月宣布了合作。兩個(gè)強(qiáng)大平臺(tái)和生態(tài)的握手,也并不意外。

-

NVIDIA

+關(guān)注

關(guān)注

14文章

5025瀏覽量

103270 -

gpu

+關(guān)注

關(guān)注

28文章

4754瀏覽量

129080 -

英偉達(dá)

+關(guān)注

關(guān)注

22文章

3800瀏覽量

91356

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

《CST Studio Suite 2024 GPU加速計(jì)算指南》

加速拋棄英偉達(dá),微軟又發(fā)布一顆芯片 #微軟 #英偉達(dá) #半導(dǎo)體 #芯片 #電路知識(shí)

英偉達(dá)與谷歌聯(lián)手加速量子計(jì)算設(shè)備設(shè)計(jì)

英偉達(dá)與谷歌攜手加速量子計(jì)算設(shè)備設(shè)計(jì)

軟銀升級(jí)人工智能計(jì)算平臺(tái),安裝4000顆英偉達(dá)Hopper GPU

GPU加速計(jì)算平臺(tái)是什么

三星電子HBM3E內(nèi)存獲英偉達(dá)認(rèn)證,加速AI GPU市場(chǎng)布局

英偉達(dá)發(fā)布新版NVIDIAApp

英偉達(dá)數(shù)據(jù)中心GPU出貨量飆升,市場(chǎng)份額持續(xù)領(lǐng)跑

英偉達(dá)GPU新品規(guī)劃與HBM市場(chǎng)展望

英偉達(dá)去年數(shù)據(jù)中心GPU出貨量占比約98%

進(jìn)一步解讀英偉達(dá) Blackwell 架構(gòu)、NVlink及GB200 超級(jí)芯片

英偉達(dá)、AMD、英特爾GPU產(chǎn)品及優(yōu)勢(shì)匯總

國(guó)內(nèi)GPU新勢(shì)力:能否成為英偉達(dá)的“終結(jié)者”?

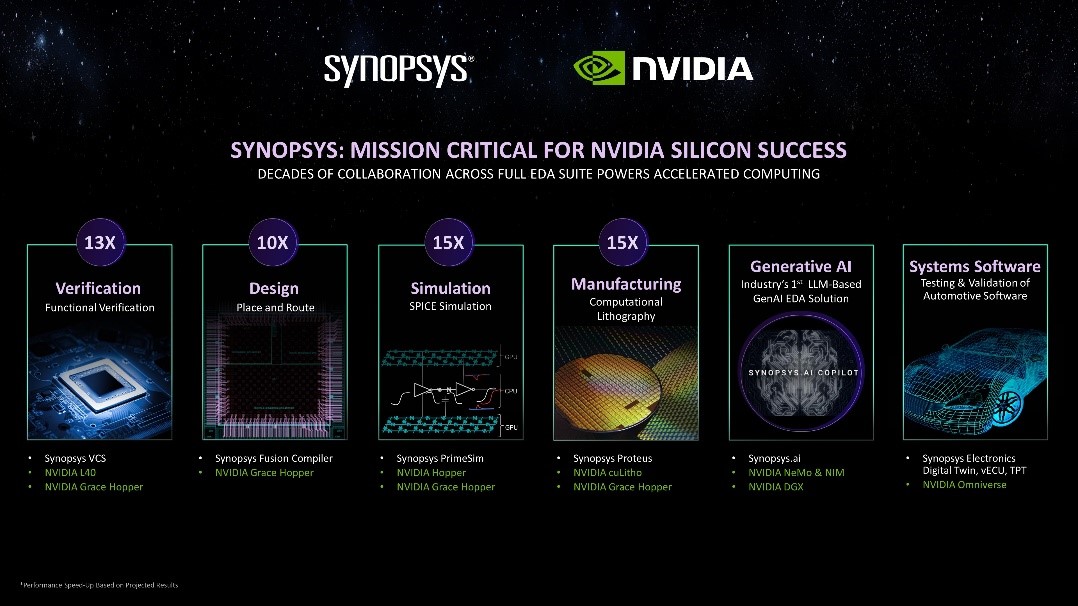

新思科技攜手英偉達(dá):基于加速計(jì)算、生成式AI和Omniverse釋放下一代EDA潛能

加速計(jì)算25年,英偉達(dá)GPU帝國(guó)的三塊新版圖

加速計(jì)算25年,英偉達(dá)GPU帝國(guó)的三塊新版圖

評(píng)論